基于质心和轮廓关键点的步态识别

陈 玲,杨天奇

CHEN Ling,YANG Tianqi

暨南大学 信息科学技术学院,广州510632

College of Information Science and Technology,Jinan University,Guangzhou 510632,China

1 引言

步态作为一种新型的身份识别手段,相比于指纹、虹膜、脸相等生物特征,具有可远距离感知,低分辨率获取,非侵犯性,无需配合的识别条件,更加适用于安全敏感场合对智能非接触式远距离的身份识别的要求。

步态识别通常包括步态运动检测、步态特征提取和特征识别3 个过程。其中,步态特征提取是步态识别技术的关键,主要分为两类:一类是基于模型的方法,如Cunado 等[1]将大腿建模为钟摆,从其倾斜角度信号的频率分量获取步态特征;Yoo 等[2]根据解剖学的知识,构建2D 人体杆状模型,将步态序列中的所有杆状模型连接起来构成步态模式。基于模型的方法通常要求获取到清晰的步态序列,并经过复杂的计算构建模型方可取得良好的识别性能,而且当身体出现自遮挡现象时识别率明显下降。第二类是基于非模型的方法,如Han 等[3]提出步态能量图(GEI)来反映侧影形状的变化,该算法对噪声更具鲁棒性,但是不足以反映连续帧之间的动态变化,丢失了一部分步态信息;王亮等[4]提出一种基于轮廓的解卷绕步态识别算法,用轮廓组成点到人体质心之间的连线来表达步态特征,这种方法依赖于人体整体轮廓形状随时间的变化,在衣着或是摆臂姿态发生变化时,对识别率有一定的影响。陈欣等[5]提出的基于质心的步态识别算法,将质心的波动作为步态特征,利用频谱分析质心运动轨迹识别个体,取得了较高的识别率且计算代价小,但是质心作为唯一特征容易受到噪声的干扰,且在样本数量增加的情况下容易出现质心波动的相似性,导致识别难度的增加。

基于以上的研究,本文提出一种将人体质心特征和轮廓特征相结合表示步态的识别算法。在运动检测阶段,通过时间差分法对实际目标进行检测,得到运动目标的二值化图像;在步态表征阶段,将人体质心高度,质心到头顶的距离,质心到双足边缘的距离组成一个四维向量,用它来表征一个步态姿势。步态序列可以看作是一组静态姿势所组成的模式,模式随时间的变化可以唯一表示个体的步态。在步态识别阶段,由于行人行走速率等差别,测试序列与样本序列的时间尺度一般不同,为了解决这一问题,采用动态时间规整(DTW)对存在全局或局部扩展、压缩或变形的模式进行匹配。实验在中科院标准CASIA 步态数据库上取得了较高的识别率,对视角不敏感,并且对衣着具有一定的鲁棒性。

2 步态运动检测

在对目标的检测跟踪环节中,先将原始视频图像转换为单通道灰度图像,再进行高斯滤波平滑图像,最后类似文献[6]采用三帧差分转换为二值图,计算如下:

式中,Tn(x)表示像素位置x处所具有统计意义的描述灰度变化的阈值,当某像素位置x处的灰度值In(x)相对于上一帧In-1(x) 和上两帧In-2(x) 都有较大的变化时,认为该点像素属于运动目标,这样将运动目标从背景中分离出,重复操作即得到一系列前景目标图像。

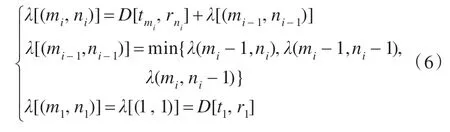

由于行走状态的不稳定性,目标不可能总与摄像机保持固定距离,所以此时提取的前景目标图像序列中不同帧之间的人体侧影大小是有差别的,不能直接用来提取步态特征,必须先对目标高度进行归一化。具体方法如下:假设P(i)为视频序列中第i帧只包含人体部分的矩形区域,其大小为m×n,利用双线插值将P(i)进行等比例缩放,缩放之后的图像高度为M,将序列中的所有帧进行同样处理,获得归一化的人体区域图像序列NormP,则NormP中所有图像的高度为M。归一化后的前景目标图像如图1 所示。

图1 运动目标检测与高度归一化

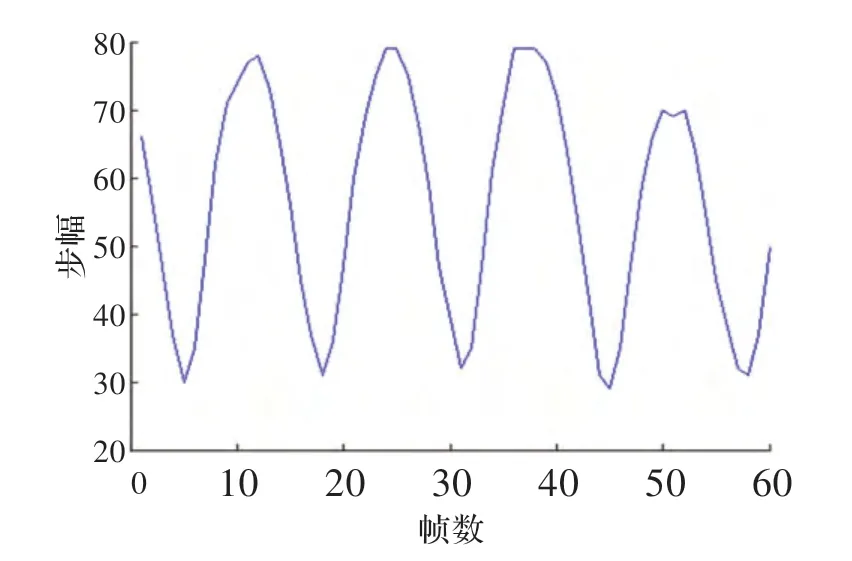

步态实验[7]证明步态运动具有准周期性的特点,所以提取出步态视频中的单个周期进行步态分析,不但能完全表示一个人行走的步态特征,而且可以减少运算量和时间开销。常用检测周期的方法有:使用人体宽度向量变化[8],人体下半身部分像素点的数目大小随时间的变化曲线[9],人体宽高比的变化[10]等。但上述方法计算过于复杂,本文直接用人体步长的周期性变化来确定步态序列的周期,图2 表示一个步态序列中目标个体的步长变化。

图2 步长随时间的变化

图2 中横坐标为序列帧数,纵坐标为步幅大小,波峰表示双侧下肢的足跟同时着地的情况。步态周期定义为同一只脚连续两次足跟触底的时间间隔[11],图中3个连续波峰之间的时间长度即为一个步态周期。

3 质心与轮廓特征参数提取

人体质心是指人体各部分合重力的作用点。人在行走过程中,由于人体姿势不停地发生改变,人体的重心也在不停地发生变化。研究[12-13]证明根据人体质心的运动轨迹可以判断人的步态,但仅靠质心的波动信号来识别个体仍不够完善。研究[4]发现基于步态的身份识别很大程度上依赖于人体轮廓形状随着时间的变化,可以用人体轮廓边界到人体质心的距离信号来表示步态姿势。这种方法计算量大,而且人体外形着装的变化很容易干扰人体轮廓的获取,从而造成较大的误差。通过实验表明[14],利用步态识别个体很大程度上是依靠人体的静态特征,例如人的身高、肢体长度等,和人体下半身尤其是双足相对位置的变化,双足相对位置的周期性变化引起了人体轮廓的周期性变化。结合上述研究成果,本文提取的特征为:(1)人体质心高度,质心的变化可以反应人体各个组成部分的相对变化;(2)质心到头顶的距离,头顶作为一个受外界影响较小并且随着步态成周期性波动的点,与质心的距离一方面可以反映行走模式的变化,另一方面可以侧面反映个体的身高;(3)质心到左足边缘的距离;(4)质心到右足边缘的距离,双足变化作为步态变化的决定性因素,提取其相关参数能够很好的反映行走的姿势变化。

对步态图片序列提取特征参数的步骤如下:

(1)确定单帧图像中质心和轮廓关键点的位置。人体的运动区域获取以后,基于连通性的边界跟踪算法用于获取它的轮廓。扫描轮廓点,容易获得轮廓最顶端、最左端和最右端的边缘点,分别记为头顶边缘点(xh,yh),左足边缘点(xl,yl) 和有右足边缘点(xr,yr)。这里需要注意的是,轮廓的左右边缘点的提取容易受到衣物或是臂摆的干扰,所以左右足关键点的提取限制在人体轮廓底部向上的1/4 区域内。质心根据轮廓点平均计算:

式中,(x,y)表示人体某一像素点的坐标,N表示人体区域像素点总个数,(xc,hc)表示人体质心位置。

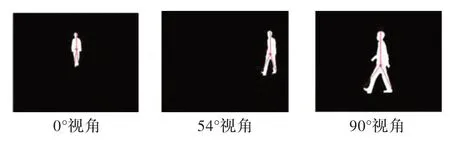

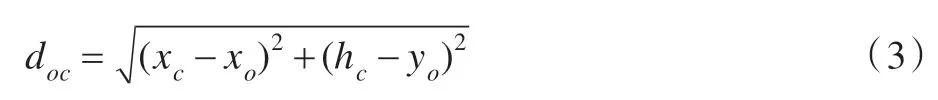

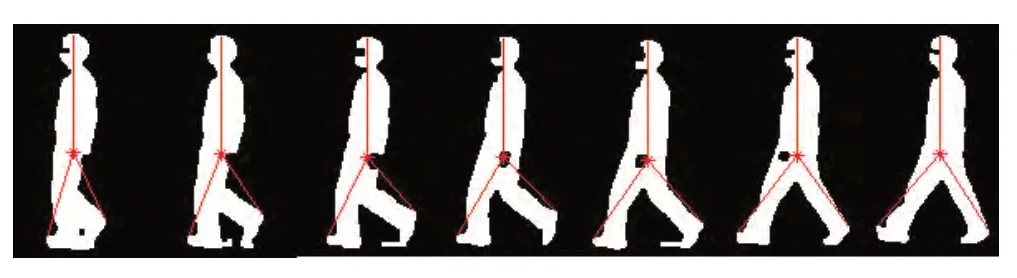

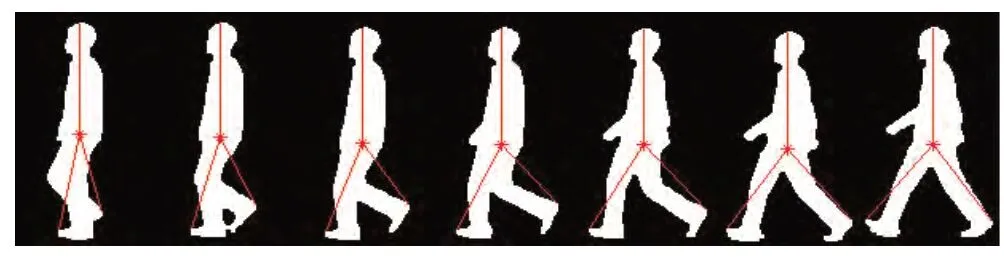

(2)单帧图像特征参数的提取。图像的特征参数可以表示为:tm(i)=[hc;dhc;dlc;drc],tm(i)表示i号个体第m帧图像的步态特征向量,hc为质心高度,dhc、dlc和drc分别表示质心到头顶、左足和右足关键点的距离。距离的计算如式(3)所示,doc表示质心与轮廓关键点之间的距离,(xo,yo)表示关键点的坐标。图3 分别是0°、54°和90°视角下提取了步态参数的单帧二值化人体图像。

图3 不同视角下的特征参数提取情况

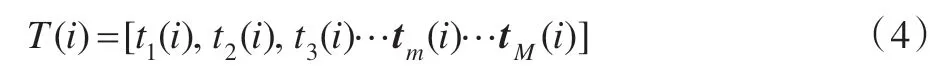

(3)获取目标运动序列的步态特征。运动序列的步态特征可以由一个步态周期内所有图像帧的特征参数组合而成,可以表示为:

其中,T(i)表示i号个体一个周期内的整体步态特征,tm(i)是i号个体第m帧图像的步态特征向量,M表示周期内的图像总帧数。

4 动态时间规整算法

在步态识别中,由于样本行走速率的不确定性,一个周期内步态图像帧数不完全相同,这使得提取出的特征参数长度不一,为了能够对存在全局或局部扩展、压缩或变形的模式进行匹配,解决动态模式的相似性度量和分类问题,选择柔性模式匹配算法——动态时间规整(DTW)[15-16]来进行步态模式的匹配。

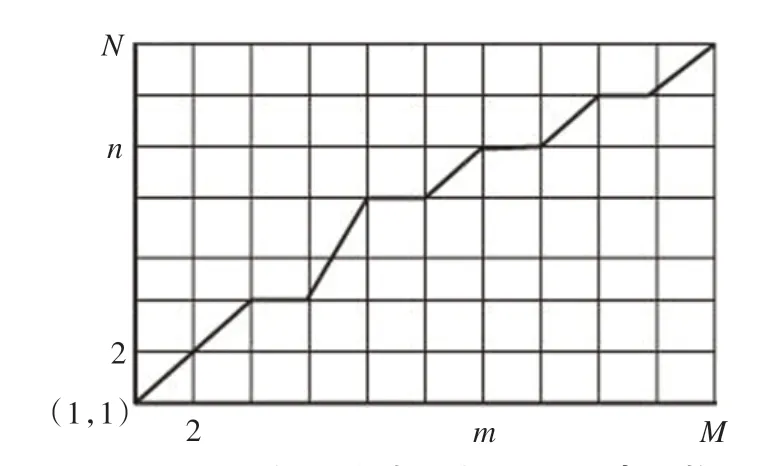

假设测试的步态序列为:T=[t1,t2,…,tm,…,tM],数据库中的模板步态序列为:R=[r1,r2,…,rn,…,rN],参考模版和测试模版的每个分量可以是一个数或者是一个多维向量,M不一定等于N,但是每个分量的维数应该相同。将测试模板和参考模板的分量号分别在坐标系的横轴和纵轴标出,构成一个M×N的网格。网格中的任何一个交叉点(m,n)表示测试模板的特征分量tm和参考模板的特征分量rn相交,交叉点的值定义为tm和rn的失真度D(tm,rn),单个矢量之间的失真度可用欧式距离计算:D(tm,rn)=(tm-rn)2。网格如图4 所示。

图4 测试模板和参考模板的失真度网格

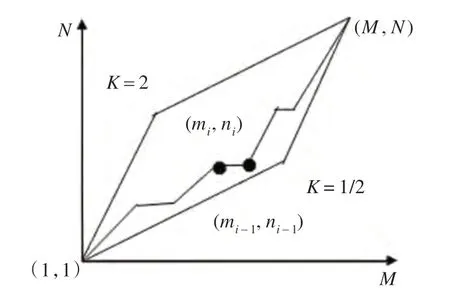

动态时间规整算法归结为找一条通过网格一系列交叉点的最佳路径,使得该路径上所有交叉点的失真度总和达到最小。考虑到行走的实际情况,上述搜索过程中的路径选择并不是任意的。首先,虽然行走速率会有所改变,但是步态各个部分的先后次序不可能颠倒,因此上述路径必然始于网格左下角,终于网格右上角;其次,步态是一个连续的行为,必须保证特征向量匹配的连续性,不能跨过某个格点去匹配;最后,为了防止盲目的搜索,一般不容许向横轴或纵轴过分倾斜,一般规定路径中各点处斜率的最大值为2,最小值为1/2,图5 所示的外边框平行四边形说明了DTW 的搜索范围。

图5 动态时间规整路径搜索范围

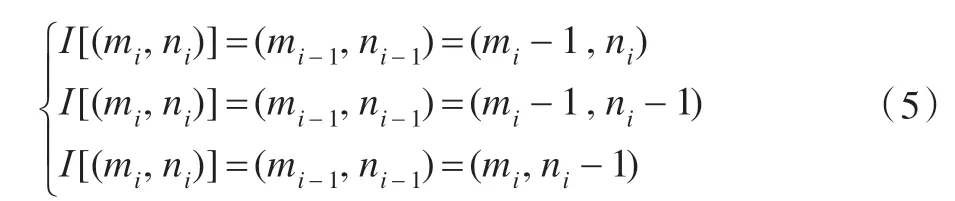

为了描述DTW 路径上交叉点的关系,定义函数Ι[(mi,ni)]为当前点(mi,ni)的前一个网格点,根据上述搜索限制,Ι[(mi,ni)]必须满足以下条件之一:

定义路径代价函数λ[(mi,ni)],表示从网格起始点出发到当前点(mi,ni)的各点失真度累计值,根据以上约束,得出如下递推公式:

由公式(6),即可计算出长度不同的测试序列T和模板序列R之间的最小失真度累计和D(T,R)=λ[(M,N)],求得动态规整算法的最佳匹配路径。

5 步态识别实验

本文在MATLAB环境下进行实验仿真,采用中科学院自动化(CASIA)步态数据库中的Database B。Database B 是一个大规模、多视角的步态库,共有124 个人,每个人有11 个视角(0°,18°,36°,…,180°),分别在3 种行走状态下(普通、穿大衣、携包)采集,在相同视角下,每个人在第一种行走状态下有6 个图像序列,其他状态下各两个序列,每个视频序列包含2~3 个步态周期,这些彩色视频序列的帧率是25 帧/s,图像尺寸为320×240,长度也都在100 帧左右。本文实验基于Database B 中的124 人,每人选取3 个视角(0°正面视角、54°斜面视角和90°侧面视角),每个视角3 种行走状态(普通、穿大衣、挎包)。为了验证本文特征选取方法对身份识别有效性和对外在服饰携带物等因素的鲁棒性,对每个视角下的行人选取一个普通状态下的步态序列作为模板序列,再分别选取两个普通状态、大衣状态和携包状态的步态序列作为测试序列、匹配模板序列和测试序列的来识别待测步态的类别。

5.1 步态特征的提取及识别

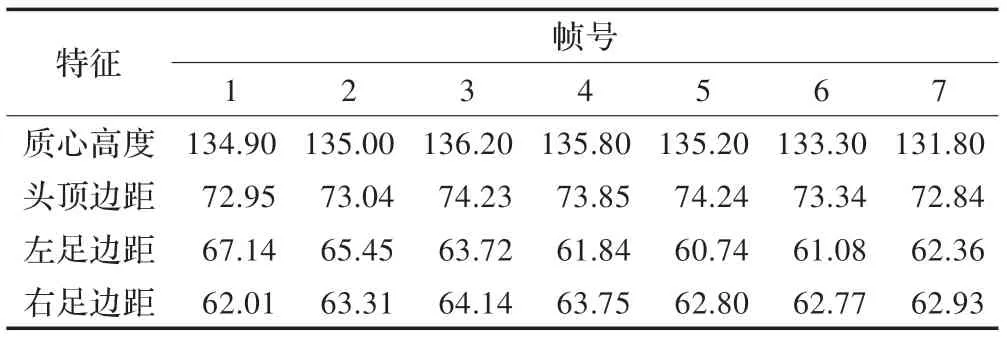

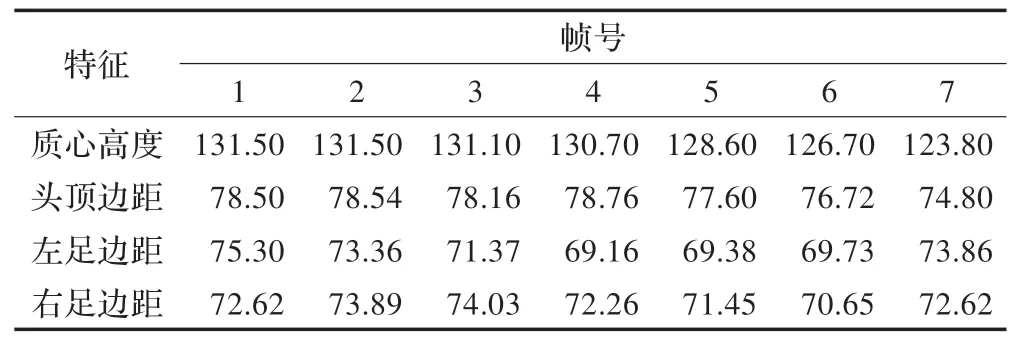

图6、图7,表1、表2 分别选取了4 号个体和1 号个体在90°视角下部分帧的步态特征提取图和与之对应的特征参数值。

图6 4 号个体的特征参数提取图

图7 1 号个体的特征参数提取图

表1 4 号个体特征参数值

表2 1 号个体的特征参数值

由以上图表可知,不同个体历经相似步态姿势时,特征参数之间显示出显著差异性。通过测试序列和模板序列一个周期内全部图像帧的参数匹配,即可识别出待测个体的身份。

测试序列和模板序列的失真度定义为测试序列和模板序列在一个周期内所有帧数的参数向量的自动时间规整距离,步态序列之间失真度越小,说明步态越相似。表3 选取了90°视角下,4 个目标的运用DTW 算法得出的匹配度。从表中不难看出,除了待测序列中2 号个体在背包情况下的识别结果有误,其他个体在普通状态、背包状态和大衣状态均能正确分类,其匹配度明显小于其他类别的匹配度。2 号个体在背包状态下的测试序列与2 号个体模板序列的匹配度为199.03,略高于和4 号模板序列的匹配度195.97,这可能是由于预处理或特征提取阶段的不确定因素引起的噪声导致的偏差。

表3 4 个目标个体在不同行走状态下的失真度

5.2 实验结果分析

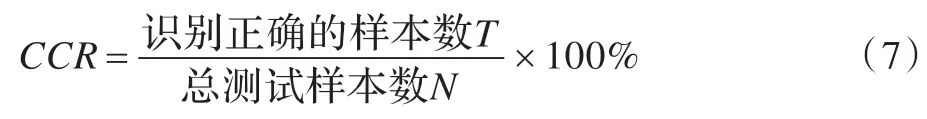

为了评价分类结果,引入正确分类率CCR(Correct Classification Rate)作为评价指标。运用自动时间规整(DTW)算法将不同角度和行走状态下的测试序列和124 个模板序列进行匹配,得出与测试序列距离最小的模板序列的类别,识别为此次测试序列的类别。公式(7)可以定义正确分类率CCR,表4 为使用本实验选取的步态特征进行DTW 识别后的正确分类率。

由表4 可知,视角和行走状态的不同组合得到算法的识别率在85.23%~98.72%之间,算法综合识别率为91.57%,说明对目标提取的步态特征是有效的。在正常的行走状态下,算法的识别率最高;在0°视角穿大衣行走的状态和90°视角背包行走的状态识别率略低。

表4 不同视角和行走状态下的步态识别率CCR %

5.3 算法性能和时间对比

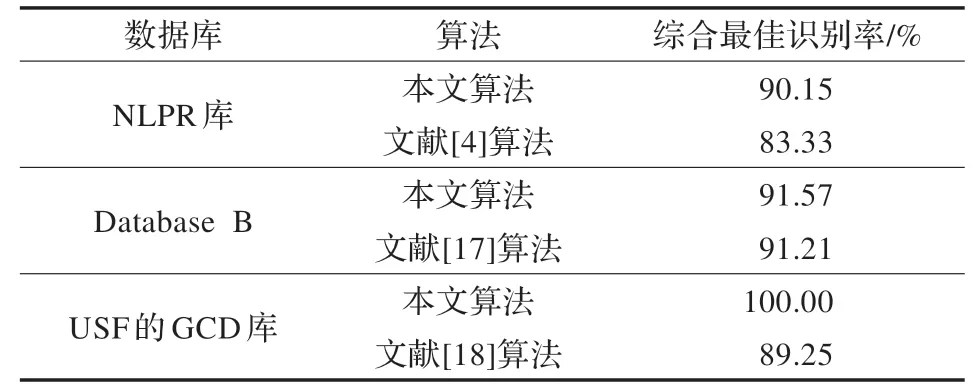

有很多研究步态特征提取和识别的算法,本文选取3 种算法进行准确性比较:只提取人体轮廓为特征[4];只采用人体质心[17];以人体区域所有像素点为特征,采用自动时间规整算法对特征进行识别[18]。由于这些算法通常是在各自的数据库上评估性能,不同数据库获得的算法识别率可比性不大,所以在不同算法的数据库中相应实现了本文的算法,评价指标取该算法同等状态和视角下的综合最佳识别率,如表5 所示。

表5 算法性能比较

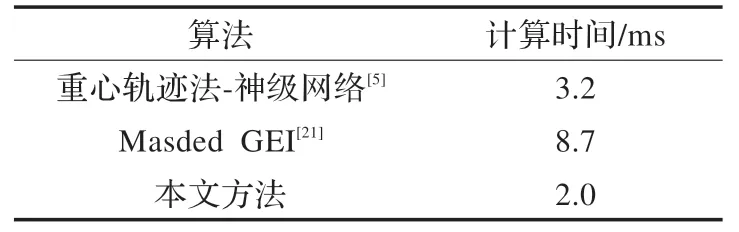

本文对单帧图像定位质心和轮廓关键点,将单帧图像的步态模式简化成了一个四维的向量,相比于其他的步态特征诸如光流[19]、自相关图[20]等更加易于实现,自然也减少了计算代价。表6 给出了一些步态识别算法的时间代价。

表6 计算时间比较

6 结论及展望

本文提出了一种简单的步态识别方法,利用质心高度和质心到人体轮廓关键点的距离4 个参数来有效地表示单帧图像步行姿势,特征向量的波动表示步行姿势的变化。这种方法对噪声不敏感,即使图像内部有噪声或者中空,只要图像足部和头部边缘的关键点获取准确,依然具有较高的识别率。今后将进一步改进算法,提高某些固定视角和行走状态的识别率,同时增加新的视角和行走状态来验证新算法,并根据算法思想着手搭建能够投入实际应用的步态识别系统。

[1] Cunado D,Nixon M S,Carter J N.Using gait as a biometric,via phase-weighted magnitude spectra[C]//Proceedings of Audio-and Video-based Biometric Person Authentication,1997.

[2] Yoo J H,Nixon M S,Harris C J.Extracting gait signatures based on anatomical knowledge[C]//Proceedings of BMVA Symposium on Advancing Biometric Technologies,2002.

[3] Han J,Bhanu B.Individual recognition using gait energy image[J].Pattern Analysis and Machine Intelligence,2006,28(2):316-322.

[4] 王亮,胡卫明,谭铁牛.基于步态的身份识别[J].计算机学报,2003,26(3):353-360.

[5] 陈欣,杨天奇.不受服饰携带物影响的步态识别方法[J/OL].计算机工程与应用(2014-08-15)[2014-12-31].http://www.cnki.net/kcms/doi/10.3778/j.issn.1002-8331.1403-0167.html.

[6] Collins R T.A system for video surveillance and monitoring[D].Pittsburg:Carnegie Mellon University,2000.

[7] Stevenage S V,Nixon M S,Vince K.Visual analysis of gait as a cue to identity[J].Applied Cognitive Psychology,1999,13(6):513-526.

[8] Cutler R,Davis L S.Robust real-time periodic motion detection,analysis,and applications[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2000,22(8):781-796.

[9] Sarkar S.The humanid gait challenge problem:Data sets,performance,and analysis[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2005,27(2):162-177.

[10] 曾莹.基于角度及轮廓特征的步态识别方法研究[D].长沙:中南大学,2008.

[11] Jain A K,Bolle R,Pankanti S,et al.Biometrics:Personal identification in networked society[M].Berlin Heidelberg:Springer,1999.

[12] Pogorelc B,Bosnić Z,Gams M.Automatic recognition of gait-related health problems in the elderly using machine learning[J].Multimedia Tools and Applications,2012,58(2):333-354.

[13] 丁浩,蒋俊平,李振建.行走过程中人体重心轨迹数学模型的建立[J].江苏警官学院学报,2009(6):167-170.

[14] Amin T,Hatzinakos D.Determinants in human gait recognition[C]//Proceedings of the 25th IEEE Canadian Conference on Electrical & Computer Engineering(CCECE),2012.

[15] Müller M.Dynamic time warping[J].Information Retrieval for Music and Motion,2007(1):69-84.

[16] Berndt D J,Clifford J.Using dynamic time warping to find patterns in time series[C]//Proceedings of the KDD Workshop,1994,10:359-370.

[17] 余涛,邹建华.基于Bayes 规则与HMM 相结合的步态识别方法研究[J].计算机学报,2012,35(2):386-396.

[18] Boulgouris N V,Plataniotis K N,Hatzinakos D.Gait recognition using dynamic time warping[C]//Proceedings of the IEEE 6th Workshop on Multimedia Signal Processing,2004:263-266.

[19] Hayfron-Acquah J B,Nixon M S,Carter J N.Automatic gait recognition by symmetry analysis[J].Pattern Recognition Letters,2003,24(13):2175-2183.

[20] BenAbdelkader C,Cutler R,Nanda H,et al.Eigengait:Motion-based recognition of people using image selfsimilarity[M]//Audio-and Video-Based Biometric Person Authentication.Berlin Heidelberg:Springer,2001:284-294.

[21] Dupuis Y,Savatier X,Vasseur P.Feature subset selection applied to model-free gait recognition[J].Image and Vision Computing,2013,31(8):580-591.