基于摄像机跟踪和深度信息的三维合成

王高飞,余 刚,谢世斌

(成都索贝数码科技股份有限公司 基础技术研究院,四川 成都 610041)

基于摄像机跟踪和深度信息的三维合成

王高飞,余 刚,谢世斌

(成都索贝数码科技股份有限公司 基础技术研究院,四川 成都 610041)

阐述一种新的基于摄像机跟踪和深度信息的三维合成技术。此技术将2D视频源转为3D视频,然后提取3D视频源的深度信息,再将摄像机跟踪和视频深度信息有机结合起来,使得3D视频和3D物件在三维场景中有机融合,进而获得更加真实自然的三维合成效果。

三维合成;2D转3D;深度信息提取;摄像机跟踪

【本文献信息】王高飞,余刚,谢世斌.基于摄像机跟踪和深度信息的三维合成[J].电视技术,2015,39(2).

1 三维合成原理

三维合成是将3D视频和3D物件在同一个三维场景中进行叠加和渲染,让两者有机融合在一起,形成一个真实自然的三维场景。三维合成一般是将3D物件融合进3D视频场景中,为了达到真实的效果,需要提取出3D视频和3D物件的深度信息,通过深度信息得到两者之间的遮挡关系,然后进行叠加。基本叠加示意图如图1所示。

图1 三维合成示意图

图1中,长方体遮挡住了小汽车,但又被松树遮挡,这种遮挡关系,是根据小汽车、长方体和松树之间的深度关系产生的,这样,就营造出了符合逻辑的三维场景。对于视频画面,一般都是含有运动物体,比如行走的人和行驶的车辆,如果要在这种运动场景中融合进3D物件,仅有3D视频和3D物件的深度信息,虽然可以产生叠加效果,但3D视频中物体会产生自旋转,而深度信息是不包含这种自旋转信息的。这样叠加出来的三维场景就会让人感觉3D物件和3D视频场景互相脱离,不是在一个统一的三维空间中,给人一种虚假的表象。类似的,3D视频中一辆小汽车慢慢驶离镜头,逐渐远去,如果和小汽车配合的3D物件没有逐渐变小,变模糊,也会给人一种两者相互脱离的感觉,瞬间让三维合成效果大打折扣。

为了避免这种3D物件和3D视频场景相互脱节的情况出现,本文提出一种基于摄像机跟踪和深度信息的新的三维合成技术。三维合成的流程示意图如图2所示。

图2 三维合成流程图

图2描述了本文阐述的三维合成技术的整个流程。整个流程的文字描述如下:

1)源视频为2D视频,则通过2D转3D技术,转换为3D视频,同时获取深度信息;源视频为3D视频,则提取深度信息。

2)对3D视频进行摄像机跟踪,获得每一帧的摄像机参数。

3)根据深度信息和每帧的摄像机参数,将3D物件融合进3D视频,从而得到三维合成场景。

下面对涉及到的重要技术点2D转3D、3D视频深度信息提取和摄像机跟踪进行简单描述。

2 2D转3D

目前,不管是广电行业,还是一般民用消费市场,视频的片源主要是2D视频。因此,在三维合成系统中,有相当一部分视频源为2D视频,这就需要将2D视频转换为3D视频。2D转3D的基本流程图如图3所示。

图3 2D转3D流程图

2D转3D流程的重点是深度信息的生成,目前有很多比较成熟的算法,主流算法都以图像分割为基础或作为一个支撑点。获得深度信息之后,为避免“卡片堆积”效应,需要对获得的深度信息进行平滑处理,一般采用高斯模糊即可。最后生成3D画面时,如果质量要求不高或者对效率要求较高,可以只生成左眼画面,直接使用源单眼画面作为右眼画面,使用源单眼画面作为右眼画面的原因是约70%人的视觉以右眼为主。

2D转3D的主流算法分为两种:基于离焦原理分割前景和背景区域算法[1]和基于运动估计的图像深度区域分割算法[2]。离焦算法根据离焦原理,即处于人眼或摄像机焦点处的画面锐利,含有较多的高频信息,离焦点越远的区域,越模糊,含有较多的低频信息。通过Higher-Order Statistics,即高阶统计量方法,加上区域生成等方法,将2D画面分割为前景和背景区域。运动估计算法的主要原理为运动差越大的区域,离人眼或者摄像机越近。由于此方法能够计算出物体之间的遮挡关系,因此提取出的深度更符合逻辑。这两种算法各有优劣,前者可以将单张2D图片转换为3D图片,对于多焦点画面或者整幅比较模糊的运动画面,效果比较差;后者提取出的深度信息更加符合逻辑,更加准确,但却无法提取单张图片的深度信息。

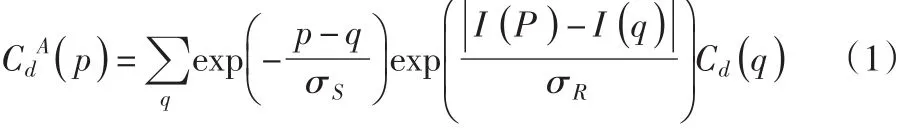

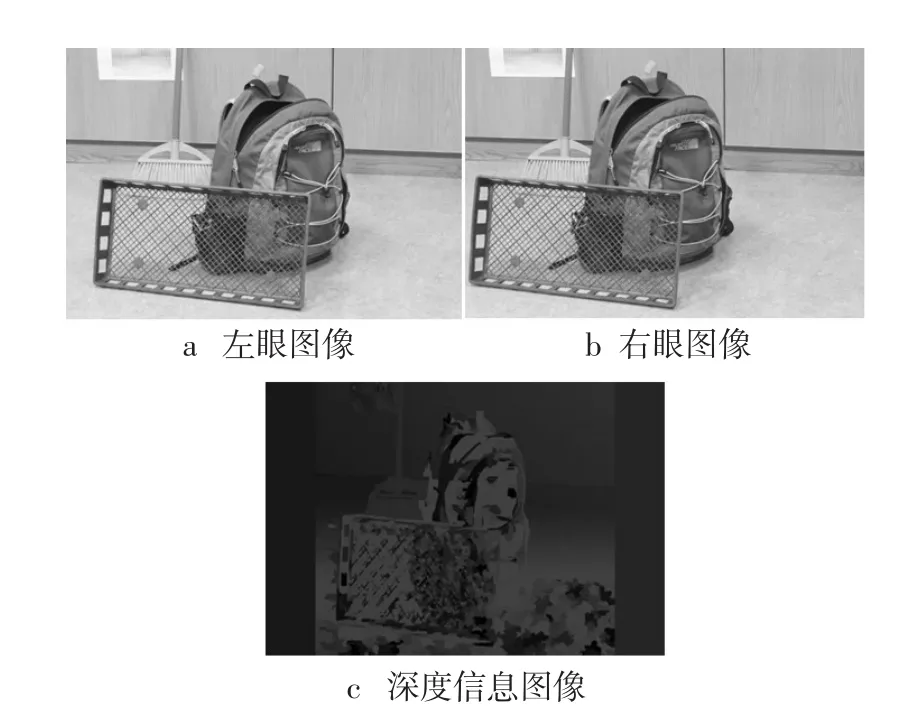

本文描述的技术采用离焦原理进行2D转3D,样例图如图4所示。

图4中,图像4a为虚拟产生的左眼图像,图像4b为原2D图像(作为右眼图像),图像4c为从原2D图像提取出来的深度信息图像。

3 深度信息提取

目前,市场上大部分3D摄像机拍摄的3D视频都不含深度信息,而在三维合成中,需要3D视频和3D物件的深度信息,才可以判断出两者之间的遮挡关系。这样,三维合成中就需要一个提取3D视频深度信息的环节。

图4 2D转3D样例图

深度信息提取算法可以分为局部和全局两大类。局部算法按照窗口对图像进行划分,以窗口为单位进行计算,这样计算量小,但计算出来的深度信息会有较强的边界效应。全局算法可以有效避免深度信息的边界效应,但计算量大。杨庆雄[3]提出的非局部花费积累算法来提取深度信息,此算法使用树形结构来计算像素间的相似性。在像素构成的最小生成树上进行花费积累计算(双边滤波器即可达到较好效果),可以一方面避免局部算法产生的边界效应,另一方面避免全局算法产生的巨大计算量。通过左右眼视差计算出深度信息后,可以使用树形滤波[4]进行深度信息的平滑和缩放处理,以达到对深度信息提取流程和质量优化的目的。

基于双边滤波花费积累公式为

式中:Cd(q)表示在视差等级为d时像素q的匹配花费;I表示引导图像;σS和σR分别表示空间相似度常量和范围相似度常量。

如果在MST上应用此花费积累公式,则可以转换为

式中:D(p,q)表示像素p和像素q在MST上的距离;σ表示σS和σR的一个线性组合。这样,可以在MST上计算花费积累,减少了计算量,同时可以避免边界效应。

对3D视频进行深度信息提取的样例图如图5所示。

4 摄像机跟踪

摄像机跟踪技术主要用来获取视频拍摄时摄像机的角度,从而计算出视频中物体的运动轨迹,以及旋转角度。摄像机跟踪技术是3D物件和视频融合的基本技术,摄像机跟踪得到的视频摄像机帧参数的好坏直接决定了两者融合产生的效果,要么浑然一体,要么漏洞百出。

图5 深度信息提取样例图

摄像机跟踪算法按照流程可以划分为两个阶段——摄像机标定和摄像机跟踪。摄像机标定的主要目的是得到视频拍摄的摄像机的内部参数以及畸变参数,这样才能在后期的摄像机跟踪中更精确地计算出摄像机帧参数。目前无标记的摄像机标定技术都是基于张正友[5]的平面标定法,此算法对于视频画面要求低,具有较高的鲁棒性。

摄像机跟踪算法较多,可以按照是否需要模型库进行划分。董子龙[6]等提出实时摄像机跟踪算法需要一个离线的特征模型库,在跟踪时只提取视频关键帧参数进行匹配,以达到实时跟踪的目的。

Georg Klein博士在2006年的博士论文中阐述了一种非标记且不需要特征数据库的视频跟踪方法用于增强现实。在2007年,他将这种方法加以发展,提出了并行跟踪和映射方法[7]用于增强现实。此方法使用光束平差法计算出画面中点的3D空间坐标,为了精确匹配特征点,可以使用SIFT或SURF算子得到物体的精确匹配,最后使用基于扩展卡曼滤波的SLAM算法来估算3D空间中点的运动来达到精确跟踪的效果。

摄像机跟踪的样例图如图6所示。

图6 摄像机跟踪样例图

从图6可以看出,随着手的移动,甚至是手指的相对移动,虚拟3D物件依然可以准确地找到跟踪物体,并会随着视频中的物体做相应的旋转和平移运动。

5 三维合成

通过深度信息提取可以得到3D视频中不同物体的深度,3D物件在渲染的时候已经包含了深度信息,这样通过深度信息可以将3D物件符合逻辑地融合进3D视频场景。摄像机跟踪可以比较精确地计算出3D视频场景中一个物体的运动和旋转信息。这样在3D物件渲染时,调整3D物件的摄像机参数,使之配合3D视频场景中一个物体的运动和旋转,就能够更加真实地将3D物件融合进行3D视频,得到一个真实感强、符合视觉逻辑的三维合成场景。

3D物件和视频的三维合成样例图如图7所示。

图7 三维合成样例图

[1] KO J,KIM M,KIM C.2D-To-3D stereoscopic conversion: depth-map estimation in a 2D single-view image[EB/OL].[2014-10-18].http://cat.inist.fr/?aModele=afficheN&cpsidt=205876 88.

[2] FENG Yue,REN Jinchang,JIANG Jianmin.Object-based 2D-to-3D video conversion for effective stereoscopic content gen⁃eration in 3D-TV applications[J].IEEE Trans.Broadcasting,2011,57(2):500-509.

[3] YANG Qingxiong.A non-local cost aggregation method for stereo matching[EB/OL].[2014-10-18].http://www.computer.org/csdl/pro⁃ceedings/cvpr/2012/1226/00/177P2A27-abs.htm l.

[4] YANG Qingxiong.Stereo matching using tree filtering[EB/OL].[2014-10-18].http://www.computer.org/csdl/trans/tp/preprint/06888 475-abs.htm l.

[5] ZHANG Z.A flexible new technique for camera calibration[J].IEEE Trans.Pattern Analysis and Machine Intelligence,2000,22(11):1330-1334.

[6]DONG Zilong,ZHANG Guofeng,JIA Jiaya,et al.Keyframe-based real-time camera tracking[EB/OL].[2014-10-18].http://www.docin.com/p-588205058.htm l.

[7] KLEIN G,MURRAY D.Parallel tracking and mapping for small AR workspaces[EB/OL].[2014-10-18].http://dl.acm.org/citation.cfm?id=1514363.

责任编辑:任健男

TN948

B

10.16280/j.videoe.2015.02.012

2014-11-18