弱监督任意姿态人体检测*

蔡雅薇,谭晓阳

南京航空航天大学 计算机科学与技术学院,南京 210016

弱监督任意姿态人体检测*

蔡雅薇+,谭晓阳

南京航空航天大学 计算机科学与技术学院,南京 210016

弱监督;人体检测;任意姿态;多示例学习

1 引言

多姿态人体检测在日常生活中有很多重要的应用[1]。例如在人类行为估计中[2],人们首先需要检测人体的位置,为头、手、脚等其他部分提供参考定位。对于智能机器人,它的活动必须避免碰撞人类,但房间里的人不会总是直立的,他们可以是趴着、坐着、躺着,或者是其他姿态。图1说明了一些不同姿态的人体,其中的图片来自LSP数据集[3]。因此检测任意姿态的人体变得十分必要[4]。

Fig.1 Illustration of human body under different poses图1 不同姿态的人体说明

但是这个课题并未受到足够的关注。与之相关的课题中,被研究最多的是行人检测问题[5],它有着广泛的应用,尤其在城市智能交通系统。目前其性能已经达到了很高的水平[6],这为多姿态人体检测在很多方面(例如特征提取、模型选择、评估方法)提供了宝贵的经验。但是行人检测本身主要关注直立姿态的人体。

任意姿态的人体检测面临着多个挑战,除了大量的外形变化,多种姿态使人工标注工作变得困难和费力,因此通常只能得到弱标记的样本。多示例学习(multiple instance learning,MIL)是克服这些挑战的一个很好的工具,因为它放松了对精确标记的要求。在多示例学习中,人们甚至不需要注释真实数据(ground truth),只需要标注图片中是否存在感兴趣的对象即可。最近,Cinbis等人[7]将多示例学习用于一般的对象检测并在Pascal VOC 2007数据集上得到了较好的结果,体现了这个方法的潜力。但是他们没有重点关注多姿态人体检测问题以及一些多示例学习的实现细节,例如样本选择、参数设置等。

本文主要提出了一种新的选择性弱监督检测算法(selective weakly supervised detection,SWSD),并给出了这个课题的深度评估,关注了以下重要但很少被研究的问题:首先,通过比较监督学习和多示例学习的性能,探究了在弱监督环境下多示例学习的能力;第二,研究了对于多示例模型训练,什么样的训练样本最有帮助,证明了SWSD算法的合理性;第三,测试了不同示例概率融合策略的效果;最后,验证了SWSD算法的优越性。

本文在被认可的Pascal VOC 2007[8]的person数据集上进行了发广泛的评估,并且得到了几个有趣的实验结论,希望能为后面的研究者提供帮助。

本文组织结构如下:第2章介绍弱监督检测的相关工作;第3章给出多示例学习算法以及SWSD算法;第4章阐述评估路线;第5章呈现综合性弱监督多姿态人体检测的实验评估;第6章总结了主要的实验结论。

2 相关工作

2014年,Girshick等人为对象检测提出了R-CNN(regions with CNN features)框架[9],他们采用Selective Search算法生成检测提议。之后,很多人在此基础上进一步提高了检测准确度。目前Pascal VOC 2007上最好的人类检测平均精确度(average precision,AP)已经达到70.1%[10],相信很快就会有新的突破。但是这些监督学习都建立在大量的精确注释和时间代价的基础上,因为在卷积神经网络(convolutional neural network,CNN)中存在太多的模型参数需要训练调整。

人们希望以最少的监督信息定位对象,因此弱监督对象检测在提出之后得到了不断的发展。2011年,Pandey和Lazebnik[11]结合了DPM(deformable parts model)和隐SVM(support vector machine)模型,证明了DPM也可以胜任弱监督对象的定位任务。Siva和Xiang[12]提出了弱监督学习框架,使用一种新的初始化注释模型来启动检测器的迭代学习。2012年,Russakovsky等人[13]根据已知对象位置能对图像分类有帮助的直觉,提出了对象中心空间池方法。

2014年,Song等人[14]结合有识别力的子模块和平滑隐SVM模型,可以自动观察正对象窗口。同年,他们也提出了自动识别具有区别力的视觉模式的方法[15]。Bilen等人[16]提出了基于从CNN提取的特征和隐SVM模型的方法,可以找出图片中的多对象示例。Wang等人[17]提出了潜在类别学习,首先使用典型的概率潜在语义分析学习潜在类别,然后决策哪个类别包含目标对象,并且还提出了用于评估每个类别区别力的类别选择方法。

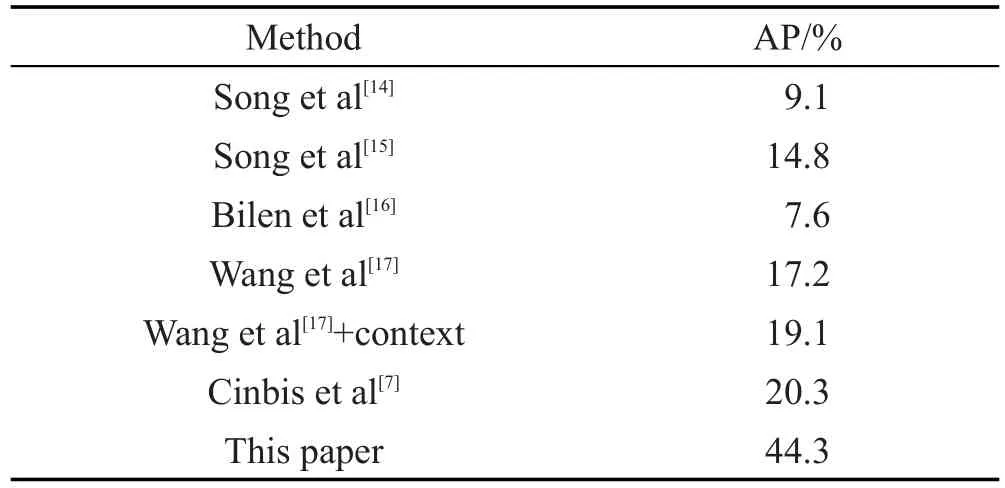

2015年,Cinbis等人[7]对正训练图片进行迭代训练并指出对象位置。他们的主要贡献在于多重多示例学习过程,避免了提前锁定到错误的对象位置。他们也通过从CNN中提取特征提高了多示例检测的性能。目前弱监督人体检测最好的AP为20.3%,显然还有很大的提升空间。

3 多示例检测

以下简单描述如何将多示例学习用于对象检测,介绍两种多示例学习算法,并重点关注选择性弱监督检测算法。

3.1 多示例学习

在多示例学习中[18],数据集由N个包组成,用表示。其中代表第i个包,它是多示例训练中的单元,如同监督学习中的一个样本,M为包中的示例数量,xij为包中的一个示例;ti为包的标记,但示例没有标记。包的标记主要取决于包中是否包含正示例。那意味着,只有包中没有任何正示例,这个包即被称为负包(ti=0),否则这就是一个正包(ti=1)。在这个定义下,不能确定正包中哪个示例为正示例,这一点加大了多示例算法的挑战。为了实现好的性能,模型必须能够足够鲁棒地对抗正包中的噪声数据。

在对象检测环境下,一个候选窗口被视为一个示例,多个候选窗口组成一个包。这样就可以训练多示例对象检测模型,但在测试的时候,每个候选窗口(示例)必须被指定一个标记,这似乎直接违背了多示例学习的定义,因为示例没有明确的标记。可以通过示例层次的模型预测来避免这个问题,或者将单一的测试示例视为只有一个示例的包,然后使用包层次的模型预测。

正式地,用 pij表示示例xij为正的概率。为了估计包层次的条件概率pi,可以使用不同的策略融合示例层次的概率。两个最常见的方法为最大汇合(Max Pooling)和噪声或模型(Noisy-or)。

Max Pooling策略的目标是找出包中最可能为正的示例,并不关心包中其他示例的标记。相对地,Noisy-or模型考虑了所有示例,但假设它们之间相互独立。

不同的多示例学习算法的差异体现在很多方面,例如示例模型(pij)、损失函数、优化方法等。文献[18]给出了最近的综述。本文实验中主要感兴趣于两种多示例学习算法,多示例逻辑回归(MIL_LR)[19]和多示例AdaBoost算法(MIL_AdaBoost)[20]。下面将简单介绍这两种算法。

3.2 多示例逻辑回归

多示例逻辑回归是一种线性分类器,在这个意义上,对于每个示例xij,它的输出标记yij可以被线性模型化为yij=wTxij+b,w和b为待学习的参数。使用sigmoid函数模型化示例为正的概率为。本文使用负的似然函数作为损失函数来训练模型:

通过梯度下降法优化参数:

MIL_LR和一般的LR算法的区别在于,在学习参数时,MIL_LR还需要考虑每个包的似然对包中示例的影响,即,而一般的LR算法则不需要。有趣的是,这个比例与示例融合策略有关。特别是在Max Pooling下,它仅仅依赖于获胜的示例xij*,而且,其中。如果线性模型合理,这个性质使得Max Pooling对不准确的注释非常鲁棒。但在Noisy-or模型下,每个示例对计算这个比例都起作用,有时这意味着包中的一些困难示例可能有机会潜在地误导学习。

3.3 多示例AdaBoost

在AdaBoost算法的多示例版本中[20],示例层次的预测模型C(xij)由多个弱分类器的输出线性组合构成,即C(xij)=∑λtct(xij)。换言之,不同于MIL_LR模型,输出标记yij对于相应的xij是非线性的。多示例AdaBoost的目标是在多示例框架下学习一组弱分类器ct(xij),以及组合系数λt。

特别地,为了学习下一个弱分类器ct,首先要固定目前已经学到的分类器,然后用它对每个xij估计yij。然后用sigmoid函数将yij过渡到pij,接着用Max Pooling或者Noisy-or模型融合到 pi。最后,MIL_ AdaBoost的学习问题归结为最大化下面的似然函数:

这个问题可以在ct所属函数空间上,通过梯度上升搜索来解决。之后,执行简单的线性搜索就能估计λt的值。

3.4 选择性弱监督检测

在多示例学习框架的基础上,希望进一步提高弱监督检测的性能。本文提出一种新的选择性弱监督检测算法SWSD。它利用了少量监督样本的优势,虽然无法获取大量的监督样本,但是可以手工标注少量的ground truth。这些ground truth所需的代价很小,但可以发挥重大作用。之所以设计这个算法是因为与ground truth重合越大的示例对多示例训练越有帮助,需要通过算法找出这些高质量的示例。本文将通过实验证明该观点。SWSD算法使用很少的ground truth来迭代选择高质量示例,模型训练过程如下。

算法1选择性弱监督检测算法SWSD

(1)初始化训练集S:包括由M个ground truth和M个正包中的负示例组成的监督样本,以及N个空的训练正包。

(2)For iterationt=1toT

①通过监督学习和多示例学习,用S训练一个检测器;

②用这个检测器测试所有正训练图片中剩下的检测提议;

③在每张图片中选择n个得分最高的提议作为示例加入到相应的训练正包中,更新S。

(3)输出最终的检测器。

另外,对于迭代次数T,可以采用交叉验证的方法来寻找最优解。图2给出了SWSD算法的简要过程。其中虚线框内的部分是本文方法的创新之处。在多示例学习框架中,从未关注过训练正包中的示例组成,而SWSD算法通过选择提议来提高正包中正示例的比例,从而提升算法的准确度。

Fig.2 Procedure of SWSD图2SWSD算法过程

4 评估路线

下面将介绍弱监督人体检测的评估路线,主要包括4部分,即检测提议的生成、特征表示、多示例学习和检测、后期处理过程。图3给出了评估过程及方法。

Fig.3 Procedure and methods of evaluation图3评估过程及方法

4.1 检测提议生成

虽然滑动窗口[21-23]是最常用的检测提议(候选窗口)生成方法之一,但在本文的工作中,采用选择性搜索(Selective Search)算法[24-26],它能产生很多的稀疏提议,并且不会损失图片中的主要信息。Selective Search算法的主要思想基于感兴趣的对象具有相似的视觉特征的假设,而且能够通过这些特征将它们从背景中分离,这大大减少了对象提议的数量。在文献中还提到了很多其他的方法,例如MCG(multiscale combinatorial grouping)[27]、Objectness[28]、随机种子[29],它们都可以用于这个目的。

4.2 特征表示

如何获取最具区别力的特征一直是模式识别领域的重要问题之一。已经有很多不错的特征表示方法供人们选择,例如HOG(histogram of oriented gradient)特征[30]、SIFT特征(scale-invariant feature transform)[31]、HSV(hue,saturation,value)特征[32]等。深度卷积神经网络[33]由于在实际中的卓越性能,成为一种受欢迎的特征表示方法。

在本文的工作中,选择VGG网络[34],这是一个38层的深度网络,最初是在ImageNet[35]数据集上训练得到。本文使用第37层的输出作为最终的特征表示,也就意味着,每个提议都会映射成一个1 000维的向量,作为多示例学习模块的输入。注意到本文并没有在原有VGG网络的基础上进一步微调,因为从Image-Net数据集上学到的特征空间足够描述人体图片。

4.3 多示例学习和检测

如何合适地定义正包是多示例学习中一个棘手的问题。在弱监督环境下,人们无法获得图片中每个对象的ground truth边界框,只能将一张正例图片的所有提议组成一个正包。在其他情况下,当已知ground truth,就可以缩小正包的尺寸,因为只需要考虑和ground truth的IOU(intersection over union)大于0.5的示例,通常将它们视为正示例,否则即为负示例。图4给出了ground truth边界框、正示例和负示例的说明。

Fig.4 Illustration of ground truth bounding box,positive instances and negative instances图4 ground truth边界框、正示例和负示例的说明

由于MIL_LR和MIL_AdaBoost算法在本质上具有不同的复杂性,集成它们是有利的。对于示例xij,用和分别表示它在两种算法下的得分输出,那么xij的最终得分定义为:

4.4 后期处理

人们提出了很多方法用于提高最终预测窗口的准确率,例如边界调整法[7]和边界框回归法[9]。本文使用一种基于聚类思想的简单但有效的方法。特别地,在每个测试包中,只考虑得分的示例作为候选输出。在这些候选中,选择得分最高的作为一个聚类中心,如果其他示例和这个中心有超过30%的重叠,就认为这个示例属于这个类,否则将它作为一个新的聚类中心。对所有剩下的示例进行此操作,直到所有的候选都被分配到某个类别中。最后,取每个类别的平均值统计量给出位置和边界框的预测。

5 实验

有很多因素影响着SWSD算法,尤其是对其中的多示例学习部分。以下讨论正示例比例、融合策略和示例质量的影响,同时说明SWSD算法的合理性及优越性。

5.1 实验数据及设置

这一部分将描述实验设置,包括训练数据和测试数据的构成以及评估协议。对于多示例训练,构造了一个由4 916张图片组成的训练集,其中2 000张是从LSP数据集[3]上选取的正例,每张图片中包含一个人体。另外2 916张是从Pascal VOC 2007[8]的人类训练集上选取的负例,不包含任何人体对象。对于测试,直接使用Pascal VOC 2007的人类测试集,包括4 952张图片,其中2 007个正例共包含了4 528个人体对象。

图1和图5分别展示了LSP数据集和Pascal VOC 2007中的人体图片。可以发现Pascal VOC 2007中的一些图片非常具有挑战性,有的太小,有的被部分遮挡,见图5最下面一行。但是这些特征可帮助测试检测器的鲁棒性。另一方面,LSP数据集上的目标更加明显,包含了更多的有效信息,将有利于多示例模型的训练。

本文使用平均准确率AP评估人体检测的性能。AP基于精确度,即正确检测与所有预测之比,也是以回归率为横轴,精确度为纵轴的曲线下的面积。

5.2 基准线

本文使用了两个不同的基准线,一个是相同图片样本下监督学习的性能,另一个是只使用100个正例样本的DPM的性能。由于想要证明多示例学习在某些情况下优于监督学习(supervised learning,SL),还想提高只有少量监督样本情况下的检测性能,因此需要两个基准线。

对于监督学习,使用在LSP数据集上标注的2 000个ground truth和2 916张Pascal VOC 2007上的负例图片作为训练样本。分别测试了SL_Ada-Boost、SL_LR和SL_LR+SL_AdaBoost的性能。对于DPM,直接使用Pascal VOC 2007的person训练集,其中包括2 095个正例和2 916个负例。在实验中,从2 000到100逐渐减少正例的数量,相应地,负例数量与正例数量相等。这两个实验均为监督学习实验。

Fig.5 Illustration of human body images in Pascal VOC 2007图5 Pascal VOC 2007中人体图片说明

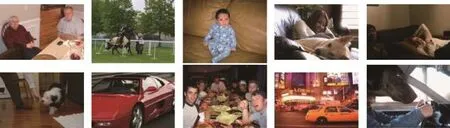

表1列出了3种监督方法的AP,可以看出SL_ AdaBoost+SL_LR算法的性能最好。本文的监督学习性能低于R-CNN框架是必然的,因为只使用了2 000个正例样本,并且也没有采用复杂的检测算法。它仅仅用于对比多示例学习。图6说明,当正例数量为2 000时,AP为35.96%,但降为100时,AP只有24.62%。根据这条曲线,发现DPM的性能随着正例样本数量的减少而降低,因此当监督信息很少时,DPM难以发挥作用。

Table 1 AP of supervised learning表1 监督学习的AP

Fig.6 AP of DPM with different numbers of positive samples图6 在不同正例样本数量下DPM的AP

5.3 正示例比例的影响

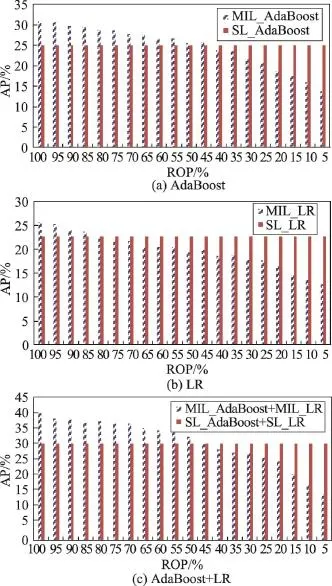

为了得到更好的性能,应该选择合适的样本用于训练。包中正示例比例(ratio of positive,ROP)对检测性能的影响将指导人们如何构造训练集。

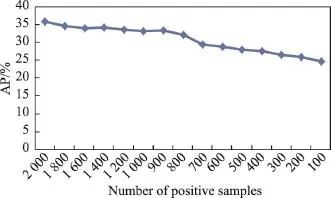

在这组实验中,变量为ROP,在第1次实验中,向每个训练正包中只添加正示例,在第2至20次实验中,逐渐加入负示例。因此,ROP将从100%不断下降至5%。所有的训练正包中均不包含ground truth。本文使用Max Pooling估算包概率。

图7展示了MIL_AdaBoost、MIL_LR和MIL_ AdaBoost+MIL_LR算法的结果。可以发现三者的AP都随着ROP的下降而减少。其中,性能最好的MIL_AdaBoost+MIL_LR的AP从39.98%降低至14.56%。这证明了ROP是影响多示例性能的关键因素,从而SWSD算法中的迭代选择过程是合理的。

Fig.7 AP of 3 algorithms with reduction of ROP图7 随着ROP的减小3种算法的AP

Fig.8 Comparison between MIL and SL图8MIL与SL的比较

根据图8可以看出,MIL_AdaBoost算法的AP在 ROP大于45%时优于SL_AdaBoost,MIL_LR算法的AP在ROP大于85%时才优于SL_LR算法,MIL_Ada-Boost+MIL_LR的性能也只在ROP大于45%时优于监督学习。因此只有ROP是个较大值时,多示例学习才会比监督学习更好。

可以观察到不论在监督学习,还是在多示例学习中,AdaBoost和LR的集成方法性能都是最好的,因此在下面的实验中,只采用此方法。

5.4 融合策略的比较

上面的实验中,选择的估算包概率的融合策略为Max Pooling(MIL-max),如式(1)所示,它只关注包中最可能为正的示例,忽略了其他示例。式(2)中的Noisy-or模型(MIL-nor)则综合了所有示例的情况,但是当包中示例数量较大时,假设为1 000,即使包中每个示例为正的概率为0.1,包为负的概率为(1-0.1)1000≈1.7×10-46。因此本文考虑只使用3个最可能为正的示例用于计算。此外,也尝试使用更多的示例,但是实验效果更差。

这组实验和上一组的实验形成对比,因此训练正包中也不包含ground truth。每次实验中包中的示例也是相同的,唯一不同的是,模型训练时,所选的融合策略为Noisy-or模型。

Noisy-or模型和Max Pooling的AP比较如图9所示。Noisy-or模型的性能远远低于Max Pooling的性能。MIL-max最高AP为39.98%,而MIL-nor最高只有23.95%。而且,MIL-nor的曲线一直在监督学习(SL)基准线的下方,这说明使用Noisy-or模型的多示例学习不如监督学习。

Fig.9 Comparison among MIL-max,MIL-nor and SL图9 MIL-max、MIL-nor与SL之间的比较

5.5 提议质量

在上面的两组实验中,每个训练正包中都不包含ground truth。本文定位正示例为与ground truth的 IOU大于0.5的示例,但是采用刚刚大于0.5的提议作为示例来训练显然是不够的,需要高质量的示例来训练更好的模型。本文通过实验评估提议的质量。

在这组实验中,所有设置均与上一个实验相同,每次实验包中示例也相同,除了在每个训练正包中额外加入了ground truth。依旧分别使用Max Pooling和Noisy-or模型估算包为正的概率。

图10展示了训练正包中是否包含ground truth对检测性能的影响。发现包含与不包含的情况之间只有极小的差距。前者最好的AP为40.02%,而后者最好也达到39.98%。所有20次实验中,两者之间的差距都在1%左右,这说明在LSP数据集上Selective Search可以提供类似ground truth的提议,并且它们可以在多示例训练中起到ground truth的作用。还观察到,即使添加了额外的ground truth,MIL-nor的性能依然很差。因此认为Noisy-or模型并不适用于多示例检测。在本文下面的实验中,只采用Max Pooling策略。

Fig.10 Comparison between whether containing ground truth图10 是否包含ground truth之间的比较

5.6SWSD算法性能

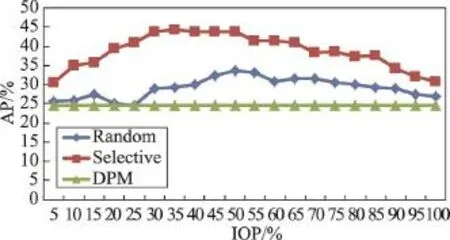

通过上面的实验已经知道,正示例比例越大检测性能就会越好。但如果将所有的提议都作为示例,正示例的比例只有大约30%,因此需要采用SWSD算法选择好的提议,提高包中正示例比例。

有两种方法用于构造训练正包:一种是随机法(random),即初始化训练正包为空,然后每次实验随机向包中添加示例,直到所有提议都作为示例加入包中。那么每个包中示例数量与提议总数之比IOP(instances over proposals)就从5%增加至100%。另一种就是SWSD算法中所采用的选择法(selective),本文使用100个ground truth和100个正包中的负示例来训练原始检测器,然后每次选择5%的提议加入到相应的正训练包中,执行此迭代操作20次。

图11说明了选择法的性能优于随机法。随机法最高的AP为33.75%,而选择法最高可达到44.34%。根据图12,显然随机法的方差较大,SWSD算法更加稳定。当使用全部的提议时,SWSD算法的AP为30.79%,优于随机法的27.03%,因为SWSD算法多使用了100个ground truth作为全监督样本。当IOP为5%时,SWSD算法的AP为30.59%,高于只使用100个正例样本时DPM的AP,因为添加了更多的弱监督信息。当IOP逐渐增加到30%,SWSD算法的AP不断增大,因为选出了更多的正示例。当IOP介于25%到65%之间时,AP高于40%。但当IOP继续增大,可选择的正示例数量减小,只能将负示例加入包中,因此AP下降了。

Fig.11 Comparison among random, selective and DPM methods图11 随机法,选择法与DPM之间的比较

Fig.12 Variance comparison between random and selective methods图12 随机法与选择法的方差比较

图13展示了某张图片第1~15个被选择的提议,可以看出大部分均为正,说明了SWSD算法的有效性。虽然本文使用了100个手工标注的ground truth,但这只需要很小的代价。实验说明只要选择合适数量的提议,就可以提高弱监督检测的性能。

Fig.13 1~15 selected proposals of one image图13 某张图片第1~15个被选择的提议

表2列出了近两年在Pascal VOC 2007的人类测试集上多个弱监督检测的AP。可以看出,经过对训练样本和模型参数的分析,SWSD算法大幅度提高了性能。之所以本文方法更好,主要是因为加入了少量的监督信息,同时控制了更多的实验细节,发现了最好的训练方法。最关键的是,尽可能保证了包中正示例比例是个较大的值。图14给出了实验过程。

Table 2 AP of multiple instance detection in person test set of Pascal VOC 2007表2 Pascal VOC 2007的人类测试集上多示例检测的AP

Fig.14 Experimental process图14 实验过程

6 结束语

经过本文综合性的评估实验,根据实验结果和相关分析,主要得出以下结论:

(1)当正示例比例是一个相对较大的值时,多示例学习的性能优于监督学习,体现了多示例学习的巨大潜力。

(2)可以手工标注少量的样本,然后用这些样本迭代选择示例。本文提出的SWSD算法用较小的代价确保了大的正示例比例,并提高了弱监督人体检测的性能。

(3)在多示例检测中,使用Max Pooling融合策略估算包为正的概率比Noisy-or模型更合适。

(4)在LSP数据集上,Selective Search算法可以提供类似ground truth的提议。

(5)在本文工作中,最好的多示例检测模型为MIL_AdaBoost与MIL_LR的集成算法。

[1]Dalal N,Triggs B.Histograms of oriented gradients for human detection[C]//Proceedings of the 2005 IEEE Conference on Computer Vision and Pattern Recognition,San Diego,USA,Jun 20-26,2005.Washington:IEEE Computer Society,2005,1:886-893.

[2]Toshev A,Szegedy C.Deeppose:human pose estimation via deep neural networks[C]//Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition,Columbus,USA,Jun 23-28,2014.Washington:IEEE Computer Society,2014:1653-1660.

[3]Yang Y,Ramanan D.Articulated human detection with flexible mixtures of parts[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2013,35(12):2878-2890.

[4]Buys K,Cagniart C,Baksheev A,et al.An adaptable system for RGB-D based human body detection and pose estimation[J].Journal of Visual Communication and Image Representation,2014,25(1):39-52.

[5]Oren M,Papageorgiou C,Sinha P,et al.Pedestrian detection using wavelet templates[C]//Proceedings of the 1997 IEEE Conference on Computer Vision and Pattern Recognition, San Juan,Puerto Rico,Jun 17-19,1997.Washington:IEEE Computer Society,1997:193-199.

[6]Ouyang Wanli,Zeng Xingyu,Wang Xiaogang.Learning mutual visibility relationship for pedestrian detection with a deep model[J].International Journal of Computer Vision, 2016,120(1):14-27.

[7]Cinbis R G,Verbeek J,Schmid C.Weakly supervised object localization with multi-fold multiple instance learning[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(1):189-203.

[8]Everingham M,Van Gool L,Williams C K,et al.The Pascal visual object classes(VOC)challenge[J].International Journal of Computer Vision,2010,88(2):303-338.

[9]Girshick R,Donahue J,Darrell T,et al.Rich feature hierarchies for accurate object detection and semantic segmentation[C]//Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition,Columbus,USA,Jun 23-28,2014.Washington:IEEE Computer Society,2014: 580-587.

[10]Zhang Yuting,Kihyuk S,Ruben V,et al.Improving object detection with deep convolutional networks via Bayesian optimization and structured prediction[C]//Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition,Boston,USA,Jun 7-12,2015.Washington:IEEE Computer Society,2015:249-258.

[11]Pandey M,Lazebnik S.Scene recognition and weakly supervised object localization with deformable part-based models[C]//Proceedings of the 2011 International Conference onComputer Vision,Barcelona,Spain,Nov 6-13,2011.Washington:IEEE Computer Society,2011:1307-1314.

[12]Siva P,Xiang Tao.Weakly supervised object detector learning with model drift detection[C]//Proceedings of the 2011 International Conference on Computer Vision,Barcelona,Spain, Nov 6-13,2011.Washington:IEEE Computer Society,2011: 343-350.

[13]Russakovsky O,Lin Yuanqing,Yu Kai,et al.Object-centric spatial pooling for image classification[C]//Proceedings of the 12th European Conference on Computer Vision,Florence, Italy,Oct 7-13,2012.Berlin,Heidelberg:Springer,2012:1-15.

[14]Song H O,Girshick R,Jegelka S,et al.On learning to localize objects with minimal supervision[J].arXiv:1403.1024,2014.

[15]Song H O,Lee Y J,Jegelka S,et al.Weakly-supervised discovery of visual pattern configurations[C]//Proceedings of the Annual Conference on Neural Information Processing Systems,Montreal,Canada,Dec 8-13,2014:1637-1645.

[16]Bilen H,Pedersoli M,Tuytelaars T.Weakly supervised object detection with posterior regularization[C]//Proceedings of the British Machine Vision Conference,Nottingham,UK, Sep 1-5,2014:1997-2005.

[17]Wang Chong,Ren Weiqiang,Huang Kaiqi,et al.Weakly supervised object localization with latent category learning [C]//LNCS 8694:Proceedings of the 13th European Conference on Computer Vision,Zurich,Switzerland,Sep 6-12,2014. Berlin,Heidelberg:Springer,2014:431-445.

[18]Ray S,Craven M.Supervised versus multiple instance learning:an empirical comparison[C]//Proceedings of the 22nd International Conference on Machine Learning,Bonn, Germany,Aug 7-11,2005.New York:ACM,2005:697-704.

[19]Xu Xin,Frank E.Logistic regression and boosting for labeled bags of instances[C]//LNCS 3056:Proceedings of the 8th Pacific-Asia Conference on Advances in Knowledge Discovery and Data Mining,Sydney,Australia,May 26-28, 2004.Berlin,Heidelberg:Springer,2004:272-281.

[20]Viola P,Platt J C,Zhang Cha.Multiple instance boosting for object detection[C]//Proceedings of the Annual Conference on Neural Information Processing Systems,Vancouver, Canada,Dec 5-8,2005:1417-1424.

[21]Papageorgiou C,Poggio T.A trainable system for object detection[J].International Journal of Computer Vision,2000, 38(1):15-33.

[22]Viola P,Jones M.robust real-time face detection[J].International Journal of Computer Vision,2004,57(2):137-154.

[23]Felzenszwalb P F,Girshick R B,McAllester D.Cascade object detection with deformable part models[C]//Proceedings of the 2010 IEEE Conference on Computer Vision and Pattern Recognition,San Francisco,USA,Jun 13-18,2010.Washington:IEEE Computer Society,2010:2241-2248.

[24]Van de Sande K E A,Uijlings J R R,Gevers T,et al.Segmentation as selective search for object recognition[C]//Proceedings of the 2011 International Conference on Computer Vision,Barcelona,Spain,Nov 6-13,2011.Washington:IEEE Computer Society,2011:1879-1886.

[25]Uijlings J R R,van de Sande K E A,Gevers T,et al.Selective search for object recognition[J].International Journal of Computer Vision,2013,104(2):154-171.

[26]Hosang J,Benenson R,Dollár P,et al.What makes for effective detection proposals?[J].IEEE Transactions of Pattern Analysis and Machine Learning,2016,38(4):814-830.

[27]Arbelaez P,Pont-Tuset J,Barron J,et al.Multiscale combinatorial grouping[C]//Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition,Columbus,USA,Jun 23-28,2014.Washington:IEEE Computer Society,2014:328-335.

[28]Alexe B,Deselaers T,Ferrari V.Measuring the objectness of image windows[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2012,34(11):2189-2202.

[29]Van den Bergh M,Roig G,Boix X,et al.Online video SEEDS for temporal window objectness[C]//Proceedings of the 2013 IEEE International Conference on Computer Vision,Sydney,Australia,Dec 1-8,2013.Piscataway,USA: IEEE,2013:377-384.

[30]Zhu Qiang,Yeh M C,Cheng K T,et al.Fast human detection using a cascade of histograms of oriented gradients[C]//Proceedings of the 2006 IEEE Conference on Computer Vision and Pattern Recognition,New York,Jun 17-22,2006.Washington:IEEE Computer Society,2006,2:1491-1498.

[31]Ke Yan,Sukthankar R.PCA-SIFT:a more distinctive representation for local image descriptors[C]//Proceedings of the 2004 IEEE Conference on Computer Vision and Pattern Recognition,Washington,Jun 27-Jul 2,2004.Washington:IEEE Computer Society,2004:506-513.

[32]Howarth P,Rüger S.Evaluation of texture features for con-tent-based image retrieval[C]//LNCS 3115:Proceedings of the 3rd International Conference on Image and Video Retrieval,Dublin,Ireland,Jul 21-23,2004.Berlin,Heidelberg:Springer,2004:326-334.

[33]Schmidhuber J.Deep learning in neural networks:an overview[J].Neural Networks,2015,61:85-117.

[34]Simonyan K,Zisserman A.Very deep convolutional networks for large-scale image recognition[J].arXiv:1409.1556, 2014.

[35]Deng Jia,Dong Wei,Socher R,et al.ImageNet:a largescale hierarchical image database[C]//Proceedings of the 2009 IEEE Conference on Computer Vision and Pattern Recognition,Miami,USA,Jun 20-25,2009.Washington: IEEE Computer Society,2009:248-255.

CAI Yawei was born in 1992.She is an M.S.candidate at College of Computer Science and Technology,Nanjing University ofAeronautics andAstronautics.Her research interests include pattern recognition and machine learning.蔡雅薇(1992—),女,安徽黄山人,南京航空航天大学计算机科学与技术学院硕士研究生,主要研究模式识别,机器学习。

TAN Xiaoyang was born in 1971.He received the Ph.D.degree from Department of Computer Science and Technology,Nanjing University in 2005.Now he is a professor and Ph.D.supervisor at Nanjing University of Aeronautics and Astronautics,and the member of CCF.His research interests include computer vision,pattern recognition and machine learning.

谭晓阳(1971—),男,江苏淮安人,2005年于南京大学计算机科学与技术系获得博士学位,现为南京航空航天大学计算机科学与技术学院教授、博士生导师,CCF会员,主要研究领域为计算机视觉,模式识别,机器学习。主持多项科研课题,在一流国际期刊和顶级国际会议上发表论文40余篇。

Weakly Supervised Human Body Detection underArbitrary Poses*

CAI Yawei+,TAN Xiaoyang

College of Computer Science and Technology,Nanjing University of Aeronautics and Astronautics,Nanjing 210016,China

+Corresponding author:E-mail:caiyawei@nuaa.edu.cn

The problem of weakly supervised human body detection under difficult poses(e.g.,multi-view and/or arbitrary poses)is studied.Most current methods on human body detection focuse only on a few common human body poses with human body in upright positions,while in the real world human bodies may exhibit very rich pose variations(e.g.,when people are bending,sleeping or sitting).This not only imposes great challenges on the task of human detection,but also makes the job of manual annotation even more difficult,and usually only weak annotations are available in practice.The multiple instance learning method relaxes the requirements of accurate labeling and hence is commonly used to address the task.However,it is sensitive to the quality of positive instances and the settings of some model parameters such as the strategy to fuse the instance-level conditional probability into a baglevel one.This paper presents a comprehensive and in-depth empirical method of these important but less studied issues on the person dataset of Pascal VOC 2007,and proposes a new selective weakly supervised detection algorithm(SWSD).Experiments demonstrate that with only a few fully supervised samples,the performance of weakly supervised human body detection can be significantly improved under the multiple instance learning framework.

weakly supervision;human body detection;arbitrary poses;multiple instance learning

10.3778/j.issn.1673-9418.1603044

A

TP391

*The National Natural Science Foundation of China under Grant No.61373060(国家自然科学基金).

Received 2016-03,Accepted 2016-05.

CNKI网络优先出版:2016-05-13,http://www.cnki.net/kcms/detail/11.5602.TP.20160513.1434.004.html

CAI Yawei,TAN Xiaoyang.Weakly supervised human body detection under arbitrary poses.Journal of Frontiers of Computer Science and Technology,2017,11(4):587-598.

摘 要:困难姿态(多视角或者任意姿态)下的弱监督人体检测问题被关注研究。现在大部分人体检测仅仅关注普通的直立姿态,但现实中的人体却呈现非常丰富的姿态(如弯曲的、躺着的、坐着的),这不仅加大了人体检测的难度,而且令标注工作更加困难,实际中通常只能获得弱标注样本。多示例学习方法放松了精准标注的要求,因此常常被用来解决此类问题。但是多示例学习对正示例的质量以及一些模型参数设置相当敏感,例如将示例层次条件概率融合到包层次的策略。在Pascal VOC 2007的人类数据集上对这些重要但很少被关注的问题进行了综合性深度研究,并提出了一种新的选择性弱监督检测算法(selective weakly supervised detection,SWSD)。实验证明,只要添加少量的监督样本,在多示例学习框架下,可以大幅度提高弱监督人体检测性能。