自动驾驶:近在咫尺,还是遥不可及

冬雪

人工智能已经演变为争夺未来的战略高地,得人工智能者得天下!自动(无人)驾驶汽车是人工智能的代表之一,而且因其实用性更强、经济增量更大,也更吸引人。2017年10月17日,百度阿波罗(Apollo)与厦门金龙客车签署战略合作协议,将于2018年7月小批量生产双方合作研发的无人驾驶微循环车,随后投入试运营。这将是国内首个实现量产的无人驾驶客车。然而,要使无人驾驶汽车真正上路,需要在技术、伦理、法律和管理多方面获得“通关”。那么,通过这些关口有多难呢?

技术的问题首先在分级

百度的无人驾驶汽车如期上路其实很悬。无人驾驶微循环车定位于解决“最后一公里”的出行问题,只在特定环境运营,如大型园区内的接驳车、机场摆渡车、旅游景点的观光车等。这类场地驾驶环境简单、路线单一,便于发挥无人驾驶的优势。尽管如此,法律能否批准仍是一个问题。

汽车带给人们效率和经济发展的同时,安全也成为一个大问题,因此,世界上才有浩如烟海的交通法规。把人类掌控的方向盘让位于人工智能,就等于把人、物和车的安全交给人工智能,显然,人类并无太大的把握,所以无人驾驶要依据循序渐进的原则。

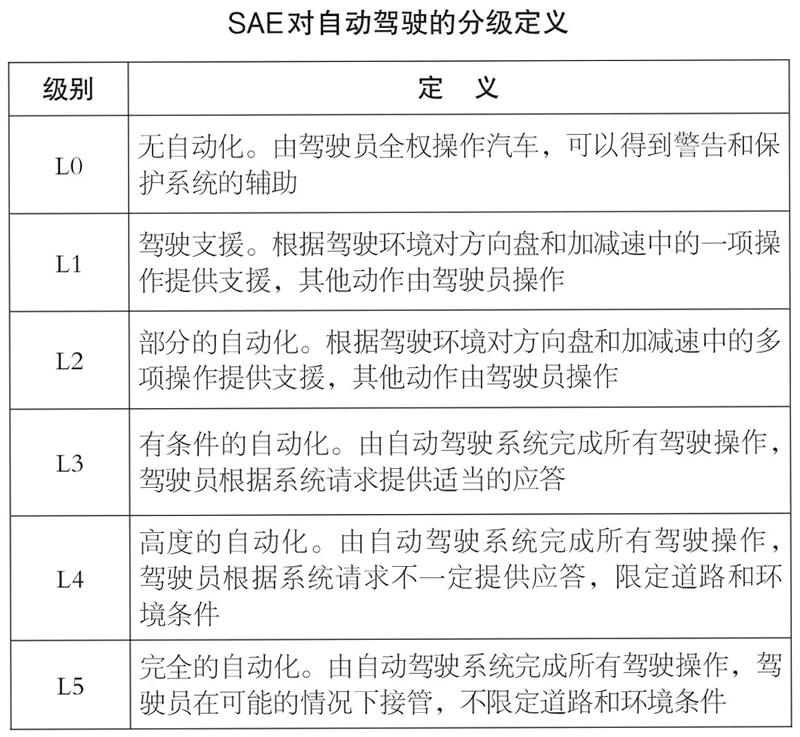

现在,全世界多数国家都按美国汽车工程师学会(SAE)的标准来对自动驾驶进行分类(如简表)。相比完全靠驾驶员自己操控的传统驾驶(L0),L1级的自动驾驶能给驾驶员一些帮助。例如,今天已经在很多车上搭载的自适应巡航(ACC)功能能通过雷达探测与前车的实时距离自动控制加减速,从而保持与前车的安全距离。

L2的标准是,汽车除了具备L1级描述中的自适应巡航外,还具备车道保持(LKA)功能或者自动变道功能。也就是说,系统除了能控制加减速,还能对方向盘进行控制。不过,人仍然是驾驶环境的观察者。

L3级最大的不同在于,道路环境的观察者由人变更为人工智能系统。系统已经完全能够识别出直线、弯道、红绿灯、限速路牌以及路上行走奔跑的人与动物等各种环境。环境观察和驾驶操作均由系统来完成。此时仍需要驾驶员,以对所有的系统请求进行应答。如突然下雨地面湿滑是否需要减速,前方车辆行驶过慢是否需要超车,前方有人在车道较近处走动是否需要鸣笛提醒等,这些请求系统会反馈给驾驶员,由其决定。

L4级的驾驶操作和环境观察仍然由系统完成。但是,在L3的基础上,人不需要对所有的系统要求进行应答,只需要在某些复杂地形或者天气恶劣的情况时,才由人对系统请求给出决策,其他情况下系统能独自应付,自动驾驶。

L5级是指车上没有方向盘、刹车、油门和驾驶员,乘客尽管放心地在车上睡觉、玩手机,系统操作应对一切,直至到达目的地提醒乘客下车。

显然,L5级自动驾驶才是真正的无人驾驶。现在,世界上最先进的自动汽车才达到L2,要达到L5还有很长的路要走。世界多数车企,如福特、丰田、本田、宝马、沃尔沃等公司提出的目标是在2020年前后量产能够达到L3级的自动驾驶汽车。比照上述标准,百度的无人驾驶微循环车并非完全意义上的自动驾驶。

自动驾驶安全吗?

以特斯拉的Autopilot为例,它是一个自动驾驶软件,配备于特斯拉的一款称为Model S的汽车上。2016年5月7日,美国人约书亚·布朗驾驶Model S在一处双向高速公路上行驶时,与一辆拖挂车相撞,不幸身亡。这是全球第一起因自动驾驶而致死的事故。

事后,美国国家高速公路交通安全管理局(NHTSA)针对Autopilot功能展开调查。经过半年的调查,NHTSA于2017年1月19日宣布,未发现Autopilot功能存在问题,同时不会要求特斯拉对汽车进行召回。NHTSA的结论是,特斯拉Autopilot不是完全自动驾驶系统,它根本无法应对所有路况,司机不应该依靠它来防止此类事故。

装备Autopilot的Model S属于自动驾驶L2级,离完全自动的L5级差得太远,并且布朗本人有太多疏忽。事發前37分钟的行程中,布朗的手仅有25秒被检测到手握方向盘。Autopilot自动辅助驾驶系统向布朗发出了多次视觉警告、铃声警告及语音警告,但布朗均无动于衷。在车祸发生时,布朗的汽车时速超过限速,而且他本人正在车上观看哈利·波特电影。

除了人祸之外,自动驾驶技术并非没有缺陷。尽管Autopilot开启了功能并提醒布朗注意,但强烈的日照和拖挂车白色车身让Autopilot系统摄像头短暂“失明”,未能够在白天强光下及时发现拖车白色侧面的反光,导致在自动驾驶模式下的刹车功能未能紧急启动,使得两车直接发生撞击。

特斯拉公司也向美国高速公路交通安全管理局下属的缺陷调查办公室提供了配置Autopilot技术的Model S和Model X等汽车在2014~2016年期间所有行驶里程和安全气囊相关的数据。调查人员利用这些数据计算了Autopilot系统安装前后的撞车率,得出特斯拉安装了Autopilot系统后汽车更安全的结论。NHTSA也承认,自从特斯拉汽车于2015年安装了Autosteer(方向盘自主转向)软件以来,特斯拉汽车的撞车率已经下降了40%左右。Autosteer是Autopilot系统的功能之一,能够让特斯拉汽车保持在自己的车道上行驶,即使遇到弯道仍能够让汽车自行转弯。

美国2016年的统计表明,美国公路上因交通事故丧生的人数超过35000人,其中94%的事故是因司机失误导致的。但是,美国特斯拉的车主使用自动驾驶仪(只是L2级)的行驶距离超过2亿千米,才只出过一次致死事故。毫无疑问,无人驾驶汽车的安全性高于人类的老司机。

自动驾驶面临的伦理难题

即便所有的技术难题都能解决,自动驾驶也不会100%的安全,总会出错,这就涉及一个问题,如何在发生事故前躲避?避免事故的智能软件设计也就面临伦理难题。

有调查发现,驾驶员在右前方有障碍(人和物)时一般是往左打方向盘,反之则往右打方向盘,这是一种本能的下意识举动。当然,更有可能是因车速太快和事发突然而来不及做出规避反应。但是,自动驾驶汽车却要面临一种选择,即“电车难题”,最早由英国哲学家菲利帕·福特在1967年发表的《堕胎问题和教条双重影响》中提出。

“电车难题”是这样的:假设5名无辜的人被绑在电车轨道上,一辆失控的电车朝他们驶来,片刻后就要碾压到他们。不过,你可以拉一个拉杆,让电车开到另一条轨道上。但是,另一条轨道上也绑了一个人,你面临两个选择:不拉杆,5人死亡;拉杆,1人死亡。你会怎么做呢?按利益最大化或损失最小化,多数人都会选择拉杆,让1人死亡救5人。但是,1人死亡还是杀了人,也躲不过良心的谴责。

一旦自动驾驶汽车上路,必然面临这种伦理难题,并且,人工智能的设计可能会陷入无尽的矛盾中。例如,如果是以死人的多少来设计人工智能的操作程序,那么接下来是否还会根据年龄、性别、地位的高低来选择“拉杆”?面对一位孕妇和一位老人,汽车出事前该撞向谁?

无人驾驶就是迫使人工智能把人分等级,按人的多与少、高贵与贫贱来选择,所以躲不开功利主义。当然,这种功利主义还是人的选择,因为智能软件是人设计的。不过,人工智能的选择有时也许要优于人的选择。比如,在面临5人与1人时,如果人类驾驶员看到的那1人是自己的亲朋,或许会选择冲撞陌生的5人,但无人驾驶汽车只会按设计的救多数牺牲少数的程序来行事,所以似乎显得更公平。

现在,新的研究还显示,无人驾驶面临更复杂的伦理选择,例如在将要发生事故时,是拯救车上的乘客还是挽救路人。法国和美国的研究人员合作在2016年6月24日的《科学》杂志上发表了几项研究结果。

其一,假如存在一场不可避免的事故,是救乘客还是路人?研究人员在线咨询了451人,当车上只有一名乘客并且只有一名行人时,75%的受试者表示應该救乘客。但是当行人的数量增加时,受试者开始转变立场。如果有5名行人和1名乘客,50%的受试者表示应该救乘客。当行人人数达到100人,乘客是1人时,有80%左右的受试者表示要救行人。

其二,研究人员询问了259人,自动驾驶汽车是否应该给车辆设定程序以保护“人数更多的一方”?结果以100点评级方式来衡量,受试者对这一问题的平均支持点数为70点。但是,当被问及他们是否愿意购买牺牲驾驶员的车辆时,其兴趣大幅下降,支持点数仅为30点。

上述研究结果反映了人们对于自动驾驶汽车的矛盾心态。人们并非接受保护多数人的观点,而是趋向于保护车中的乘客,哪怕车上的乘客明显少于行人。同时,人们又支持为车辆设定程序以保护人多的一方,但不太愿意购买有可能牺牲驾驶员的车辆。

所以,对自动驾驶汽车是人为设定程序还是让其自主决策,以及“电车难题”是否会造成自动驾驶汽车的困境,莫衷一是。不过,在讨论自动驾驶的伦理难题时,有人提出了两个关键点。一是不能把人的生命交由人工智能来处置,即自动驾驶的系统编程不应在人的生命中进行挑选,也不应该在受害者中进行抵消,但自动驾驶应秉持损害最小化原则;二是自动驾驶应避免陷入“电车难题”。从车辆的设计和编程开始,就应考虑以一种具备防御性和可预期的方式驾驶,自动驾驶应重在完善技术,并通过可控交通环境的应用、车辆传感器、刹车性能、危险情况中给受威胁者发出信号提示、通过“智能”道路基础设施等来预防危险,最大程度地增强道路安全性,避免两难局面的发生。

然而,要实现这两点除了不太可能外,还陷入自相矛盾之中,例如,不应在自动驾驶的编程中涉及功利主义的程序,但又要求自动驾驶应秉持损害最小化原则,后者本身就是功利主义选择。

法律对自动汽车开了一个口子

人无论做什么事情,都要对结果负责,所以有自然人和法人的负责形式。但是,自动驾驶没有人,其运营和出了事后谁负责呢?在没解决这个问题之前,1968年联合国制定的道路交通公约规定,汽车的控制者必须是人而非电脑。

不过,法律是人制定的,也是随时代发展而变化的,为适应自动驾驶汽车上路,一些国家已经解冻自动驾驶汽车的法律,允许自动驾驶汽车有条件地上路。自动驾驶汽车上路最大的法律基础或法理是,把研发、生产自动驾驶汽车的人员和机构作为责任人(法人)。尽管如此,现今的法律也只是有条件地允许自动驾驶汽车上路,主要是测试。

2017年10月12日,美国加利福尼亚州车辆管理局宣布,从2018年6月起允许没有方向盘、制动踏板、后视镜和没有驾驶员的无人驾驶汽车在道路上进行测试,允许公众乘坐配有无人驾驶技术的车辆。所有上路测试的自动驾驶汽车都属于L3级自动驾驶汽车,在某些情况下依然还需要人工干预。此外,美国国会正考虑立法,允许厂商生产和部署没有踏板和方向盘的非传统类型汽车,同时还允许各州政府制定单独的自动驾驶监管法案。

相比而言,德国的法律更进了一步。2017年5月12日,德国联邦参议院通过首部自动驾驶汽车的法律,允许汽车自动驾驶系统未来在特定条件下代替人类驾驶。这部法律首先明确了法律责任,如果在人为驾驶的情况下发生事故,驾驶人承担事故责任;如果是人工智能系统引发事故,将由汽车制造商承担责任。

判断人为驾驶还是自动驾驶将由汽车上安装的一个类似黑匣子的装置来确认,该装置可以记录系统运作、要求介入和人工驾驶等不同阶段的具体驾驶情况,以保证在出现交通安全事故时,明确责任划分。

当然,德国的这部法律也还没有涉及自动驾驶的最高级L5级,该法律规定驾驶席必须有司机,并且要保留方向盘、油门和刹车等配置,以保证在自动驾驶系统出现故障的情况下,驾驶者能及时介入,并且在何时能让自动驾驶汽车上路也语焉不详。

2017年10月14日,日本国土交通省首次推出了关于自动驾驶的安全标准。规定必须搭载一种功能,在路上自动行驶时,当司机手离开方向盘15秒以上,自动系统将发出警告;如继续保持手离开方向盘的状态,50秒后自动驾驶系统将停止,切换为手动驾驶。

显然,德国的自动驾驶汽车的法律最开放,但时间未定,美国次之,日本的基本还算不上自动驾驶法规。中国目前尚无自动驾驶汽车的法律。因此,无论是国外还是国内,自动驾驶汽车上路和运营还有漫长的路要走。

【责任编辑】庞 云