嵌入式助航灯具定位系统设计与实现

牛国臣,袁 婕,谷润平

(1.中国民航大学 机器人研究所,天津 300300; 2.中国民航大学 空中交通管理学院,天津 300300)(*通信作者电子邮箱13752255179@139.com)

0 引言

民航机场助航灯光系统[1]需全天候服务,嵌入式助航灯具透光镜表面附着污染物时,其发光强度大大降低[2],严重影响目视飞行中飞机起降过程的安全,需定期清洗[3-5]。目前,机场通常采用人工或利用自动化装置对嵌入式助航灯具的透光镜进行清洗,以在保证其发光强度的同时节约能源。采用自动化装置对嵌入式灯具进行清洗时,需对灯具透光镜进行精确定位。

目前,天津机场现采用高压喷气枪去除嵌入式助航灯具透光镜上的污物;广州白云机场曾使用灯具清洗车,但这些清洗装置均需人工定位灯具。全自动化的嵌入式助航灯具清洗装置中,灯具定位系统是否能准确、快速判断灯具位置,是有效清洗的关键。项目组前期设计了文献[6]中的嵌入式灯具清洗装置,其定位系统采用电涡流传感器通过检测嵌入式灯具金属外壳实现定位,存在定位误差大、速度慢及适用性较差的问题[7]。文献[8]中利用嵌入式灯具光强检测的方法识别灯具位置,但未提出具体灯具定位算法,且其精度有待进一步论证。基于里程计和云台[9]以及基于视频监控系统[10]的视觉定位方法对运动物体有较好的定位效果,但其精度较低且无法安装在跑道附近。文献[11]运用小波变换方法提取对象轮廓,适用于对曲率大的尖锐物体进行识别定位;文献[12-13]中对微小物体进行定位,精度较高,适用于在理想环境下的矩形物体定位,而民航机场嵌入式助航灯具工作环境较复杂。

综上,现有的定位方法在嵌入式助航灯具定位方面存在精确性、适用性及快速性上的不足。因而,对嵌入式助航灯具清洗装置的定位系统进行分析研究,提出基于改进最大类间方差法Otsu的灯具定位方法。嵌入式助航灯具的清洗均在夜间停航时进行,以夜间发光的跑道中线灯为例进行研究。

1 灯具定位模型

民用机场跑道中线灯两灯间最短间距为7.5 m,一般间距15 m,最长达30 m[1]。为避免干扰,采用由两部摄像机组成的定位系统对嵌入式助航灯具透光镜进行定位,建立定位模型,优化摄像机安装参数,并验证模型的理论精度。该定位统系统将作为文献[6]中嵌入式助航灯具清洗系统的一部分安装于清洗车上,要求定位系统以最低速2 m/s水平行进时对嵌入式灯具进行定位。嵌入式助航灯具透光镜长、宽分别不超过40 mm、20 mm,要求定位系统误差不得大于嵌入式灯具透光镜长宽的一半,用欧氏距离表示,即要求灯具定位误差小于22.4 mm。

1.1 系统结构设计

为使系统在水平行进过程中将一个灯具作为目标进行定位,且采用两部摄像机对灯具进行拍摄时应尽可能减少其他灯具光强的干扰,需优化两部摄像机的安装参数。根据实际灯具的距离要求,优化摄像机安装参数,反推其视角和焦距。两部摄像机采用相同的测距原理但为同时兼顾系统的准确性、适用性、快速性,上部摄像机主要应用于对灯具位置预判并对文献[6]中的清洗车导航,下部摄像机主要应用于对灯具进行精确定位,采用两部摄像机是必要的[14]。

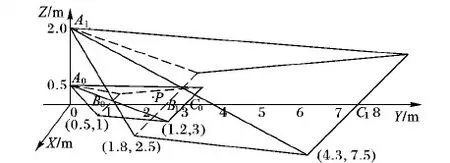

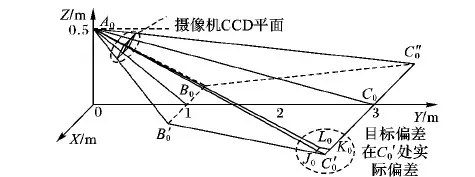

定位系统将安装于文献[6]中的嵌入式助航灯具清洗车上,清洗车高2 m,底盘高0.3 m。两摄像机上下竖直安装于清洗车上,下部摄像机光心位于A0点,垂直高度0.5 m以满足精度要求;上部摄像机光心位于A1点,垂直高度2 m以实现对灯具位置预判和清洗车导航。跑道中线灯直径约为0.2 m和0.3 m,如图1所示,为使拍摄视野中仅有一个灯且两摄像机的拍摄范围相衔接,设计两摄像机视野相交处为B1C0=0.5 m;考虑跑道中线灯的最短间距,同时为减小跑道其他发光灯具对图像品质的影响,设计两摄像机总视程为B0C1=6.5 m,其中B0C0=2 m,B1C1=5 m。

图1 系统结构及视角范围

定义摄像机光轴偏离水平面以下的角度为摄像机安装角θ,表示水平面与摄像机光轴的夹角。由系统模型知,下部摄像机θ0=18.0°;上部摄像机θ1=26.8°。摄像机焦距依据系统模型和摄像机垂直视角通过计算和实验反推出,上下两部摄像机的物理焦距分别为4 mm和6 mm。

1.2 系统理论精度

依据基于视觉的定位原理计算上述模型理论精度,以下部摄像机为例,验证该系统是否能达到精度要求。

1.2.1 定位原理

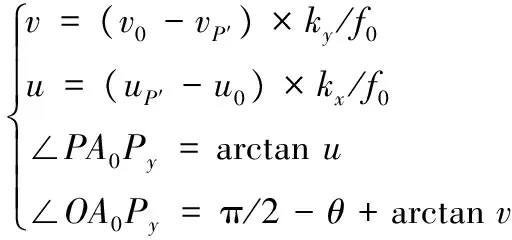

图1中地面上一点P在下部摄像机电荷耦合元件(Charge Coupled Device, CCD)平面上成像图如图2所示,其中:P′为P的成像点;e为摄像机光轴与CCD平面交点,其坐标通过摄像机标定获得[15]。P经系统定位可得其空间坐标(x0,y0,z0),如式(1)~(2)所示:

(1)

其中:

(2)

其中:kx、ky(mm/像素)分别是单位像素在CCD平面上的物理长度;(u0,v0)为摄像机光心像素坐标;(uP′,vP′)为P点投影在摄像机图像平面上的像素坐标;Py是P点在空间Y轴的投影;f0为摄像机焦距。

图2 从摄像机处观察成像平面γ

1.2.2 理论精度计算

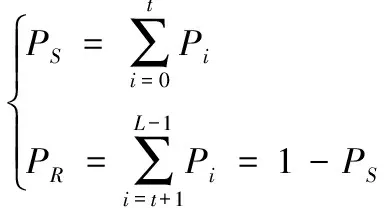

(3)

图3 目标点图像偏差在位置C0′处产生实际偏差

2 助航灯具目标提取

使用摄像机对嵌入式灯具进行定位,目的是根据图像定位出灯具透光镜的实际质心。根据夜间发光的嵌入式助航灯具特点:透光镜附近很小的区域比其周围的环境亮得多,因而将夜间发光灯具的透光镜中心位置作为定位目标。首先,将拍摄的彩色图像变为二值图像;其次,采用简单平滑对图像进行滤波处理;最后,研究阈值化和目标提取算法。

2.1 Otsu改进算法

在视频处理中使用固定阈值无法保证每帧图像都能提取出有效的目标图像,因此,使用自适应阈值算法对图像进行二值化处理。最大类间方差法Otsu作为一种能够对图像进行二值化阈值计算的高效算法,可用于对图像进行自适应阈值处理。对于夜间发光灯具,运用Otsu标准算法在本设计中运用效果不好,为达到更好的目标提取效果,保证系统精度,对该算法进行改进。

夜间进行图像采集,平均灰度值较低且对整幅图片影响较大,直方图数据表明灰度值较大部分其所占像素数少,使得标准Otsu算法阈值偏低,导致部分背景图像被划分到前景图像中。其结果是使原本应作为背景的部分区域划分到前景区域中,因此目标区域较大影响系统定位精度。

为解决此问题,对灰度值低于整幅图像平均灰度值的像素点进行处理,使其灰度直方图的概率累加和为平均灰度值所对应概率的一半。这样在遍历所有灰度值求类间方差最大值时,自适应阈值相对改进前会变大,因而减小了夜间拍摄时黑暗环境对目标图像提取的影响。设目标为S,所占概率PS,平均灰度值为ωS;背景为R,所占概率PR,平均灰度值为ωR;全局平均灰度值ω0,所对应的灰度级为I,所占像素数为nI;L表示灰度级总数,每个灰度级i所占像素数ni,其占总像素数的比例为Pi;类间方差σ2;t0、t分别为改进前后类间方差最大时的灰度值,即所求自适应阈值。算法如下。

步骤1 建立灰度直方图:

(4)

步骤2 计算目标、背景概率,并计算两类图像的平均灰度:

(5)

(6)

步骤3 计算平均灰度值公式如下:

(7)

步骤4 直方图重建计算式如下:

(8)

重复步骤2~3后进行步骤5。

步骤5 计算类间方差公式如下:

σ2=PS(ωS-ω0)2+PR(ωR-ω0)2

(9)

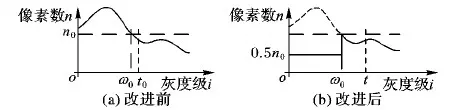

遍历所有像素,选择类间方差最大值时的t值作为阈值。算法改进前后灰度直方图示意图如图4所示。

图4中,横坐标表示灰度值,纵坐标表示每个灰度值所占像素数。图4(b)中灰度值小于平均灰度值ω0的概率用平均灰度值所占概率的一半替代,使得类间方差最大值t大于改进前的t0,即阈值增大。

图4 Otsu算法改进前后灰度直方图示意图

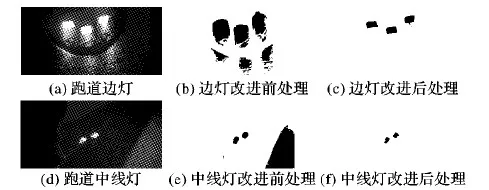

对夜间发光的两种嵌入式助航灯具进行图像采集,如图5(a)、(d)所示。

图5 两种灯具经Otsu算法改进前后的自适应阈值处理结果

图5(b)、(c)与图5(e)、(f)为图5(a)、(d)经改进前后的Otsu算法处理所得图像,阈值分别为:37,254,92,106,图5(c)、(f)较图5(b)、(e)的阈值大得多且二值化区域更小更精确。通过观察图像对比处理前后阈值可知,Otsu改进算法通过在标准算法中运用所提方法对灰度直方图进行重建,使得该算法能够获取更大的类间方差最大值t,使得二值化处理后获得的灯具透光镜位置信息更精确,便于后续图像质心的精确提取。

2.2 质心提取算法

采用阶距法对经Otsu算法处理后的图像进行质心提取,得到嵌入式助航灯具在图像中的定位点。对一幅2D的离散化数字图像,当f(u,v)≥0时,p+q阶矩mpq定义为:

(10)

其中:M、N分别为横、纵坐标像素数,当(u,v)为目标区域中的点时取f(u,v)=1;否则f(u,v)=0。

图像的质心和第0、第1阶矩有关。式(11)为嵌入式助航灯具质心坐标(uc,vc)计算方程:

(11)

3 校正及检测实验

为减小视频拍摄过程中的误差和系统自身误差,提高精度,对系统进行误差补偿。对补偿后的系统进行精确度测试,判断所设计的系统是否满足要求。

3.1 灯具定位系统误差补偿

在灯具定位系统中,存在诸多因素引起的误差,其中由环境、系统安装等外部因素引起的误差发生在视频图像的采集阶段,系统中大部分误差在该阶段产生。针对这类误差,通过对比实际距离和测量距离之间的偏差,寻找二者之间的关系,对系统进行误差补偿,提高系统精确度。

机场夜间停航时一般关闭跑道灯光;飞机起降频率较低时会降低光强;停航检修时一般会开二级或三级光。一般选择上述3种情况对灯具进行清洗。在实际拍摄和图片处理过程中发现三级光灯具能得到较好的处理效果,最终选择三级光强的跑道中线灯对系统进行误差补偿,应用SONY HDR-PJ30E摄像机进行拍摄。开发工具包括:Microsoft Visual Studio 2010、OpenCV b5a、Matlab。以下部摄像机为例,具体灯具定位系统校正实验步骤如下:

1)固定摄像机倾角;

2)建立如图1所示摄像机坐标系,其中XOY平面为地面,Z轴垂直于XOY平面且通过摄像机光心;

3)移动摄像机使得灯具坐标x=0,y变化时拍摄多组照片,并记录灯具此时实际距离;

4)确定三个y值,移动摄像机使得灯具处于相应y值处,x进行变化,拍摄多组照片,并记录灯具此时实际距离;

5)对所有照片进行处理,记录处理后的数据;

6)用Matlab得到补偿的拟合方程。

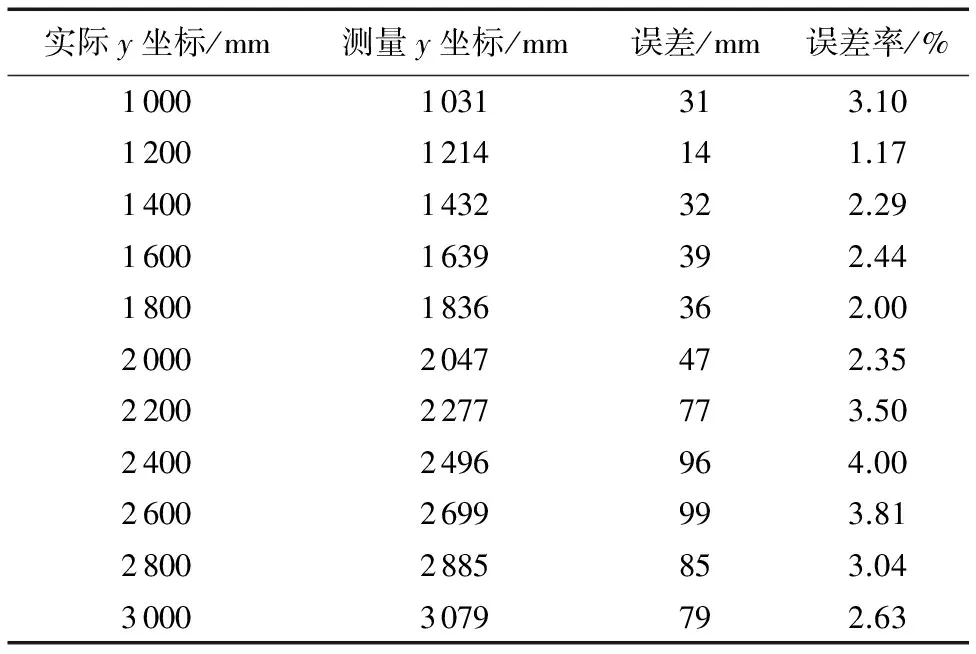

误差补偿实验分两部分:Y方向和X方向的补偿。其中,误差=测量坐标-实际坐标。首先进行沿Y轴方向的校正。摄像机安装角为18.0°,架设离地0.5 m处;灯具沿Y轴放置,拍摄在三级光强下灯具的照片。此时的数据如表1所示。

表1 校正前跑道中线灯的系统测试数据

分析产生的误差,误差数值均不大且为正值,则产生原因有:①灯具放置位置统一偏向某一侧;②灯具内部灯泡的实际发光位置统一比透镜位置远离X轴;③光线反射强烈,对系统产生影响。针对以上产生误差的原因,运用最小二乘法进行线性拟合以补偿系统误差。拟合方程为:

Ytrue=0.976 3Ymeasure+210.2

(12)

同理,对平行于X轴方向的校正。分别拍摄跑道中线灯放置在Y=1 200 mm、2 000 mm、2 800 mm且平行于X轴的一组照片。经图像处理后,对系统进行线性拟合以补偿系统误差,拟合方程为:

Xtrue=0.990 0Xmeasure-484.6

(13)

依据式(12)~(13)对系统进行误差补偿,使得嵌入式灯具定位系统更加精确。

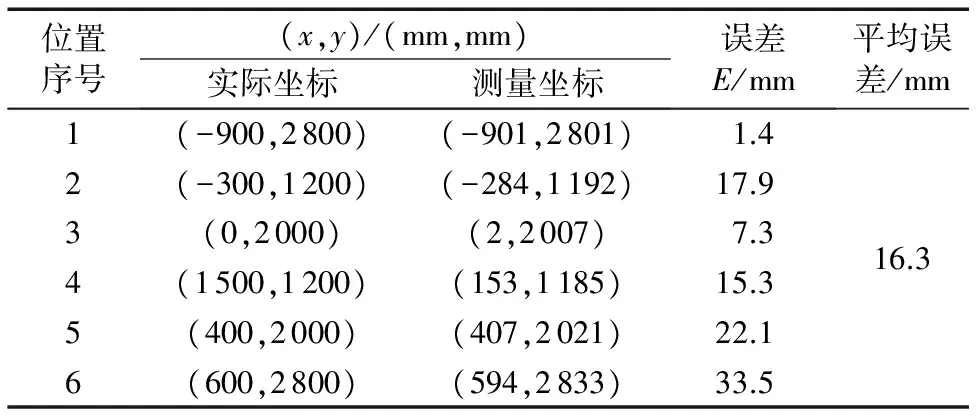

3.2 系统测试实验

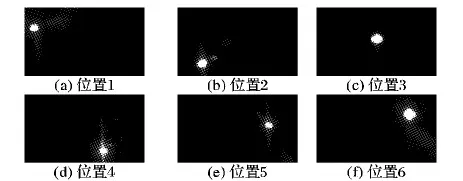

当跑道中线灯处于摄像机图像平面不同位置时的典型图片如图6所示,记录灯具相对于摄像机的实际坐标和经过图像处理后的测量坐标,并计算它们之间的误差。

图6 不同位置的跑道中线灯

定义误差为测量坐标偏离实际坐标的欧氏距离,计算公式如下:

(14)

其中:E为系统测量误差;(x,y)为灯具实际位置坐标;(x0,y0)为系统测量所得灯具位置坐标。灯具位置数据如表2所示。

表2 校正后跑道中线灯的系统测试数据

由表2中平均误差一栏的数据可知,校正后系统平均误差均为16.3 mm,小于22.4 mm,满足精度要求。在未经误差补偿之前,有表1数据可得沿Y轴方向的平均误差为65.7 mm,若考虑X方向误差则误差值会更大,校正后系统总误差大幅度减小。此外,基于视觉对灯具进行定位,对环境要求低适用性强。该系统还能够实现实时在线定位,定位速度快。

4 结语

为实现嵌入式助航灯具清洗装置中灯具定位子系统快速准确定位灯具,并使其具有良好的适用性,设计了一套基于视觉的嵌入式助航灯具定位系统。对嵌入式助航灯具进行自适应阈值处理时,所提出的Otsu改进算法能够有效克服其标准算法对灯具二值化所得前景图像区域大的缺点,使得该系统能够对嵌入式助航灯具透光镜的定位更准确。该系统基于视觉定位设计,能够解决现有定位系统定位速度慢、适用性差的问题。该系统的定位精度通过运用双目定位等方法还有一定的提升空间。

References)

[1] International Civil Aviation Organization. Convention on International civil aviation annex 14 [EB/OL]. [2017- 03- 22]. https://www.icao.int/publications/Documents/7300_9ed.pdf.

[2] 贾立山,王立文.机场助航灯光强动态检测仿真系统的实现[J].系统仿真学报,2012,24(9):1769-1770.(JIA L S, WANG L W. Realization of simulation system of dynamic detection of airport flight aid light luminous intensity [J]. Journal of System Simulation, 2012, 24(9): 1769-1770.)

[3] 史振林,郭玉彪.目视助航灯光系统的使用[J].江苏航空,2005(1):28-29.(SHI Z L, GUO Y B. Usage of the visual aeronautical ground lights system [J]. Jiangsu Aviation, 2015(1): 28-29.)

[4] 朱志胜.民用飞机着陆灯与机场助航灯光在飞机夜航中的作用[J].民用机场设计与研究,2014(2):88-91.(ZHU Z S. The function of landing light and airport approach light for civil aircraft during night flight [J]. Civil Aircraft Design & Research, 2014(2): 88-91.)

[5] 高庆吉,徐萍,胡丹丹,等.机场目视助航技术与系统[Z].天津:中国民航大学,2015:135-155.(GAO Q J, XU P, HU D D, et al. The Technology and System of Visual Navigation for Civil Aviation [Z]. Tianjin: Civil Aviation University of China, 2015: 135-155.)

[6] NIU G C, YUAN J, LIU Y X, et al. Design of cleaning system for aviation embedded aeronautical ground lights [C]// Proceedings of the 2014 IEEE International Symposium on Instrumentation & Measurement, Sensor Network and Automation. Piscataway, NJ: IEEE, 2014: 2144-2148.

[7] 刘雪扬,张文斌,尹志宏.电磁传感器的循迹特性分析[J].传感器与微系统,2014,33(7):35-37.(LIU X Y, ZHANG W B, YIN Z H. Analysis on tracking characteristics of electromagnetic sensor [J]. Transducer and Microsystem Technologies, 2014, 33(7): 35-37.)

[8] 侯启真.机场目视助航灯光在线检测系统关键技术研究[D].天津:中国民航大学,2008:15-29.(HOU Q Z. Research on the key technologies of real-time navigation light measuring system [D]. Tianjin: Civil Aviation University of China, 2008: 15-29.)

[9] 牛国臣,徐萍,冯琦.基于里程计和PTZ视觉的移动机器人自定位[J].计算机应用,2011,31(10):2822-2824.(NIU G C, XU P, FENG Q. Autonomous localization of mobile robot based on odometer and PTZ vision [J]. Journal of Computer Applications, 2011, 31(10): 2822-2824.)

[10] 田鹏辉,隋立春,杨耘.静止背景下运动目标的检测[J].测绘通报,2012(11):28-30.(TIAN P H, SUI L C, YANG Y. Motion object detection under static background [J]. Bulletin of Surveying and Mapping, 2012(11):28-30.)

[11] KWANG H P, HWAN J C, GHANG D K, et al. Vision based position control of a robot manipulator using wavelet based feature extraction [C]// Proceedings of the 2001 IEEE International Symposium on Industrial Electronics Proceedings. Piscataway, NJ: IEEE, 2001: 237-242.

[12] CHEN S H, SHI Z K. High accuracy position method based on computer vision and error analysis [J]. Proceedings of SPIE-The International Society for Optical Engineering, 2003, 5253: 330-333.

[13] WANG Z J, HUANG X D. Visual positioning of rectangular lead components based on Harris corners and Zernike moments [J]. Journal of Central South University, 2015, 22(7): 2586-2595.

[14] TANOTO A, LI H, RüCKERT U, et al. Scalable and flexible vision-based multi-robot tracking system [C]// Proceedings of the 2012 IEEE Multi-Conference on Systems and Control. Piscataway, NJ: IEEE, 2012: 19-24.

[15] 王锋,周仁魁,杨小许,等.CCD摄像机图像中心两种标定方法的应用研究[J].光子学报,2006,35(2):295-296.(WANG F, ZHOU R K, YANG X X, et al. Applications of two types of calibration method to CCD camera’s image center measurement [J]. Acta Photonica Sinica, 2006, 35(2): 295-296.)

This work is partially supported by Tianjin Research Program of Application Foundation and Advanced Technology (14JCQNJC04400).

NIUGuochen, born in 1981, Ph. D. candidate, associate professor. His research interests include robot navigation and control, intelligent control.

YUANYie, born in 1994, M. S. candidate. Her research interests include flight performance.

GURunping, born in 1971, M. S., associate professor. His research interests include flight performance.