基于卷积神经网络的偏色光下植物图像分割方法

张文彬 朱敏 张宁 董乐

摘 要:为了解决传统图像分割算法在植物工厂中偏色光植物图像上分割精确度不高、泛化性能差的问题,提出了一种基于卷积神经网络,并结合深度学习技术,对人工偏色光下植物图像进行精确分割的方法。采用该方法,最终在偏色光植物图像原始测试集上达到了91.89%的分割精确度,远超全卷积网络、聚类、阈值、区域生长等分割算法。此外,在不同色光之下的植物图片上进行测试,该方法也较上述其他分割算法有着更好的分割效果和泛化性能。实验结果表明,所提方法能够显著提高偏色光下植物图像分割的精确度,可以应用于实际的植物工厂工程项目当中。

关键词:植物工厂;深度学习;卷积神经网络;偏色光植物图像;图像分割

中图分类号:TP183 文献标志码:A

Plant image segmentation method under bias light based on convolutional neural network

ZHANG Wenbin1, ZHU Min2, ZHANG Ning1, DONG Le1*

(1.School of Computer Science and Engineering, University of Electronic Science and Technology of China, Chengdu Sichuan 611731, China;

2.Zhuhai (Hengqin) Food Safety Research Institute, Zhuhai Guangdong 519000, China)

Abstract: To solve the problems of low precision and poor generalization performance of traditional image segmentation algorithms on the plant images under bias light in plant factory, a method based on neural network and deep learning for accurately segmenting the plant images under artificial bias light in plant factory was proposed. By using this method, the segmentation accuracy on the original test set of bias light plant images is 91.89% and is far superior to that by other segmentation algorithms such as Fully Convolutional Network (FCN), clustering, threshold and region growth. In addition, this method has better segmentation effect and generalization performance than the above methods on plant images under different color lights. The experimental results show that the proposed method can significantly improve the accuracy of plant image segmentation under bias light, and can be applied to practical plant factory projects.

Key words: plant factory; deep learning; Convolutional Neural Network (CNN); bias light plant image; image segmentation

0 引言

近年来,随着科技的进步以及世界人口、环境、资源问题的日益突出,为了保证人们吃上绿色、安全、放心的蔬菜,植物工厂这种新型农业系统受到了世界各国的关注和青睐,得到了快速的发展[1-5]。

植物工厂是运用计算机技术,通过设施内高精度环境控制,采用低耗能、光质佳的人工光源,使植物生长摆脱自然条件的束缚,实现农作物全年连续生產的农业系统[6]。研究实验结果表明,植物对光的吸收主要集中在红光和蓝光波段,因此,植物工厂中应用红蓝光按照一定比例配置而成的光源,从而导致植物失去了自然状态下的色调,形成了偏色光图片。相关研究表明,对于大多数叶菜类植物,比如生菜,其植株的高度和正投影的相对面积就可以近似反映出植物自身的生长状况[7]。因此,实现偏色光下植物图像的精确分割对于现代植物工厂的发展至关重要。

在图像分割领域,人们已经进行了大量研究工作,提出了很多创新性的想法。大体上,目前的图像分割方法可以分为四大类:基于阈值、基于边缘检测、基于区域和基于神经网络的图像分割算法[8]。

基于阈值的图像分割方法是根据人们的先验知识,或者图像整体的统计信息,将图像中每一个像素按阈值划分为不同区域。近年来,在该方向提出了很多改进措施,比如:郎春博等[9]提出了一种基于改进正余弦优化算法的多阈值图像分割方法,提高了传统分割方法的运算速度和分割精度;易三莉等[10]提出了一种基于最大类间方差的最大熵图像分割方法,解决了分割时目标与背景之间边界模糊的问题。这种分割算法计算简单,容易操作,但在实际情况中,很难选取一个适当的阈值;此外,这种分割方式仅仅单独考虑每一个像素的信息,没有关心图像的空间特征,对噪声比较敏感,导致在实际情况下分割效果不佳。

基于边缘检测的图像分割算法是通过检测边界信息来进行物体的分割。在实际应用中,李文杰等[11]提出一种融合可变区域拟合(variable Region Scalable Fitting, RSF)模型及LOG(Laplacian Of Gaussian)算子的图像分割方法,可用于分割强度分布不均匀的图像;董怡[12]提出一种基于边缘信息的RGB-D图像分割算法,提高了抗噪能力。该类方法可迅速定位到边缘,但是对噪声非常敏感,而且容易产生不连续的边界及双边界。

基于区域的图像分割算法是将图像中具有相似特征的像素点组合在一起完成分割。洪向共等[13]提出一种根据改进的区域生长算法以及基于灰度共生矩阵的纹理特征进行红外光伏面板图像分割的方法,解决了红外图像对比度低、信噪比低的问题;胡学刚等[14]提出一种基于区域合并的模糊C均值(Fuzzy C-Means, FCM)改进算法,综合考虑区域间的各种关系得到最终的分割结果;蒋秋霖等[15]提出一种基于区域生长的算法,结合维纳滤波进行脑肿瘤图像的分割。该类方法主要利用图像中的局部空间信息,可以克服其他方法存在的图像分割空间不连续的缺点,但是可能导致图像过度分割。

基于神经网络的图像分割算法是利用标注图像作为训练样本,训练神经网络使其具备图像分割功能,之后将待分割图像输入网络就可得到分割结果。万园洁等[16]提出运用改进的全卷积网络(Fully Convolutional Network, FCN)[17]来进行小麦图像的分割;贝琛圆等[18]提出运用U-Net网络来进行腺体细胞图像分割;王琢等[19]提出基于深度学习的叶片图像分割算法,实现正常光照下植物图像分割。这类方法所依赖的先验知识较少,根据给定的数据集就可以自动学习,泛化性能强、整体精确度高,是目前图像分割领域的主要研究方向。

但是,包括上面所述的所有方法在内,目前在植物图像分割方面已有的研究工作仅针对正常光下的图像进行分割,而当照射光不是自然光时,植物自身的颜色会发生巨大变化,使得一般的分割算法精确度降低,无法满足植物工厂中对于偏色光下植物图像分割的需求。因此,为了解决这个问题,本文提出一种基于改进的卷积神经网络——改进U-Net网络进行人工偏色光下植物图像分割的方法,采用自制的符合植物工厂实际情况的偏色光下的植物图像作为数据集,在tensorflow框架下对模型进行了训练优化。为了验证本文方法在偏色光下植物图像分割问题上的有效性,将其和传统的图像分割算法(阈值法、K-means聚类、区域生长法)以及全卷积网络(FCN)进行了对比分析,结果表明本文方法在偏色光植物图像分割问题上具有明显的优势(原始测试集精度达到91.89%)。

整体上讲,本文的创新及贡献主要包括以下4个方面:

1)将改进的先进图像分割算法,融合实际工程环境的限制条件,首次应用到偏色光下植物图像分割问题这一全新领域之中。

2)将人工智能技术引入实际农业生产当中,本文的探索和研究在现代农业智能化进程中具有重要的启发和引导意义。

3)本文成功运用人工智能技术解决了现实工程环境中的实际问题,对实现人工智能技术落地具有积极的推动作用。

4)本文研究工作为进一步结合物联网知识进行植物工厂中植物生长环境的自动调控,提高作物的产量,改善作物的品质奠定了坚实的基础,真正运用技术改善人们的生活。

1 图像分割网络

近年来,随着以神经网络为代表的深度学习技术的兴起,人们也将其应用到图像分割领域,出现了很多用于图像语义分割的网络架构。其中,最具代表性的架构当属FCN[17]和U-Net网络[20]。

FCN是由Long等[17]在2015年提出。与传统的卷积神经网络(Convolutional Neural Network, CNN)在卷积层之后使用全连接层得到固定长度的特征向量不同,FCN将传统CNN后面的全连接层替换成了卷积层,而在最后一个卷积层后,采用反卷积层对得到的特征图层(feature map)进行上采样,从而对每一个像素进行分类预测,保留了原始输入图像中的空间信息,实现了图像语义级别的分割。

U-Net网络是Ronneberger等[20]在2015年提出的一个用于医学图像分割的卷积神经网络。它是典型的编码解码网络结构,编码部分由卷积和池化层交替组成,采用ReLU(Rectified Linear Unit)激活函数,主要进行图像中特征的提取。解码部分主要是将得到的特征图层(feature map)上采样到接近原始图像大小,实现语义分割。这两部分相互对称,并且在同一层级之间通过复制裁剪操作实现在不同尺度上的结合,极大地还原了图像中的细节信息。

2 偏色光对植物图像分割的影响

在人工偏色光下,由于光照亮度及色彩的不同,植物自身的色彩以及与背景之间的对比度等均会发生很大变化,从而对最终的分割效果产生影响。为了深入探究影响偏色光下植物图像分割性能的主要因素,本文选用传统的K-means聚类法作为统一的图像分割方法,运用控制变量的思想,探究光照颜色、光照亮度、图像对比度三者对最终分割结果的影响。

2.1 K-means聚类算法

K-means聚类算法是一个经典的分类算法,其核心思想是根据给定的相似性测度,不断迭代更新,直到达到预先设定的终止条件,比如聚类中心变化小于阈值或达到最大的迭代轮数。在本文中选用像素间灰度值差的绝对值作为相似性测度,將图像中的像素分为两类,从而实现图像整体的分割。算法的具体步骤如下:

1)输入一张图像,初始聚类中心灰度值设为0和255,分别代表植物和背景两类。

2)依次遍历图像中每一个像素,计算每个像素和聚类中心像素灰度值的差的绝对值,并将该像素分到灰度值差绝对值较小的那一类中。

3)根据新的分类结果,取每一类所有像素灰度值的均值作为新的聚类中心。

4)若聚类中心变化小于给定的阈值或者达到最大的迭代轮数,算法终止,输出聚类结果;否则返回2)继续执行。

为了更好地展示在聚类过程中图像分割结果的变化情况,本文选用偏色光下的植物图片进行聚类实验,其中某一张图片在不同迭代轮数下的分割结果如图1所示。从图中可以看出,随着迭代轮数的增加,分割结果图像中的噪声点在逐渐减少,同时聚类结果的精确度在不断上升。

分割结果的精确度计算公式如式(1)所示:

accu=(N00+N11)/N(1)

其中:N 代表一张图像中的像素总数量;N00 代表实际为第零类(物体)并被预测为第零类的像素总数;N11 代表实际为第一类(背景)并被预测为第一类的像素总数。

2.2 光照颜色对植物图像分割性能的影响

在探究光照颜色对植物图像分割性能的影响时,固定光的亮度及图像对比度不变,改变光的颜色,按照2.1节中所述的K-means聚类算法进行图像分割实验。在测试时,本文选用自然光照下的植物图片作为对比,按照式(1)分别测试在蓝光、绿光、红光、紫光下的分割精确度。最终的实验结果如表1所示。

表格(有表名)表1 不同光照颜色下精确度对比

Tab. 1 Comparison of accuracy under different light colors

光照颜色测试精确度光照颜色测试精确度自然光0.955561绿光0.793622紫光0.923135红光0.326329蓝光0.918005

从表1可以看出,在某些颜色光照之下,如紫光和蓝光,分割精确度只略低于自然光照下的分割结果;而在另一些颜色的光照之下,如红光和绿光,分割的精确度会大幅度降低。不同颜色的光对分割性能的影响作用具有很大的不确定性,从而限制了普通图像分割方法(如K-means聚类等)在偏色光植物图像上的分割性能。

2.3 光照亮度对植物图像分割性能的影响

与探究光照颜色对植物图像分割性能的影响类似,固定光的颜色以及植物图片的对比度,利用2.1节所述的算法及式(1),分别测试在不同亮度的光照下植物图像最终的分割精确度。实验结果如表2所示。

表格(有表名)表2 不同光照亮度下精确度对比

Tab. 2 Comparison of accuracy under different light brightnesses

光照亮度测试精确度光照亮度测试精确度正常亮度(100%)0.91800550%亮度0.52520180%亮度0.918303120%亮度0.918135150%亮度0.901565

从表2可以看出,光照亮度对植物图像的分割性能有一定的影响,但是相对于光照颜色的不确定影响,光照亮度的影响具有一定的规律性。整体上看,亮度越低,分割的性能就越差,当亮度增大到一定程度时,分割性能基本维持不变。因此,在实验时,应该保证植物处于一个正常或者偏亮的环境中,避免光线过暗。

2.4 植物图像对比度对分割性能的影响

同样,固定光照颜色以及光的亮度,根据2.1节中所述的算法,探究植物图像对比度对于分割结果的影响。在测试时,选用五组对比度逐渐递增的图像进行实验,根据式(1)得到最终的分割结果精确度如表3所示。

表格(有表名)表3 不同对比度下精确度对比

Tab. 3 Comparison of accuracy under different contrasts

植物图像对比度测试精确度植物图像对比度测试精确度正常对比度0.918005对比度-50.037918对比度-20.039234对比度+20.920524对比度+50.914640

从表3可以看出,植物图像的对比度对分割的性能有很大的影响。整体上看,对比度降低后,精确度急剧下降,分割结果基本已经失去了意义;当对比度增大时,分割结果的精确度会略有增加,说明对比度较大时分割效果较好,这和人们的实际经验是一致的。因此,在实验时就需要保证植物图像有一定的对比度,否则可能就会产生无意义的结果。

3 偏色光下植物图像分割网络搭建及训练

3.1 偏色光下植物图像分割网络结构

在本文的研究中,考虑到数据集的实际情况,仔细进行了分析对比后,决定选择基于改进的U-Net网络进行偏色光下植物图像的分割。改进的U-Net网络结构如图2所示。

相较于原始的U-Net网络,本文进行以下几点改进:1)改进了卷积的计算方式。在原始网络中,采用无填充方式,每进行一次卷积操作,图像的尺寸都会减小,从而导致最终输出的结果和输入图像尺寸不一致;在本文中,选择采用零填充的卷积计算方式,从而保证了输入输出尺寸的一致性,而且也方便进行网络搭建。2)去掉了一部分drop out层。为了保留更多的细节信息,在上采样过程中去除了drop out层,从而保证提取到的特征全部用于上采样,以此让更多的深层次特征来参与恢复最终的分割图像。3)尝试加入注意力(Attention)机制来提取更多的细节信息,同时忽略掉图像中的噪声,但实验效果并不突出(将在4.3.2节进行详细解释)。实验结果表明,在改进的U-Net网络结构下,取得了较好的分割效果。

3.2 网络训练过程

3.2.1 数据预处理

在训练之前,为了进一步得到更多的图片并且避免过拟合的问题,本文进行了数据增强处理,得到原始数据集,其中部分图像如图3所示。

本文对图片进行了旋转、镜像对称、裁剪三种不同形式的增强。具体分别进行了90°、180°、270°旋转和关于X轴与Y轴的对称操作,旋转和对称可以帮助网络学习到旋转不变性的特性,更好地提升网络的泛化能力。在裁剪时,选用了三个不同的裁剪尺度,以原始图像中心点为中心,选择一个正方形(边长为原始图像的1/2)和兩个在水平、垂直方向上的长方形(长为原始图像的1/2、宽为1/3)裁剪框,提取出原始图片中的一部分像素,之后再经过插值,变换到原来图像的尺度。使用这种裁剪的图片可以使网络学习到更多关于图片的细节信息,使其关注到一些比较重要的因素而忽略掉干扰因素。经过数据增强处理,得到的原始数据集扩大了9倍,这对于之后网络的优化训练具有重要意义。

3.2.2 参数初始化

参数初始化操作对于神经网络来说至关重要,初始化不当可能导致某部分神经元在训练过程中一直无法被激活,而另一部分神经元一直处于激活状态,从而导致网络出现故障。大量实验表明,一般情况下,网络中初始化的权重值应该保证使每一个特征图层(feature map)都近似具有单位方差,而对于采用ReLU激活函数的卷积神经网络,只需要随机地从一个标准差为2/N 的高斯分布中采样得到权重初始化值即可, 其中N代表某一个神经元节点的输入节点个数,比如一个3×3×64 的卷积核,N就等于3×3×64=576。同样地,也从标准正态分布中随机采样得到偏置的初始化值。

3.2.3 损失函数

在训练过程中,本文选择的代价函数是特征图层中每一个像素在深度方向上经过softmax函数之后,再和真实的标签进行交叉熵计算得到的值。其中,softmax函数的定义如式(2)所示:

softmaxk(x)=exp(ak(x))∑Kk′=1exp(ak′(x)) (2)

其中:ak(x)表示在特征图层上位置x处通道k上的激活值,其中,x∈Ω,Ω∈Z2,K是总共含有的类别个数。式(2)计算得到的结果softmaxk(x)表示在位置x处k通道上进行归一化后的值,也就是该位置x被划分为第k类的概率。

交叉熵函数的定义如式(3)所示:

Ep′(p)=-∑ipi′ ln pi(3)

其中:p′代表真实标签的概率分布,p代表经过上面softmax函数计算得到的预测概率分布。可以发现,预测结果的精确度越高,得到的交叉熵值就越低,该值很好地衡量了两个概率分布之间的差异性。训练的目标就是要通过学习调整权重和偏置的取值,从而最小化该值。

3.2.4 网络训练软硬件环境

硬件环境 处理器为Intel Xeon CPU E5-2640 v3 2.60GHz,内存为128GB;GPU为Tesla K40c。

软件环境 操作系统为ubuntu 16.04,64位;编程语言为python3.6;深度学习库为tensorflow1.12.0。

3.2.5 网络超参数调节

本文选择基于python语言在tensorflow框架下进行网络训练,使用了Adam优化器来进行反向传播操作最小化交叉熵损失函数。Adam优化器的参数采用默认设置的值。

在选取学习率时,从10-6到10-2以10倍为单位尝试了多个学习率的取值,最终发现在学习率为10-4时,网络损失函数的收敛曲线比较好,既不会过早停止变化,也不会一直呈下降趋势达不到收敛的效果,因此最终将网络的学习率设置为10-4。

在选取其他3个超参数的值时,本文采用网格搜索法实现。首先设定batch_size的取值集合为{1,2,5}(因为受到内存空间资源的限制,当batch_size大于5后会出现内存溢出的情况);设定dropout的取值集合为{0.6,0.7,0.8,0.9}(为了和tensorflow中的含义一致,此处的数值代表保留的比例);设定正则化系数的取值集合为{0.001,0.004,0.007,0.01}。之后通过网格搜索法,测试在每一组超参数配置下的网络在验证集上的精确度,最后选择精确度最高的网络模型所对应的那组超参数,作为网络最终的超参数设置。最终,当batch_size为2,dropout值为0.8,正则化系数为0.004时,网络在验证集上具有最佳的效果。在最佳超参数配置下,网络训练过程中训练集和验证集上的损失函数值变化曲线如图4所示。 从图4中可以看出,随着训练轮数的增加,损失函数值在不斷减小,最终在35轮左右趋于平稳,即达到收敛。

4 实验与结果分析

4.1 实验所用数据集

本实验所使用的数据集是由搭建的模拟植物工厂偏色光环境系统拍摄得到的照片,并通过labelme软件自制而成的数据集。

在实验过程中,每张图片上只有一株植物,在得到拍摄的照片之后,先对其进行尺度变换,得到固定大小的512×512的植物图片。之后,利用labelme软件进行图像标签的标注,得到带有标签的偏色光下植物图片数据集。labelme软件操作界面如图5所示,最初带标签的偏色光下植物图像如图6所示。

4.2 卷积层输出结果展示

为了体现卷积操作在特征提取过程中所发挥的作用,本文选用一张偏色光下植物图片,输入已经训练好的改进的U-Net网络中,获取其通过每一组卷积操作后的特征图层。对应于图2中的网络结构,在下采样过程中,一共有五组卷积操作,本文提取每一组卷积操作后的结果,最终得到五组不同层级的部分特征图层示例。如图7所示,其中(a)到(e)分别对应图2中每一组卷积操作后的结果。

从图7中可以看出,不同层级的卷积操作结果具有一定的差异性。在低层级处,通过卷积操作得到的特征图层可以通过直观感觉来辨别物体的大致轮廓和位置,而随着层级加深,得到的特征图层越来越抽象,已经无法通过直观感觉进行辨别,而这些大量的抽象特征图层通过进一步的解码网络处理之后,即可得到最终的分割图像。

4.3 对比分析

4.3.1 数据增强

在对改进U-Net网络进行调参优化后,本文得到了一个最佳的偏色光下植物图像分割模型,使用该模型在原始测试集上进行测试,根据式(1)计算得到的精确度达到了0.918937。为了更进一步说明模型的有效性,同时降低随机误差的影响,体现出统计意义,本文在原始数据集的基础之上,通过一些数据增强操作(增加亮度、对比度),增大了数据集规模,并在大量的样本之上重新进行了测试,增大的数据集中部分图片如图8所示。实验结果显示,相对于加入注意力机制后的图像分割网络,本文模型在样本数量增大时也有着相对较高的精确度,对比结果见表4。而在增大的数据集上,传统分割算法精确度有所升高,本文的模型精确度略低于传统分割算法,这主要是因为增大了图像亮度和对比度后,植物与背景之间的差异更加明显,传统的图像分割算法就具有比较大的优势,而在实际环境下的图片中,本文模型优于传统分割算法,对比结果见表5。此外, 本文模型在增大的数据集上与不同结构的FCN分割结果相比,也有很大程度的领先优势,对比结果见表6。本文从不同方面将该模型与其他的图像分割方法结果作一个比较。

4.3.2 U-Net在不同改进方式下的结果对比

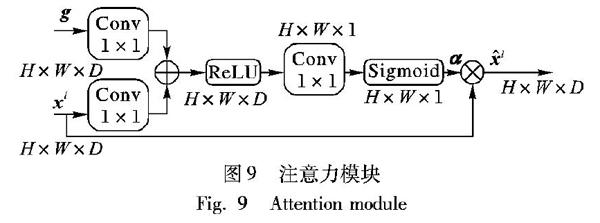

在本文提出最终改进的U-Net网络结构之前,还进行了很多其他改进方法的尝试,其中比较重要的一个改进尝试是在网络中加入注意力机制模块,期望通过该模块可以使网络学习到更多的主体信息而忽略掉图像中的噪声。该注意力模块如图9所示。

图9中:g代表在上采样过程中,逆卷积操作输出的结果;xl代表编码阶段存储的用于拼接(skip connection)的特征图层;两者通过1×1的卷积进行线性变换后相加,经过ReLU激活函数之后,再通过1×1的卷积操作将其变换为深度为1的特征图层,在该图层上进行sigmoid运算,得到一个非负的激活系数矩阵α。此时将α与xl对应元素相乘,得到l,这就是加入注意力机制之后得到的用于拼接的特征图层。

但是在添加注意力机制后,在偏色光植物图像数据集上分割效果并不好,精确度有所下降,而且由于加入注意力模块而引入的额外运算导致分割时间也变长。根据式(1)计算得到相应的测试集精度及运行时间如表4所示,在原始测试集上的分割效果对比图如图10所示。因此,最终舍弃了这一改进,而选用了之前所述的网络结构。

4.3.3 与传统图像分割方法结果对比

为了验证改进U-Net网絡在偏色光下植物图像分割中的有效性,将其得到的结果与传统的图像分割方法结果进行了对比。其中包括基于阈值的图像分割、基于区域的图像分割、基于聚类的图像分割三类典型的图像分割方法。

根据式(1)计算得到在不同测试集上的分割精确度及运行时间对比如表5所示,在原始测试集上的分割效果图如图11所示。从表5中可以发现,改进U-Net网络在精确度上相较于传统的方法提高了大约6个百分点,运行时间只比阈值法长,而比其余两个传统方法更短。

由此可见,改进U-Net网络在偏色光下植物图像分割方面相较于传统的图像分割方法具有更好的适应性和更高的精确度,同时也具有更高的效率。

4.3.4 与FCN分割结果对比

近年来,在图像分割领域出现了一批基于神经网络的图像分割算法,其中以FCN最具代表性。为了验证本文U-Net网络模型在偏色光下植物图像分割问题上的优势,将得到的结果和FCN得到的结果也进行了对比,根据式(1)计算得到在不同测试集上的精确度如表6所示,在原始测试集上的分割结果如图12所示。

从表6中可以发现,虽然本文模型比FCN的运行时间要长,但是在精确度方面有着大幅度的提升。从图12也可以看出: FCN得到的分割图像噪声很多,无法直接得到精确的分割结果,还需要作进一步的后处理; 而本文模型得到的结果无需进行任何后处理就可以达到较好的分割效果。

4.3.5 与已有偏色光下植物图像分割方法对比

在本文之前,杨思思等[21]提出了一种基于机器视觉的人工光植物图像分割方法,采用传统的图像处理技术,结合植物本身对于偏色光的物理反射特性,从物理学的角度对偏色光下的植物图像进行建模分析,去除了背景,将植物从图片中分割开来。但是,该方法存在着诸多不足之处:首先,该方法的泛化性能不强。由于不同植物甚至同一种植物不同时期它们对于光的反射特性都有很大的差异,若利用这种物理建模的方式进行植物图像提取,就必须实时地对植物进行光的各项反射、吸收指标测定,否则就无法保证结果的准确性。其次,该方法对植物图像质量要求较高。在原文的实验中,作者使用的植物图像背景比较单一,与植物本身的对比非常明显。若图像背景复杂多变,则无法表现出很好的分割效果。再者,该方法分割得到的图片只是将背景与植物剥离,而并没有将花盆与植物分割开,结果不够理想。

而采用本文方法就非常好地解决了以上存在的问题。利用神经网络的自我学习能力,本文提出的分割方法泛化性能得到了很大程度的提高;而且,对于复杂背景下的植物图片,也有较好的分割效果;更令人惊喜的是,本文方法也可以将植物与花盆部分剥离。测试的效果图如图13所示。

4.3.6 不同色光之下分割结果对比

在本文网络架构的训练过程中,使用的数据集都是在蓝色LED灯下拍摄得到的植物图片。在实现了蓝色光下植物图片的分割任务之后,为了进一步测定该网络在不同色光照射下的植物图像上的分割性能,本文又使用搭建的实验平台,在紫色光、红色光、绿色光下分别拍摄了一些植物图片并使用训练好的模型进行了测试,同时也使用同样的图片在传统的图像分割方法及FCN上进行了测试,实验分割效果如图14所示。

从图14中发现,传统的图像分割算法在一些噪声点及植物的花盆部分无法进行准确辨别,FCN在不同色光照射之下的植物图像上直接失去了分割的能力,产生了无意义的结果。而本文模型在不同色光照射之下的植物图片上也有非常好的分割效果,这也进一步证明了本文方法具有很好的泛化性能。

5 结语

针对植物工厂中人工偏色光下植物图像分割的问题,本文构建了一个基于卷积神经网络的偏色光下植物图像分割网络——改进U-Net网络,实现了偏色光下植物图像的精确分割,解决了以往偏色光植物图像分割方法泛化性能差、对图片质量要求高、分割结果不理想的问题。本文方法可以实现对植物叶面积参数的实时、无损、非接触测量,为植物生长状况的实时监测以及进一步运用计算机和物联网技术对植物的生长环境因素进行实时调控提供了理论依据,同时也为现代植物工厂的智能化发展提供了保障,具有广阔的发展前景和极大的现实意义。

参考文献 (References)

[1]姚凤珍.植物工厂发展现状及趋势概述[J].中国照明电器,2016(12):16-18.(YAO F Z. Development situation and trend of the plant factory[J]. China Light and Lighting, 2016(12): 16-18.)

[2]刘文科.植物工厂的发展现状与展望[J].中国照明电器,2016(12):5-9.(LIU W K. Review on current status and development prospects of plant factory [J]. China Light and Lighting, 2016(12): 5-9.)

[3]刘文科.植物工厂发展的机遇与挑战[J].照明工程学报,2018,29(4):Ⅱ.(LIU W K. Opportunities and challenges of plant factory development [J]. China Illuminating Engineering Journal, 2018, 29(4): Ⅱ.)

[4]王伟丽.浅析国内外植物工厂发展现状[J].木工机床,2018(4):31-34.(WANG W L. A brief analysis of the current situation of plant factory development at home and abroad [J]. Woodworking Machinery, 2018(4): 31-34.)

[5]刘文科,刘义飞.人工光植物工厂技术装备与产业发展的战略思考[J].中国农业科技导报,2018,20(9):32-39.(LIU W K, LIU Y F. Developmental strategies for technology and equipment and industry of plant factory with artificial lighting [J]. Journal of Agricultural Science and Technology, 2008, 20(9): 32-39.)

[6]郑延海,裴克全.什么是“植物工厂”[J].生命世界,2017(4):4-7.(ZHENG Y H, PEI K Q. What is “plant factory” [J]. Life World, 2017(4): 4-7.)

[7]李晓斌,王玉顺,付丽红.用K-means图像法和主成分分析法監测生菜生长势[J].农业工程学报,2016,32(12):179-186.(LI X B, WANG Y S, FU L H. Monitoring lettuce growth potential using K-means image method and principal component analysis method [J]. Transactions of the Chinese Society of Agricultural Engineering, 2016, 32(12): 179-186.)

[8]赵诗宇.图像分割算法的分类与研究[J].科技风,2019(5):58-58.(ZHAO S Y. Classification and research of image segmentation algorithms [J]. Technology Trend, 2019(5): 58-58.)

[9]郎春博,贾鹤鸣,邢致恺,等.基于改进正余弦优化算法的多阈值图像分割[J/OL].计算机应用研究[2019-03-04].http://www.arocmag.com/article/02-2020-04-058.html.(LANG C B, JIA H M, XING Z K, et al. Multi-threshold image segmentation based on improved sine-cosine optimization algorithm [J/OL]. Application Research of Computers [2019-03-04]. http://www.arocmag.com/article/02-2020-04-058.html.)

[10]易三莉,张桂芳,贺建峰,等.基于最大类间方差的最大熵图像分割[J].计算机工程与科学,2018,40(10):1874-1881.(YI S L, ZHANG G F, HE J F, et al. Maximum entropy image segmentation based on the variance between the largest classes [J]. Computer Engineering and Science, 2018, 40(10): 1874-1881.)

[11]李文杰,夏海英,刘超.融合RSF模型及边缘检测LOG算子的图像分割方法的研究[J].南京邮电大学学报(自然科学版),2018,38(2):98-102.(LI W J, XIA H Y, LIU C. Image segmentation method based on RSF model and edge detection LOG operator [J]. Journal of Nanjing University of Posts and Telecommunications (Natural Science Edition), 2018, 38(2): 98-102.)

[12]董怡.基于边缘信息的RGB-D图像分割算法研究[D].南京:南京邮电大学,2018:19-34.(DONG Y. Research on RGB-D image segmentation algorithm based on edge information [D]. Nanjing: Nanjing University of Posts and Telecommunications, 2018: 19-34.)

[13]洪向共,周世芬.基于灰度共生矩阵和区域生长算法的红外光伏面板图像分割[J].科学技术与工程,2018,18(34):92-97.(HONG X G, ZHOU S F. Infrared photoelectric panels image segmentation based on gray level co-occurrence matrix and region growing algorithm [J]. Science Technology and Engineering, 2018, 18(34): 92-97.)

[14]胡学刚,段瑶,严思奇.基于区域合并的FCM图像分割改进算法[J].小型微型计算机系统,2018,39(9):2077-2080.(HU X G, DUAN Y, YAN S Q. Improved FCM image segmentation algorithm based on region merging [J]. Journal of Chinese Computer Systems, 2018, 39(9): 2077-2080.)

[15]蒋秋霖,王昕.基于区域生长算法的脑肿瘤图像分割[J].长春工业大学学报,2018,39(5):490-493.(JIANG Q L, WANG X. Brain tumor image segmentation based on region growing algorithm [J]. Journal of Changchun University of Technology, 2008, 39(5): 490-493.)

[16]万园洁,卿粼波,何小海,等.基于改进全卷积网络的小麦图像分割[J].计算机系统应用,2018,27(3):221-227.(WAN Y J, QING L B, HE X H, et al. Wheat image segmentation based on improved full convolution network [J]. Computer Systems and Applications, 2018, 27(3): 221-227.)

[17]LONG J, SHELHAMER E, DARRELL T. Fully convolutional networks for semantic segmentation [C]// Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2015: 3431-3440.

[18]贝琛圆,于海滨,潘勉,等.基于改进U-Net网络的腺体细胞图像分割算法[J].電子科技,2019(11):1-7.(BE C Y, YU H B, PAN M, et al. Gland cell image segmentation algorithm based on improved U-Net network [J]. Electronic Science and Technology, 2019(11): 1-7.)

[19]王琢,汪雅婷,宋文龙,等.基于深度学习的叶片图像分割算法[J].森林工程,2019,35(1):42-46.(WANG Z, WANG Y T, SONG W L, et al. Leaf image segmentation algorithm based on deep learning [J]. Forest Engineering, 2019, 35(1): 42-46.)

[20]RONNEBERGER O, FISCHER P, BROX T. U-Net: convolutional networks for biomedical image segmentation [C]// Proceedings of the 2015 International Conference on Medical Image Computing and Computer-Assisted Intervention, LNCS 9351. Cham: Springer, 2015: 234-241.

[21]杨思思,周泓,虞侠挺.基于机器视觉的人工光植物工厂植物生长状况监测系统[J].传感器与微系统,2014,33(12):88-90.(YANG S S, ZHOU H, YU J T. Plant growth monitoring system for artificial light plant factory based on machine vision [J]. Transducer and Microsystem Technologies, 2014, 33(12): 88-90.)

This work is partially supported by the National Natural Science Foundation of China (61772114), the Leading Talent Introduction Program of Guangdong Province (2016LJ06S419).

ZHANG Wenbin, born in 1997, M. S. candidate. His research interests include computer vision, image processing.

ZHU Min, born in 1963, Ph. D., engineer. His research interests include food safety, intelligent agriculture.

ZHANG Ning, born in 1975, Ph. D., lecturer. His research interests include computer vision, system design.

DONG Le, born in 1980, Ph. D., professor. Her research interests include video understanding, machine intelligence, pattern recognition.

收稿日期:2019-04-16;修回日期:2019-08-07;录用日期:2019-08-12。

基金项目:国家自然科学基金资助项目(61772114);广东省引进领军人才项目(2016LJ06S419)。

作者简介:张文彬(1997—),男,河南三门峡人,硕士研究生,主要研究方向:计算机视觉、图像处理; 朱敏(1963—),男,上海人,工程师,博士,主要研究方向:食品安全、智能农业; 张宁(1975—),男,江苏南京人,讲师,博士,主要研究方向:计算机视觉、系统设计;董乐(1980—),女,陕西西安人,教授,博士,主要研究方向:视频理解、机器智能、模式识别。

文章编号:1001-9081(2019)12-3665-08DOI:10.11772/j.issn.1001-9081.2019040637