基于时序空间关系模型的交通标志识别

翟孝威 宋云志

摘 要: 道路交通标志识别是汽车无人驾驶技术的重要组成部分。通过调整卷积层和池化层数据输入方式,改进具有融合特征的多尺度卷积神经网络,提高识别准确率。依据视频图像的空间连续关系构建时序空间关系模型(Temporal-Spatial Model, TSM),结合多尺度卷积神经网络减少识别数据量,提高处理的效率,实现视频图像交通标志的高效率和高准确率识别。实验结果表明,所提出的算法识别率保持90.36%,在原始图像上运行平均帧率为32fps,有效地改进了基于单帧的交通标志图像识别效率低的问题。

关键词: 交通标志识别; 汽车无人驾驶; 多尺度卷积神经网络; 时序空间关系模型

中图分类号:TP391 文献标志码:A 文章编号:1006-8228(2019)06-63-04

Abstract: Traffic sign recognition is an important part of driverless car technology. In this paper, by adjusting the data input methods of convolutional layer and pooling layer, the multi-scale convolutional neural network with fusion features is improved to make better recognition accuracy, and the Temporal-Spatial model is constructed according to the spatial relationship of video images. Combining with multi-scale convolutional neural network to reduce the amount of identification data, improve the efficiency of processing, the model achieves the recognition of traffic sign with high efficiency and high accuracy. The experimental results show that the proposed algorithm's recognition rate is 96.81%, and the average frame rate is 32fps on the original image, which effectively improves the low-efficiency of single-frame traffic sign recognition.

Key words: traffic sign recognition; driverless car technology; the multi-scale convolutional neural network; Temporal-Spatial model

0 引言

道路交通标志牌是应用图像符号和文字符号显示当前道路信息的交通安全设施,严格按照国家相关法律标准设计。交通标志背景和图形文字的颜色反差较大为识别带来便利,但由于受到多种因素的影响,如标志牌颜色变浅、光照太强或不足、损坏形变、车辆抖动和视角的变化等因素,都会对交通标志的识别带来困难,因此,我们的目标就是设计一个稳健和高效的交通标志识别算法。

文献[1-2]总结和分析了目前交通标志识别技术发展概况。近几年道路交通标志的识别技术发展迅速,主要分为两大类:基于图像处理与机器学习相结合的方法[3]以及深度学习方法[4-5]。Claw Bahlmann[6]提出一种基于颜色、形状和运动信息的交通标志检测、追踪和识别系统框架。首先,使用AdaBoost训练算法获得一组Haar小波特征,然后,使用贝叶斯生成模型分类。该系统具有接近实时检测和较高准确分类的性能,但基于Haar小波特征检测算法易受光照影响。文献[7]通过基于颜色的分割生成感兴趣区域,再使用特定几何形状匹配该区域,最后采用基于假设生成和验证的三维重建验证交通标志区域,该方法对遮挡和变形效果较好,但无法保证检测的准确性和时效性。

近几年深度学习技术在图像识别方面取得快速发展,甚至优于人类的表现。Yok-Yen Nguwi和Abbas Z. Kouzani[8]提出一种基于神经网络的交通标志自动识别系统。该系统分为交通标志的检测和识别两个模块。检测阶段将图像转换到HIS颜色空间,根据颜色特征和几何形状特征分割图像,再使用MLP神经网络过滤分割图像得到较为精确的感兴趣区域。识别模块使用的一对一架构分别训练每一类别的交通标志,该识别结构扩展性强,识别率较高。文献[5]在交通标志识别阶段,训练多任务卷积神经网络进行特征提取和分类,网络识别准确率高,但实时性较差。

与传统卷积神经网络[9]识别方式不同,本文充分利用已识别交通标志图像,构建已识别目标集(Already Recognized Objects Set ,AROS),提出一种基于TSM模型的交通标志识别算法。算法包括三部分。①基于统计学原理的图像映射压缩算法用于提取待识别区域,提高检测速度。②基于时空关系模型的交通標志识别算法用于提高识别速度,解决识别序列图像问题上单帧耗时长的问题。③改进多尺度卷积神经网络,使分类更加精准。

1 交通标志识别流程框架

本文通过图像映射压缩算法得到二值压缩图像,并利用几何形态学方法快速提取待识别区域,提取13200样本数据的卷积特征,训练SoftMax分类器。并依据分类器识别结果构建已识别目标集,将多尺度卷积神经网络模型和基于时序关系构建的TSM模型有效结合,完成交通标志识别工作。处理流程如图1所示。

2 交通标志检测

交通标志牌底色多以红、蓝和绿色用于警告、指示和指路信息。颜色和形状是交通标志最显著的特征,我们使用这两种特征区分背景、快速定位交通标志,得到待识别交通标志区域。

2.1 图像映射压缩算法

为了减少计算时间、提高检测交通标志的效率,首先将图像中满足阈值范围的像素点重绘在对应二值图像中,使用基于统计学原理的图像映射压缩算法将二值图像按比例压缩,减少目标筛选阶段数据量。算法流程如下:

⑴ 将原始RGB图像转化为同尺寸的HSV图像。

⑵ 遍历图像所有像素点。将H、S、V三分量满足颜色阈值范围的像素点在二值图像B中设置为255,反之置为0。

⑶ 映射压缩。如下图所示,将二值图像B划分为M×N个子块,每个子块大小为m×m。设输出二值图像为S,其尺寸为M×N,将图像B中每一个子块映射压缩成S中对应的一个像素点。

图像映射压缩过程如图2所示,统计二值图像B中每个子块白色像素点占子块总像素点的比率。当比率大于阈值时在输出图像对应像素点置为255,反之置0。

分割并压缩图像之后得到包含目标候选区域的压缩二值图像。如图3所示,左侧为原始图像(768×320),右侧上方和下方分别是根据红色和蓝色分割后的映射压缩二值图像(96×40)。

2.2 交通标志候选区域提取

通常交通标志区域具有特定的几何形态,因此可以依据几何形态特征去噪。将图像中区域尺寸过小或者过大、形状异常的区域过滤。按照公式⑴提取目标区域。

其中Si表示第i个连通区域的最小外接矩形的面积,Ri为该外接矩形的长宽比率。Smin和Smax为图像中交通标志最小外接矩形的面积最小值和最大值,Rmin和Rmax为交通标志最小外接矩形的长宽比率的最小值和最大值。当这两个变量同时满足条件时,即为提取的交通标志候选区域,否则过滤掉。

3 基于时序空间关系模型的交通标志识别

通过统计交通标志视频序列图像,可以发现相邻帧中的交通标志具有位置、形态与尺寸变化较小,相似度高,关联性强[10]的特点。基于单帧的目标识别,可以保持每帧中目标区域高识别率,但如果连续识别序列图像中的目标,识别效率较低。本文将时空关系模型和分类网络有效结合,在保持高识别率前提下,减少识别时间。

3.1 模型描述

模型要依据视频图像时序空间变化的连续性和关联性特点,比较相邻帧中待识别区域的信息,优化识别方法。基于相邻帧交通标志时序空间变化原理,构建TSM识别模型。依据F0…Fn-1帧中交通标志的识别结果,构建AROS,包括交通标志类型、位置、是否被处理的标记信息、已识别次数,以及近几帧该目标未出现的次数等参数。

TSM识别模型按照图4结构设计,目标识别可以使用TSM预测或分类器预测。分析模型的结构可知,AROS的创建以及更新是构建该模型的关键。当第Fn帧中的目标满足下列关系,将当前帧中的目标加入AROS中:

⑴ AROS为空时。

⑵ AROS非空。读取第Fn帧中第i个目标的信息和AROS中第j个目标信息按照公式⑵匹配操作。参数满足di,j<10,同时目标长宽比率范围在0.8-1.2时,可以判断为同一类型的目标,并用当前目标信息更新AROS。

基于单帧识别的卷积分类网络,依次识别相似连续帧中目标,耗时较长。上述构建的基于时序空间关系的识别模型,能够在保持高识别率的基础上,有效加快序列帧相似目标的识别速率。

3.2 改进的多尺度卷积神经网络

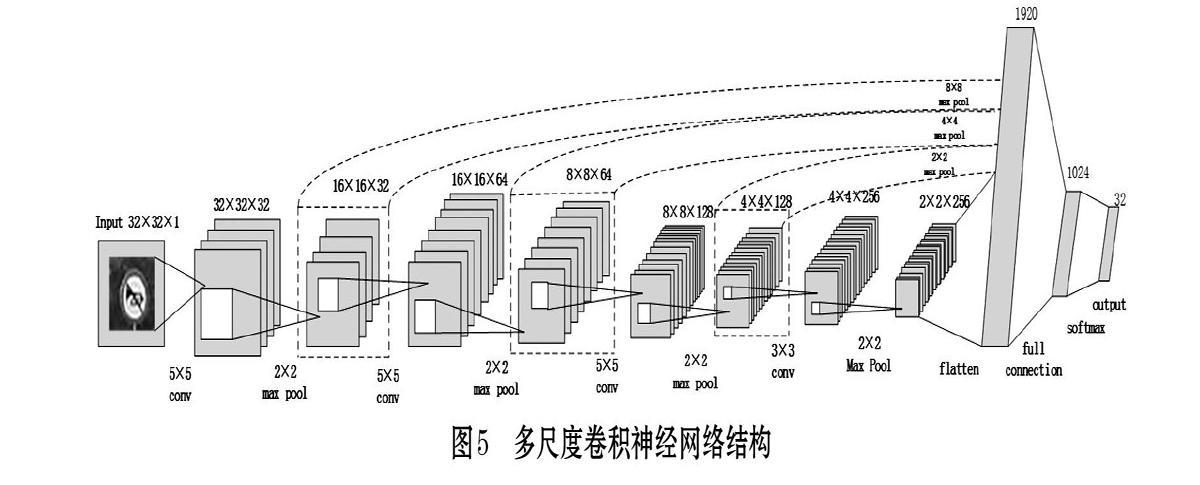

模型的识别准确率归根结底依赖于神经网络分类器,因此采用一个高精度的分类器尤为重要。“分类器学习到更多的卷积特征,那么它的分类精度就越高”,受Yann LeCun[11]文献启发,网络结构采用多尺度卷积神经网络,每个卷积层不仅传递给下一层,而且传递给分支层,经过相应比例的下采样后都可以作为输入直接传给分类器。这样的网络结构设计,使得分类器充分学习每层网络的特征图像,提高目标分类识别效果。

本文构建的卷积神经网络采用四层卷积层和池化层用于特征提取,一层全连接层用于分类。与传统的神经网络不同,多尺度卷积神经网络可以同时保留L1和L2卷积层提取的局部特征和L3、L4层的高级特征,能够兼顾学习到样本特征的全局性和局部性。多尺度卷积神经网络结构如图5所示。

随着训练过程的进行,模型复杂度增加,会出现过拟合现象,本文采用Dropout、L2正则化、Early stopping三种方式解决过拟合。将Dropout作用在全部网络层,以一定概率将选中的神经元舍弃,使其不起作用。L2正则化在损失函数上加上一个正则化项,起到对模型向量 “惩罚”的作用,避免单纯最小二乘问题的过拟合问题。Early stopping在每一个迭代结束时,计算验证集的准确率,当准确率随着训练不再提高时,就停止训练,防止过拟合,提高训练速度和调参效率。

3.3 模型应用

将本文的模型应用在视频图像中,运行大量视频,统计结果。图6(a)为使用卷积神经网络识别连续帧图像选取9帧作为样例,识别率较高,耗时长;图6(b)是使用TSM模型识别该连续帧图像,在该序列图像中,识别率不变,时间明显缩短。

(a) 卷积神经网络识别序列图像

(b) TSM识别序列图像

从序列图像的识别结果来看,基于单帧识别的卷积神经网络识别率高,但TSM識别算法结合多帧信息,不仅识别率高,还加快识别速度。

4 实验结果与分析

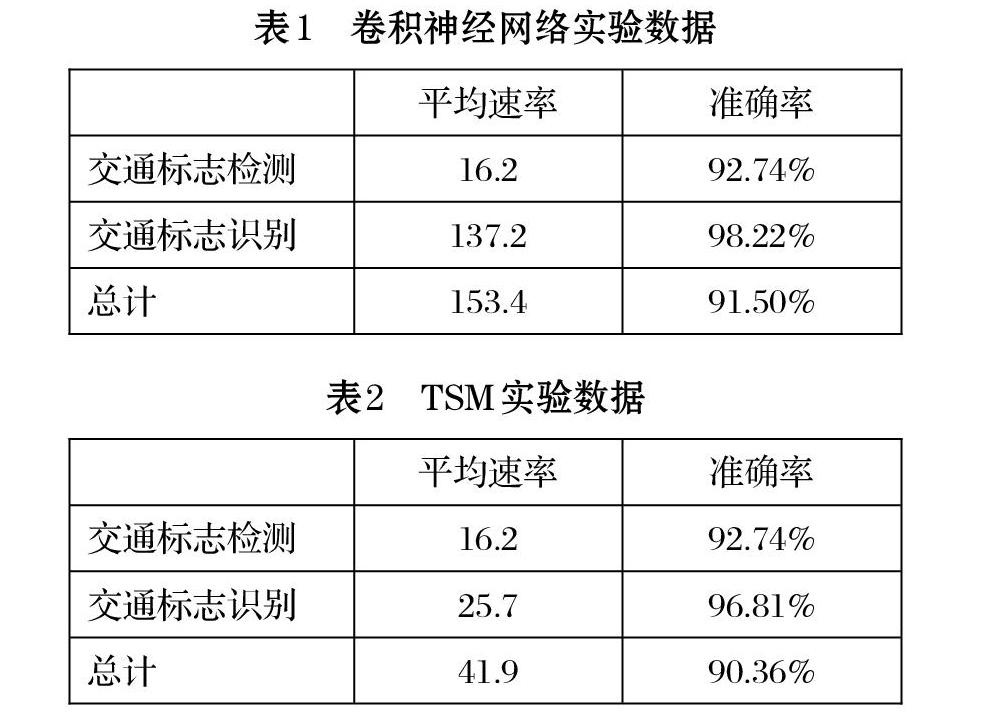

为验证本文识别算法的准确率和效率,采用行车记录仪录制的青岛市多条城市道路、多种天气情况和多个时间段的的视频文件作为测试数据,视频帧率29fps,分辨率1920×1080。测试环Intel@Xeon(R) CPU E5-2683 v3 @2.00GHz×28。使用卷积神经网络和TSM识别算法分别测试同一视频文件,结果数据如表1、表2所示。

通过对比表1和表2的数据可以得出结论,使用本文提出的TSM识别算法,识别率降低约2%,识别速率可以提高近400%。本文算法在保证高识别率的前提下,有效解决序列图像基于单帧识别效率低的问题。

5 结束语

本文根据交通标志在序列图像中的时序空间关系,提出了基于TSM的交通标志识别算法,该算法通过将TSM模型和改进的多尺度卷积神经网络有效结合,解决了单帧图像识别效率低的问题,保证高识别率的基础上,大大提高了序列图像交通标志识别速率。下一步工作,继续完善检测算法,以及优化识别阶段的网络模型,实现更快速的图像识别。

参考文献(References):

[1] 刘佳敏,何宁,杜金航.智能辅助驾驶系统中的禁令交通标志识别方法研究[D].西南交通大学,2013.

[2] 温斯傲,李志民,郝博闻.交通标志检测研究综述[J].智能计算机与应用,2016.6(3): 58-61

[3] 姚汉利,赵金金,鲍文霞.基于特征融合和字典学习的交通标志识别[J].计算机技术与发展,2018.28(1):51-55

[4] S. Jung U L, J. Jung and D. H. Shim. Real-time TrafficSign Recognition system with deep convolutional neural network[C].2016 13th International Conference on Ubiquitous Robots and Ambient Intelligence (URAI), Xi'an,2016:31-34

[5] H. Luo Y Y, B. Tong, F. Wu and B. Fan. Traffic SignRecognition Using a Multi-Task Convolutional Neural Network[J].International IEEE Conference on Intelligent Transportation Systems,2018.19:1100-1111

[6] Bahlmann C, Zhu Y, Ramesh V, et al. A system for trafficsign detection, tracking, and recognition using color, shape, and motion information[J].2005 IEEE Intelligent Vehicles Symposium Proceedings,2005:255-260

[7] Soheilian B, Paparoditis N, Vallet B. Detection and 3Dreconstruction of traffic signs from multiple view color images[J].Isprs Journal of Photogrammetry and Remote Sensing,2013.77:1-20

[8] Nguwi Y Y, Kouzani A Z. Automatic road sign recognitionusing neural networks[J]. 2006 Ieee International Joint Conference on Neural Network Proceedings,2006.1-10.

[9] Lecun Y, Bengio Y. Convolutional networks for images, speech, and time series[M].1998.

[10] 王元奎,秦勃,李偉.基于时空关系模型的城市道路车辆实时检测[J].计算机系统应用,2017.10:207-212

[11] Sermanet P, Lecun Y. Traffic Sign Recognition withMulti-Scale Convolutional Networks[J].2011 International Joint Conference on Neural Networks (Ijcnn),2011:2809-2813