基于多关联特征的屏幕阅读坐姿健康性判别

邹芳园,闵卫东,崔 浩,韩 清

基于多关联特征的屏幕阅读坐姿健康性判别

邹芳园1,闵卫东2,崔 浩1,韩 清1

(1. 南昌大学信息工程学院,江西 南昌 330031;2. 南昌大学软件学院,江西 南昌 330047)

长期坐姿不正确将会严重危害人体健康。现有的基于计算机视觉的坐姿检测方法主要是通过检测人体本身来判别坐姿的健康性,没有综合地考虑人体与屏幕之间的交互关系,使得对多种不健康坐姿无法准确检测,对此提出了一种基于多关联特征的屏幕阅读坐姿健康性判别方法。从人体自身的约束关系和人与屏幕间的约束关系这2个方面考虑,先检测出人体和屏幕,再根据目标的空间方位关系综合地提取与坐姿健康关联性强的坐姿特征。接着将坐姿特征序列输入到卷积神经网络中进行学习和分类,从而实现坐姿的健康性判别。实验结果表明,该方法可以有效地识别出屏幕阅读时存在的多种不健康坐姿行为。与其他方法相比,具有较好地识别结果及应用价值。

坐姿检测;健康性判别;多关联特征;卷积神经网络

计算机的普及使得坐式成为人们的一种生活常态。由于不健康坐姿不仅会伤害眼睛,还会增加患各种肌肉骨骼疾病的风险,严重危害人体健康[1-3],因此坐姿检测对帮助人们养成健康的坐姿习惯是非常有必要的。

坐姿检测主要分为2类:基于穿戴式设备的方法和基于视觉的方法。MEYER等[4]和MATTMANN等[5]利用贝叶斯分类器对压力传感器收集的信息来识别姿势;MA等[6]通过安装在颈后部的三轴加速度计获取坐姿数据,结合支持向量机进行坐姿分类;LIANG等[7]通过Adaboost分类压力信号来识别坐姿。这些方法均能检测坐姿,但对传感器精度要求高,检测效果受人与传感器接触区域影响大、易受干扰、成分复杂、可能给人带来不舒适感等问题。

张宇[8]和MU等[9]采用基于视觉的方法,通过检测人脸再比对人脸区域面积的大小来识别坐姿,但是对光线、背景等要求高,且脸部信息不能完全反映人体关节之间的信息,可能存在漏检情况;WANG等[10]提出将图像处理技术与Kinect相结合的方法,把人体姿势分为坐、站、躺、弯腰和跪5种截然不同姿势再进行分类;YAO等[11]通过Kinect比较监测与正常状态的坐姿,设计了坐姿判别方法,但易漏检;LIU等[12]在RGB-D场景中结合健康的坐姿估算框架来估计坐姿,该方法可通过检测肢体的分布帮助适当地调整坐姿;马叶涵[13]通过Kinect获取与用户体态相关的RGB-D图像进行坐姿检测,并对打电话、喝水和打字3个动作进行建模实现动作分类;郭玉喜[14]提出了一种基于real sense体感摄像机的坐姿检测方法,通过深度图像计算使用者头部的摆动幅度及其与显示器之间的距离来判别坐姿是否健康;曾星等[15]通过采集的深度图像获取人体关键点特征和轮廓特征来检测坐姿,帮助纠正学习工作情况中出现的不良坐姿。

由于现有的检测方法只关注被检测者的坐姿,忽略了人与屏幕之间的健康约束关系,使得多种不健康坐姿如由于视距和视角不当造成的不良坐姿无法被准确检测。对此提出一种基于多关联特征的屏幕阅读坐姿健康性判别方法。从人体自身健康约束关系和人与屏幕的健康约束关系这2个方面入手,通过场景检测提取目标对象间的关联特征,并与从深度图像中提取的人体关节特征相融合。再将坐姿特征序列输入到一个浅层的卷积神经网络(convolutionalneuralnetwork, CNN)中进行分类,实现对屏幕阅读的不健康坐姿的精确判别。

1 坐姿健康性判别方法介绍

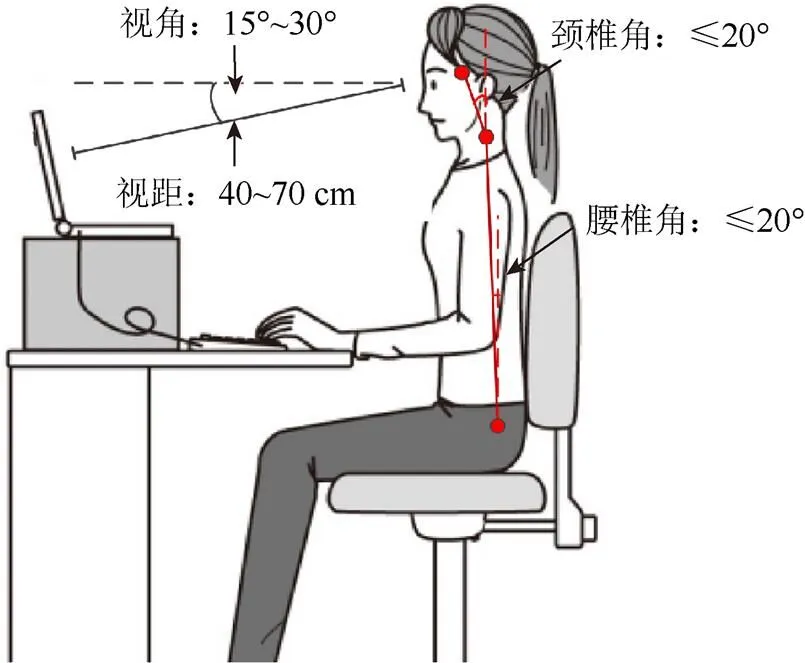

人在屏幕阅读时容易无意识地形成不健康坐姿,这是因为坐姿会受到计算机工作站系统中如人、屏幕、椅子等因素的影响[16-18]。MCATAMNEY等[19]指出腰椎角度、颈椎角度大于20°即为不良坐姿;BURGESS-LIMERICK等[20]建议健康的人眼监控距离为40~70 cm;SPRINGER[21]表明视觉显示最佳角度为低于水平视线15°~30°,所以健康的坐姿是人与工作环境共同作用的结果。本文结合人体关节和人与场景[22]2个方面定义了健康的坐姿形态,并展示了3种常见的不健康坐姿示例,如图1所示。图1已根据本文中的坐姿健康性关联特征进行了相应的标注。

基于多关联特征的屏幕阅读坐姿健康性判别方法如图2所示。对Kinect输出的场景深度图与彩色图进行骨架跟踪和场景检测。根据坐姿健康性的约束关系,从人体骨架关节信息和人与屏幕间的空间关系2个方面入手提取坐姿的关联特征。将提取的坐姿关联特征序列输入到一个浅层的CNN中进行健康性分类,进而得到更准确的人体坐姿健康性判别结果。

2 基于坐姿健康性约束关系的关联特征提取

2.1 人体关节点检测及跟踪

深度传感器Kinect凭借非入侵性和用户友好型的优势被广泛应用于现有行为检测工作的采集实验数据中[23]。主要原理是通过解码接收到的红外光线生成具有三维深度信息的图像,接着通过骨架追踪系统寻找图中可能是人的移动物体,并进行像素级别评估分辨出人体的不同部位。根据追踪到的关节点可得到人体骨架,同时对每个模型的输出像素进行位置评估,因此能准确地返回骨骼关节的位置和方向。

骨架跟踪前,被测者需要面向传感器呈T形以帮助完成骨架模型的匹配和校准。图3是呈T形的人体骨架示意图,关节的位置和方向与实际的人体相对应,坐标系中轴向右,轴向上,轴表示深度增加方向。

由于骨架检测及跟踪容易受肢体重叠、运动速度及遮挡等问题的影响,其导致跟踪效果差甚至是失败。因此相机应避免放置在被检测对象的正前方或正后方,以造成不必要的遮挡,影响检测性能[24],侧边放置能够提供较好的检测效果[12]。为了减少骨架跟踪的干扰,本文结合关节间的健康约束关系[9,25],提取了屏幕阅读时与坐姿健康性有强约束关系的人体头部关节点、颈部关节点和腰部关节点。

(a) 健康坐姿

(b) 驼背坐姿

(c) 后倾式坐姿

(d) “狮身人面”坐姿 图1 坐姿示例 图2 框架概述 图3 人体骨架正面示意图 2.2 场景检测 人在屏幕阅读时,坐姿与屏幕之间存在互交作用。要判别人与屏幕间的约束关系,需要先从复杂环境中精准地识别出人与屏幕,才能提取目标间的空间关联特征。Faster R-CNN[26]相比于其他几种机器学习方法[27-29]具有更高的检测精度和更快的目标检测速度。MIN等[30]通过场景分析的方法有效地识别出场景中人与家具,精确地判断了人体的摔倒行为。本文通过Faster R-CNN对屏幕阅读场景进行检测,获取人与屏幕间的空间关系。 Faster R-CNN网络主要由区域建议网络RPN提取候选区域模块和目标检测模块组成。由于这2个网络模块被统一到一个深度学习网络框架下,避免了重复计算,极大地减少了计算量,使得目标检测收敛速度更快。RPN网络生成的建议区域的中心坐标为x,y,宽、高分别为w,h。标定框对应存在中心坐标为x*,y*,其宽和高为w*,h*。xa,ya是候选框的中心坐标,wa和ha是其对应的宽和高。回归损失计算公式为 , (1) , (2) , (3) , (4) 图像的总损失函数为 传统本科人才的培养体系一般都偏重于基础知识教学和深奥理论的讲授,忽视了对应用能力的培养,对实践教学体系也缺乏深入的思考和系统的构建。针对传统本科人才的培养体系,学校要大胆改革,实施三大转变:以教师为中心向以学生为中心转变;以学历为中心向学历和能力并重转变;以理论为中心向理论和实践相结合转变,培养应用型人才,增强“双师型”教师意识。 (5) 其中,pi为候选区域被预测为目标的概率;为与被预测为目标的锚点所对应的标定框的坐标向量;为目标和背景的对数损失;为回归损失函数,R为损失函数smooth L1。 Faster R-CNN的训练数据集voc-2007中包含本实验需要检测的人与显示屏幕类别,且所有图片均已标注。使用自收集的实验数据进行微调后,分别获得检测人的F1分数为89.19%,屏幕检测的F1分数为81.13%,precision为检测精度;。基于Faster R-CNN的场景检测结果如图4所示,实验表明场景检测方法可以有效地检测出人与屏幕,有利于帮助获取目标对象之间的空间关系。 2.3 坐姿关联特征提取 通过场景检测和骨架跟踪后,本文利用基于坐姿健康性的约束关系[19-21]提取了4个与健康性有较强关联的检测特征颈椎角、腰椎角、视距和视角。屏幕阅读时坐姿关联特征提取如图5 所示。 理论分析及解析解的研究,试图通过不需要经过复杂的数值模拟计算即可得到系统数学模型的求解结果,进而指导工业设计或系统性能优化等。 图4 目标检测结果示意图 图5 坐姿关联特征提取示意图 令头部关节点为H(Xh,Yh,Zh),颈部关节点为S(Xs,Ys,Zs),腰部关节点为 W(Xw,Yw,Zw),显示器中心坐标为M(Xm,Ym,Zm)。颈部至头部向量为SH,腰部至颈部向量为WS,人体头部至显示器的向量为HM。表示水平方向上的方向向量为HL,竖直方向上的方向向量为SG。向量SH计算为 (6) 根据上述向量计算方式可计算向量WS和HM。 特征角度计算以颈椎角度αV计算为例。颈椎角度是向量SH与竖直方向上的方向向量SG之间的夹角,即 (7) 根据上述角度计算方式可计算腰椎角度βV和视角θV。 市场在取水权申请环节发挥作用的流程是:水权申请人通过市场竞争水权后,经政府确权登记发证,取得水权,并可以流转。可见,市场机制不但在水权交易二级市场中发挥决定性作用,而且在取水权申请环节一级市场也可以发挥决定性作用。但是,由于后者增加社会用水总量,又是政府参与市场活动,应当慎用,最好是作为弥补市场不足时采用;而前者不增加用水总量,又是市场平等主体间的交易,应当优先采用。 人与屏幕间的距离DV为 (8) 根据人机工程学健康指导原则[29-31],定义坐姿的健康性。图6为一段时间内的坐姿特征序列示意图,由于人在屏幕阅读时处于活动状态,因此提取到坐姿特征的值会随着人体运动而相应变化。将4个特征序列组成一个基于时间序列的运动特征。采用CNN学习关联特征序列,实现屏幕阅读时坐姿不健康性的判别。 在高中语文核心素养中,语言构建和运用能力是最为基础的内涵,对于发展学生思维发展能力、审美能力和创新能力、文化传承和诠释等,都能够起到不可替代的作用。只有在构建良好语言体系、完善语言运用能力的基础上,才能够不断提升综合素养[2]。因此,在高中语文的教学过程中,应该始终把语言构建和运用能力作为教学的根本。 图6 坐姿关联特征的时间序列 3 基于CNN的坐姿健康性判别 CNN可以被应用于分类人的日常行为[31-32],本文采用一个浅层的CNN学习坐姿特征序列的时空信息,用于屏幕阅读时坐姿健康性检测判别。分类网络结构如图7所示。 图7 用于分类坐姿健康性的CNN架构 首先将坐姿特征序列进行分割处理,再输入到卷积层中由多个滤波器对其进行并行学习,以获取丰富的坐姿特征表达。本文选取的滤波器的大小为12,步长为1。接着通过激励层对上一卷积层的输出结果做非线性映射,这里采用的激励函数是ReLU函数。ReLU函数是一个逐点计算的激活函数,收敛速度快,表现形式为ReLU(x)=max(0,x)。为了除去冗余信息,减少计算负担,本文通过最大池化,使用尺寸为14的滤波器对特征图进行降维处理。并将池化层的输出特征图输入到Flatten层中进行扁平化,即把多维的输入数据折叠成一维数据。补充特征是关于特征序列的均值、方差等,与一维化后的CNN提取的特征一同输入到全连接层。全连接层由1 024个神经元构成。为了降低学习过程出现过拟合风险,在训练过程中使用Dropout的方法来降低神经元之间复杂的联合适应性,即保持输入层和输出层神经元的个数不变,每次随机忽略隐藏层的部分节点,迫使网络去学习更加鲁棒的特征。最后将这些特征输入到softmax层进行最后的分类,并计算出坐姿健康性的概率似然值。 (1)确定实验对象。本文针对的是网络课程设计的学生。(2)确定教学内容。以OSI七层模型为基础,涉及网络层、传输层等相关协议的应用。 蒲琳笑着不由自主地搂住张盈盈,半天却不知道说什么,想起以前她赌气和张盈盈说起的摘星星的话,就说:“我们想摘的星星是什么?” 模型的损失函数为交叉熵损失函数,即 (9) 其中,M为类别的数量;y为真实的分类结果;p为观测样本的类别预测结果。通过随机梯度下降算法Adam[33]来优化网络参数。 4 实验结果及分析 本文实验是基于Ubuntu 16.04 LTS + Tensorflow 1.0.0 + Opencv2.4.9 +Matlab +Microsoft Kinect 2.0摄像头+配置了英特尔酷睿i7-4790 3.60 GHz处理器、显卡M4000以及内存为8 G的PC机上实现的。实验椅子高为43 cm,办公桌高为78 cm,显示器可升降,实验中可根据需要调整显示器高度及位置。图8为屏幕阅读时常见的坐姿行为,其中图8(a)为健康坐姿,图8(b~i)为几种常见的不健康坐姿。 由于目前没有符合本文坐姿检测情况的坐姿健康性检测标准数据集,因此实验中所用到的数据均为自己拍摄收集的坐姿检测数据。本文通过8名受测试者在2种办公环境下收集了包括健康坐姿在内的多种坐姿视频共276个,每个视频大于300帧,在收集的30 545帧图像特征数据用于训练及测试。实验结果见表1。 由于坐姿健康性分类是基于时间的特征序列,为了测试在训练过程中坐姿特征序列的长度对分类结果的影响,本文将特征序列分割成了不同的长度。经过多次测试发现,识别间隔为10时,分类精度最好。本文对图8中的不同坐姿分别进行了健康性判别,用于测试的每类坐姿的个数分别为600,判别的结果见表2。 (a) 健康坐姿(b) 身体右侧(c) 手托头部 (d) 身体前倾(e) 身体左侧(f) 身体后倾 (g) 视距过近(h) 视角不当(i) 身体前趴 图8 9种坐姿示例 表1 实验结果 样本坐姿类别召回率 (%)精度 (%)F1分数 (%) 训练测试 健康 9 0285 44993.9997.0995.51 不健康10 4995 56995.7691.3793.51 表2 坐姿健康性判别实验 坐姿类别识别率(%) CNN分类随机森林分类 健康坐姿100100 身体右歪93.3399.17 手托头部99.1598.33 身体前倾83.0577.97 身体左歪96.6796.67 身体后倾94.92100 身体前趴93.3395.83 视距过近93.7568.25 视角不当87.1965.83 平均识别率93.3689.12 首先对屏幕阅读过程中目标对象所处的场景环境进行检测后,结合人体骨架信息综合地提取与健康性具有较强的关联特征,再针对坐姿特征序列进行分类。本文采用CNN对坐姿进行分类,并与随机森林分类算法进行比较。随机森林是一种由多棵决策树构成的对数据进行判别和分类的方法,能够很好地处理多维特征数据。表2实验结果表明,随机森林模型能够很好地判别身体幅度较大的不健康坐姿。CNN通过对提取的坐姿关联特征进行学习和分类,可以更有效地检测和判别屏幕阅读时坐姿的健康性。 本文还综合地复现了基于视觉的方法[8]和基于Kinect骨架检测的方法[11],对屏幕阅读时的坐姿进行健康性判别实验分析。对比实验检测结果如图9所示。 图9 坐姿健康性判别识别率对比 文献[8]通过检测人脸,计算脸部面积再与基准人脸面积对比来判断人的坐姿。该方法简单易操作,但只能给出大致的距离和方位提醒,受光照影响大,人脸检测易出现漏判和误检。文献[11]通过计算人体关节角度来检测坐姿是否健康,该方法简单效果好,但受骨架检测及跟踪效果影响大,且未关联屏幕。图9结果表明,本文提出的坐姿检测方法具有更好的坐姿健康性判别效果。 李闺女又呸了一口:李六如,真是越来越不知道羞耻了。原先拆迁时,你想当个先进也就算了。如今,又勾结佟金鑫占了那点口粮田。你说,老少爷们今后怎么活? 下面定性的分析几种现有的坐姿检测方法对图8所示坐姿的健康性判别能力。 基于穿戴设备的坐姿检测方法[4-5]和基于辅助设备的坐姿检测方法[6-7]可以获取人体速度和高度等信息,通过压力变化来检测坐姿。但只能根据传感器的受力情况来判别是否存在不健康坐姿,并没有对关联场景进行分析,无法有效地检测出因视距不当及显示器高度不合理而导致的不健康坐姿。 基于计算机视频的方法[8-9]主要是通过在设定的区域内进行人脸检测,计算面部区域的大小来判别坐姿是否健康。如果出现面部遮挡等情况,如身体前趴时,则无法通过检测人脸识别出不健康坐姿。而且该方法没有提取对象间有效的关联特征,无法有效地检测出如屏幕高度不当、视角不合理的坐姿环境。 这句台词在诞生之后风靡了整个朋友圈,引发近乎病毒式的传播。但对此句话熟悉的人应该知道,其原句是:“看似稳如老狗,实际慌得一批”,由于电子竞技游戏经常会有“极限反杀”、“丝血逃生”这样的极限操作,因此这个闪烁着无数网友自黑抖机灵的智慧光辉的用词,在世界杯蹿红之前已经火爆在电竞圈了。 基于体感摄像机的坐姿检测方法[15]利用用户脸部的深度图像来监测人体头部的摆动和俯仰情况,从而实现坐姿检测。该方法主要根据头部运动来判别坐姿是否健康,容易出现对人体上半身躯干部位监测不全的问题。基于Kinect的坐姿检测方法[11]通过深度信息计算出人体骨架关节点之间的关系,实现坐姿检测。该方法依赖于人体骨架信息,且只关注人体本身的坐姿情况,没有关联场景,因而忽略了人与屏幕之间的联系,致使一些由视距和视角等造成的不健康坐姿无法被准确地检测和识别。 专业核心课程通过引进全球性国际酒店管理专业机构—美国饭店协会教育学院(AHLEI)的人才培养模式、核心课程、师资、教材和教学方法,共享其在全球的教学、实习、就业资源,以AHLEI12门专业核心课程作为理论课程建设主线,根据不同课程和学生实际情况,逐步加大英语授课比例,大一20%-30%,大二50%左右,大三及以上80%-100%,实施本土化双语教学。自建中英文试题库,配套阶段测试,帮助学生适应美方考试模式,逐步提高课程通过率,为学生真正能用英语从业打下坚实的基础。 综上,本文提出的方法可准确有效地识别出屏幕阅读时存在的多种不健康坐姿行为。在实验过程中尽可能地模拟用户在日常情况下的屏幕阅读状态。和现有方法相比,本文方法能更准确地识别出更多种的不健康坐姿,特别是由视距和视角等造成的不健康坐姿。 5 结束语 坐姿复杂多样,为了有效检测屏幕阅读的不健康坐姿,本文提出一种基于多关联特征的屏幕阅读坐姿健康性判别方法。从人体自身和人与屏幕的互交2个方面综合判别屏幕阅读坐姿健康性。实验结果表明,本文方法能够有效地检测出多种不健康的坐姿行为,并具有较好地检测准确率。由于本文选取的关联特征都是与人体健康存在较强的约束关系,因此可以根据关联特征值的变化对人体坐姿的健康性进行具体分析,针对性帮助及时调整和纠正不健康坐姿,可以潜在地使用和整合于工作场所的保健中。 参考文献 [1] 方跃伟, 潘松涛, 段蒋文. 办公室坐姿作业肌肉骨骼疾患健康危害及对策[J]. 健康教育与健康促进, 2014, 9(4): 326-329. [2] LIS A M, BLACK K M, KORN H, et al. Association between sitting and occupational LBP [J]. European Spine Journal, 2007, 16(2): 283-298. [3] OKUNRIBIDO O O, MAGNUSSON M, POPE M H. Low back pain in drivers: The relative role of whole-body vibration, posture and manual materials handling [J]. Journal of Sound and Vibration, 2006, 298(3): 540-555. [4] MEYER J, ARNRICH B, SCHUMM J, et al. Design and modeling of a textile pressure sensor for sitting posture classification [J]. IEEE Sensors Journal, 2010, 10(8): 1391-1398. [5] MATTMANN C, AMFT O, HARMS H, et al. Recognizing upper body postures using textile strain sensors [C]//2007 11th IEEE International Symposium on Wearable Computers. New York: IEEE Press, 2007: 29-36. [6] MA S Y, CHO W H, QUAN C H, et al. A sitting posture recognition system based on 3 axis accelerometer [C]//2016 IEEE Conference on Computational Intelligence in Bioinformatics and Computational Biology (CIBCB). New York: IEEE Press, 2017: 1-3. [7] LIANG G, CAO J, LIU X. Smart cushion: A practical system for fine-grained sitting posture recognition [C]//2017 IEEE International Conference on Pervasive Computing and Communications Workshops (PerCom Workshops). New York: IEEE Press, 2017: 419-424. [8] 张宇. 基于人脸检测与肤色统计的坐姿行为监测[J]. 计算机与网络, 2017, 43(7): 72-75. [9] MU L, LI K, WU C. A sitting posture surveillance system based on image processing technology [C]//2010 2nd International Conference on Computer Engineering and Technology. New York: IEEE Press, 2010: V1-692-V1-695. [10] WANG W J, CHANG J W, HAUNG S F, et al. Human posture recognition based on images captured by the kinect sensor [J]. International Journal of Advanced Robotic Systems, 2016, 13(2): 54. [11] YAO L, MIN W, CUI H. A new kinect approach to judge unhealthy sitting posture based on neck angle and torso angle [C]//International Conference on Image and Graphics. Heidelberg: Springer, 2017: 340-350. [12] LIU B, LI Y, ZHANG S, et al. Healthy human sitting posture estimation in RGB-D scenes using object context [J]. Multimedia Tools and Applications, 2017, 76(8): 10721-10739. [13] 马叶涵. 基于Kinect的办公健康分析系统的设计与实现[D]. 哈尔滨: 哈尔滨工业大学, 2015. [14] 郭玉喜. 基于Real Sense的坐姿检测与纠正系统的设计与实现[D]. 长春: 吉林大学, 2016. [15] 曾星, 罗武胜, 孙备, 等. 基于深度图像的嵌入式人体坐姿检测系统的实现[J]. 计算机测量与控制, 2017, 25(9): 8-12. [16] PONGLANGKA W, THEERA-UMPON N, AUEPHANWIRIYAKUL S. Eye-gaze distance estimation based on gray-level intensity of image patch [C]//2011 International Symposium on Intelligent Signal Processing and Communications Systems (ISPACS). New York: IEEE Press, 2012: 1-5. [17] RUBENOWITZ S. Survey and intervention of ergonomic problems at the workplace [J]. International Journal of Industrial Ergonomics, 1997, 19(4): 271-275. [18] SHIKDAR A A, AL-KINDI M A. Office ergonomics: Deficiencies in computer workstation design [J]. International Journal of Occupational Safety and Ergonomics, 2007, 13(2): 215-223. [19] MCATAMNEY L, NIGEL C E. RULA: A survey method for the investigation of work-related upper limb disorders [J]. Applied Ergonomics, 1993, 24(2): 91-99. [20] BURGESS-LIMERICK R, PLOOY A, ANKRUM D R. The effect of imposed and self-selected computer monitor height on posture and gaze angle [J]. Clinical Biomechanics, 1998, 13(8): 584-592. [21] SPRINGER T J. VDT workstations: A comparative evaluation of alternatives [J]. Applied Ergonomics, 1982, 13(3): 211-212. [22] JASCHINSKI W, HEUER H, KYLIAN H. Preferred position of visual displays relative to the eyes: A field study of visual strain and individual differences [J]. Ergonomics, 1998, 41(7): 1034-1049. [23] CAI Z, HAN J, LIU L, et al. RGB-D datasets using microsoft kinect or similar sensors: A survey [J]. Multimedia Tools and Applications, 2017, 76(3): 4313-4355. [24] SHOTTON J, FITZGIBBON A, COOK M, et al. Real-time human pose recognition in parts from single depth images [J]. Communications of the ACM, 2013, 56(1): 116-124. [25] WASENMÜLLER O, STRICKER D. Comparison of Kinect V1 and V2 Depth Images in Terms of Accuracy and Precision [M]//Computer Vision-ACCV 2016 Workshops. Heidelberg: Springer, 2017: 34-45. [26] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6):1137-1149. [27] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation [C]//2014 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). New York: IEEE Press, 2014: 580-587. [28] HE K, ZHANG X, REN S, et al. Spatial pyramid pooling in deep convolutional networks for visual recognition [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(9): 1904-1916. [29] GIRSHICK R. Fast R-CNN [C]//2015 IEEE International Conference on Computer Vision (ICCV). New York: IEEE Press, 2015: 1440-1448. [30] MIN W, CUI H, RAO H, et al. Detection of human falls on furniture using scene analysis based on deep learning and activity characteristics [J]. IEEE Access, 2018, 6: 9324-9335. [31] IGNATOV A. Real-time human activity recognition from accelerometer data using Convolutional Neural Networks [J]. Applied Soft Computing, 2018, 62: 915-922. [32] 邓志锋, 闵卫东, 邹松.一种基于CNN和人体椭圆轮廓运动特征的摔倒检测方法[J]. 图学学报, 2018, 39(6): 1042-1047. [33] KINGMA D P, BA J. Adam: A method for stochastic optimization [EB/OL]. (2014-12-22). [2017-01-30]. https://arxiv.org/abs/1412.6980. Health Discrimination of Sitting Posture in Screen Reading Based on Multi-Relevant Features ZOU Fang-yuan1, MIN Wei-dong2, CUI Hao1, HAN Qing1 (1. School of Information Engineering, Nanchang University, Nanchang Jiangxi 330031, China;2. School of Software, Nanchang University, Nanchang Jiangxi 330047, China) Abstract: Long-time incorrect sitting posture is seriously harmful to human health. The existing computer vision-based method of judging whether the sitting posture is healthy or not mainly relies on the detection of the state of the human body itself, in disregard of the interaction between the human body and the screen, resulting in a failure to accurately detect a number of unhealthy sitting postures. We proposed a method of judging the healthiness of screen-reading sitting posture based on multi-relevant features. In consideration of the constraints imposed by the human body and the binding force between the human and screen, the method extracts the features that are strongly related to the sitting posture healthiness according to the spatial orientation of the target in a comprehensive way after detecting the human body and the screen. Subsequently, the sitting posture feature sequence is input to the convolutional neural network for analysis and classification in order to judge whether it is healthy or not. The experimental results show that the method can effectively identify a variety of unhealthy sitting behaviors during screen reading. Compared with other existing methods, this method is characterized with better recognition effects and application value. Keywords: sitting posture detection; healthiness judgment; multi-correlation features; convolutional neural network 中图分类号:TP 391 DOI:10.11996/JG.j.2095-302X.2019050892 文献标识码:A 文章编号:2095-302X(2019)05-0892-08 收稿日期:2019-04-12; 定稿日期:2019-06-08 基金项目:国家自然科学基金项目(61762061);江西省自然科学基金项目(0161ACB20004);江西省智慧城市重点实验室项目(20192BCD40002) 第一作者:邹芳园(1995-),女,江西上饶人,硕士研究生。主要研究方向为图形图像处理、计算机视觉等。E-mail:ncuzoufangyuan@163.com 通信作者:闵卫东(1966-),男,江西赣州人,教授,博士,博士生导师。主要研究方向为图形图像处理、图形学、人工智能、大数据、智慧城市信息技术。E-mail:minweidong@ncu.edu.cn