基于特征的图像显著性检测

艾显丽 彭亚雄 陆安江

【摘 要】为了解决目前显著性检测中图像的纹理特征对其他特征(颜色、方向等)的影响问题,通过对该领域已有的算法和文章进行實验和比较,提出一个概念上明确和改进的基于对比度的显著性检测的直观算法。研究了将输入的图像用已改进的总变差模型来获取一个有效的主要结构,将提取到的主要结构图像分解为紧凑、感知、同质的元素,抽象出不必要的细节;进一步,基于这种抽象元素计算了两个对比度量,即颜色独特性和空间分布,通过高斯滤波得到两个对比度的显著图,将其进行融合。分析了融合后的显著图与目前比较经典的算法得到的显著图之间的改进之处。实验证实了去除纹理特征后提取到的显著图,有效地抑制了图像各特征之间的相互干扰,提高了显著图融合的精确度。

【关键词】显著性检测;纹理特征;对比度

1 引言

人类对自身以外的信息获取是来自感知,其中有80%的信息是通过视觉来获取的[1]。面对如此之多的复杂场景,人类如何快速、准确地识别出对自己有效的信息一直都是人们坚持不懈追求的目标。显著性目标检测技术可分为通过任务驱动的自顶向下的显著性方法以及通过底层特征数据驱动的自底向上的显著性方法[2-3]。近几年随着人工智能的兴起,目标级显著性检测的研究也在越来越受到人们的密切关注,由于这种方法的实用性,显著目标检测的研究成果也已经广泛应用于很多领域,比如可以应用在图像分割、自适应压缩、图像检索等计算机视觉技术中[4]。

然而,在以往的工作中,对比度的定义是基于各种不同类型的图像特征,包括单个像素的颜色变化、边缘和梯度、空间频率、图像块的结构和分布、直方图、多尺度描述符或其组合。每个单独特征的重要性仍然不清楚,即使是非常相似的方法也可能表现出相当大的性能差异。

从目前的研究现状来看,显著性检测方法很少考虑到图像的纹理特征对其他特征(颜色、方向等)的影响,使得最后的显著图融合不精确。本文重新考虑了基本相关的对比措施及其定义的图像内容。方法是基于一幅图像含有规则或不规则的纹理特征,用改进的总变差模型提取图像的主结构图,将主结构图分解为基本元素[9],基于这些元素定义了两个对比度量用于计算每个像素的显著性。

除此之外,不同的评价结果表明:现有方法中的个体特征和对比措施很难评估。将对比度度量集减少到只有两个,这两个度量集可以通过抽象的图像元素直观地定义,同时生成像素精确的显著性图。

2 本文算法

2.1 算法步骤

本文的算法是将一幅输入的图像通过总变差模型去纹理特征之后,然后通过分割得到主结构图,获取到抽象的、小的和在感知上均匀的元素(如图1中的分割图),用于图像抽象的显著性计算方法,将主结构上具有代表性的元素和基于颜色和空间分布对比度的显著性度量计算出来。这里采用基于滤波器的公式高效计算并生成每像素显著性图(如图1中的颜色独特性和空间分布)以及利用这些元素的两两对比度量来计算图像的显著性(如图1中的最终显著图)。最后为了与手工分割的标注图进行比较,在实验中对阈值图进行计算(如图1中的阈值结果)。

2.2 总变差模型

本文通过提取图像主结构的方法来分离纹理特征,在主结构图上提取图像的颜色特征,减少纹理信息对基于颜色特征进行显著性检测的干扰[10]。本文选取的是基于总变差模型的方法来去除图像中的规则或不规则的纹理,该方法具有很高的鲁棒性,适用于对多种不同类型的纹理这一特征进行处理。总变差模型通过下式表示:

其中,I是原始输入的图像,P是二维图像的像素索引,S是去纹理后的输出图像,Sp是去纹理后的二维图像像素索引,Ip是原始输入图像的二维图像像素索引,λ是一个不可或缺的权重值,它用来控制图像的光滑程度,在本文实验中λ=0.01,(Sp-Ip)2保证了输出的结构图像和输入的原始图像保持尽可能的相似,其中各向异性

2.3 颜色特征值

3 实验和评价

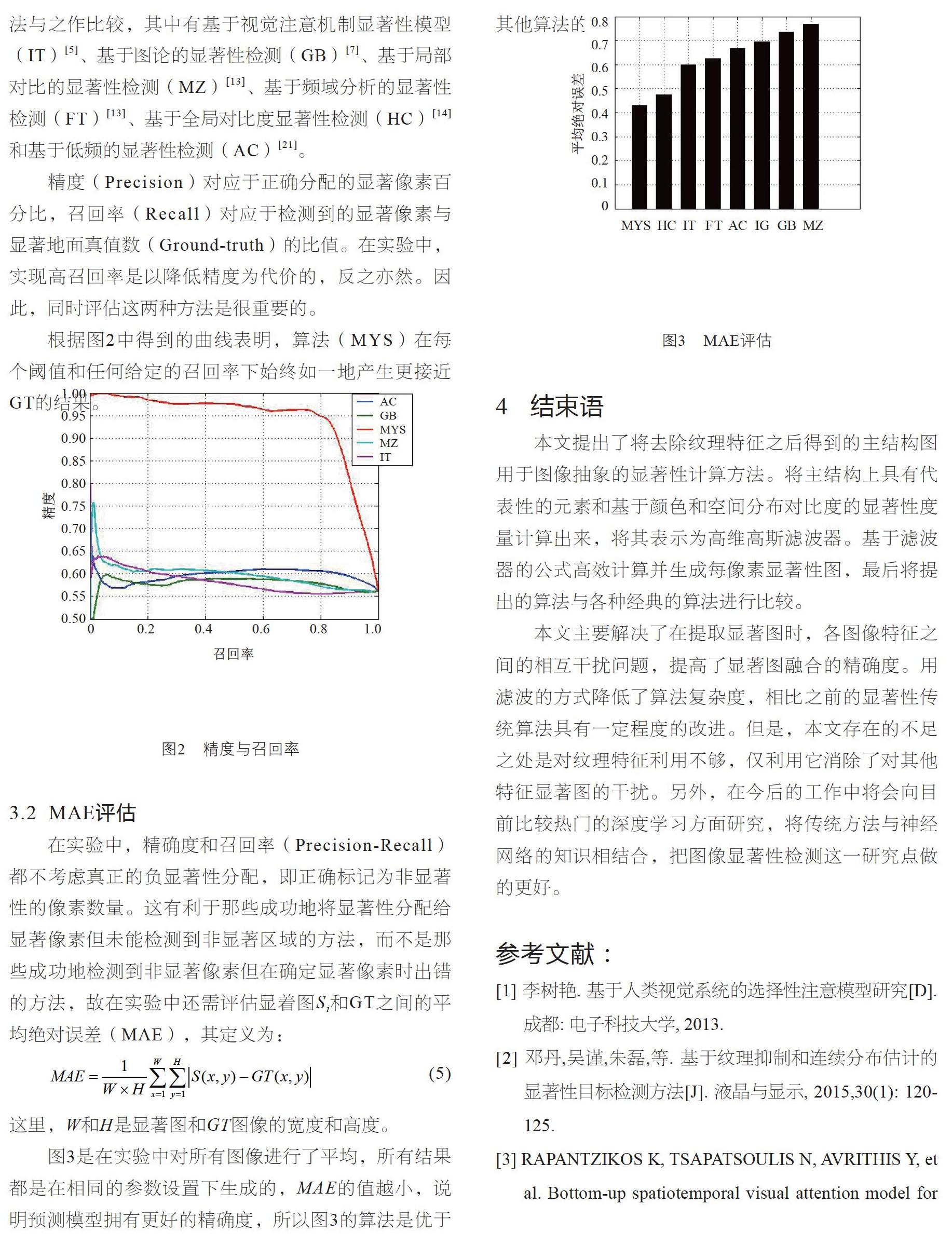

3.1 Precision-Recall评估

本文采用的是分割阈值的方法来进行评估[12,17-19]。首先,将通过融合得到的显著图进行二值化,将分割后的二值图与MSRA-1000数据库[20]中手工分割的标注图(GT)进行比较。此外,为了凸显算法(MYS)的改进性,在评估时还会选取传统方法中一些经典的算法与之作比较,其中有基于视觉注意机制显著性模型(IT)[5]、基于图论的显著性检测(GB)[7]、基于局部对比的显著性检测(MZ)[13]、基于频域分析的显著性检测(FT)[13]、基于全局对比度显著性检测(HC)[14]和基于低频的显著性检测(AC)[21]。

精度(Precision)对应于正确分配的显著像素百分比,召回率(Recall)对应于检测到的显著像素与显著地面真值数(Ground-truth)的比值。在实验中,实现高召回率是以降低精度为代价的,反之亦然。因此,同时评估这两种方法是很重要的。

根据图2中得到的曲线表明,算法(MYS)在每个阈值和任何给定的召回率下始终如一地产生更接近GT的结果。

3.2 MAE评估

图3是在实验中对所有图像进行了平均,所有结果都是在相同的参数设置下生成的,MAE的值越小,说明预测模型拥有更好的精确度,所以图3的算法是优于其他算法的。

4 结束语

本文提出了将去除纹理特征之后得到的主结构图用于图像抽象的显著性计算方法。将主结构上具有代表性的元素和基于颜色和空间分布对比度的显著性度量计算出来,将其表示为高维高斯滤波器。基于滤波器的公式高效计算并生成每像素显著性图,最后将提出的算法与各种经典的算法进行比较。

本文主要解决了在提取显著图时,各图像特征之间的相互干扰问题,提高了显著图融合的精确度。用滤波的方式降低了算法复杂度,相比之前的显著性传统算法具有一定程度的改进。但是,本文存在的不足之处是对纹理特征利用不够,仅利用它消除了对其他特征显著图的干扰。另外,在今后的工作中将会向目前比较热门的深度学习方面研究,将传统方法与神经网络的知识相结合,把图像显著性检测这一研究点做的更好。

参考文献:

[1] 李树艳. 基于人类视觉系统的选择性注意模型研究[D]. 成都: 电子科技大学, 2013.

[2] 邓丹,吴谨,朱磊,等. 基于纹理抑制和连续分布估计的显著性目标检测方法[J]. 液晶与显示, 2015,30(1): 120-125.

[3] RAPANTZIKOS K, TSAPATSOULIS N, AVRITHIS Y, et al. Bottom-up spatiotemporal visual attention model for video analysis[J]. IEEE Conference on Image Processing, 2007(2): 237-248.

[4] 胡德鳳. 基于纹理特征图像分割的研究[D]. 合肥: 合肥工业大学, 2013.

[5] ITTI KOCH C, NIEBUR E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE TPAMI, 1998(11): 1254-1259.

[6] 魏昱. 图像显著性区域检测方法及应用研究[D]. 济南: 山东大学, 2012.

[7] HAREL J, KOCH C, PERONA P. Graph-based visual saliency[J]. In NIPS, 2006: 545-552.

[8] HOU X, ZHANG L. Saliency detection: A spectral residual approach[J]. In CVPR, 2007(7): 1109.

[9] EFROS A A, FREEMAN W T. Image quilting for texture synthesis and transfer[J]. In SIGGRAPH, 2001: 341-346.

[10] AUJOL J F, GILBOA G, CHAN T F, et al. Structure-texture image decomposition-modeling, algorithms, and parameter selection[J]. International Journal of Computer, 2006: 111-136.

[11] REN Y, HU L T, CHIA, et al. Improved saliency detection based on super pixel clustering and saliency propagation[J]. ACM Multimedia, 2010: 1099-1102.

[12] ACHANTA R, SHAJI A, SMITH K, et al. SLIC super pixels Technical report[R]. 2010.

[13] MA Y F, ZHANG H. Contrast-based image attention analysis by using fuzzy growing[J]. ACM Multimedia, 2003: 374-381.

[14] CHENG M M, ZHANG G X, MITRA N J, et al. Global contrast based salient region detection[J]. IEEE Conference on Computer Vision & Pattern Recognition, 2015,37(3): 409-416.

[15] ACHANTA R, HEMAMI S, ESTRADA F, et al. Frequency-tuned salient region detection[C]//IEEE Conference on Computer Vision and Pattern Recognition. 2009: 1109.

[16] PEDRO F, FEIZENSZWALB, DANIEL, et al. Efficient Graph-Based Image Segmentation[J]. International Journal of Computer Vision, 2004(2): 167-181.

[17] DUAN L, WU C, MIAO J, et al. Visual saliency detection by spatially weighted dissimilarity[J]. In CVPR, 2011: 473-480.

[18] 刘文超. 基于光学遥感图像的目标检测算法的研究与实现[D]. 成都: 电子科技大学, 2010.

[19] WANG M, KONRAD J, ISHWAR P, et al. Image saliency: From intrinsic to extrinsic context[J]. In CVPR, 2011: 417-424.

[20] 刘松涛,姜康辉,刘振兴,等. 局部和全局特征融合的红外图像显著性检测[J]. 光电子·激光, 2018(3): 235-242.

[21] LIN Weisi, FANG Yuming. A Saliency Detection Model Using Low-Level Features Based on Wavelet Transform[J]. IEEE Transactions on Multimedia, 2013: 135-140.