深度分层融合超像素分割的深度视频去噪算法

韩丰泽 董文帅 张维忠

摘要: 针对传统的视频去噪方法对深度视频去噪效果不理想,导致丢失轮廓信息和深度值信息的问题,本文提出一种新的深度视频分层去噪与彩色图像超像素分割相结合的深度视频去噪算法。首先获取深度视频的深度信息,根据深度值分布,将深度视频帧分层去噪,然后将去噪后的每一深度层合并为深度帧,将与深度帧相对应的彩色帧进行超像素划分,填补去除噪声后产生的深度值空白区域的深度值,去除深度视频噪声,或根据物体周边深度值,消除并填补由物体遮挡产生的干扰噪声。实验结果表明,该算法能够消除深度视频噪声,有效解决了深度视频噪声导致画面凌乱,目标物体辨识难,无关物体遮蔽深度信息,获取深度信息困难等问题,减少噪声对公共客流统计项目的干扰,具有较好的实时性和鲁棒性。该研究在公共交通客流统计项目以及医院急诊患者数量统计项目上进行了验证,具有一定的实际应用价值。

关键词: 深度视频去噪; 分层去噪; 超像素划分; 深度值填充; 客流统计

中图分类号: TP391.413 文献标识码: A

收稿日期: 2019-07-03; 修回日期: 2019-11-29

作者简介: 韩丰泽(1994-),男,硕士研究生,主要研究方向为计算机视觉。

通信作者: 张维忠(1963-),男,博士,教授,主要研究方向为大数据学习,计算机视觉及深度学习等。Email: zhangwz_01@aliyun.com

目前,公共交通客流监控[1-2]和客流大数据分析[3-4]已成为热点研究方向,公共交通客流统计项目主要采用深度相机[5-6],采集深度信息[7-8]获取客流数据。深度视频噪声[9-10]干扰客流计数,产生计数误差等问题,因此,去除深度视频噪声对提高公共客流统计准确率具有重要意义。谭志国等人[11]提出了一种层析深度图像去噪算法,该算法利用深度信息去噪,去噪效果较好,但对去噪后产生深度值空白区域[12-13]填充效果欠佳;潘波等人[14]提出一种基于超像素的深度图修复算法,该算法利用双边滤波进行消除噪声,但容易丢失物体轮廓信息;胡天佑[15]提出一种深度视频空洞区域修复技术,修复原始视频空洞区域。基于此,本文采用深度视频分層去噪与彩色图像超像素划分填补空白深度值相结合的方法,进行深度视频去噪,并填充去噪后产生的空白深度值。通过公共客流统计项目的实际应用测试,证明该算法能够有效消除深度视频噪声,帮助客流统计系统获取有效深度信息,提高公共客流统计精度,具有较好的鲁棒性及实用性。该研究具有实际应用价值。

1 问题描述

本文处理的噪声主要分为两类:一是由深度相机获取的深度视频[16-17]中的噪声,这种噪声通常由深度相机内部传感器的误差及现实条件下光线复杂折射所引起;二是在项目实际运行环境中,环境物体产生的干扰噪声,例如公交车后门横杆会对客流统计造成影响,需要消除此类干扰噪声。针对这两种深度视频噪声,本文设计了专门的深度视频去噪方法,取得了良好的去噪效果

2 深度视频去噪方法

2.1 深度视频分层去噪与超像素分割彩色图像相结合的去噪方法

本算法主要消除由深度相机获取的深度视频噪声,即深度视频中的噪声。深度视频分层去噪与超像素分割相结合的去噪算法利用深度视频中深度信息对每一帧深度视频帧去噪,按照深度值的分布情况,将深度帧进行分层,每层进行去噪,再将去噪后的每层图像合并为完整深度帧;去噪后,噪声区域成为无深度值的空白区域,结合超像素分割彩色帧进行聚类,根据类内像素点深度值连续且相近,利用无噪声像素点求出噪声像素点深度值,填补深度帧去噪后的空白区域。

简单的线性迭代聚类[18](simple linear iterativeclustering,SLIC)超像素划分[19-20]。在CIELAB颜色空间,用五维特征向量替代彩色图像,通过调整五维特征向量距离度量标准,实现对图像像素局部聚类。SLIC算法有较好的边界粘附性、分割速度、超像素形状及聚类效果。SLIC具体实现步骤如下:

初始化种子点;在种子点的n×n邻域内重新选择种子点;在每个种子点周围的邻域内为每个像素点分配类标签;距离度量包括颜色距离和空间距离,分别计算每个搜索到的像素点和该种子点的距离;迭代优化;增强连通性,距离计算方法为

dc=(lj-li)2+(aj-ai)2+(bj-bi)2(1)

ds=xj-xi2+yj-yi2(2)

D′=dc/Nc2+ds/Ns2(3)

式中,dc代表颜色距离;ds代表空间距离;lj和li代表亮度;aj和ai代表从绿色到红色的分量;bj和bi代表从蓝色到黄色分量;xj,xi,yj,yi代表横纵坐标;Nc代表最大颜色距离;NS是类内最大空间距离,定义Ns=S=sqrtN/K,适用于每个聚类。

将图像从RGB颜色空间转换到CIElab颜色空间,对应每个像素的颜色值l,a,b和坐标x,y组成一个五维向量Vl,a,b,x,y2个像素的相似性,即可由它们的向量距离来度量,距离越大相似性越小。

大的颜色距离Nc由图片大小和聚类决定,所以用固定常数m代替,S为期望的超像素尺寸,最终的距

D′=dc/m2+ds/S2(4)

深度流结合彩色流深度视频去噪,具体实现方法及步骤如下:

1) 获取深度视频深度帧。

2) 依照深度值分布对深度帧进行分层。

3) 对每层图像进行二值化处理,将面积小于阈值的深度噪声去除。

4) 将去噪后的每层图像合并为完整深度帧。

5) 填补去噪后深度值空白区域。

6) 对与深度帧对应的彩色帧进行SLIC超像素划分,进行聚类。

7) 划分后,根据类内无噪声点的深度值计算,得到空白点的深度值。

8) 填补完毕,得到去噪后深度帧。深度视频去噪算法流程如图1所示。

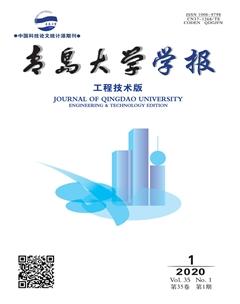

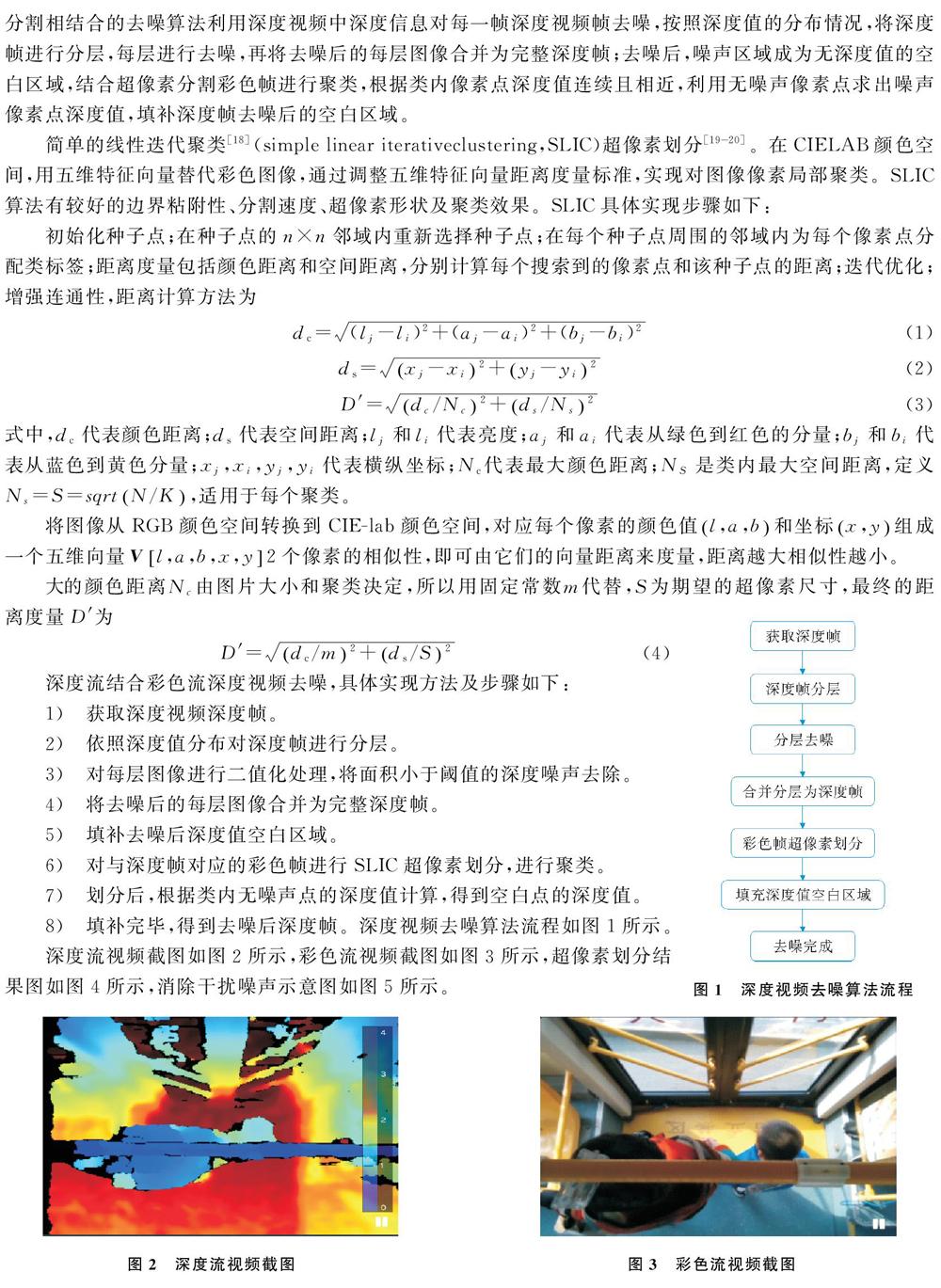

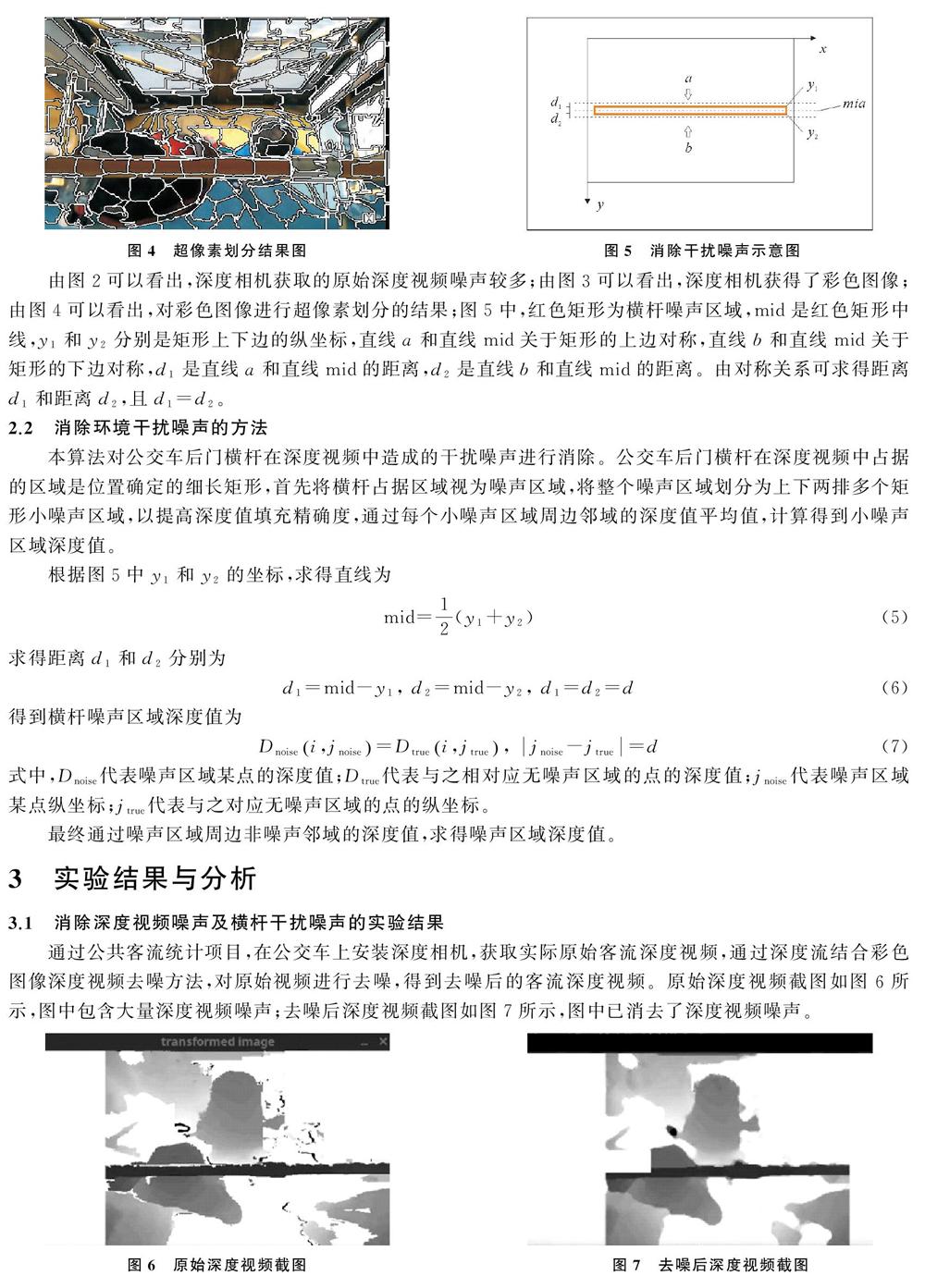

深度流视频截图如图2所示,彩色流视频截图如图3所示,超像素划分结果图如图4所示,消除干扰噪声示意图如图5所示。

由图2可以看出,深度相机获取的原始深度视频噪声较多;由图3可以看出,深度相机获得了彩色图像;由图4可以看出,对彩色图像进行超像素划分的结果;图5中,红色矩形为横杆噪声区域,mid是红色矩形中线,y1和y2分别是矩形上下边的纵坐标,直线a和直线mid关于矩形的上边对称,直线b和直线mid关于矩形的下边对称,d1是直线a和直线mid的距离,d2是直线b和直线mid的距离。由对称关系可求得距离d1和距离d2,且d1=d2。

2.2 消除环境干扰噪声的方法

本算法对公交车后门横杆在深度视频中造成的干扰噪声进行消除。公交车后门横杆在深度视频中占据的区域是位置确定的细长矩形,首先将横杆占据区域视为噪声区域,将整个噪声区域划分为上下两排多个矩形小噪声区域,以提高深度值填充精确度,通过每个小噪声区域周边邻域的深度值平均值,计算得到小噪声区域深度值。

根据图5中y1和y2的坐标,求得直线为

mid=12(y1+y2)(5)

求得距离d1和d2分别为

d1=mid-y1, d2=mid-y2, d1=d2=d(6)

得到横杆噪声区域深度值为

Dnoisei,jnoise=Dtruei,jtrue, jnoise-jtrue=d(7)

式中,Dnoise代表噪声区域某点的深度值;Dtrue代表与之相对应无噪声区域的点的深度值;jnoise代表噪声区域某点纵坐标;jtrue代表与之对应无噪声区域的点的纵坐标。

最终通过噪声区域周边非噪声邻域的深度值,求得噪声区域深度值。

3 实验结果与分析

3.1 消除深度视频噪声及横杆干扰噪声的实验结果

通过公共客流统计项目,在公交车上安装深度相机,获取实际原始客流深度视频,通过深度流结合彩色图像深度视频去噪方法,对原始视频进行去噪,得到去噪后的客流深度视频。原始深度视频截图如图6所示,图中包含大量深度视频噪声;去噪后深度视频截图如图7所示,图中已消去了深度视频噪声。

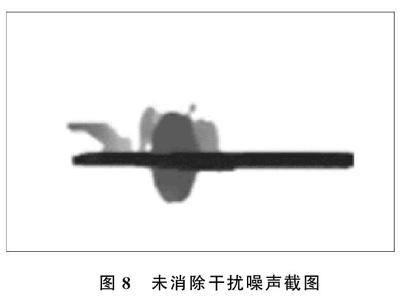

对带有横杆干扰噪声的原始客流深度视频进行截图,未消除干扰噪声截图如图8所示;对原始深度视频进行去除横杆干扰噪声,消除干扰噪声截图如图9所示。

3.2 实验结果分析及创新性

对比图6和图7可以看出,去噪后的深度视频成功消除了原始深度视频中的大量噪声,很好的填补去噪之后的深度值空白区域,实现了较好的去噪效果,有利于提高对深度视频的观察和信息提取。

对比图8和图9可以看出,消除横杆干扰噪声的深度视频,成功消除了横杆干扰噪声,较为准确的补齐噪声区域的深度值,使深度视频更加直观和清晰。该去噪算法有效利用了深度视频的深度信息,对深度视频去噪更有针对性,与传统的视频去噪方法相比,本算法去噪之后的深度视频能够有效保留物体的轮廓信息,不会导致轮廓及边缘模糊;同时,通过求解噪声区域深度值,更好的保留了深度视频的深度信息。

4 结束语

本文基于深度视频分层去噪与彩色图像超像素分割相结合的深度视频去噪算法,能够有效消除深度视频中的噪声。通过在公共客流统计项目以及医院急门诊患者数量统计项目上实验运行,运行结果表明,本算法为该项目提供了一个低噪声干扰,人体轮廓清晰,深度信息完整且正确的深度视频,提高了公共客流统计项目的乘客识别率以及医院急门诊患者数量统计准确率,该算法具有创新性和實用价值。该深度视频去噪算法,还适用于其它可以应用深度视频的项目,例如商业网点人流量统计,货物物流仓储统计等;在医疗领域,可适用于各大医院及医联体急门诊患者流水数量统计,随时评估各大医院急诊室的实时容纳能力,为120急救中心转运病人提供实时指导,为危重病人的急诊转运地点提供最佳选择,避免了因转运地点不合理造成的病情延误。在本文算法中,深度视频去噪能力还可以进一步提高,后期将研究实验更多去噪理论和方法,继续提高深度视频去噪能力,继续研究将深度视频去噪算法适配到更多实际项目。

参考文献:

[1] Irshad A, Matthew N. Dailey. Multiple human tracking in highdensity crowds[J]. Image and Vision Computing, 2012, 30(12): 966-977.

[2] Oded Cats. An agentbased approach for modeling realtime travel information in transit systems[J]. Procedia Computer Science, 2014, 32: 1-6.

[3] 刘永鑫. 基于多源数据融合的城市公交系统乘客出行模式挖掘及其应用研究[D]. 广州: 华南理工大学, 2018.

[4] 王飞. 基于视频图像处理的公交客流统计技术研究[D]. 南京: 东南大学, 2018.

[5] 宋爽, 陈驰, 杨必胜, 等. 低成本大视场深度相机阵列系统[J]. 武汉大学学报: 信息科学版, 2018, 43(9): 1391-1398.

[6] Lu X Q, Deng Z G, Luo J, et al. 3D articulated skeleton extraction using a single consumergrade depth camera[J]. Computer Vision and Image Understanding, 2019, 188: 1-13.

[7] 颉朝敏. 基于阵列相机的深度信息获取[D]. 西安: 西安电子科技大学, 2018.

[8] Kangham O, Myungeum L, Yura L, et al. Salient object detection using recursive regional feature clustering[J]. Information Sciences, 2017, 387: 1-18.

[9] 杜棋东. 基于Kinect深度信息的人体三维点云去噪方法[J]. 计算机与数字工程, 2018, 46(11): 2170-2174.

[10] 张康. 基于图像深度感知中的立体匹配和深度增强算法研究[D]. 北京: 清华大学, 2015.

[11] 谭志国, 欧建平, 张军, 等. 一种层析深度图像去噪算法[J]. 光学学报, 2017, 37(5): 94-100.

[12] 曹东华. 基于深度图像绘制中的空洞填充[D]. 重庆: 重庆大学, 2016.

[13] 胡金晖. 基于深度信息的多视点视频编码及图像增强技术研究[D]. 武汉: 武汉大学, 2014.

[14] 潘波, 范祺紅, 曹雪玮, 等. 基于超像素的深度图修复算法[J/OL]. 计算机应用研究, 2020, 37(6): [2019-06-19]. https:∥www.arocmag.com/article/02-2020-06-058html

[15] 胡天佑. 深度视频空洞区域修复技术研究[D]. 宁波: 宁波大学, 2017.

[16] 陈宝亮. 基于卷积神经网络和融合ToF与立体数据的高质量深度图获取算法研究[D]. 西安: 西安电子科技大学, 2018.

[17] 王媛媛, 刘学成, 伍凤娟. 基于双目视觉的三维重构算法实现[J]. 传感器与微系统, 2018, 37(4): 136-138, 141.

[18] 刘仲民, 王阳, 李战明, 等. 基于简单线性迭代聚类和快速最近邻区域合并的图像分割算法[J]. 吉林大学学报: 工学版, 2018, 48(6): 1931-1937.

[19] Zu B K, Xia K W, Li T J, et al. SLIC SuperpixelBased l 2, 1Norm Robust Principal Component Analysis for Hyperspectral Image Classification[J]. Sensors, 2019, 19(3): 479.

[20] Angulakshmi M, Lakshmi Priya G G. Walsh Hadamard Transform for Simple Linear Iterative Clustering (SLIC) Superpixel Based Spectral Clustering of Multimodal MRI Brain Tumor Segmentation[J]. Innoration and Research in BioMedical Engineering, 2019, 40(5):253-262.

Deep Video Denoising Method Based on Deep Stream Hierarchical Fusion of Color Images

HAN Fengzea, DONG Wenshuaib, ZHANG Weizhonga

(a. College of Computer Science & Technology; b. Emergency Department Affiliated Hospital, Qingdao University, Qingdao 266071, China)

Abstract: Aiming at the problem that the traditional video denoising method is not ideal for depth video, which leads to the loss of contour information and depth value information, this paper proposes a new depth video denoising algorithm combining depth video layered denoising and color image superpixel segmentation. First, the depth information of the depth video is obtained, and then the depth video frame is denoised according to the depth value distribution, and then each depth layer after denoised is merged into the depth frame. The color frame corresponding to the depth frame is divided into super pixels to fill the depth value of the blank area of the depth value generated after noise removal, to remove the depth video noise, or to eliminate and fill the interference noise generated by the object occlusion according to the depth value around the object. The experimental results show that the algorithm can eliminate the deep video noise. It can effectively solve the problems such as disordered images caused by deep video noise, difficult identification of target objects, depth information covered by unrelated objects, and difficulty in obtaining depth information, etc., and reduce the interference of noise on public passenger flow statistical items, with better realtime and robustness. This research has been verified in the public transport passenger flow statistics project and patient flow statistics project of emergency room,which has practical application value.

Key words: deep video denoising; layered denoising; superpixel partition; depth value filling; public flow statistics