基于深度学习的乳腺癌病理图像分类研究综述

李 华,杨嘉能 ,刘 凤,南方哲,钱育蓉

1.新疆大学 软件学院,乌鲁木齐 830046

2.新疆维吾尔自治区信号检测与处理重点实验室,乌鲁木齐 830046

1 引言

据世界卫生组织(WHO)下属的国际癌症研究中心(IARC)的统计,2012年死于癌症的人数有820万人,预计2030 年因癌症死亡的人数将达到2 700 万人[1],其中乳腺癌是女性中最常见的癌症。乳腺癌疾病的检测和诊断可以通过成像系统程序,如乳腺X线、磁共振图像、超声图像和热图[2]。癌症筛查的影像学研究已有40 多年历史[3],然而,临床上,基于病理图像的活检无疑是检测乳腺疾病的金标准[4],也是对病理图像进行准确分类时医生制订最佳治疗方案的重要依据。

目前针对乳腺癌病理图像的分类研究主要分为两类:基于人工特征的传统的乳腺癌病理图像分类方法;基于深度学习的乳腺癌病理图像分类方法。基于人工特征的传统的乳腺癌病理图像分类方法采用人工提取特征,基于这些特征使用支持向量机[5]、随机森林[6]等分类器完成分类。该方法存在高要求的专业知识、提取特征耗费时间和提取高质量特征难等缺点。相对于传统分类方法,基于深度学习[7](Deep Learning,DL)的乳腺癌病理图像分类方法,利用网络自主学习相应的特征,克服了需要专业人士手工提取特征的缺点,同时节省了人工提取特征的时间。本文将主要介绍基于深度学习的乳腺癌病理图像分类的研究。

当下,基于深度学习的乳腺病理分类方法主要采用的深度学习模型[8-11]有卷积神经网络、自动编码器、深度残差网络和密集连接网络。这些方法利用深度学习模型自学习的特点,自动提取乳腺癌病理图像的特征,实现乳腺癌病理图像的分类。一方面,其方法避免了传统算法中人工设计、提取特征的复杂性和局限性;另一方面,深度学习在自然语言处理、普通图像分类识别、物体识别等领域获得了广泛应用[12-15],为深度学习在乳腺癌病理图像分类中的应用奠定基础[16-17]。

本文针对目前主流的基于深度学习的乳腺癌病理图像分类模型进行了归纳总结。第一部分对乳腺癌病理图像分类进行简要介绍,第二部分和第三部分对基于深度学习的乳腺癌病理图像分类的相关模型进行详细论述,第四部分介绍相关数据集,根据常用的模型评价标准,在相同的数据集上对四种深度学习模型进行实验对比分析,第五部分,对乳腺癌病理图像分类的未来发展趋势进行了展望。

2 乳腺癌病理图像分类

2.1 乳腺癌病理图像分类方法概述

医学影像不同的成像方式[18]包括X 射线、组织活检、计算机断层扫描(CT)、磁性、共振成像(MRI)、正电子发射断层扫描(PET),超声等。其中,利用组织活检技术对乳腺进行穿刺得到乳腺癌病理图像。

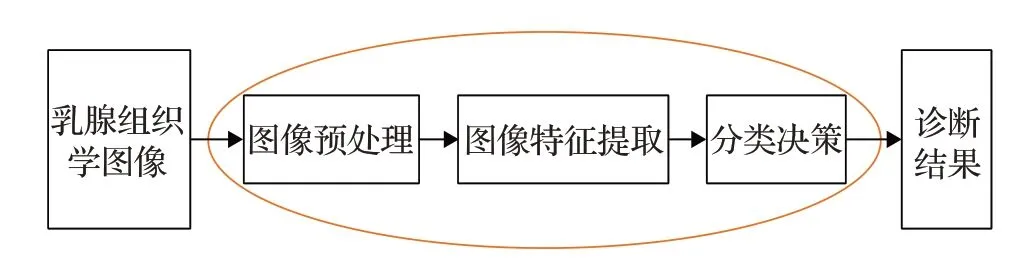

乳腺癌病理图像分类任务[19]主要是利用良性病变和恶性病变不同的纹理特征、几何特征、形态特征、光密度特征进行分析,来选择特征参数,通过反演推测不同类型的特征,实现分类的效果。图1是基于乳腺癌病理图像分类系统框架。主要研究内容包括四部分:图像预处理、图像特征提取、分类决策和诊断结果。

图1 乳腺癌病理图像分类系统框架

传统的乳腺病理图像分类方法常采用图像分割技术,如基于细胞核的分割方法,以及很多常用的图像分析算法,如分水岭算法、活动轮廓、水平集算法、K-means聚类算法以及区域生长等。通过对细胞核相关特征及核间组织形态进行分析,提取图像的形态和纹理等相关特征,使用传统的分类器,如支持向量机(Support Vector Machine,SVM)或基于特定问题设计的分类器对图像进行分类。在特征提取部分,常采用通用特征描述符,如尺度不变性特征变换(Scale Invariant Feature Transform,SIFT)、灰度共生矩阵(Gray-Level Co-occurrence Matrix,GLCM)和梯度方向直方图(Histogram of Oriented Gradients,HOG)等。

基于传统方法的乳腺病理图像分类效果的局限性在于人工设计提取的特征通常针对某种特定特性的病变类型具有良好的适应性,难以有效蕴含变化多样的病变特征,在实际应用中,分类模型的泛化能力差。

相比于传统的乳腺病理图像分类方法,基于深度学习的乳腺病理图像分类方法可以学习更具泛化性的特征表示,以适应在实际诊疗场景中,对变化多样的乳腺病理图像进行检测。

2.2 乳腺癌病理图像分类存在的问题

不同于普通图像,乳腺癌病理图像获取困难,图像信息含量大,病变类型多种多样,乳腺癌病理图像分类是一项非常有挑战性的工作,已成为当前研究的重点,主要包括以下四种:

一是由于病理图像自身固有的复杂性和多样性的特点。医学图像之间细微的差异性、细胞重叠现象、颜色分布不均匀等,给图像分类工作带来了很大的困难。主要表现在医学的相关病理特征成因复杂,图像方面的随机噪音很大以及图像断层之间的重叠,使得显微检查成为一项劳动密集型的繁琐任务,成本高,耗时久且易出现误诊问题。

二是由于缺乏大型公开的、已标记的数据集。医学图像涉及伦理,导致公用医学图像获取困难,然而利用深度学习训练模型一般需要的数据量较多,给算法研究带来一定的困难。

三是由于目前缺乏专业的病理医师。病理学家的诊断结果直接影响着后续的治疗方案,权威的病理学家需经过高度专业的训练以及丰富的阅片经验,而这些经验和专业难以继承和创新。

四是由于不同病理学家评判标准的主观性。病理切片中病理和细胞学特征评判标准的主观性和个人经验差别使得不同病理学家之间的平均诊断一致性只有大约75%。

图2 卷机神经网络概念结构图

针对上述问题,一方面,基于深度学习的方法不同于传统方法,不需要人工提取特征,降低了对专业病理医生的需求,可以利用网络不断学习图像特征,对变化多样的乳腺病理图像进行检测,这在一定程度上解决了病理图像自身固有的复杂性和多样性、缺乏专业的病理医师以及不同病理学家评判标准的主观性等问题;另一方面,面对大型公开的、已标记的数据集缺乏的问题,会给深度学习方法训练优化模型带来困难,虽然难以直接解决,但是可以利用无监督或半监督学习、数据增强以及迁移学习等方法,缓解医学数据缺乏带来的问题。总的来说,深度学习方法比传统方法更具优势,因此近年来被越来越多的研究者所采纳。

3 深度学习模型

深度神经网络的很多结构模型都被应用在医学影像中,其中对于乳腺癌病理图像分类模型应用广泛的包括卷积神经网络(Convolutional Neural Networks,CNN)、自动编码器(AutoEncoder,AE)、深度残差网络(Residual Neural Network,ResNet)和密集连接网络(Dense Convolutional Network,DenseNet)。下文就对这些模型的原理和框架进行简单介绍。

3.1 卷积神经网络

CNN在大规模图像特征表示和分类中取得了很大的成功,是神经网络中一个非常经典的模型[20-21]。在CNN[22-24]中,主要包括三种网络层:卷积层(Convolutions)、采样层(Sub Sampling)和全连接层(Fully Connected)。其典型的网络结构图如图2所示。

CNN的关键思想在于多层堆叠、局部连接、权值共享和池化。CNN 中的层与层之间不再是全连接的,而是局部连接的,这样可以大大简化模型的复杂度,减少参数的数量。CNN 能够自学习图像特征,无需专业病理医师进行人工操作复杂的特征提取,更适合应用于乳腺病理图像特征的学习与表达,目前CNN 已成为乳腺癌病理图像研究中深度学习算法的关键,且适用于多种医学问题[4],例如医学图像识别、医学分割等方面。

3.2 深度残差网络

ResNet[25]结构可以极快的加速神经网络的训练,模型的准确率也有比较大的提升,同时参数量比VGGNet[26]低。理论上在特征提取时增加网络的深度或者宽度,提取到的细节与抽象能力就越丰富,然而仅仅进行简单的层数增加操作,会出现梯度爆炸或梯度弥散的问题,传统解决方法如数据初始化(normlized initializatiton)和正则化(batch normlization)[27]操作,虽然解决了梯度问题,但是会导致网络性能退化。残差网络则克服了神经网络深度增加导致性能易退化的缺点,其主要思想是与Highway Network的思想类似,允许原始输入信息直接传输到后面一层,其结构如图3所示。

图3 残差网络结构图

ResNet 采用跳跃连接方式,能提取多层特征信息,适用于乳腺病理图像复杂性高、颜色分布不均匀、不易提取等问题且残差网络已经被广泛应用到计算机视觉[28]、图像识别[29]、行人检测[30]等相关领域的模型中。

3.3 密集连接网络

ResNet 模型的核心是通过建立前面层与后面层之间的“短路连接”(shortcuts,skip connection),这有助于训练过程中梯度的反向传播,从而能训练出更深的CNN网络。DenseNet 模型的基本思路与ResNet 一致,但是它建立的是前面所有层与后面层的密集连接[31](dense connection)。DenseNet 的另一大特色是通过特征在channel上的连接来实现特征重用(feature reuse)。这些特点让DenseNet在参数和计算成本更少的情形下实现比ResNet更优的性能。

相比ResNet,DenseNet是一种密集连接且DenseNet是直接连接来自不同层的特征图,这可以充分结合病理图像上下文信息,易于复杂的乳腺病理图像分类,能够实现特征重用,提升模型效率,其结构图如图1 所示。DenseNet 在语义切割[32]、语音识别[33]和图像分类[34]等领域都得到了广泛的应用。

图4 DenseNet结构图

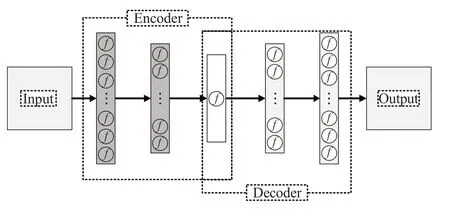

3.4 自动编码器

自动编码器是人工神经网络(Artificial Neural Network,ANN)的一种形式[35],用于无监督学习模型。AE 能够从图像数据中学习生成的表示,通过减少隐层的维数空间来构造输出层上的输入。自动编码器被广泛应用于乳腺图像分析中的检测任务,尤其是公开、已标记的医学数据集缺乏,利用无监督学习的自动编码器,适用于对缺乏的乳腺病理图像进行处理。其网络结构图如图5所示。

图5 自动编码器网络结构图

自编码技术,包括稀疏自编码(Spase AutoEncoder,SpaseAE)、栈式自编码器(Stack AutoEncoder,SAE)、变分自编码(Vector AutoEncoder,VAE)、堆叠去噪自动编码器(Stacking Denoising AutoEncoder,SDAE)等。其中,SAE[36]常用于医学图像分析,是一个由多层训练好的自编码器组成的神经网络。由于网络中的每一层都是单独训练而来,相当于都初始化了一个合理的数值,使网络更容易训练且具有更快的收敛性及更高的准确度。

4 基于深度学习的乳腺癌病理分类方法

4.1 基于卷积神经网络的方法

基于卷积神经网络的分类方法,其核心思想是利用卷积神经网络的机制,利用端到端的学习方法,输入医学图像,从医学图像底层数据中学习医学数据的特征信息,如良性病变和恶性病变不同的纹理特征、几何特征、形态特征、光密度特征,并利用损失函数不断对学习到的特性进行改进,从而使网络模型具有更好的分类效果。

Spanhol[37]等人分别测试了 LeNet[38]和 AlexNet[39]模型,将乳腺癌肿瘤分为良、恶性两种,准确率分别为72%和80.8%~85.6%。由此可得LeNet 模型结构比AlexNet简单,造成提取信息不足,导致准确率偏低。沿着改进CNN网络层数,提高分类精度的思想,Vang等人[40]提出了基于InceptionV3 模型的乳腺病理图像分类方法,其主要思想是加深网络模型的层数,通过包含多数投票、梯度提升机(GBM)和Logistic 回归的集成融合框架来进行补丁级预测,以获得图像水平预测。

虽然,在基于卷积神经网络的方法中利用增加卷积神经网络的层数以及优化各层参数,可以有效克服网络结构简单,图像特征提取能力弱的缺陷,极大程度上缓解了提取乳腺癌病理图像本身的复杂性,图像细节特征繁杂的问题,使模型达到良好的分类效果,但是随之会增加模型的训练时间以及可能会产生网络训练时的梯度消失和梯度爆炸现象。

4.2 基于深度残差网络的方法

理论上,对卷积神经网络不断加深网络层数,可以提高特征提取能力,实现较高的分类效果,但是实际上会出现梯度消失和梯度爆炸问题,导致参数易陷入局部最小的情况。深度残差网络使用捷径连接(shortcut connection)没有增加新的参数,其计算复杂度与没有残差单元的普通深度卷积神经网络基本一致,可以保持较快的计算速度,提高模型的性能。

Koné 等人[41]利用 Resnet50 模型对乳腺癌病理图像分类,取得81%的4 分类精度;Mahbod 等人[42]提出了一种新的基于ResNet 模型的方法,采用归一化苏木精-伊红染色图像作为输入,通过两个不同的ResNet的组合,先对ImageNet 图像进行了预训练,然后对乳腺病理图像进行微调,最后,利用模型最后全连接层的输出,给出最终四类疾病的预测结果。Brancati等人[43]提出了一种基 于 ResNet 的 微 调 策 略 ,将 ResNet34、ResNet50 和ResNet101三种组合在一起,利于平衡单个ResNet模型的提取特征单一弱点,取得了较好的分类效果。

基于深度残差网络的方法,利用残差结构的多层特征融合,更好地获取乳腺癌病理图像的高频细节信息且网络调整灵活、简单,简化学习目标和难度并在一定程度上解决了梯度消失或者梯度爆炸,导致网络层数过深无法训练的问题。

4.3 基于密集连接网络的方法

ResNet的提出,虽然解决了网络加深带来的梯度消失问题,通过残差块可使得神经网络的深度可以很大程度的加深,但网络也因此而变得笨拙。而DenseNet 则是在ResNet的基础上,保持分类精度不变的情况下,大大降低了模型参数量。DenseNet即解决了退化问题,也加强了特征在网络中的传递,有效提高了模型分类效果。

Li等人[44]基于DenseNet模型的方法,提出了一种新的用于病理图像分类的深度学习网络DenseNet,利用对稠密块进行无级卷积,实现多尺度特征提取,取得了93.29%的四分类精度。Makarchuk 等人[45]在利用单一DenseNet 模型的基础上,提出的一种新的基于DenseNet169和DenseNet201两种模型组合的分类方法,实验证明组合后的DenseNet分类精度比单一DenseNet更胜一筹。Kohl等人[46]研究了稠密连通卷积的适用性,并用实验对比 VGG19、Inception-v3 和 DenseNet161 三种网络模型,先分别将三种模型利用ImageNet 图像进行预训练,最后对比分类精度,DenseNet161平均精度高于VGG19和Inception-v3两个模型4%。

基于密集连接网络的方法,通过引入Dense Block结构,将多个Dense Block串联起来,使得网络获取的每层特征图都与其他层有关,达到信息流利用最大化,充分结合图像上下文信息,使得乳腺癌假阳性检测比例降低,提高乳腺病理图像特征提取能力,有效提高医学图像识别率。

4.4 基于自动编码器的方法

基于监督学习的方法,如CNN、ResNet、DenseNet,虽然在医学图像分类方面,取得了很好的成绩,但是基于监督学习的方法需要大规模的标记数据,标记的组织病理学图像是昂贵和耗时的。如果能够利用大量的未标记数据,则现有的基于监督的模型的性能可以得到明显的改善。解决这个问题的一个可行的方法,是利用非监督特征学习神经网络(如自动编码器)从大量未标记的医学图像中学习有价值的信息。

文献[47-48]中使用两个隐藏层SSAE 以无监督的方式学习乳腺癌图像表示,该方法在不考虑H&E 图像颜色信息的情况下,学习灰度图像的高级表示,然后训练一个分类器来识别图像。Feng 等人[49]提出的一种利用SDAE 从大量的图像中学习健壮的特征,使用SDAE获取组织病理学图像的高级表示。为了提高模型的识别能力,利用高层次特征和标记信息训练分类器,对模型进行了有监督的端到端的微调,对模型进行了优化。

基于自动编码器的方法,适用于只有少数标记图像和大量未标记图像的细胞分类任务,在一定程度上解决了因公开已标记医学数据匮乏导致基于监督学习的网络模型训练困难的问题,但是存在仅限于高分辨率组织病理图像识别的限制。

4.5 基于模型融合的方法

单一的网络模型,往往所提取的特征类别单一,不能覆盖所有的特征信息,采用多个模型融合的方式,可以利用不同模型的特性,分阶段提取图像特征,提高模型分类效果。

Yan 等人[50]提出了利用 Inception-v3 与 LSTM 结合的混合卷积神经网络对乳腺癌组织病理学图像分类的方法。该方法能有效综合卷积神经网络和递归神经网络的优点,并能结合图片分块间的短期和长期空间相关性。Campilho 等人[51]融合了 Resnet 与 Inception-v2模型,对乳腺癌病理图像分类,取得四类分类任务的准确率为76%。Rakhlin等人[52]提出了一种基于深度卷积神经网络的乳腺癌病理图像分类计算方法,融合了ResNet50、vgg16 和 Inception_v3 三种模型的优点,取得四类分类任务的准确率为87.2%,二分类任务的准确率为93.8%。Chennamsetty等人[53]使用了一组ImageNet预先培训的CNN 来对医疗图像进行分类。算法由一个ResNet101 和两个DenseNet161 组成,与来自不同数据标准化方案的图像进行精细协调,使用预先训练的权值初始化模型,缓解了有限数量的高质量标签数据训练网络的限制。

基于模型混合的方法可以结合不同模型的优点,构建多级特征融合,将乳腺癌病理图像中的重叠,分布不均匀等问题,利用低层的颜色、纹理等特征与高层的语义特征相结合,解决了单一模型造成的细节信息丢失的确定,提高模型的识别率且混合的模型比一般单一的模型具有更好的尺度不变性,但是存在模型设计困难和存储开销大,且模型的性能有待提高等问题。

综上所述,基于深度学习的乳腺癌病理图像分类方法通过模拟人脑抽象和迭代过程,获得对乳腺癌病理图像数据中良性病变和恶性病变图像的具体可分性的表示特征。深度神经网络可以从输入的原始乳腺癌病理图像中,学习到乳腺病变的低层特征:边缘特征和纹理特征等,结合各种卷积核组合的中间层特征,获得不断抽象的高层语义特征。基于深度学习的乳腺癌病理图像分类方法既降低了人工提取特征的困难和负担,又能获得从原始输入到高层语义的有效特征表达,提高识别效果。然而,基于深度学习的乳腺癌病理图像分类方法也存在如下问题:首先,很多算法是通过增加网络的深度以及网络的复杂度,提高神经网络的非线性表达能力,但这种方式也增加了神经网络的参数,同时目前可用的有标注的乳腺癌病理图像数据量十分有限,复杂的网络模型在训练时也会难以优化。其次,通过设计复杂的网络监督学习过程,使其更好地拟合多样化的乳腺病变特性,从而获得更具备泛化能力的特征表达形式。然而,这种改进方式同时也增加了对神经网络的训练难度,不适当的任务学习分配也会使得训练模型难以收敛。

如表1 为本文对基于深度学习的乳腺病理图像分类方法的总结。从目前已发表的相关文献可知,基于卷积神经网络的分类方法是最先用于分析乳腺癌病理图像中识别问题的深度学习方法,也是目前研究最为广泛的深度学习识别方法。相较于其他方法,基于卷积神经网络的分类方法可以更快速地提取特征,具有强大的特征表示能力。但基于卷积神经网络的分类方法缺少全局上下文信息,使得图像病变内的一些细节信息在网络前向传播过程中丢失,假阳性检测率高。此外,基于卷积神经网络的分类方法在运算速度上也稍有逊色。因此,针对基于卷积神经网络的分类方法的缺陷,后续研究者提出采用基于深度残差网络和基于密集连接网络的方法,可以更好地解决基于卷积神经网络分类方法中的问题,有效解决了梯度消失和梯度爆炸问题,并能捕捉网络中多层特征信息,弥补检测速度慢等问题,实现更快速的特征提取。但是基于深度残差网络和基于密集连接网络存在不善于探索新的医学特征、网络结构设计、模型训练以及目标函数优化困难等问题,可以尝试添加注意力模块探索新的医学特征,以及采用迁移学习方法,降低模型训练难度。基于自编码的分类方法优点在于不需要具有精准的标注信息,可以有效减少医学标注数据少以及标注不准确的问题,其难度在于如何设计有效的网络结构,如何有效地优化目标函数以及如何高效地训练模型。后续研究可探究优化模型方面以及考虑对缺乏的医学数据进行数据增强、数据迁移等方法,采用有监督的神经网络进行医学分类任务。基于模型融合的分类方法,也存在存储开销大和模型设计困难等问题,后续研究可考虑结合多个GPU 以及探究优化模型方面,这也是目前研究的热点,能结合不同模型的优点,弥补单一方法自身的局限性,达到更优的分类效果。

5 数据集及性能比较

本章首先对乳腺癌病理图像相关数据集以及分类模型的评价指标进行简要介绍,然后再对近几年基于深度学习的乳腺癌病理图像分类的相关模型进行对比和分析。

5.1 乳腺癌病理图像相关数据集

数据集在医学图像分类领域的研究中占据了重要的位置,它是衡量和比较分类算法性能的共同基础,也是推动该领域向更复杂更具有挑战性方向发展的主要力量。表2 中总结了近几年医学挑战中提出的乳腺癌病理图像公开数据集,虽然解决了早期数据集极度匮乏的问题,但若应用在深度学习的方法中,数据量依然欠缺,乳腺癌病理图像的采集问题仍是重点问题。

表1 基于深度学习的乳腺病理图像分类方法总结

表2 常见乳腺癌病理数据集

针对这一问题,解决方法一般采用数据增强[54](Data Augmentation),创建新的数据添加到原本的训练集中。通常采用八种常用的数据增强方法[55-58],分别是旋转变换、翻转变换、平移变换、对比度变换、噪声扰动、颜色增强、亮度增强、颜色扰动,实现效果如图6所示。

5.2 评价标准

采用准确率(Accuracy)、F1度量(F1-score)、精确性(Precision)、召回率(Recall)、灵敏度(Sensitivity)、特异性(Specificity)等不同的关键性能指标[68-70]对典型的医学图像分析系统进行了评价。

其中,真阳性(True Positive,TP)表示被正确识别为缺陷的病例数,假阳性(False Positive,FP)表示被错误识别为缺陷的病例数,真阴性(True Nagative,TN)表示被正确识别为无缺陷的病例数,假阴性(False Nagative,FN)表示被错误识别为无缺陷的病例数。

5.3 实验结果与分析

本节在BACH数据集和BCC数据集上对基于卷积神经网络、深度残差网络、密集连接网络、自动编码以及模型融合的乳腺癌病理图像分类方法的性能展开比较和分析,列举了近几年具有代表性的乳腺癌病理图像分类文献方法性能的实验结果以及选取了BACH数据集,训练集包括400张图片,测试集包括100张图片,分别对AlexNet、ResNet50、DenseNet121 以及 SDAE 四种模型进行实验对比和数据分析。

基于卷积神经网络的分类方法,分析了Vang等人[40]提出的基于InceptionV3 模型的乳腺病理图像分类方法。该方法不同于Spanhol 等人[37]提出的基于LeNet 和AlexNet 构建的网络结构简单,模型深度较浅的分类模型,其引入Inception结构代替单一的卷积加激活的传统操作技术,利用1×1 卷积核进行降维,解决模型计算量大的问题,网络层数比AlexNet 深很多,但参数却只是AlexNet的1/12倍。

基于深度残差网络的分类方法,分析了Brancati 等人[43]提出的一种将 ResNet34、ResNet50 和 ResNet101 三种组合在一起的分类方法,选取了具有少量参数且复杂性较低的ResNet,利用ImageNet 预先训练的权重初始化模型,减轻网络训练的问题,同时选取34、50和101不同的网络深度,融合不同层获得的特征图,很好的提高了模型的特征提取能力。

基于密集连接网络的分类方法,分析了Kohl 等人[46]提出的基于DenseNet161 的分类方法,与Brancati等人[43]提出的方法类似,为了减轻模型训练负担,先利用ImageNet 预先训练的权重初始化模型,然后对数据集中400张图像进行下采样固定网络输入尺寸,利用DenseNet块加强特征的传播且减少模型参数,在减少模型复杂度的同时提高分类精度。

基于自动编码器的分类方法,分析了Feng 等人[49],提出的一种利用SDAE 从大量的图像中学习健壮的特征,利用SDAE自学习的特点,弥补数据集不足的问题,但是对于训练集中从未出现的编码,在解码时可能会看作噪声或乱码。

最后对于基于模型融合的方法,分析了Rakhlin 等人[52]提出的融合ResNet50、vgg16和Inception_v3三种模型的分类方法,以及Chennamsetty等人[53]提出的融合一个ResNet101 和两个DenseNet161 的分类方法,这两种方法思路相通,利用不同模型的特性,获取图像抽象的细节信息,提高模型的识别率。

图6 不同数据增强方法展示图

通过表3中准确率,输入尺寸和颜色归一化的数据可以看出,乳腺癌病理图像诊断结果与模型输入尺寸选取的大小、选取策略以及是否先对图像采用颜色归一化技术有很密切的关系。总体看来,基于模型融合的乳腺癌病理图像分类方法的识别率较高于其他方法,具有较好的特征提取效果,在一定程度上可以为病理学医生提供更具准确性的参考意见。

图7为四种模型混淆矩阵的结果展示图,可视化的展示了四种模型在BACH 数据集上的分类效果,其中N、B、In、in 分别代表Normal、Benign、Insitu、Invasive 四个类别。图 A、B、C、D 分别对应 AlexNet、ResNet50、DenseNet121以及SDAE模型对四种乳腺癌类别分类的混淆矩阵图,可以看出,图A、B、C、D 有同样的问题,Normal 和Benign 类别的分类准确率普遍低于Insitu 和Invasive类别,且Normal与Benign互错分为对方类别的概率较大。可能造成这种现象的原因是Normal 和Benign的子类不仅多种多样,而且与患者的年龄密切相关。因此,在数据集数目有限的情况下临床图像很难涵盖Normal 和Benign 病理图像的足够特征。因此,最终的分类结果相对较低。

6 总结与展望

基于深度学习的乳腺癌病理图像分类是计算机领域和医学领域共同的研究重点,具有重要的理论研究意义和良好的应用前景。本文对近几年提出的基于深度学习的乳腺癌病理图像分类方法进行归纳和总结:

(1)早期基于传统方法的乳腺癌病理图像分类方法的不足,一方面,由于多利用提取图像的低层特征,难以完成对比度较低的,复杂情况的图像分类,并且传统人工设计的乳腺癌特征表示方法的局限性在于识别算法的鲁棒性不强,识别模型的泛化能力较差,往往只适用具有某一种或几种显著性特征的识别,难以涵盖变化多样的乳腺癌特征;另一方面,采用传统人工提取特征,由于医生的个人因素可能会带来误诊情况。

(2)随着深度学习网络在计算机视觉处理中取得的巨大成功,深度学习网络也备受医学界的青睐,并在医学图像分析的多个领域取得了重大进展。深度学习方法与传统方法相比具有十分明显的优势,深度网络利用了多层次结构,自动地从数据中学习并更新网络中数量庞大的神经元参数,使其具有强大的学习能力和特征表现能力。大多数的深度模型算法可以实现端到端的训练方式,使整个检测模型的训练和测试变得十分方便。目前在使用深度学习模型处理乳腺病理图像分类的方法上存在相似性,大多采用CNN、ResNet、DenseNet 和AE及几种模型融合的方式来进行图像分类。

表3 乳腺病理数据集上乳腺癌图像典型分类方法的性能对比

图7 四种模型的混淆矩阵效果图

深度学习在医学图像研究中已经取得了不错的效果,乳腺癌病理图像分类准确率也在不断提高,但距离实际临床应用还存在一定的差距。今后的研究工作可以从以下几方面展开:

(1)提高乳腺癌病理数据可用性

尽管深度学习方法能够提供更好或更高的学习效果,但深度学习技术仍存在一定的局限性,限制了其在临床领域的应用。深度学习体系结构需要大量的训练数据和计算能力。缺乏计算能力将导致需要更多的时间来训练网络,这将取决于使用的训练数据的大小。大多数深度学习模型,如卷积神经网络,都需要有标签的数据来进行监督学习,而医学图像的人工标记是一个困难的问题。

(2)降低标签注解的主观性

病理切片中病理和细胞学特征评判标准的主观性和个人经验差别使得不同病理学家之间的平均诊断一致性只有大约75%,如果可能的话,注释应该由不同的病理病理家提供,以适应主观性的变化。

(3)提高深度学习模型的可解释性

深度学习方法无论从分类效果和实际应用价值都有着无可比拟的优越性,但深度学习也常被称为“黑盒”,特别是在医学领域,与手工制作的特性不同,它提供了更直观、更适合临床医生和研究人员的透明信息。深度学习驱动的特征依赖于从大量培训数据中提取的过滤器响应,这些数据缺乏可解释性。仅仅有一个良好的分类系统是不够的,还需要利用科学的方法对模型进行合理的解释与分析。

(4)引入图像全局有效的上下文信息

目前,在乳腺病理图像分类的研究中,采用常规的基于 CNN、ResNet、DenseNet 和 AE 方法不能有效的捕获图像的上下文信息,对于提升乳腺病理图像识别精度存在困难。有效地引入图像的全局信息,也可以提升图像的分类精度。可尝试结合传统的计算机视觉方法捕获图像的上下文信息,也可结合反卷积操作以及LSTM对图像的上下文信息实现扩充。

(5)设计乳腺癌病理图像与乳腺X线图像协同合作的模型

应该设计新的结合乳腺X线和病理测量的算法,在活检获取病理图像之前,获取到乳腺X 线图像,以及两种类型的一一对应关系,以便挖掘放射学和病理图像之间的语义相互关系。

(6)将生成式对抗网络引入医学图像,以期望丰富医学图像数据

图像分析研究人员面临的主要挑战是如何访问相关的图像和数据库,为了解决乳腺癌病理图像数据缺乏的问题,不仅可借助迁移学习、数据增强等方法,还可以考虑利用生成式对抗网络,丰富医学图像数据。