无砟道床表观伤损智能识别算法研究

王宁 柴雪松 暴学志 李健超 马学志 田德柱

1.中国铁道科学研究院集团有限公司铁道建筑研究所,北京 100081;2.中铁科学技术开发有限公司,北京 100081

随着高速铁路运营时间增长,部分无砟道床出现了裂缝、离缝、掉块等表观伤损,严重影响轨道结构稳定性和耐久性。目前无砟轨道表观伤损的检测主要依靠人工巡检,受铁路检修天窗限制,夜晚光照不良,工作效率低,漏检较多,难以做到全面、有效检查。

随着图像采集、人工智能等技术的发展,图像技术逐渐应用于铁路基础设施智能检测的研究,涵盖轨道、桥梁、隧道等工程领域,例如隧道衬砌表观病害智能检测系统、车载智能轨道巡检系统、高速车载式轨道图像巡视系统等。但在无砟道床表观裂缝、掉块等表观伤损的自动识别方面还缺乏有效手段。在我国铁路运维的智能化发展趋势下,迫切需要研制面向铁路无砟道床表观伤损的智能检测识别系统,提高铁路无砟道床巡检的自动化、智能化水平。

在语义分割和卷积神经网络中有许多优秀的网络应用在混凝土裂缝的识别上[1-6]。Cha等[7]利用Region-CNN模型对裂缝、锈病等多种混凝土伤损进行检测,但由于不能得到裂缝的几何边缘,只能用于裂缝的粗检测,无法定量描述裂缝表面几何尺寸。李良福等[8]提出一种基于卷积神经网络的DBCC(Deep Bridge Crack Classify)分类模型,用于桥梁背景面元和桥梁裂缝面元的识别。瞿中等[9]提出基于融合特征图的全U型网络的裂缝检测算法,精确率比于U-net提升了1.48%。王纪武等[10]提出了基于改进Faster RCNN+ZF模型的铁路桥梁裂缝自动分类方法,在Faster R-CNN网络模型前添加一层Prewitt算子锐化卷积层,以提升模型特征提取能力。卢佳祁等[11]提出基于递进式级联卷积神经网络的方法对混凝土表面裂缝进行识别,先采用全卷积神经网络提取出含有裂缝的窗口区块作为感兴趣区域,再使用轻量化的U-Net图像分割网络作用于感兴趣区域,实现裂缝区域的精确提取。

既有研究已经提出了不同的裂缝检测技术和算法,但针对无砟道床表观伤损的检测精度和计算效率尚待验证。在我国铁路智能化运维发展大趋势下,迫切需要研究可以进行全周期全覆盖检测的无砟道床表观伤损智能检测识别系统,实现无砟轨道表面裂缝、缺损以及离缝伤损的精细化识别,满足周期性巡检以及Q/CR 803—2020《高速铁路无砟道床伤损评定》中0.1 mm的精度要求,提高铁路无砟道床巡检的自动化、智能化水平。

1 总体方案

无砟道床表观伤损识别的技术难点包括:①存在细长形和面积形伤损,形态差异大;②存在0.1 mm和100 cm伤损,尺度差异大;③图片上绝大部分是背景,裂缝图像占比小,属于细小目标特征识别;④背景复杂,存在阴影、水渍和污渍的干扰;⑤需要识别尺寸为30 000×17 000以上的不定长图片,单张图像数据量超过30 M,对内存和识别速度影响非常大。

在图像识别算法方面,主要研究方法包括传统的图像处理、机器学习以及深度学习技术。传统图像处理和机器学习依赖人工设计特征,表达能力较弱;需要复杂的人工调参过程;场景定制性强,模型泛化性较差,难以对应实际场景中的复杂情况。深度学习技术可以在大量数据的训练中自动提取最适合的特征,图像识别能力远超人类肉眼,但是离不开大规模的标注数据集。采用基于深度学习的像素级语义分割算法可以获取形态、长度和位置,符合裂缝目标小、识别要求更精细的特点。

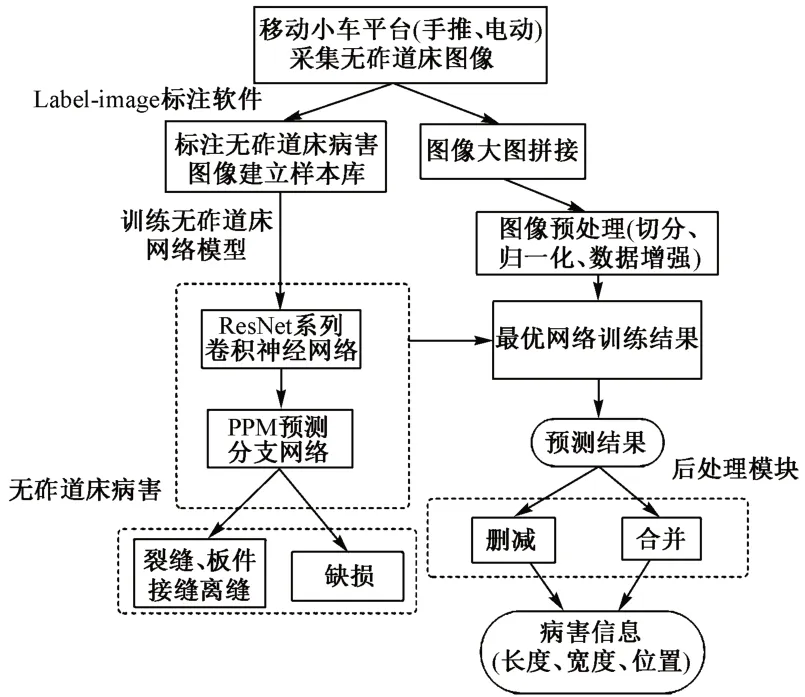

无砟道床表观伤损智能识别算法流程如图1所示,包括训练和预测两部分。

图1 伤损智能识别算法流程

训练流程:首先建立样本库,使用标注工具对每张图像进行像素级语义分割标注,建立伤损特征分布均衡且满足一定规模的伤损样本数据集,按一定比例分为训练集和验证集;然后构建基于编码-解码架构的深度神经网络伤损分割模型,将训练集的图片输入到分割模型的编码网络提取特征,再输入到解码网络中将提取的特征生成对象分割结果,持续进行模型训练;最后通过验证集对模型识别能力进行评估,找到最优的模型参数。

预测流程:首先采用图像拼接重构获取拼接大图,对图像进行预处理;再通过最优模型对现场图片进行快速检测,识别裂缝、离缝、掉块等伤损的像素级类别和位置;然后将识别结果输入到后处理模块进行删减、合并,优化识别结果;最后依据之前建立的图像尺度提取伤损几何尺寸信息,实现对无砟道床表观伤损的自动化检测、伤损趋势分析和状态评定。

2 构建样本库

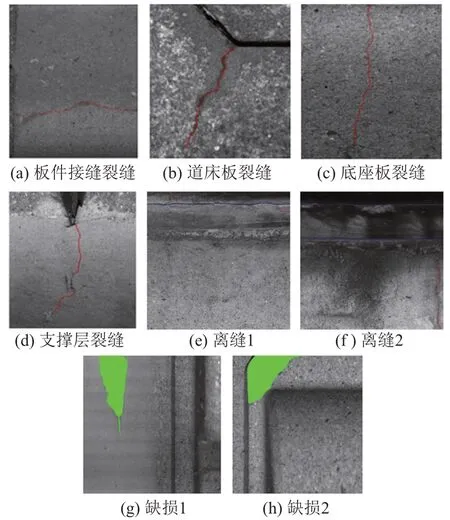

通过样本收集,目前样本库中裂缝、离缝、掉块的样本数量共约6 000个,图片尺寸为1 024×1 024。对样本库进行标注,包括两种形式。

1)利用标注工具label-image-PRIV对每张图像进行像素级语义分割标注,使用不同颜色标注伤损数据,构造伤损样本库,如图2所示。

图2 伤损样本标注示例

2)由于裂缝、离缝、掉块的颜色信息非必要特征,因此图像均转换为单通道灰度图像。背景的像素值设置为0,裂缝、掉块、离缝的像素值分别为1、2、3,这样可以提高神经网络运算速度。为了进一步增加样本和显化伤损,经过旋转、翻转、直方图均衡化、Gamma变换等方法进行数据增强。

将样本库分为训练集、验证集及测试集,其中训练集与验证集的比例为4∶1。训练集用于训练、优化模型;验证集用于验证训练好的模型的性能,选择最优参数;测试集可以测试模型的各项指标。最终窗口图像训练集6 000张,验证集1 000张,测试集2 000张。由于图像中背景区域面积大于伤损区域面积,设置正负样本比例为1∶3。

3 分割网络模型

常 用 的 语 义 分 割 网 络 有FCN、UNet、SegNet、DeepLab以及PSPNet。考虑到裂缝特征、掉块特征属于不同尺寸的特征,采用PPM结构作为分割网络的预测分支,融合4种不同金字塔尺度的特征,其中PSPNet是由ResNet101和空间金字塔池化模块组成的网络,可识别不同尺度的目标。由于ResNet101参数量较多,会导致训练速度、推理速度变慢,且对于裂缝特征,深层网络容易导致模型过拟合,因此对PSPNet网络进行修改,采用ResNet18作为分割网络的特征提取网络(主干网络),通过选取合适的编码和解码结构,最终的分割网络可以生成精确的分割图。整体结构如图3所示,其中CNN为卷积网络,POOL为池化层,CONV为卷积层,CONCAT为拼接合并层。

3.1 编码网络结构

编码网络结构是图像特征提取器,将输入图像转换为由多维特征表示。编码网络主要从图像分类网络中提取出来,只需经过简单改动就可作为分割网络的编码网络。

ResNet网络残差结构的输入参数x经过了两条支路。一条是普通的卷积网络层,用来学习输入的特征表达;另一条是捷径,直接将输入x跳过卷积网络层,即恒等映射。假设所需的映射输出为H(x),在一个残差结构里堆叠的卷积网络层来拟合另一个映射F(x)=H(x)-x,则原来的映射H(x)转化为H(x)=F(x)+x。这一转化可以通过前馈神经网络的shortcut连接来实现。

Shortcut连接就是跳过一个或者多个层简单地执行恒等映射,再将其输出与堆叠的卷积网络层的输出叠加。恒等的shortcut连接并不增加参数和计算复杂度。更重要的是,由于shortcut连接的存在,网络层数在变得很深时,梯度在从最后一层往前传时不会变得极小甚至为0,使得网络可以收敛。

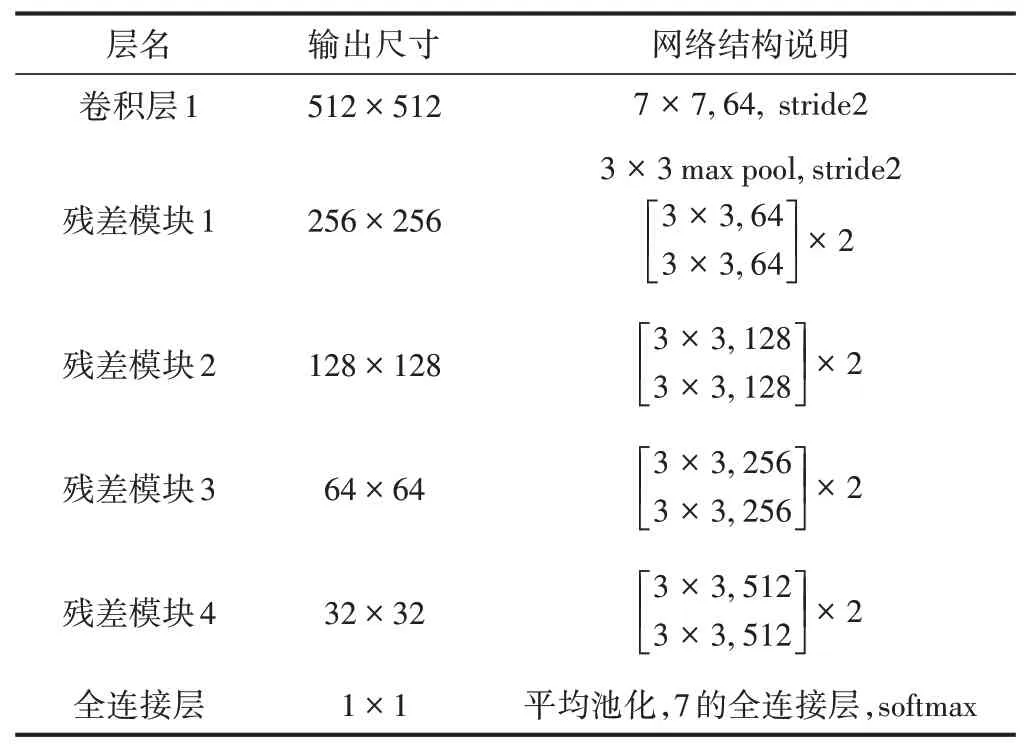

表1为ResNet18网络的详细结构,共4个残差模块,每个模块之间都进行一次下采样操作,即特征图的输出尺寸降低50%,同时输出特征图维度增加1倍。表中3×3、7×7是卷积核的大小,64、128、256、512是特征图的维度,stride2是下采样的步长。

表1 ResNet18网络结构

为了减少网络的参数,基于特征图范数的裁剪准则,提出了对ResNet18网络冗余卷积核剪枝的压缩算法。

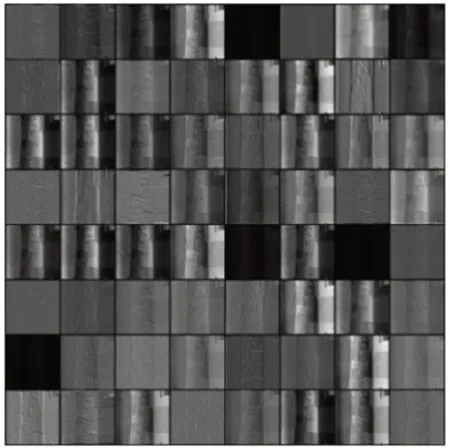

首先,基于采集的无砟道床图像提取ResNet18网络模型中的每个卷积层的特征图矩阵。编码网络提取的特征图如图4所示。

图4 编码网络提取的特征图

然后进行算法修改,步骤如下。

1)计算ResNet18网络模型中各层卷积核的特征图L1范数均值。

2)基于特征图L1范数均值的大小对卷积核进行排序,剪去L1小于预设值的冗余卷积核,记录被剪去的卷积核的原始位置,提取该卷积核在网络中的层级权值。

3)剔除该卷积核原始位置对应的参数连接值,同时对该卷积核的输入通道进行剪裁,组成新的参数连接,完成对ResNet18网络模型的冗余卷积核的裁剪。

此外,删掉了ResNet模型的全连接层,且最后两个残差模块不进行下采样,改为空洞卷积,保留图像的分辨率同时增加感受野。

对裁剪后的网络模型中的权值进行微调训练,通过反复训练、验证、调参以及优化后,得到一个性能最优的分割模型;将预处理后的图像输入到训练好的分割模型中,通过像素级的分割获得待识别区域的识别结果。

3.2 解码网络结构

解码网络结构是编码网络结构的镜像版本,主要有FCN、ASPP、PPM等等。解码网络结构是一个形状生成器,可以从卷积神经网络中提取特征生成对象分割结果,网络的最终输出是与输入图像大小相同的概率图像。在解码阶段,最重要的操作是向上采样,通过跟踪原始位置并强激活回到图像空间来捕获对象的特有结构。因此,可以有效地以更高的分辨率重建对象的详细结构。

由于伤损中的裂缝、离缝、掉块的尺度相差较大,故采用金字塔池化模块PPM网络(Pyramid Pooling Module)作为解码网络,处理不同尺度的池化特征。通过4个平行的卷积层支路来融合4个不同金字塔尺度的特征。这4个支路分别由1×1、2×2、3×3和6×6大小卷积核组成,在原始特征图上使用不同尺度的池化,得到多个不同尺寸的池化特征图,再通过双线性插值获得未池化前的大小,在通道维度上拼接这些特征图(含原始特征图),最终输出一个糅合了多种尺度的复合特征图,作为最终的金字塔池化全局特征,从而达到兼顾全局语义信息与局部细节信息的目的。

3.3 评测指标

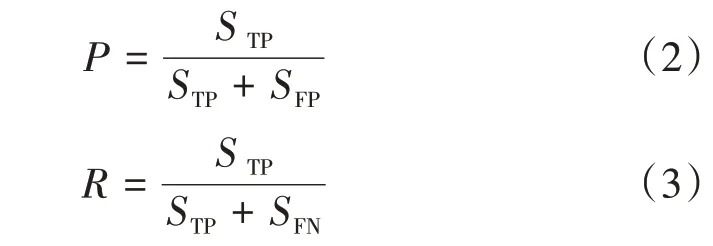

准确率是指在一定试验条件下的多个测定值中满足限定条件的测定值所占的比例。评测深度学习模型的识别效果时,采用识别准确率指标衡量,通常准确率越高,分类器越好,计算式为

将样本分为四种:TP(被模型预测为正的正样本,真正)、TN(被模型预测为负的负样本,真负)、FP(被模型预测为正的负样本,假正);FN(被模型预测为负的正样本,假负)。其中第一个字母表示本次预测的正确性,T代表正确,F代表错误;第二个字母表示由分类器预测的类别,P代表预测为正例,N代表预测为反例。四种样本的数量分别为STP、SFN、SFP、STN。显然,这4个值的和即样本总数。

查准率(Precision,又称精确率)是指在所有系统判定为真的样本中确实是真的样本的占比。查全率(Recall,又称召回率)是指在所有确实为真的样本中被判为真的占比。查准率P和查全率R的表达式为

4 试验验证

4.1 测试集试验

为了测试模型的识别准确率,利用2080ti的GPU平台,在Pytorch深度卷积网络框架下进行识别试验。

从京津城际铁路、京广铁路、石太铁路三条线路现场采集的无砟道床图像中抽取2 000个样本,包括有典型表观伤损的正样本1 500个,无伤损的负样本500个。样本尺寸为4 096×4 096。为保证样本集的质量以及裂缝特征识别效果,在图像标注集制作前进行了初步筛选,保证裂缝特征的清晰度和对比度,背景特别复杂的裂缝图像不纳入标注样本集中[12]。

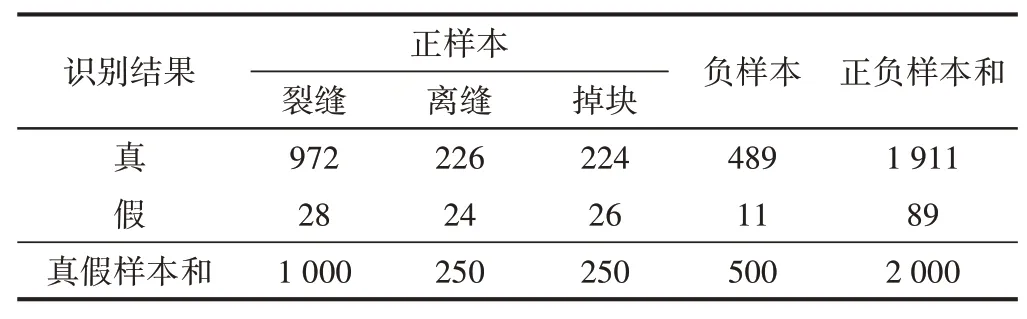

建立好的测试集用无砟道床表观伤损检测识别模型进行测试,结果见表2。

表2 无砟道床测试集测试结果

由表2可知,无砟道床识别准确率95.6%。对识别错误的样本进行分析,裂缝类表观伤损,主要由于表观受到雨水、污渍等干扰导致识别错误。离缝、掉块类伤损,主要由于形态多样,采集训练的样本数量少,模型训练学习不足,导致识别错误。部分样本的识别结果如图5所示。

图5 部分测试集样本识别结果

4.2 现场试验

将智能识别算法应用于无砟道床表观伤损检测系统,其工作流程如下。

1)人工推动轨道小车连续运行,安装在走行轮轴头的触发编码器为采集相机提供触发信号,采集相机连续采集无砟道床表观高清图像。

2)处理单元利用智能识别算法对无砟道床表观图像快速检测,识别裂缝、离缝、掉块等伤损像素级类别和位置,依据图像尺度提取伤损几何尺寸信息

3)依据Q/CR 803—2020,根据无砟道床类型、伤损部位、伤损类型以及几何特征确定伤损等级。

4)将里程、伤损等级、伤损图例、伤损数量等信息输入数据管理平台,进行智能化展示,便于历史数据查询、伤损劣化规律分析及存储管理。

在京沪线进行无砟道床现场试验。由人工对试验段无砟道床进行精确检测,并对检测出的裂缝、离缝、掉块进行测量和标注,标注出10条裂缝、8条离缝以及10处掉块,共28处。

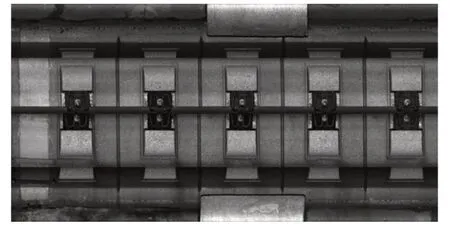

采集的图片经过图片预处理拼接后得到大图,全线等间距采样,图像按板切分,伤损定位到轨枕,如图6所示。

图6 预测大图示例

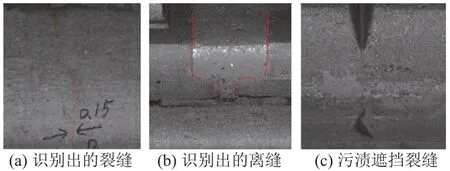

利用本文建立的识别模型进行自动识别(图7),检测像素精度优于0.1 mm,利用智能识别算法对表观伤损识别精度可达0.05 mm,其中1条裂缝由于污渍遮盖未识别出来,其余标记伤损全部检出,无砟道床表观伤损检出率为96.43%。

图7 现场验证识别效果

5 结语

本文开展了无砟道床表观伤损智能识别算法研究,创新性地构建了基于ResNet网络冗余卷积核压缩的多尺度多任务无砟轨道表观伤损智能识别模型,实现了无砟轨道伤损的大尺度预测、多任务并行处理、像素级语义分割的智能识别,识别精度达0.05 mm,满足Q/CR 803—2020的要求(0.1 mm)。该模型对2 000张测试图像的识别准确率为95.6%,无砟道床表观伤损现场检出率为96.4%,检测效果良好。

识别复杂特征干扰的无砟道床图像,特别是混合水渍、严重污渍覆盖的恶劣环境图像,是本领域的一个难点。后续更深入地研究算法理论和网络结构,建立更加丰富和数据充足的样本库,来提高复杂恶劣图像中裂缝的识别率。