基于彩色图像融合的隐藏武器检测技术

王亚杰,冉晓艳,叶永生,石祥滨( 沈阳航空航天大学 工程训练中心,沈阳 110136 )

基于彩色图像融合的隐藏武器检测技术

王亚杰,冉晓艳,叶永生,石祥滨

( 沈阳航空航天大学 工程训练中心,沈阳 110136 )

摘要:针对基于图像融合的隐藏在人衣服下面的武器检测技术存在的未充分保护人体的隐私权、色彩失真等问题,提出了一种基于模糊C均值 (Fuzzy C-means Clustering,FCM) 聚类分割的隐藏武器检测方法,该方法采用FCM聚类、数学形态学对红外图像进行武器分割与提取,并将武器融合到彩色可见光图像HSI空间的I分量中,通过逆变换得到RGB彩色融合图像。该方法的融合过程只有武器参与,避开了人身体的其他部位,保护了人体的隐私权,且融合图像维持了源可见光图像的真彩色、武器目标清晰。经过对比实验,本文方法得到的融合图像具有更丰富的信息,在主观上具有更好的视觉特性,在客观评价指标上也取得了良好的评价。

关键词:隐藏武器;模糊C均值聚类;形态学处理;彩色图像融合

0 引 言

为了及时发现犯罪分子隐藏在衣服中的武器、有效制止恐怖事件的发生,隐藏武器检测技术(Concealed Weapon Detection, CWD)成为了一个重要的研究课题[1-2]。目前主要的成像仪包括可见光成像仪、X-射线、毫米波、红外成像仪等。可见光图像能够清晰的反映人物及场景的细节和颜色信息,却看不到武器;X-射线产生的是近乎裸体的三围透视图,严重侵犯人的隐私权,明显不适合;毫米波和红外成像仪能检测到武器,却不能反映人的外在信息,只有通过图像融合技术将彩色可见光图像和红外(毫米波)图像进行融合,使融合后的图像不仅能够显示隐藏的武器,还能够展示人物及场景的细节和颜色信息,弥补了各成像仪存在的不足[3-5]。

现有的基于图像融合的隐藏武器检测方法可分基于灰度图像和基于彩色图像,所采用的融合技术可分为空间域融合算法和变换域融合算法。融合图像的目的是最大程度的保留源可见光图像的细节及颜色信息,同时包含清晰的武器目标。Blum等人[6]在去除背景的前提下使用易操纵金字塔变换、高斯金字塔变换及模糊K均值聚类算法,实现了灰度级的隐藏武器检测,得到的融合图像能够清晰的显示武器,但需要人工去除图像背景,不利于实际应用。Bhatnaga等人[7]将基于框架的人类视觉系统用于隐藏武器检测,根据人类视觉系统的特点提出了基于纹理的融合方法,实现了灰度级隐藏武器检测,该算法计算量较大,复杂度较高,且融合图像不够清晰。Cho等人[2]基于人的隐私权考虑,运用小波变换实现了隐藏武器检测,该算法对武器的提取不够准确,且融合效果也不够理想。Yang等人[8]和Zhang等人[4]提出了基于区域的图像融合算法,该算法在融合图像中融入武器的同时引入了大量的毫米波图像其他成分,融合效果明显发亮。Xue[1]和宋等人[9]分别基于小波框架和提升小波变换实现了彩色可见光图像与红外图像融合,两种方法得到的融合图像保持了可见光图像的高分辨率和自然色彩,但两种方法都反复使用了多个彩色空间变换,算法过程较复杂,融合图像中武器显示不够清晰,且图像的背景发亮,存在色彩失真的情况。

针对现有方法存在的一些不足,例如:去除背景的局限性、武器不清晰、颜色失真等,本文提出基于模糊C均值聚类图像分割的隐藏武器检测方法,该算法的融合过程只有武器参与,避开了人身体的其它部位,充分尊重人体的隐私权,而且融合图像具有可见光图像清晰细节、真彩色、无色彩失真,武器目标也清晰可见、具有可探测性。本文方法的过程比较简单,对于安全检查技术的发展具有一定的实用意义。

1 模糊C均值聚类算法

模糊C均值聚类算法[10-12](FCM)是根据隶属度进行聚类的。FCM聚类算法用于图像分割时是以图像的像素与聚类中心的加权相似性测度为依据,通过不断迭代优化目标函数,最终获得聚类的最优结果。

根据拉格朗日乘子法计算得到uij和vi如下:

模糊聚类分割图像就是通过反复迭代来确定隶属度uij和聚类中心vi,从而使目标函数J(U, V)达到最小,获得聚类的最优结果。

2 彩色图像融合算法

本文提出的基于模糊C均值聚类分割的彩色可见光与红外图像融合算法如图1所示。

本文算法的具体过程如下:

步骤1,将彩色可见光图像进行RGB到HSI的空间变换。

在HSI色彩模型中,H是色调分量,表示彩色特征;S是饱和度分量,表示彩色浓淡;I是亮度分量,表示强度。H、S、I相互之间独立,并直接近似地反映了人眼的颜色感觉特性,所以在HSI空间进行融合处理更符合人眼的视觉感受[8]。I分量用于与提取出来的武器进行镶嵌融合,H、S分量用于给融合结果图像进行彩色上色。

图1 彩色可见光与红外图像融合算法Fig.1 Color visual image and IR image fusion algorithm

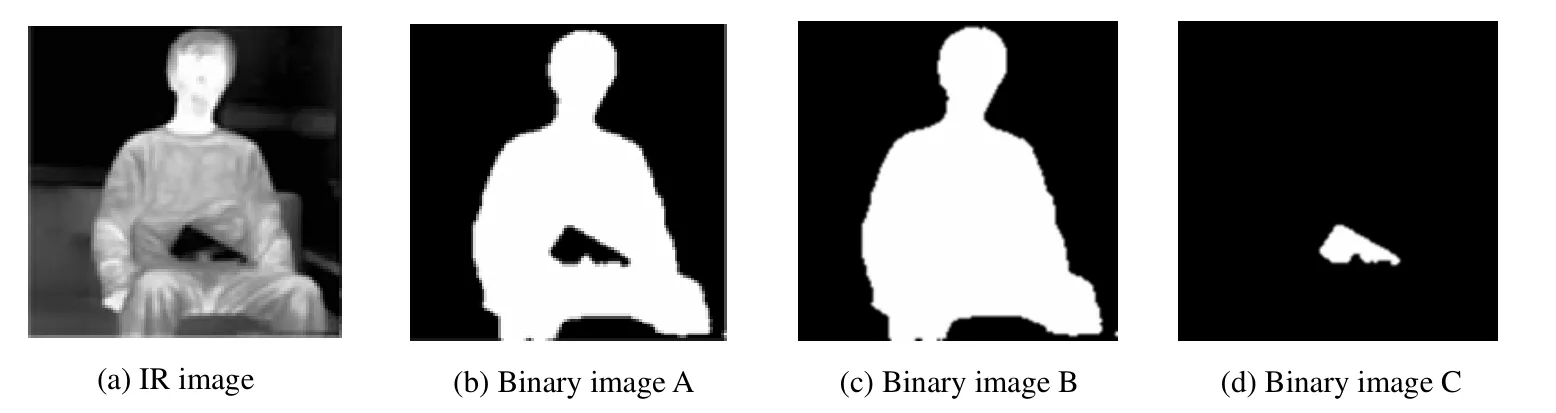

步骤2,将红外图像进行FCM聚类分割,得到二值图像A。

由于红外传感器的成像原理是热辐射成像,人的身体温度大于武器温度,导致红外图像中人身体区域比较亮,武器和背景区域相对较暗,根据以上特点,将红外图像进行FCM聚类分割,聚类数目为2类,得到二值图像A,如图2(b)所示。

图2 红外图像分割效果图Fig.2 The effect of infrared image segmentation

步骤3,对步骤2得到的二值图像A进行形态学填充孔洞处理,得到二值图像B,如图2(c)所示。

形态学填充孔洞处理主要是针对一幅标记图像fm,该图像的边缘部分的值为1-f,其余部分的值为0,即:

填充图像f上的孔洞可由参数为hholes的IPT函数fimfill执行,具体用法如下:

步骤4,武器检测主要是对比分析二值图像A和二值图像B,得到仅有武器存在的二值图像T,如图2(d)所示。具体算法如下:

步骤5,将步骤4得到的二值图像T和源彩色图像的I分量做镶嵌融合,得到灰度的融合图像,具体算法如下:设灰度融合图像为F,则

步骤6,将灰度融合图像F作为新的I分量与源彩色图像H、S分量进行组合,再变换到RGB空间,得到最终的彩色融合图像。

3 实验结果与分析

为验证本文算法的有效性,采用主观评价方法和客观评价方法对融合图像进行评价。主观评价主要以目前基于融合的隐藏武器检测技术需要达到的目标作为标准对融合图像进行评价。客观评价主要采用空间频率[14](SF)、边缘信息评价因子[15-17](QAB/F)、互信息[18](MI)评价指标和文献[19]提出的评价指标(MFAB)对灰度融合图像进行定量分析,其中:空间频率反映了一幅图像F空间域的总体活跃程度,其值越大表明图像的空间活跃程度越高;边缘信息评价因子反映了融合图像与源图像之间边缘信息的传递情况,其值越接近1,则表明边缘传递的越好;互信息表示融合图像从源图像中获取信息的多少,互信息值越大,表明获取的信息就越多,融合效果越好;MFAB是一种基于互信息的融合图像质量评价指标,该指标越大代表融合质量也越好。

实验中,本文选用两组经过配准的可见光图像和红外图像作为源图像,分别与DWT算法、NSCT算法、文献[6]算法、文献[9]算法、文献[20]算法进行比较,并截取融合图像的部分图像进行对比分析。第一组实验如图3和图4所示。

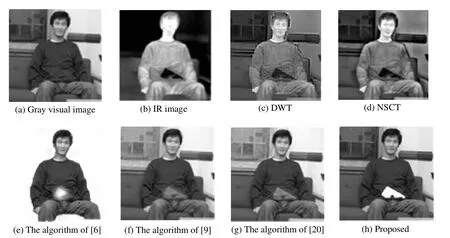

图3 第一组灰度可见光和红外图像融合结果Fig.3 The first group fused results of Gray image and IR image

图4 第一组彩色可见光图像和红外图像融合结果Fig.4 The first group fused results of color image and IR image

图3(a)、(b)是大小为144×144的灰度可见光图像和对应的红外图像;图3(c)是DWT算法得到的融合图像;图3(d)是NSCT算法得到的融合图像;图3(e)是应用文献[6]提出的在去除背景的前提下基于易操纵金字塔的方法得到的融合图像;图3(f)是文献[9]提出的基于提升小波变换的方法得到的融合图像;图3(g)是文献[20] 提出的基于双树复小波变换的方法得到的融合图像;图3(h)是本文算法得到的融合图像。

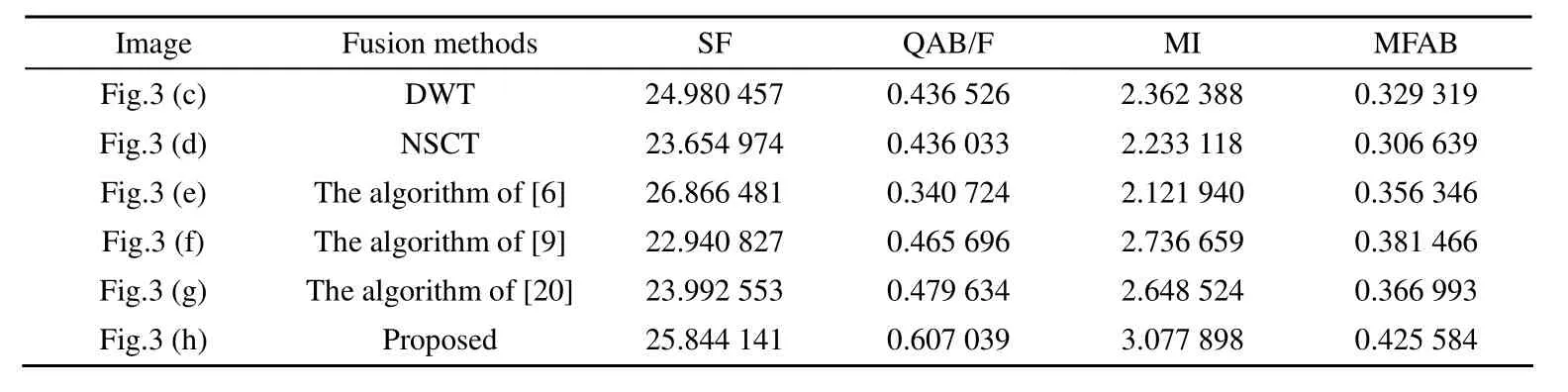

对比图3(a)、3(c)~(h)可以看出,图3(c)、3(d)融入了目标武器,但同时也融入了大量的红外图像中非目标成分,导致了融合图像较源可见光图像背景偏暗,人体部分偏亮,与源可见光图像相比整体偏差较大;图3(e)的融合效果较好,但却需要人工去除背景操作,具有局限性;图3(f)、3(g)都检测出了武器,保持了大部分人物及背景信息,但是它们的背景较源图像偏亮一些,同时检测出的武器不够清晰,这是因为两种算法使用取反的红外图像直接参与融合,该过程在突出武器的同时背景也被增强了;图3(h)在检测出武器的同时保持了所有源可见光图像的背景及人物信息,并且检测出的武器亮度较高,轮廓清晰,具有更好的视觉特性,因此,本文算法在主观视觉上最清晰。表1是各种算法的客观评价结果值,可以看出本文方法得到的融合图像大部分指标优于其它几种算法,只有指标SF值小于文献[6]方法,由于文献[6]算法是在去除背景的前提下进行的融合,即该融合图像没有背景信息,因此其SF值高于本文算法不能说明本文算法差。

表1 图3中的融合图像质量评价Table 1 Fusion effect evaluation of fig.3

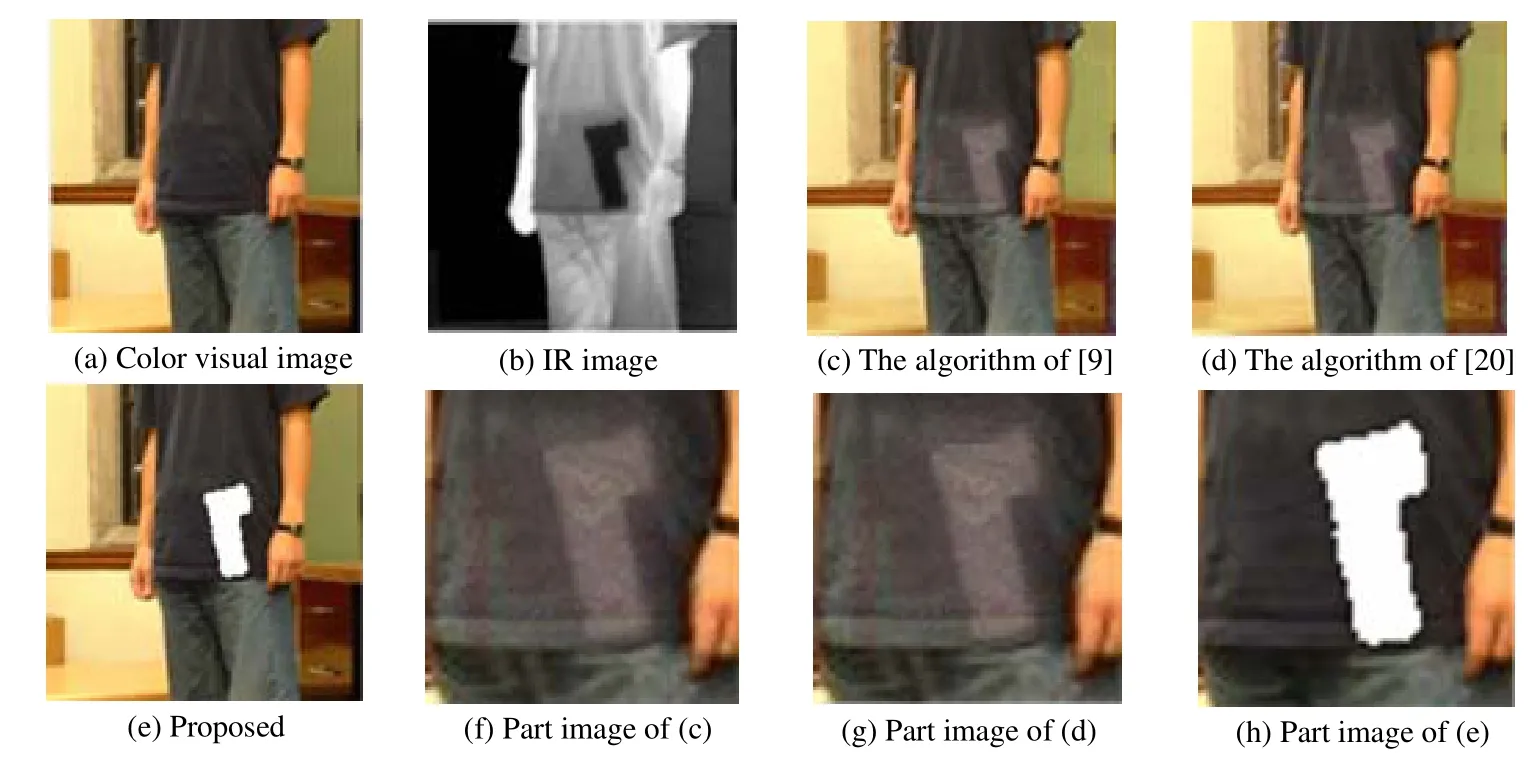

图4(a)、(b)是大小为144×144的彩色可见光图像和对应的红外图像;图4(c)是应用文献[9]方法得到的彩色融合图像;图4(d)是文献[20]方法得到的彩色融合图像;图4(e)是本文算法得到的彩色融合图像;图4(f)是图4(a)的局部图像,图4(g)~(l)是图4(c)~(e)在不同位置的局部图像。

从图4(c)、图4(d)看出,文献[9]和文献[20]算法虽然保持了可见光图像自然色彩,检测出了隐藏的武器,但与本文的融合图像图4(e)相比,色彩的真实性、细节清晰性却明显存在不足。分别将细节图像图4(g)、图4(h)、图4(i)与源图像对应部分图像图4(f)相比较,可以看出图4(i)保留了源图像的自然真彩色,而图4(g)、图4(h)与源图像相比明显偏亮,这是因为文献[9]和文献[20]两种算法将取反的红外图像与V分量直接进行融合,该过程在突出武器的同时背景部分也被增强了,导致最终融合图像背景要比源可见光图像明亮。对比图4(j)、图4(k)、图4(l)可以看出,图4(l)中检测出的武器亮度较高,轮廓清晰,便于人眼观察。

除此之外本文算法采用了对武器进行提取并镶嵌的方法,没有涉及到人身体的其他部分,融合过程中只有武器参与融合,充分保护了人体的隐私权。

为了进一步验证本文算法的有效性,我们又做了第二组实验,如图5和图6所示。

图5(a)、图5(b)是大小为144×144的灰度可见光图像和对应的红外图像;图5(c)是DWT算法得到的融合图像;图5(d)是NSCT算法得到的融合图像;图5(e)是应用文献[6]算法得到的融合图像;图5(f)是文献[9]算法得到的融合图像;图5(g)是文献[20]算法得到的融合图像;图5(h)是本文算法得到的融合图像。图6(a)、图6(b)是大小为144×144的彩色可见光图像和对应的红外图像;图6(c)是文献[9]算法得到的融合图像;图6(d)是文献[20]算法得到的融合图像;图6(e)是本文算法得到的融合图像;图6(f)~(h)分别是图6(c)~(e)的局部图像。

通过对比可以看出,在图5中图5(h)保留的源可见光图像信息最多且检测出的武器最清晰,在图6中,图6(h)不仅保留了源可见光图像的真彩色,而且武器部分相对其余两幅图像也都清晰。对比表2的四项评价指标值,本文算法得到的融合图像其四项评价指标SF、QAB/F、MI、都是最好的,且明显好于其他几种方法。

图5 第二组灰度可见光和红外图像融合结果Fig.5 The second group fused results of Gray image and IR image

图6 第二组彩色可见光图像和红外图像融合结果Fig.6 The second group fused results of color image and IR image

表2 图5中的融合图像质量评价Table 2 Fusion effect evaluation of fig.5

4 结 论

本文针对基于图像融合的隐藏武器检测技术中存在色彩失真、武器不清晰、未充分保护人体的隐私权等问题,进一步研究了基于图像融合的隐藏武器检测技术,提出了基于模糊C均值聚类的图像融合方法。该方法将红外图像中检测出的武器提取出来,同时对彩色可见光图像进行HSI空间变换,将提取出来的武器镶嵌到I分量中,然后进行颜色空间逆变换,获得RGB彩色融合图像。该融合过程只有武器参与融合,避开了人身体的其他部位,保护了人体的隐私权。另外,由于红外图像检测出来的武器嵌入到I分量的对应位置,未对其余部分做任何改变,使融合图像具有源可见光图像的高分辨率和自然真彩色,无色彩失真现象,同时融合图像中武器目标清晰,具有可探测性。通过对比实验,本文方法得到的融合图像较其他几种算法具有更丰富的信息,更好的视觉特性和客观评价指标,且该方法过程比较简单,对安全检查技术的进一步发展具有重要应用价值。由于本文方法是将武器直接镶嵌到可见光图像的I分量中,融合图像中武器看起来有点“突兀”,下一步将寻找更好的镶嵌方式,使融合图像中镶嵌的武器看起来更自然,同时,还要对更多场景的图片进行实验测试。

参考文献:

[1] XUE Zhiyun,Blum R S. Cncealed weapon detection using color image fusion [C]// Proceedings of the 6th International Conference on Information Fusion,Cairns,QLD,Australia,July 8-11,2003,1:622-627.

[2] Siu-Yeung Cho,Nanda-Pwint Tin. Using infrared imaging technology for concealed weapons detection and visualization [C]// IEEE Region 10 Annual International Conference,Fukuoka,Japan,November 21-24,2010:228-233.

[3] Uner M K,Ramac L C,Varshney P K,et al. Concealed Weapon Detection:An image fusion approach [C]// Proceedings of SPIE-The International Society for Optical Engineering,Boston,M A,United states,November 19,1996,2942:123-132.

[4] ZHANG Zhong,Blum R S. Region-based image fusion scheme for concealed weapon detection [C]// Proceedings of 31st Annual Conference on Information Sciences and Systems,Baltimore,M D,March 19,1997:168-173.

[5] YANG Jinzhang,Blum R S. Image fusion using the Expectation-Maximization algorithm and a hidden markov model [C]// IEEE Vehicular Technology Conference,Los Angeles,CA,United states,September 26-29,2004,60(6):4563-4567.

[6] Blum R S,XUE Zhiyun,ZHENG Liu,et al. Multisensor Concealed Weapon Detection by Using A Multiresolution Mosaic Approach [C]// IEEE Vehicular Technology Conference,Los Angeles,CA,United states,September 26-29,2004,60(7): 4597-4601.

[7] Bhatnagar G,WU Q M Jonathan. Human Visual System based Framework for Concealed Weapon Detection [C]// Proceedings-2011 Canadian Conference on Computer and Robot Vision,St. Johns,NL,Canada,May 25-27,2011:250-256.

[8] YANG Jinzhong,Blum R S. A Region-Based Image Fusion Method Using the Expectation-Maximization Algorithm [C]// 40th Annual Conference on Information Sciences and Systems,Princeton,N J,United states,March 22-24,2006:468-473.

[9] 宋璞. 隐藏武器检测中的图像融合技术研究 [D]. 长沙:国防科技大学,2011:40-57.

SONG Pu. Concealed Weapon Detection Research Based on Image Fusion [D]. Changsha:National University of Defense Technolog,2011:40-57.

[10] YAN Lingli,YI Shen. An Automatic Fuzzy C-Means Algorithm for Image Segmentation [J]. Soft Computing(S1432-7643),2010,14(2):123-128.

[11] ZHOU Xiancheng,SHEN Quntai,LIU Limei. New two-dimensional fuzzy C-means clustering algorithm for image segmentation [J]. Journal of Central South University of Technology(S1005-9784),2008,15(6):882-887.

[12] Quintanilla-Dominguez J,Ojeda-Magana B,Cortina-Januchs M G,et al. Image Segmentation by fuzzy and possibilistic clustering algorithms for the identification of microcalcifications [J]. Scientia Iranica(S1026-3098),2011,18(3D):580-589.

[13] Pal N R,Bezdek J C. On cluster validity for fuzzy C-means model [J]. IEEE Transactions on Fuzzy Systems(S1063-6706),1995,3(3):370-390.

[14] 高超. 图像融合评价方法的研究 [J]. 电子测试,2011(7):30-31.

GAO Chao. Research of image fusion evaluation method [J]. Electronic Test,2011(7):30-31.

[15] 胡良梅,高隽,何柯峰. 图像融合质量评价方法的研究 [J]. 电子学报,2004,32(12A):218-221.

HUN Liangmei,GAO Jun,HE Kefeng. Research on Quality Measures for Image Fusion [J]. Acta Electronica Sinica,2004, 32(12A):218-221.( )

[16] 李俊峰,姜晓丽,戴文战. 基于提升小波变换的医学图像融合 [J]. 中国图象图形学报,2014,19(11):1639-1648.

LI Junfeng,JIANG Xiaoli,DAI Wenzhan. Medical image fusion based on lifting wavelet transform [J]. Journal of Image and Graphics,2014,19(11):1639-1648.

[17] Xydeas C S,Petrović V. Objective image fusion performance measure [J]. Electronics Letters(S0013-5194),2000,36(4):308-309.

[18] Abd-el-Kader A,El-Din Moustafa H,Rehan S. Performance measures for image fusion based on wavelet transform and curvelet transform [C]// National Radio Science Conference,Cairo,Egypt,April 26-28,2011:1-7.

[19] Hossny M,Nahavandi S,Creighton D. Comments on Information measure for performance of image fusion [J]. Electronics Letters(S0013-5194),2008,44(18):1066-1067.

[20] 王亚杰,徐心和. 基于彩色图像融合新算法的隐藏武器检测研究 [J]. 中国图象图形学报,2009,14(3):520-524.

WANG Yajie,XU Xinhe. Concealed Weapon Detection Research Based on Color Image Fusion New Algorithm [J]. Journal of Image and Graphics,2009,14(3):520-524.

Concealed Weapons Detection Technology Based on the Color Image Fusion

WANG Yajie,RAN Xiaoyan,YE Yongsheng,SHI Xiangbin

( Engineering Training Center, Shenyang Aerospace University, Shenyang 110136, China )

Abstract:A detection algorithm of weapon concealed underneath person’s clothes based on Fuzzy C-means (FCM) clustering is presented, aiming at the problem of image fusion, for example, no protecting the personal privacy, no true color. The main idea of the algorithm is to segment and extract the shape of concealed weapon from the infrared image by using FCM clustering and mathematical morphology. And the weapon is embed into I component of visual image in HSI color space. At last, the image is converted into RGB color space. In this process, only the concealed weapon is participated in the fusion and the other parts of the human body are avoided, which protect the personal privacy. The fused image maintains true color of the visual image, and the concealed weapon is very clear. By comparison experiment, the results show that the fused image obtained from the proposed algorithm can preserve a large amount of information and have the better visual quality and objective evaluation index.

Key words:concealed weapons detection; fuzzy C-means clustering; mathematical morphology; color image fusion

通信作者:冉晓艳(1988-),女(蒙古族),内蒙古赤峰人。硕士研究生,主要研究图像融合。E-mail: 502363040@qq.com。

作者简介:王亚杰(1968-),女(汉族),辽宁铁岭人。教授,博士,主要研究图像融合、模式识别、机器博弈。E-mail: wangyajie@sina.com。

基金项目:国家自然科学基金资助项目(61170185);航空科学基金资助(2015ZC54008)。

收稿日期:2015-04-15; 收到修改稿日期:2015-05-08

文章编号:1003-501X(2016)02-0062-07

中图分类号:TP391

文献标志码:A

doi:10.3969/j.issn.1003-501X.2016.02.011