基于深度残差的多特征多粒度农业病虫害识别研究

李艳红 樊同科

摘要:为了实现复杂农田背景下的病虫害识别,提出了一种基于深度残差学习的多特征多粒度农业病虫害识别方法。结果表明,与传统SVM和BP神经网络相比,该算法在复杂农田背景下的病虫害图像识别精度明显提高。在复杂农田背景下10种作物病虫害图像的分类问题上取得了98.67%的精度。该算法具有很高的实际应用价值,可以与当前使用的农业联网系统集成到实际的农业病虫害防治中。

关键词:深度残差;多特征多粒度;农业病虫害;识别

中图分类号:TP391.4; S435 文献标识码:A

文章编号:0439-8114(2020) 16-0153-05

DOI: 10.14088/j.cnki.issn0439-8114.2020.16.035

农业病虫害对农作物的生长和农产品的储藏构成了严重威胁。单纯依靠低速、低效的人工识别无法满足实际需要,并且会造成较高的人工成本。近年来,农业信息化发展迅速,通过高清相机可以更方便地在农田中获取农业病虫害图像。基于计算机视觉的图像识别技术能够有效降低识别成本,识别速度和效率都有明显提高。与样本照片相比,从农田获得的实际图像往往具有较高的背景噪声。若不进行特征预处理,传统的机器学习分类方法如SVM和BP神经网络不能达到令人满意的准确率。农田环境复杂,很难选择出适合所有病虫害的一般特征。近两年来,深度学习技术发展迅速,深卷积神经网络(Convolutional neural networks,CNN)已应用于图像识别领域,如街景识别、车辆检测、人体运动识别、音视频识别,均取得了很好的效果1-3]。CNN具有自动提取图像特征的能力,因此可作为一般特征提取工具应用于农田环境中的农业病虫害识别。为了防止深层神经网络的退化,提高深层卷积神经网络模型的训练质量,有必要采用深层残差学习。因此,在研究深度卷积网络的基础上,提出利用深度残差的多特征多粒度技术,建立一个复杂背景下的农田病虫害图像识别系统。该系统具有较强的鲁棒性,能够识别出具有同化色素的病虫害,并能进行端到端的训练,更适合于農业生产。

1相关研究

近年来,基于计算机视觉的农业病虫害识别研究一直是热点冋题,许多病虫害识别系统被提出。Larios等[4]提出了一种基于SIFT的特征学习方法,并构造了特征直方图对石蝇幼虫图像进行分类。Zhao等[5]研究了基于粗糙集和模糊C-Means聚类的甘蔗棉蚜病虫害图像识别。Zhao等[6]通过分析昆虫翅膀的颜色直方图和灰度共生矩阵,建立了昆虫自动分类系统。Faithpraise等[7]提出了一种基于k-Means聚类和对应滤波器的植物病虫害识别系统。Xie等[8]使用稀疏编码的空间金字塔识别农田病虫害图像。与早期的SVM和神经网络方法相比,提高了背景病虫害图像的识别精度。为了进一步提高昆虫的识别能力,Xie等[9]开发了一种基于多任务稀疏表示和多核学习技术的昆虫识别方法。上述方法中都需要对病虫害图像进行复杂的预处理,并且模型的性能往往受到所选特征的影响。大多数病虫害图像样本都具有统一背景的图像,或需要去除背景或进行二值化。通过卷积神经网络,可以实现具有背景的病虫害图像端到端的训练,从而简化了训练过程。

2病虫害图像识别

神经网络是解决线性不可分问题的良好分类器,并且在网络结构上取得了许多进展,以提高分类或聚类的性能。在处理图像分类问题时,较好的模型是卷积神经网络。近年来,神经网络已经在图像识别领域被广泛并且成功地应用,在该背景下,通过优化深度卷积网络结构,利用深度残差网络的多特征多粒度学习,构建农业病虫害图像识别模型,并通过试验与传统机器学习模型对比,以验证方法的有效性。

2.1卷积网络的结构

卷积神经网络的基本结构如图1所示,基本卷积神经网络包括输入层、卷积层、池层、全连接层、Softmax分类和输出层。在某一层的卷积过程中,滤波器在该层上滑动,其权值矩阵与滤波器下像素的值进行Hadamard乘积。

式中,b表示一个偏移项,f表示一个激活函数的情况下,一般的神经网络通常使用范围为[-1,1]的s形函数或双曲正切函数。

随着网络深度的增加,梯度容易消失或爆炸。Krizhevsky等[10]提出了Relu激活函数。池层的工作过程是向下采样,包括最大池和平均池方法。该过程可以表示为:

在合并过程中,允许指定大小的窗口在某一层的要素地图上滑动。如果使用最大池,则窗口中的最大值将被保留;如果使用平均池,则窗口中的平均值将被保留。处理多分类问题的卷积神经网络的顶端通常使用Softmax分类器。在Softmax回归中,输入X属于T类的概率可以由以下方程表示:

损失函数为输出概率向量与实际类向量的交叉熵损失。

其中,1{yi=t}表示指示性函数,只有在测试的第i个图像正确时,它的值才等于1,对损失函数采用随机梯度下降法进行端到端优化。损失函数的梯度可用下列公式计算:

2.2基于卷积网络的特征提取

卷积神经网络具有自动提取特征的能力,并通过卷积神经网络中水平的可视化,清楚地显示所提取的特征[11-13]。图2显示了通过卷积神经网络的病虫害图像的特征。图像中这些病虫害的边界通过普通CNN的第一卷积和汇集层被激活,从而从复杂的背景中分离出来。可视化图像表明,CNN具有很强的特征提取能力。

2.3卷积网络的性能对比分析

在实际农田环境中,采集到的图像具有复杂的背景噪声,不同于固定背景色样本的图像,在复杂背景下具有较高的难度和实际意义。选择10种病虫害作为研究对象(表1),图3显示了病虫害生物的外观。

每类病虫害图像随机抽取40幅图像作为训练集,15幅图像用于测试。数据集包含不同的角度和病虫害的姿态,这些图像在输入系统之前都被镜像,使数据总量翻倍,以充分利用CNN。在训练之前,使用了象素平均减法。

x*=x-u (6)

式中,u表示訓练集上每个通道中像素值的均值,并且从病虫害图像的RGB通道的像素矩阵中减去均值。

试验条件设置如表2所示,以caffe为深度学习框架,采用GPU加速技术提高训练速度。

在相同的环境和数据集下,对CNN模型(本研究采用AlexNet架构的CNN模型)、传统神经网络和线性支持向量机进行了测试。在传统神经网络中,隐层神经元的数量为3 072, Sigmod用作激活函数,最后使用Softmax作为最终分类器。所有输入的病虫害生物图像都伴随着自然环境中的复杂背景,每个模型的识别精度如图4所示。CNN的识别准确率远远超过了其他传统的机器学习方法。

各模型收敛后的识别精度如表3所示。线性支持向量机和传统神经网络的精度均在50%以下,而基于AlexNet架构的CNN模型精度是传统BP神经网络的两倍。结果表明,深卷积神经网络在复杂农田背景下的图像分类中明显优于支持向量机和简单的浅层BP神经网络。不过,8层AlexNet的CNN模型的识别率仅为88.67%,其识别能力仍无法达到令人满意的状态。

2.4卷积网络降解的局限性分析

随着深度的加深,模型的识别能力增强。但简单地增加神经网络的深度会使模型很难训练,并且精度会突然下降。因此,针对这一问题,必须寻找一种新的深度学习方法,同时增加模型的深度也应抑制退化的发生。

基于AlexNet的8层深度来简单地增加层次的深度,将其深度从9层增加至11层。该模型在同一环境下分别迭代2 000次,降解现象的发生如图5所示。

3深度残差的多特征多粒度学习

随着网络深度的加深,并非所有的模型都能得到训练和优化。对于退化现象,提出了一种称为深度残差的优化方法。该方法通过叠加一个多层非线性网络来融合一个残差映射,然后表达实际映射关系。在深度残差网络中,可以通过添加一个快捷连接来实现身份映射,防止了深度模型的误差扩大,其结构如图6所示。

采用50层和101层深度残差网络对农业病虫害进行识别训练。模型在resnet101和resnet50上进行了微调,并在Imagenet上进行了预训练。基本学习率为0.0001。使用步骤策略训练,每500次迭代后学习率降低90%。采用加权衰减法,将衰减参数设为0.000 5,采用随机梯度下降法进行优化,将动量参数设为0.9,将总迭代次数设为2 000次。

表4显示了试验中硬件消耗的3种模型,其中AlexNet每次输入使用128个图像,resnet-50和resnet-101每次使用8个输入(表5)。

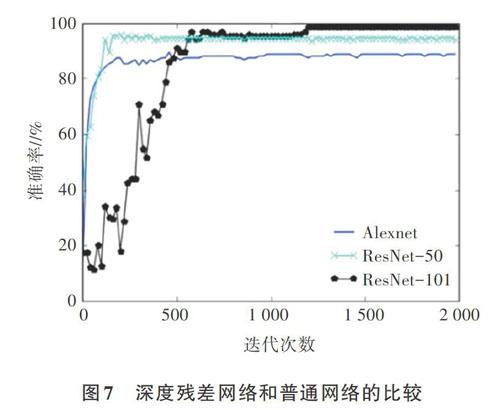

图7比较了深度残差网络和普通CNN的精度的变化。表5显示了本研究数据集中的普通卷积神经网络AlexNet模型和深度残差网络ResNet的精度比较。结果显示,基于深度残差学习的ResNet101模型的识别准确率为98.67%,明显高于CNN。同时,通过分析普通卷积模型AlexNet和深度残差模型ResNet的模型收敛过程,对比二者的性能差距,发现AlexNet更易出现卷积降解问题,模型较早收敛于局部解,不能进一步提升精度。相对于普通卷积网络AlexNet,深度残差网络ResNet随着网络深度的提升,精度进一步提高,更加接近最优解。

4结论

采用深度残差的多特征多粒度学习方法对复杂农田背景下的农业病虫害进行识别。该方法精度远远高于SVM和BP神经网络。与CNN相比,识别精度进一步提高。对于复杂背景下10种农业病虫害,识别率达到98.67%。同时,深度残差网络可以作为基础组件,与目标检测跟踪架构模型(如R-CNN[14]或R-FCN[15])相结合,以跟踪农业病虫害目标,并通过农业网络监控视频实现害虫目标位置信息的实时采集。此外,需要考虑Android或IOS等移动平台的可移植性,使该方法能够在智能移动终端中应用,提供更高的实用和推广价值。

参考文献:

[1] CHEN X, XIANG S, LIU C L, et al. Vehicle detection in satelliteimages by hybrid deep convolutional neural networks[J]. IEEE geo-lienee and remote sensing letters,2014, 11 ( 10): 1797-1801.

[2] JI S, XU W, YANG M, et al. 3D Convolutional neural networks forhuman action recognition [J]. IEEE h,ansactions on pattern analysisand machine intelligence, 2013, 35( 1) :221-231.

[3]ABDEL-IIAMID O, MOHAMED A R, JIANG H, el al. Convolu-tional neural networks for speech recognition [J]. IEEE/ACM trans-actions on audio, speech, and language processing, 2014,22(10):1533-1545.

[4] LARIOS N , DENG H , ZHANG W , et al. Automated insect identi-fication through concatenated histograms of local appearance fea-tures [C]// IEEE workshop on applications of computer vision.IEEE, 2007.

[5] ZHAO J, LIU M, YAO M. Study on image recognition of insect pestof sugarcane cotton aphis based on rough set and fuzzy c-meansclustering [C]// 2009 Third international symposium on intelligentinformation technology application. IEEE, 2009.

[6]ZHAO Z Q,GAO J,GLOTIN H,et al. A matrix modular neuralnetwork based on task decomposition with subspace division byadaptive affinity propagation clustering [J]. Applied mathematicalmodelling,2010, 34( 12):3884-3895.

[7] FAITHPRAISE F, BIRCH P, YOUNG R,et al. Automatic plant pestdetection and recognition using k-means cluslering algorithm andcorrespondence filters [J]. International journal of advanced biotech-nology & research, 2013,4(2) : 189-199.

[8] XIE C,LI R,DONG W,et al. Recognition for insects via spatialpyramid model using sparse coding [J]. Transactions of the Chinesesociety of agricultural engineering, 2016, 32( 17) : 144-151.

[9] XIE C J, ZHANG J, UR, et al. Automatic classification for fieldcrop insects via mulliple-task sparse representation and multiple-kernel learning [J].Computers & electronics in agriculture,2015,119:123-132.

[10]KRIZHEVSKY A,SUTSKEVER I,HINTON G. ImageNet classi-fication with deep convolutional neural networks [C]// NIPS. Cur-ran Associates Inc. 2012.

[11]GOODFELLOW I J,BULATOV Y,IBARZ J,et aL Multi-digitnumber recognition from street view imagery using deep convolu-tional neural networks [J]. http:/www. researchgate. net/publica-tion/259399973.

[12]HUBEL D H, WIESEL T N. Republication of the journal of physi-ology (1959) 148,574-591 : Receptive fields of single neuronesin the cat's striale corlex. 1959. [J].Journal of physiology,2009,587(12):2721-2732.

[13]LECUN Y, BOTTOU L, BENGIO Y, et al. Gradient-based learn-ing applied to document recognition [J]. Proceedings of the IEEE,1998, 86(ll):2278-2324.

[14]REN S, HE K, GIRSIIICK R, et al. Faster R-CNN: Towards real-time objectdetection with region proposal network [J].IEEE trans-actions on pattern analysis & machine intelligence, 2015, 39(6):1137-1149.

[15]COATES A, BAUMSTARCK P, LE Q, et al. Scalable learning forobject detection with GPU hardware [C]// IEEE/RSJ internationalconference on intelligent robots & systems. IEEE, 2009.

收稿日期:2019-12-12

基金項目:陕西省2019年重点研发计划项目(2019NY-055);陕西省教育科学十三五规划课题(SGHI8H538)

作者简介:李艳红(1978-),女,陕西武功人,讲师,硕士,研究方向为大数据、教育技术,(电话)18092318233(电子信箱)178653954@qq.com。