“资源一号”02D卫星多波段图像融合

李俊杰 傅俏燕 姜涛

“资源一号”02D卫星多波段图像融合

李俊杰 傅俏燕 姜涛

(中国资源卫星应用中心,北京 100094)

图像融合方法同时保持全色图像空间细节和多光谱图像的光谱信息是一个挑战,特别是对于全色和多光谱图像光谱范围部分重合或不重合的波段,或者是波段数较多的多光谱图像,一些融合算法不能较好的支持。针对“资源一号”(ZY-1)02D卫星的全色图像和8波段多光谱图像,对结合光谱响应函数和全局方差匹配的遥感图像融合方法做了适度扩展,并将扩展后的融合方法首次用于ZY-1 02D卫星多个区域的图像融合,并与商业软件使用的效果较好的主流融合方法的结果进行了定性和定量的比较与评价,结果表明:该融合方法空间细节和光谱保持都较好,可用于ZY-1 02D卫星多波段图像融合。

光谱响应函数 图像融合 多波段图像 “资源一号”02D卫星 遥感图像

0 引言

依据美国忧思科学家联盟(Union of Concerned Scientists,UCS)2020年4月发布的数据[1],有2 666颗卫星在太空中运行,其中超过700颗是对地观测遥感卫星。大多数遥感卫星,特别是商用遥感卫星一般都带有一个高分辨率的全色(High Resolution Panchromatic,HRP)相机和一个低分辨率的多光谱(Low Resolution Multispectral,LRM)相机。HRP图像空间分辨率高,但光谱分辨率低,LRM图像则正好相反。图像融合可以结合HRP和LRM图像各自的优势,得到高空间分辨率和高光谱分辨率融合图像。融合图像提高了全色和多光谱图像的使用价值,被广泛应用于资源调查、变化监测、生态保护等领域。

图像融合方法有多种,Javan把图像融合分为四类[2]:1)分量替换[3-5](Component Substitution,CS)方法,CS方法先对LRM图像进行变换,然后把变换后得到的某一个分量用HRP图像替换,最后再逆变换得到融合图像;2)多分辨率分析[6-7](Multi-resolution Analysis,MRA)方法,基于小波分析和拉普拉斯金字塔,将高频分量注入多光谱波段得到融合图像;3)组合方法[8-11],结合CS和MRA方法各自优势,组合使用得到融合图像;4)基于变分优化[12-14](Variational Optimization-based,VO)方法,包括层次贝叶斯模型、稀疏矩阵分解模型融合等,这些方法直接或间接基于变分模型的优化。图像融合既保持全色图像的空间细节,又保留多光谱的光谱信息,对于大多数融合方法,同时较好的做到这两点很困难,一般是空间细节保持好,但光谱发生扭曲,或者相反。

“资源一号”02D(ZY-1 02D)卫星提供全色和8波段的多光谱图像,其图像融合在实践中存在如下问题:1)光学遥感卫星“快鸟”(Quickbird)、“高景一号”、“高分二号”和“资源三号”等的传感器一般配置为全色和4波段的多光谱相机,类似ZY-1 02D卫星携带8波段多光谱相机的情况较为少见。现有的融合方法大多是针对4波段多光谱和全色图像的融合进行测试和评价,虽然有文献对美国的WorldView-2/3卫星8波段的多光谱图像不同融合方法的有效性进行了比较和评价[15-18],但是对全色和8波段多光谱图像融合的有效性评价较为薄弱且不充分。2)有些融合方法并不支持多光谱8波段图像融合,例如Intensity Hue Saturation(IHS)、Brovey融合方法等。3)ZY-1 02D卫星8个多光谱波段中有2个波段的光谱范围与其全色波段的光谱范围存在较小重叠,融合结果易出现光谱扭曲。

针对ZY-1 02D卫星图像8波段多光谱数据和全色数据特点,对文献[19]提出的结合光谱响应函数和全局方差匹配的遥感图像融合方法做了适度扩展,将扩展后的方法首次用于ZY-1 02D全色图像和8波段多光谱图像的融合,并与商业软件使用的效果较好的主流融合方法Gram-Schmidt(GS)和Nearest Neighbor Diffusion(NNDiffuse)进行定性和定量的对比分析,从空间细节、光谱信息保持以及总体的均衡性方面对融合图像结果进行评价。

1 测试数据和研究区域

1.1 测试数据

融合所用的测试数据为ZY-1 02D卫星全色和8波段多光谱图像。ZY-1 02D卫星可有效获取115 km幅宽的9波段全色多光谱数据,其中全色波段空间分辨率2.5m,光谱范围为450~902nm,8个多光谱波段空间分辨率为10m,光谱范围为416~1 047nm。

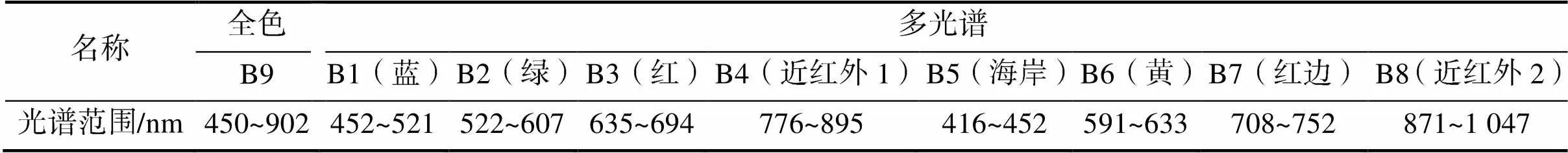

ZY-1 02D卫星的全色多光谱波段设置与美国发射的亚米商业遥感卫星WorldView-2(WV-2)类似,除了常规的全色、蓝、绿、红和近红外波段之外,增加了海岸、黄、红边和另一个近红外波段。不过ZY-1 02D的全色波段光谱范围要比WV-2宽约100nm,ZY-1 02D卫星全色和多光谱波段的光谱范围见表1。

ZY-1 02D测试图像已经过正射校正,全色和多光谱图像配准误差小于1个像元。

表1 ZY-1 02D全色多光谱图像波段光谱范围

Tab.1 The spectral range of ZY-1 02D panchromatic and multispectral image bands

1.2 研究区域

为了验证融合算法的稳定性和有效性,选取中国山东东营市和上海市作为遥感图像融合测试的研究区域。研究区域的地表覆盖类型有人造地表、耕地、林地、草地、水体等。两个研究区域主要地表覆盖类型分别为耕地和人造地表,遥感图像大小均为10 000像元×10 000像元(全色图像),对应面积为625km2(25km×25km)。ZY-1 02D东营市区域图像的成像日期为2020-07-24,上海区域图像的成像日期为2020-04-23。

2 图像融合方法

2.1 结合SRF_VAR融合方法

结合光谱响应函数和全局方差匹配的遥感图像融合(Spectral Response Function and Variance Matching,SRF_VAR)方法属于分量替换融合方法。该方法基于通用分量替换融合框架,使用全色和多光谱传感器的光谱响应函数反映的辐射能量响应的比例关系来构造强度分量,其数学表达式[19]为:

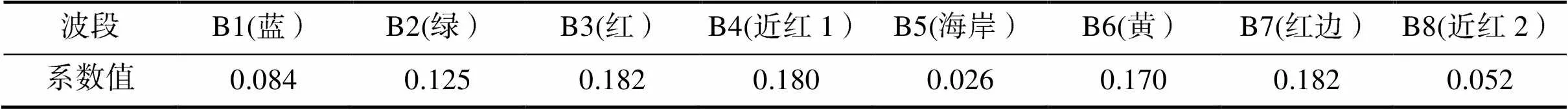

表2 ZY-1 02D多光谱模拟全色的各波段权重系数

Tab.2 The weight coefficients of each band in multispectral simulation of ZY-1 02D panchromatic images

2.2 GS融合方法

GS融合方法最早由Laben提出[20],该方法能保持融合前后图像光谱信息的一致性,融合波段数不受限制,是一种高保真的遥感图像融合方法。GS融合方法首先从低分辨率的多光谱波段中模拟合成出 一个低分辨率全色波段;然后对模拟出的全色波段和多光谱波段进行Gram-Schmidt变换;最后用高空间分辨率的全色波段替换Gram-Schmidt 变换后的第一个波段,应用Gram-Schmidt反变换得到最终的融合图像。

图1 ZY-1 02D全色和多光谱传感器的光谱响应函数曲线

2.3 NNDiffuse融合方法

NNDiffuse融合方法最早在文献[21]中提出,其基本假设是:高分辨率融合图像中的每个像元光谱值都是低分辨率光谱图像中相邻超像素光谱值的线性加权组合。该方法对图像的波段数没有限制,融合结果图像的色彩、纹理和光谱信息相对原始全色和多光谱图像,都能得到很好保持。NNDiffuse融合方法的成果图像城市区域效果好,但是当全色图像对比度较低时,融合图像有时会在目标边缘出现光谱溢出[21]。

3 融合结果与分析

对数十景不同区域、不同天气条件(云/雾)的ZY-1 02D图像使用本文方法进行融合,融合结果目视良好稳定,未出现异常。本文测试图像为ZY-1 02D山东东营市和上海市区域的图像,分别采用SRF_VAR、GS和NNDiffuse三种融合方法得到对应的融合图像。其中SRF_VAR融合方法使用Python编程实现,GS和NNDiffuse融合分别采用商业遥感软件ENVI5.2对应的图像融合功能实现,参数采用其默认设置。用定性和定量两种方式对融合结果图像进行评价。定性评价展示的图像大小为384像元×384像元,为10 000像元×10 000像元融合图像的子区,定量评价计算使用的是整幅的东营市和上海市测试图像。

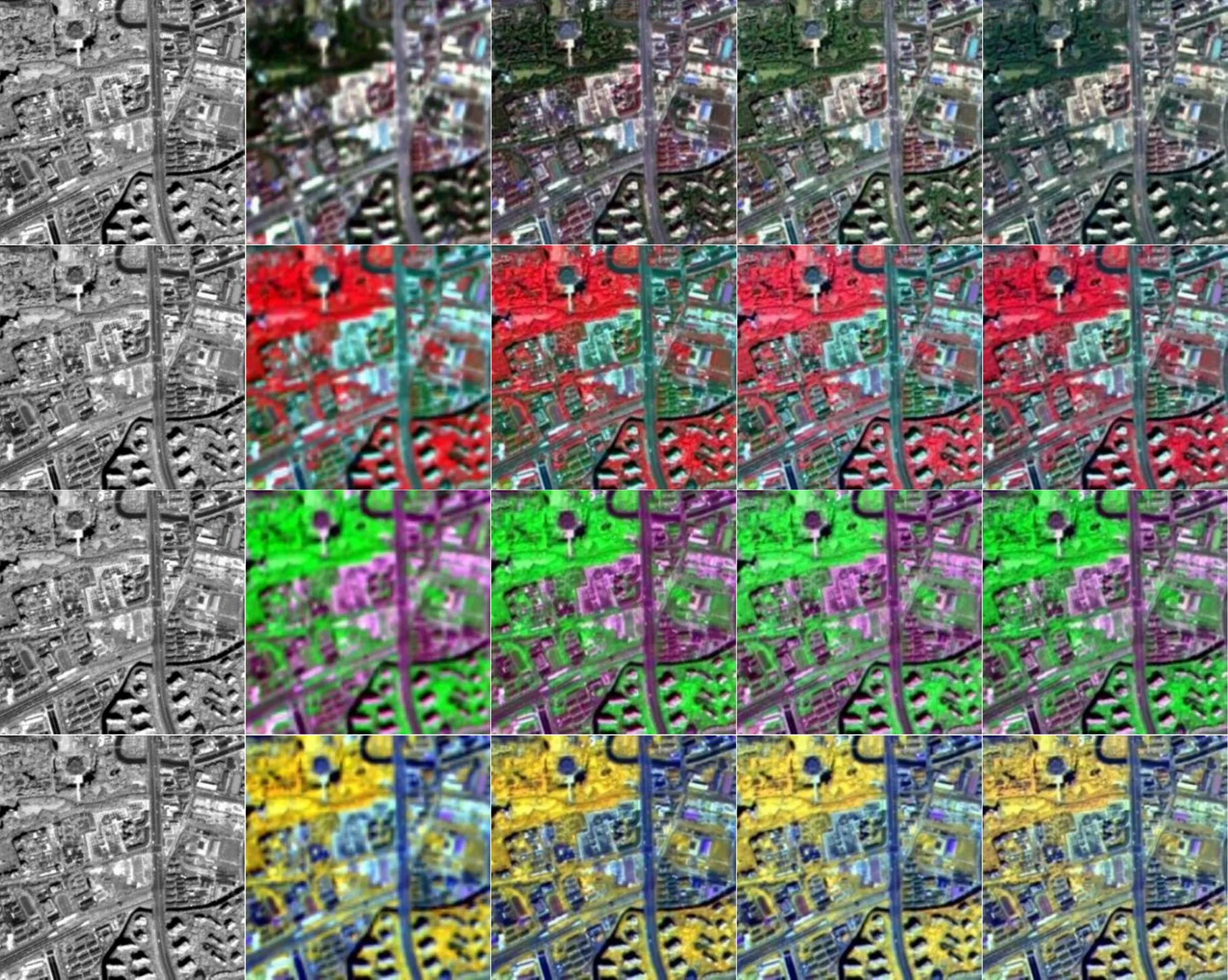

3.1 定性评价

融合结果的定性评价很重要,它由人目视判读图像的光谱和空间细节保持,通过对比直观展示融合结果。不过融合图像的展示有一定的限制,彩色图像展示一次只能使用3波段进行彩色合成,即使不考虑波段合成顺序,8波段的图像也有56种组合。由于篇幅限制图像展示数量,为了展示所有8个波段,采用最佳指数因子(Optimum Index Factor, OIF)来辅助挑选图像彩色合成的最佳波段组合。

OIF因子由Chavez[22]提出,可用于任意多光谱图像,它基于各个波段组合内和组合间标准方差的和与总相关系数的比值计算,计算公式为

具有最大OIF值的3波段图像一般包含最大的信息量(标准方差衡量)和最少的信息冗余(相关性测量)。综合考虑彩色图像合成的惯例,在展示所有8个波段的前提下,选择OIF值较大的组合,融合图像样例目视定性评价展示(见图2和图3)的波段组合为(3, 2, 1)、(4, 3, 2)、(3, 8, 6)和(4, 7, 5),括号中的数字为波段序号,其中波段组合(3, 2, 1)和(4, 3, 2)为一般目视解译使用较多的真彩色和假彩色图像合成。

(a)全色 (b)多光谱 (c)SRF_VAR (d)GS (e)NNDifffuse

注:从第一行开始从上往下彩色图像的波段合成方式依次为(3, 2, 1)、(4, 3, 2)、(3, 8, 6)和(4, 7, 5)。

图2和图3中全色、多光谱以及不同方法的融合图像均采用2%线性拉伸的增强方式,保证图像的对比有统一的显示方式,避免增强方式不同造成的目视判读偏差。空间细节方面,图2和图3不同融合方法结果图像之间对比以及与全色图像对比,空间细节无肉眼可见差异,不同融合方法结果图像相对全色图像的空间细节基本一致。光谱保持方面,彩色图像展示波段组合(3, 2, 1)、(4, 3, 2)、(3, 8, 6)和(4, 7, 5)图像中植被的颜色分别为暗绿色、红色、亮绿色和黄橙色,原始多光谱和不同融合方法结果图像之间的光谱保持目视对比结果如下:1)图2中真彩色(3, 2, 1)合成图像,SRF_VAR颜色与原始多光谱最为接近,GS图像的建筑物蓝色屋顶相对多光谱图像偏深,GS和NNDiffuse图像的水体区域颜色相对多光谱也偏暗;2)图2中(4, 3, 2)、(3, 8, 6)和(4, 7, 5)彩色图像,不同融合方法图像相对多光谱颜色基本一致,NNDiffuse图像在植被和水体区域颜色略为偏深;3)图3中真彩色(3, 2, 1)合成图像结果中,SRF_VAR颜色与多光谱最为接近,GS、NNDiffuse图像植被区域相对多光谱图像均有一定程度偏色;图3中(4, 3, 2)、(3, 8, 6)和(4, 7, 5)彩色图像,不同融合方法图像相对多光谱颜色基本一致,GS和NNDiffuse图像在小部分区域相对多光谱图像略有轻微偏差。

(a)全色 (b)多光谱 (c)SRF_VAR (d)GS (e)NNDifffuse

注:从第一行开始从上往下彩色图像的波段合成方式依次为(3, 2, 1)、(4, 3, 2)、(3, 8, 6)和(4, 7, 5)。

总的来说,在空间细节方面,SRF_VAR、GS和NNDiffuse融合方法空间细节保持都较好,无肉眼可见差异;光谱保持方面,三种融合方法结果图像用4种不同的波段组合方式合成的彩色图像相对多光谱图像均无明显的颜色扭曲,但是SRF_VAR图像的光谱信息保持最好,相对多光谱图像不同彩色组合几乎无偏色,其次是GS图像,NNDiffuse图像的光谱保持相对最差。

3.2 定量评价

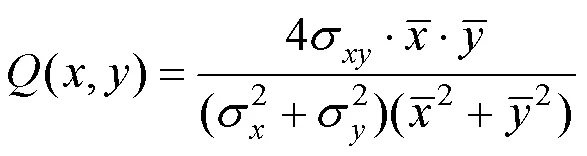

相对于主观的目视判定,定量评价较客观。定量评价使用数学模型和公式,通过一组预定义的质量(Quality,以下同)指标来测量融合图像与原始图像之间的光谱和空间相似性[23]。融合图像定量评价的方式有两类:一类是基于参考图像的评价,另一类是无参考图像的评价。基于参考图像的评价难度在于与全色图像分辨率一致的多光谱参考图像往往不易获取,Wald提出了一个解决的方法,通过降低全色和多光谱图像的分辨率进行融合,用原始多光谱图像作为参考图像[24]。目前使用参考图像的定量评价一般都采用Wald提出的方法来获得参考图像,但是Wald方法暗含的假设是融合方法的表现是独立于空间分辨率的,该假设是否可靠取决于传感器和图像内容[25]。因此,本文选择无参考图像的定量评价方法,用无参考评价QNR(Quality with No Reference)指数来定量评价不同融合方法的结果图像。

QNR指数综合光谱扭曲指数和空间畸变指数计算得到,首先分别定量的评价融合图像的空间细节保持和光谱保持,然后得到最终的均衡性评价结果,较为全面地评价融合图像。QNR指数值域范围为[0, 1],在该范围中,值越大融合图像效果越好;QNR的最大值为1,表示相对原始多光谱图像,无光谱畸变,相对全色图像无空间细节损失。

QNR的计算需要首先定义质量指数,是后续的指标计算基础,其计算公式为[26]

表3 不同方法融合图像的定量指标比较

Tab.3 Image comparison of quantitative indexes by different fusion methods

4 结束语

“资源一号”02D卫星多波段图像为遥感应用提供更丰富的谱段信息的同时,也为图像融合带来了新的挑战。本文首次使用结合光谱响应函数和全局方差匹配的遥感图像融合方法对ZY-1 02D多波段图像进行融合,并与主流、效果较好的融合方法结果进行定性和定量的比较。针对山东东营市和上海市两个不同区域的图像融合测试结果进行定性和定量分析,结果表明:1)SRF_VAR、GS和NNDiffuse融合方法用于ZY-1 02D多波段图像融合均较为稳定和优良,空间细节和光谱保持总体较好,三种方法均可用于ZY-1 02D多光谱图像融合;2)NNDiffuse融合方法得到的结果图像空间细节保持最佳;采用SRF_VAR融合方法的融合图像,其光谱保持和总体效果最佳,在保持全色图像空间细节的同时,相对多光谱图像的光谱扭曲也较小。

[1] Union of Concerned Scientists. UCS-Satellite-Database-4-1-2020.xls[EB/OL]. (2020-08-11)[2020-11-04]. https://www. ucsusa.org/resources/satellite-database.

[2] JAVAN F D, SAMADZADEGAN F, MEHRAVAR S, et al. A Review of Image Fusion Techniques for Pan-sharpening of High-resolution Satellite Imagery[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2021, 171: 101-117.

[3] DOU W, CHEN Y H, LI X B, et al. A General Framework for Component Substitution Image Fusion: An Implementation Using the Fast Image Fusion Method[J]. Computers & Geosciences, 2007, 33(2): 219-228.

[4] AIAZZI B, BARONTI S, SELVA M. Improving Component Substitution Pansharpening Through Multivariate Regression of MS+Pan Data[J]. IEEE Transactions on Geoscience & Remote Sensing, 2007, 45(10): 3230-3239.

[5] DADRASJAVAN F, SAMADZADEGAN F, FATHOLLAHI F. Spectral and Spatial Quality Assessment of IHS and Wavelet Based Pan-sharpening Techniques for High Resolution Satellite Imagery[J]. Advances in Image and Video Processing, 2018, 6(2): 1-15.

[6] JOSHI M V, BRUZZONE L, CHAUDHURI S. A Model-based Approach to Multiresolution Fusion in Remotely Sensed Images[J]. IEEE Transactions on Geoscience & Remote Sensing, 2006, 44(9): 2549-2562.

[7] SHAHDOOSTI H R, GHASSEMIAN H. Fusion of MS and PAN Images Preserving Spectral Quality[J]. IEEE Geoscience and Remote Sensing Letters, 2015, 12(3): 611-615.

[8] NUNEZ J, OTAZU X, FORS O, et al. Multiresolution-based Image Fusion with Additive Wavelet Decomposition[J]. IEEE Transactions on Geoscience and Remote Sensing, 1999, 37(3): 1204-1211.

[9] CHENG J, LIU H, LIU T, et al. Remote Sensing Image Fusion Via Wavelet Transform and Sparse Representation[J]. ISPRS Journal of Photogrammetry & Remote Sensing, 2015, 104: 158-173.

[10] 吴学文, 徐涵秋. 多分辨率分解的遥感影像融合方法对比分析[J]. 地球信息科学学报, 2010, 12(3): 419-425.

WU Xuewen, XU Hanqiu. Comparison among Multi-resolution Decomposition-based Image Fusion Methods[J]. Journal of Geo-information Science, 2010, 12(3): 419-425. (in Chinese)

[11] VIVONE G, ALPARONE L, GARZELLI A, et al. Fast Reproducible Pansharpening Based on Instrument and Acquisition Modeling: AWLP Revisited[J]. Remote Sensing, 2019, 11(19): 2315.

[12] HUANG B, SONG H H, CUI H B, et al. Spatial and Spectral Image Fusion Using Sparse Matrix Factorization[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(3): 1693-1704.

[13] WEI Q, DOBIGEON N, TOURNERET J Y. Bayesian Fusion of Multi-Band Images[J]. IEEE Journal of Selected Topics in Signal Processing, 2015, 9(6): 1117-1127.

[14] FU X, LIN Z, HUANG Y, et al. A Variational Pan-Sharpening With Local Gradient Constraints[C]//IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), June 15-20, 2019, Long Beach, USA. IEEE, 2019.

[15] NIKOLAKOPOULOS K, OIKONOMIDIS D. Quality Assessment of Ten Fusion Techniques Applied on Worldview-2[J]. European Journal of Remote Sensing, 2015, 48(1): 141-167.

[16] LI H, JING L H, TANG Y W. Assessment of Pansharpening Methods Applied to WorldView-2 Imagery Fusion[J]. Sensors, 2017, 17(1): s17010089.

[17] EI-MEZOUAR M C, KPALMA K, TALEB N, et al. A Pan-sharpening Based on the Non-subsampled Contourlet Transform: Application to Worldview-2 Imagery[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(5): 1806-1815.

[18] KWAN C, BUDAVARI B, BOVIK A C, et al. Blind Quality Assessment of Fused Worldview-3 Images by Using the Combinations of Pansharpening and Hypersharpening Paradigms[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(10): 1835-1839.

[19] 李俊杰, 傅俏燕, 姜涛. 结合光谱响应函数和全局方差匹配的遥感图像融合[J].光子学报, 2020, 49(10): 1010001.

LI Junjie, FU Qiaoyan, JIANG Tao. Remote Sensing Image Fusion Based on Spectral Response Function and Global Variance Matching[J]. Acta Photonica Sinica, 2020, 49(10): 1010001. (in Chinese)

[20] LABEN C A, BERNARD V, BROWER W. Process for Enhancing the Spatial Resolution of Multispectral Imagery Using Pan-sharpening: US6011875[P]. 2000-01-04.

[21] SUN W H, CHEN B, MESSINGER D W. Nearest-neighbor Diffusion-based Pan-sharpening Algorithm for Spectral Images[J]. Optical Engineering, 2014, 53(1): 013107.

[22] CHAVEZ P S, BERLIN G L, SOWERS L B. Statistical-method for Selecting Landsat MSS Ratios[J]. Journal of Applied Photographic Engineering, 1982, 8(1): 23-30.

[23] ZHANG Yun. Methods for Image Fusion Quality Assessment – A Review, Comparison and Analysis[C]//The International Achieves of the Photogrammetry, Remote Sensing Information Sciences, Volume XXXVII Part B7, Beijing. [S.l.: s.n.], 2008: 1101-1109.

[24] WALD L, RANCHIN T, MANGOLINI M. Fusion of Satellite Images of Different Spatial Resolutions: Assessing the Quality of Resulting Images[J]. Photogrammetric Engineering and Remote Sensing, 1997, 63: 691-699.

[25] CARLA R, SANTURRI L, AIAZZI B, et al. Full-scale Assessment of Pansharpening Through Polynomial Fitting of Multiscale Measurements[J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(12): 6344-6355.

[26] ALPARONE L, AIAZZI B, BARONTI S, et al. Multispectral and Panchromatic Data Fusion Assessment without Reference[J]. Photogrammetric Engineering & Remote Sensing, 2008, 74(2): 193-200.

Multi-band Image Fusion of ZY-1 02D Satellite

LI Junjie FU Qiaoyan JIANG Tao

(China Centre for Resources Satellite Data and Application, Beijing 100094, China)

It is a challenge to keep both the spatial details of panchromatic images and spectral information of multispectral images, especially for the bands with partial or inconsistent spectral ranges of panchromatic and multispectral images. In addition, some fusion algorithms cannot better support multispectral images with a large number of bands. Aiming at the 8-band multispectral and panchromatic images of ZY-1 02D satellite, the remote sensing image fusion method combining the spectral response function and global variance matching is moderately extended. The extended fusion method is applied to the image fusion of multiple regions of ZY-1 02D satellite for the first time. The method is compared and evaluated qualitatively and quantitatively with mainstream fusion methods used by commercial softwares. The results show that the fusion method has good spatial details and spectral preservation, and can be used for multi-band image fusion of ZY-1 02D satellite.

spectral response function; image fusion; multi-band image; ZY-1 02D satellite; remote sensing image

P237

A

1009-8518(2021)05-0058-09

10.3969/j.issn.1009-8518.2021.05.007

李俊杰,男,1983年生,2007年获中国科学院研究生院人文地理学专业硕士学位,高级工程师。研究方向为遥感数据处理与信息提取。E-mail:lijunjie299@126.com。

2020-11-03

国家重点研发计划(2018YFB0505000)

李俊杰, 傅俏燕, 姜涛. “资源一号”02D卫星多波段图像融合[J]. 航天返回与遥感, 2021, 42(5): 58-66.

LI Junjie, FU Qiaoyan, JIANG Tao. Multi-band Image Fusion of ZY-1 02D Satellite[J]. Spacecraft Recovery & Remote Sensing, 2021, 42(5): 58-66. (in Chinese)

(编辑:夏淑密)