改进ResNet18网络模型的羊肉部位分类与移动端应用

张垚鑫,朱荣光,孟令峰,马 蓉,王世昌,白宗秀,崔晓敏

改进ResNet18网络模型的羊肉部位分类与移动端应用

张垚鑫1,2,朱荣光1,2※,孟令峰1,马 蓉1,王世昌1,白宗秀1,崔晓敏1

(1. 石河子大学机械电气工程学院,石河子 832003;2. 农业农村部西北农业装备重点实验室,石河子 832003)

针对传统图像分类模型泛化性不强、准确率不高以及耗时等问题,该研究构建了一种用于识别不同部位羊肉的改进ResNet18网络模型,并基于智能手机开发了一款可快速识别不同部位羊肉的应用软件。首先,使用数据增强方式对采集到的羊背脊、羊前腿和羊后腿肉的原始手机图像进行数据扩充;其次,在ResNet18网络结构中引入附加角裕度损失函数(ArcFace)作为特征优化层参与训练,通过优化类别的特征以增强不同部位羊肉之间的类内紧度和类间差异,同时将ResNet18网络残差结构中的传统卷积用深度可分离卷积替换以减少网络参数量,提高网络运行速度;再次,探究了不同优化器、学习率和权重衰减系数对网络收敛速度和准确率的影响并确定模型参数;最后,将该网络模型移植到安卓(Android)手机以实现不同部位羊肉的移动端检测。研究结果表明,改进ResNet18网络模型测试集的准确率高达97.92%,相比ResNet18网络模型提高了5.92个百分点;把改进ResNet18网络模型部署到移动端后,每张图片的检测时间约为0.3 s。该研究利用改进ResNet18网络模型结合智能手机图像实现了不同部位羊肉的移动端快速准确分类,为促进羊肉的智能化检测及羊肉市场按质论价提供了技术支持。

图像处理;图像识别;模型;羊肉;ResNet18;移动端;羊肉部位分类

0 引 言

羊肉的肉质鲜嫩,营养价值高,且其中含有丰富的维生素、钙、磷、铁等,深受人们喜爱[1]。不同部位羊肉的品质[2-3]以及脂肪酸、蛋白质等营养成分含量[4-5]各不相同,且不同部位羊肉的颜色、失水率、风味、嫩度和加工适宜性等也会随储藏时间改变[6]。随着人们生活水平的不断提高,对肉制品真实性的要求也越来越高,然而不同部位的羊肉经常被混淆出售,该行为破坏了市场“按质论价”的原则。因此,寻求一种快速、准确鉴别不同部位羊肉的方法对维护肉制品行业的市场秩序具有重要意义。

目前,用于肉制品检测的技术主要有近红外光谱、高光谱成像以及传感器(电子鼻、电子舌)检测等[7]。Sanz等[8]将高光谱成像技术与机器学习算法相结合,对羔羊的背长肌、腰大肌、半膜肌进行分类,准确率为96.67%。Kamruzzaman等[9]采用高光谱成像技术结合主成分分析算法对夏洛莱羊的半腱肌、背阔肌和腰大肌进行了分类,准确率高达100%。但上述方法因成本高和操作复杂等缺点难以应用推广。随着手机运算速度的提高,基于移动端的肉制品检测研究逐渐增多[10-12]。赵鑫龙等[10]基于智能手机开发了一种用于牛肉大理石花纹检测的软件,检测准确率为95.56%,且单张检测时间低于0.5 s。然而,有关不同部位羊肉分类判别应用软件的研究仍然较少,孟令峰等[11]利用反向传播神经网络对基于手机图片的不同部位羊肉进行分类,并开发了相应的手机应用软件,但其准确率为90.94%,方法精度有限。

近年来,各种卷积神经网络模型不断涌现,其网络层次越来越深,结构越来越复杂,精度越来越高[13-16]。目前,深度学习已逐步应用于农畜产品新鲜度[17]、成熟度[18]、品质检测[19-20]和掺假检测[21-23]等相关研究。当深度学习的网络深度达到一定界限时,在其训练过程中会出现梯度消失的现象,导致网络难以收敛。ResNet网络[24]通过引入残差结构解决该问题,现已应用于茶叶[25]、柑橘[26]等其他食品分类中,但仍存在参数过多、运算成本高等问题。因此,一些网络为了提高运行速度,将训练好的网络进行压缩或将网络结构轻量化[27]。有研究表明,MobileNet网络[28]中的深度可分离卷积能在不影响准确率的前提下降低计算量,提高运行速度。由于羊背脊、羊后腿、羊前腿等不同部位的羊肉颜色和纹理特征较为相似,导致不同部位羊肉类别之间的区分精度不高,且不同的贮藏时间会影响不同羊肉部位的外观形态进而对部位的区分产生影响。因此,为增强不同部位羊肉之间差异的判别效果,提高网络模型的分类精度,本研究借鉴人脸识别中的附加角裕度损失函数(ArcFace)[29],并将其作为不同部位羊肉分类网络模型的特征优化层参与训练,通过最大化分类界限区分不同部位羊肉之间的细微特征。

本研究为实现基于手机图像的不同部位羊肉分类判别,引入附加角裕度损失函数(ArcFace)作为ResNet18网络的特征优化层以增强不同部位羊肉特征之间的可分性,并借鉴MobileNet轻量化网络,将ResNet18网络残差结构中的传统卷积替换为深度可分离卷积以减少网络参数量,进而比较不同优化器、学习率和权重衰减系数对网络收敛速度和准确率的影响,然后建立基于改进ResNet18网络的不同部位羊肉识别模型,最后将改进ResNet18网络模型移植到Android终端。本研究提出在深度学习模型中引入Arcface以及深度可分离卷积的方法可为其他深度网络改进提供参考。另外,本研究开发的不同部位羊肉分类手机应用软件(APP)将深度学习方法应用于手机终端,具有很好的实用性和便携性。

1 材料与方法

1.1 图像采集与预处理

1.1.1 羊肉样本图像采集

本研究试验样本采购于石河子市中心农贸市场,样本分别取自6只小尾寒羊(6~8月龄),在进行约30 h的排酸后送至石河子大学农畜产品实验室进行样本制备。试验制备的羊背脊、羊前腿和羊后腿肉样本的长、宽、高约为40 mm、30 mm、10 mm,将其真空包装后置于4 ℃冰箱内冷藏。为避免外界自然光照对试验产生影响,使采集环境更加稳定,整个试验过程均在封闭环境下进行,并对光源进行补偿。图像采集前,将试验样本从冰箱中取出,待其恢复至室温后使用手机(华为P10,华为技术有限公司,中国)进行图像采集,分别于每天的10:00和22:00进行2次图像采集,连续采集12 d。拍摄过程中,手机摄像头位于羊肉样本正上方12 cm的位置。试验剔除提前腐败的异常样本后,得到羊背脊、羊前腿和羊后腿样本各14 个,共计1 008张图像,图像格式为.jpg,图像分辨率为2 976×3 968像素。

1.1.2 图像数据预处理

本研究为提高网络模型的适应性与泛化性,对获得的羊肉图片采用随机旋转、水平和垂直翻转、调节亮度饱和度对比度、添加高斯模糊和椒盐噪声等方式进行数据集扩充[30]。扩充后的数据集数量为原来的9倍,共10 080张图片,不同扩充方式下的羊肉图片示例如图1所示。本试验所采用的数据集包括羊前腿、羊后腿和羊背脊3类不同部位羊肉,为保证样本量均衡,从每类样本中随机选取2 000张共计6 000张不同部位羊肉的手机图片,按照4∶1的比例划分为训练集(4 800张)和测试集(1 200张)。

1.2 基于改进ResNet18网络的不同部位羊肉分类模型构建

1.2.1 ResNet18网络

激活函数随卷积神经网络层数的不断加深而逐渐增多,从而将输入数据映射到更加离散的高维空间,造成网络较难收敛。针对上述问题,He等[24]提出ResNet网络,其由卷积层、池化层、归一化层、残差结构和全连接层等结构组成。ResNet18网络通过引入残差结构可解决由于网络层数较多而出现的退化问题,以免在提取特征过程中丢失信息。然而,ResNet18网络在进行多分类时仍存在类别边界不清晰、网络参数量过多和不便移植到手机端等问题。

1.2.2 附加角裕度损失函数(ArcFace)

ResNet18网络采用Softmaxloss损失函数实现多分类时,先将神经网络的输出数值转化为每个类的相对概率,然后再映射到(0,1)区间内,最终选取概率值最大的类别作为预测结果。传统的Softmaxloss损失函数(1)如式(1)所示

1.2.3 深度可分离卷积

随着网络层数的增加,网络的参数量也随之增加,使得网络训练效率逐渐降低。针对此问题,本研究借鉴MobileNet网络中的深度可分离卷积,将其代替ResNet18网络中的传统卷积以获得更高效的轻量化网络,使网络在几乎不影响准确率的前提下大大降低计算量,以便将改进ResNet18网络模型部署到移动端。

1.2.4 改进ResNet18网络模型构建

本研究提出的改进ResNet18网络是通过对ResNet18网络进行以下2个方面改进而获得。一方面,对ResNet18网络的残差结构进行改进,将其中的传统卷积替换为深度可分离卷积。深层卷积对输入层的每个通道分别进行卷积操作,然后利用逐点卷积提取不同通道在相同空间位置上的特征信息。相比传统卷积,深度可分离卷积可在不影响分类精度的前提下降低网络参数量,提高网络效率。另一方面,为区分不同部位羊肉特征之间的细微差异,引入附加角裕度损失函数(ArcFace)[29]作为改进ResNet18网络的特征优化层参与训练,在角度空间增加角度间隔以加强类内紧度和类间差异,最大化不同部位羊肉的分类界限。本研究提出的改进ResNet18网络主要由以下7部分组成:卷积层、池化层、归一化层、残差结构(3个)、全连接层、Softmax分类层和特征优化层,其结构示意图如图2所示,其中,残差结构由卷积核大小为3×3步长为2的卷积、卷积核大小为3×3步长为1的深度卷积和卷积核大小为1×1步长为1的逐点卷积构成。整个改进ResNet18网络的损失函数由Softmax分类层的Softmaxloss损失函数1与特征优化层的附加角裕度损失函数(ArcFace)3两部分之和组成,进行网络训练时,通过最小化损失函数以实现羊背脊、羊前腿和羊后腿之间的精准分类与识别。

1.2.5 试验环境

羊肉部位分类模型训练的试验环境:硬件包括Intel® CoreTMi7-6700KCPU @ 3.40 GHz处理器,40 GB内存和NVIDIA GeForce RTX 2080 Ti 显卡(11 GB 显存)等,软件包括操作系统Windows 10(64位)、编程语言Python 3.6.5、深度学习框架Pytorch1.1.0、通用计算架构CUDA 10.0和GPU加速库CUDNN 7.4.1。手机APP开发及软件测试的环境:硬件为内存64 GB的华为手机(P10,华为技术有限公司,中国),软件包括Android8.0操作系统和Android Studio安卓应用软件开发环境。

1.2.6 评价指标

本研究采用准确率(Accuracy,%)来评价所有不同部位羊肉分类模型的性能,并通过混淆矩阵分析三种部位羊肉的错分情况。准确率为分类正确的样本数占样本总数的比例,其计算如式(5)所示

式中TP、FP、FN、TN分别为混淆矩阵中分类模型对不同部位羊肉的分类情况统计。其中TP为正类判定为正类的样本个数,FP为负类判定为正类的样本个数,FN为正类判定为负类的样本个数,TN为负类判定为负类的样本个数。进行分类任务时,把要预测样本的实际类别数视为正样本数,其他所有类别之和为负样本数。

图2 改进ResNet18网络模型的结构示意图

Fig.2 Structure diagram of improved ResNet18 network model

2 结果与分析

2.1 附加角裕度损失函数(ArcFace)对特征分布的影响分析

为探究附加角裕度损失函数(ArcFace)对不同部位羊肉特征分布的影响,本研究将ResNet18网络和ResNet18_ArcFace网络提取的两个特征进行可视化,其特征分布图如图3所示。相比ResNet18网络,ResNet_ArcFace网络在增强类内紧度的同时还增加了类间差异,使得同一部位羊肉特征的相似度增强,不同部位羊肉之间特征差异性增大,进而提高了网络模型的鲁棒性。

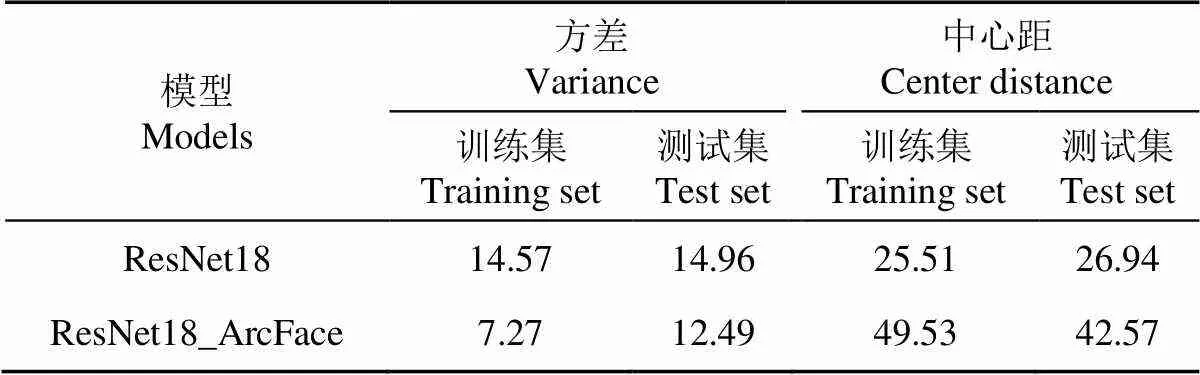

为进一步量化不同网络所提取的特征对羊肉部位的类内紧度和类间差异的影响,本研究从不同部位特征总的方差和中心距(中心之间的距离之和)两个指标对其进行对比分析。ResNet18网络和ResNet18_ArcFace网络训练集和测试集的方差和中心距如表1所示。其中,ResNet18_ArcFace网络训练集和测试集的方差分别为7.27和12.49,比ResNet18网络分别减少了7.30和2.47。ResNet18_ArcFace网络训练集和测试集的中心距分别为49.53和42.57,比ResNet18网络分别增大了24.02和15.63。结果表明,ResNet18网络引入ArcFace可提高不同部位羊肉之间的可区分性。

表1 ResNet18网络、ResNet18_ArcFace网络特征分布的对比分析

2.2 深度可分离卷积对网络模型参数量的影响分析

利用深度可分离卷积替换ResNet18网络残差结构中的传统卷积后,卷积分为深度卷积和逐点卷积2个部分。因此,网络中残差结构的参数量由原来3.13×106降至0.36×106,整体网络的参数量由原来的11.69×106降至7.68×106。结果表明,与ResNet18网络相比,引入深度可分离卷积的改进ResNet18网络可减少参数量。

2.3 模型参数对改进ResNet18网络模型的影响分析

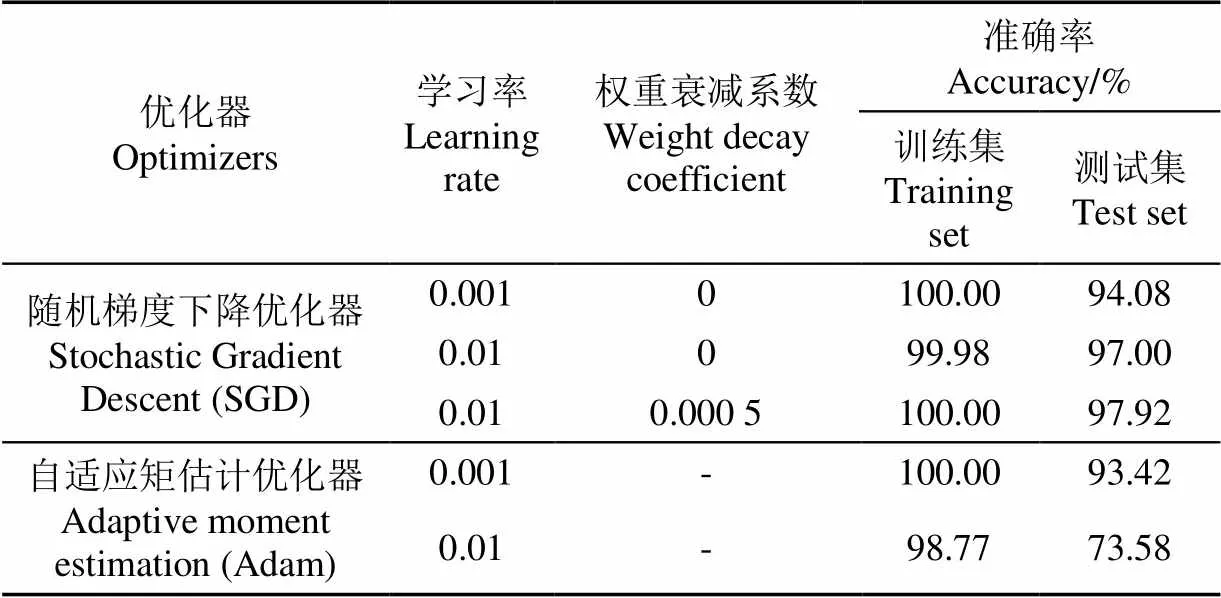

为研究训练过程中的模型参数对改进ResNet18网络模型的影响,本研究分别选用随机梯度下降(Stochastic Gradient Descent,SGD)优化器和自适应矩估计优化器(Adaptive moment estimation,Adam)两种优化器,并分别设置学习率为0.01和0.001,权重衰减系数为0和0.000 5对模型进行训练,并对比分析不同参数对模型准确率的影响。测试集的准确率随参数的变化趋势如图4所示。由图4可知,Adam比SGD优化器收敛速度更快,但网络模型准确率波动较大。模型参数对改进ResNet18网络模型影响的具体情况如表2所示,当采用学习率为0.01,权重衰减系数为0.000 5的SGD优化器时,测试集的准确率为97.92%,且准确率曲线趋势更加平稳。

表2 改进ResNet18网络模型在不同参数下准确率的对比分析

注:Adam优化算法中加入权重衰减系数无效。

Note: It is invalid for adding weight decay coefficient in Adam optimization algorithm.

2.4 改进ResNet18网络模型与其他网络模型的对比分析

本研究中所有网络模型均使用迁移学习的方式进行训练,冻结网络中除全连接层之外的所有网络层,只对最后一层进行训练。训练模型时采用SGD优化器,学习率设置为0.01,权重衰减系数设置为0.000 5。试验过程中的批次样本数为32,最大轮数为100轮。

ResNet18、改进ResNet18和MobileNet网络模型的准确率随训练轮数的变化如图5所示。由图5可知,ResNet18网络模型经过21轮训练准确率达到90.25%,最终稳定在92.00%;改进ResNet18网络模型经过6轮训练准确率达到95.25%,最终稳定在97.92%;MobileNet网络模型经过17轮训练准确率达到78.34%,最终稳定在84.58%。与ResNet18网络模型和MobileNet网络模型相比,改进ResNet18网络模型收敛速度更快,且准确率分别提升了5.92和13.34个百分点。

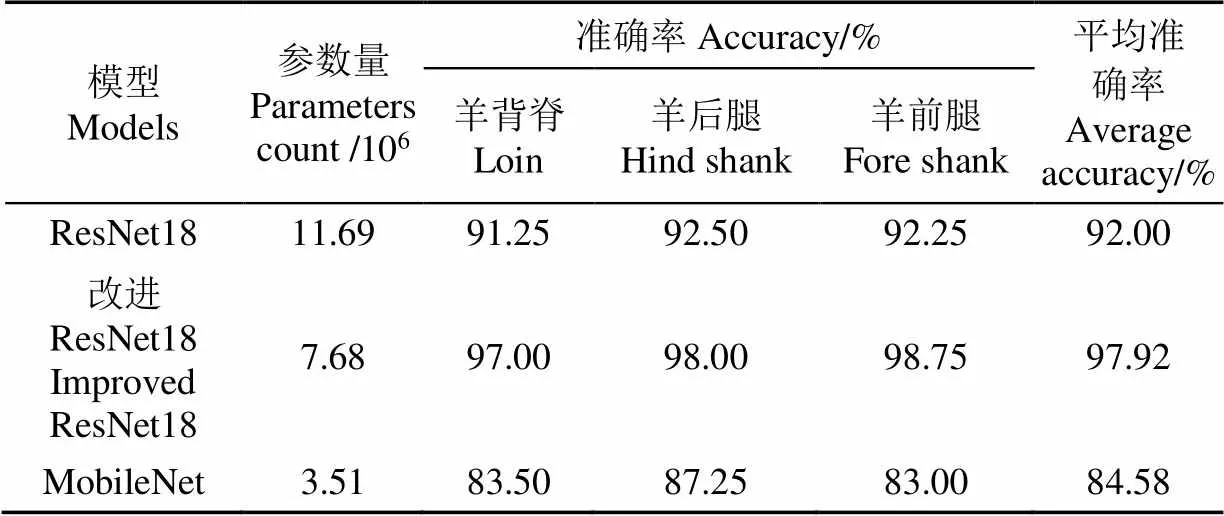

ResNet18、改进ResNet18和MobileNet网络模型对不同部位羊肉的分类结果对比情况如表3所示。由表3可知,使用改进ResNet18网络模型对羊背脊、羊后腿和羊前腿的分类准确率分别为97.00%、98.00%和98.75%。与ResNet18网络模型相比,改进ResNet18网络模型对羊背脊、羊后腿和羊前腿的分类准确率分别提高了5.75、5.50和6.50个百分点;与MobileNet网络模型相比,改进ResNet18网络模型对羊背脊、羊后腿和羊前腿的分类准确率分别提高了13.50、10.75和15.75个百分点。结果表明,与ResNet18网络模型和MobileNet网络模型相比,改进ResNet18网络模型对不同部位羊肉的分类准确率均有较大提升。

表3 ResNet18、改进ResNet18和MobileNet网络模型分类结果对比

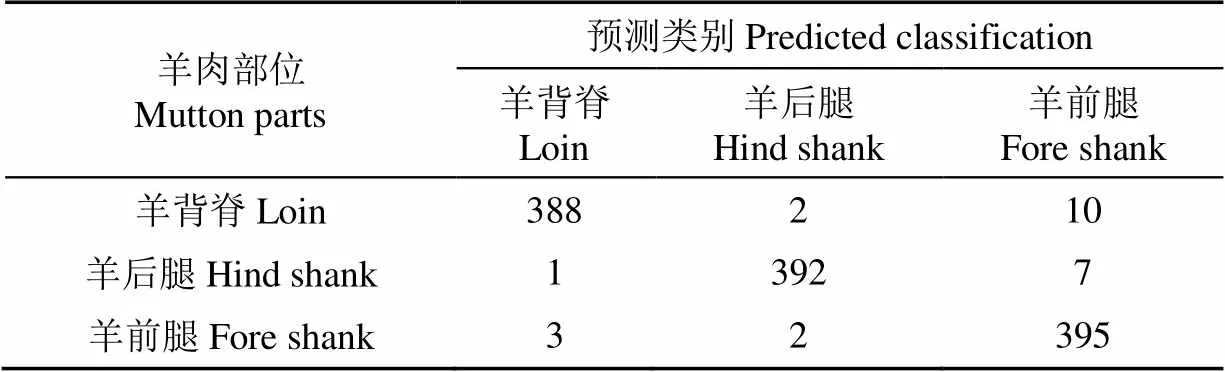

改进ResNet18网络模型的混淆矩阵如表4所示。由表4可知,使用改进ResNet18网络模型对1 200个不同部位羊肉数据集进行测试,仅25个不同部位的羊肉图像分类错误,分类效果良好。另外,本研究通过进一步分析不同部位羊肉数据集的错分情况可知,不同部位羊肉的颜色和纹理特征是其分类过程中的重要依据,当样本与背景颜色区分度不大和样本纹理不清晰(模糊或有噪声)时,则容易发生误分。误分样本大多为亮度较大、饱和度较低、添加了椒盐噪声和模糊的图片,其较为复杂的背景影响了样本的准确识别。

表4 改进ResNet18网络模型的混淆矩阵

2.5 不同部位羊肉分类手机APP实现

为了实现不同部位羊肉精准分类在移动端的快速检测,本研究采用Pytorch Mobile框架将训练好的改进ResNet18网络模型部署到Android设备中。首先,将训练好的改进ResNet18网络模型转换成TorchScript模型,并保存为相应的.pt格式。然后,在Android Studio软件环境中开发羊肉部位分类手机应用APP,APP主要包括前端界面和后端处理。前端界面主要由.xml文件进行布局,通过添加文本和按钮组件实现羊肉图片和检测结果的显示。后端处理通过编写Java语言实现,包括图像获取、图像处理和模型判别功能。在运用APP对不同部位羊肉进行识别时,首先,使用图像获取功能采集图像,然后,利用图像处理功能将获取图像的大小压缩至224×224像素并存储,最后,调用.pt格式的TorchScript模型对压缩后的图片进行识别。利用测试集1 200张图片对羊肉部位分类手机APP进行测试,得出每张图片的检测时间约为0.3 s。

3 结 论

1)本研究在ResNet18网络的基础上引入附加角裕度损失函数(ArcFace),并将残差结构中的传统卷积替换为深度可分离卷积,构建了改进ResNet18网络模型用于不同部位羊肉的分类。该网络模型不仅提高了不同部位羊肉之间的可区分性,而且减少了网络的参数量。

2)改进ResNet18网络模型对不同部位羊肉分类的准确率高达97.92%。与ResNet18网络模型和MobileNet网络模型相比,改进ResNet18网络模型的分类准确率分别提升了5.92个百分点和13.34个百分点。

3)将本研究提出的改进ResNet18模型转化为TorchScript模型移植到移动端后,所开发的羊肉检测应用软件能够实现对不同部位羊肉快速准确分类,每张图像的检测时间约为0.3 s。

总体而言,本研究提出的改进ResNet18网络模型采用了大量背景较为复杂的数据进行训练,可以实现不同部位羊肉的快速准确分类,但所开发的手机APP较为简单。后续研究中,将会考虑羊肉品种、产地以及储藏时间对模型的影响。另外,本研究提出的改进ResNet18网络模型可为实现其他类别差异细微的样本快速准确分类提供参考。

[1] 王彩霞,王松磊,贺晓光,等. 高光谱图谱融合检测羊肉中饱和脂肪酸含量[J]. 光谱学与光谱分析,2020,40(2):595-601.

Wang Caixia, Wang Songlei, He Xiaoguang, et al. Detection of saturated fatty acid content in mutton by using the fusion of hyperspectral spectrum and image information[J]. Spectroscopy and Spectral Analysis, 2020, 40(2): 595-601. (in Chinese with English abstract)

[2] Junkuszew A, Nazar P, Milerski M, et al. Chemical composition and fatty acid content in lamb and adult sheep meat[J]. Archives Animal Breeding, 2020, 63(2): 261-268.

[3] 李贞子,杨具田,宋巧,等. 不同性别及部位的兰州大尾羊肉食用品质[J]. 食品工业科技,2014,35(17):354-357,361.

Li Zhenzi, Yang Jutian, Song Qiao, et al. Edible quality of Lanzhou fat-tailed sheep in different gender and anatomical regions[J]. Science and Technology of Food Industry, 2014, 35(17): 354-357, 361. (in Chinese with English abstract)

[4] 陈学敏,朱国茵,罗海玲,等. 基于指纹图谱的欧拉羊肉挥发性风味物质定量分析[J]. 农业机械学报,2020,51(5):349-355.

Chen Xuemin, Zhu Guoyin, Luo Hailing, et al. Quantitative analysis of Oula lamb meat volatile compounds based on fingerprint[J]. Journal of Agricultural Machinery, 2020, 51(5): 349-355. (in Chinese with English abstract)

[5] 王亚娜,王晓香,王振华,等. 大足黑山羊宰后成熟过程中挥发性风味物质的变化[J]. 食品科学,2015,36(22):107-112.

Wang Yana, Wang Xiaoxiang, Wang Zhenhua, et al. Changes in volatile flavor components in Dazu black goat meat during postmortem aging[J]. Food Science, 2015, 36(22): 107-112. (in Chinese with English abstract)

[6] 刘文营,王守伟. 羊肉生产及加工工艺对肉及肉制品品质的影响研究进展[J]. 食品科学,2020,41(1):304-311.

Liu Wenying, Wang Shouwei. Recent progress in understanding the effect of mutton production and processing technologies on the quality of meat and meat products[J]. Food Science, 2020, 41(1): 304-311. (in Chinese with English abstract)

[7] Dumalisile P, Manley M, Hoffman L, et al. Discriminating muscle type of selected game species using Near Infrared (NIR) spectroscopy[J/OL]. Food Control, 2020, 110, [2019-11-01], https: //doi. org/10. 1016/j. foodcont. 2019. 106981.

[8] Sanz J A, Fernandes A M, Barrenechea E, et al. Lamb muscle discrimination using hyperspectral imaging: Comparison of various machine learning algorithms[J]. Journal of Food Engineering, 2016, 63(2): 92-100.

[9] Kamruzzaman M, Elmasry G, Sun D, et al. Application of NIR hyperspectral imaging for discrimination of lamb muscles[J]. Journal of Food Engineering, 2011, 104(3): 332-340.

[10] 赵鑫龙,彭彦昆,李永玉,等. 基于深度学习的牛肉大理石花纹等级手机评价系统[J]. 农业工程学报,2020,36(13):250-256.

Zhao Xinlong, Peng Yankun, Li Yongyu, et al. Mobile phone evaluation system for grading beef marbling based on deep learning[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(13): 250-256. (in Chinese with English abstract)

[11] 孟令峰,朱荣光,白宗秀,等. 基于手机图像的不同贮藏时间下冷却羊肉的部位判别研究[J]. 食品科学,2020,41(23):21-26.

Meng Lingfeng, Zhu Rongguang, Bai Zongxiu, et al. Discrimination of chilled lamb in different parts under different storage time based on mobile phone images[J]. Food Science, 2020, 41(23): 21-26. (in Chinese with English abstract)

[12] Adi K, Pujiyanto S, Nurhayati O D, et al. Beef quality identification using thresholding method and decision tree classification based on android smartphone[J/OL]. Journal of Food Quality, 2017, 2017, [2017-09-05], https: //doi. org/10. 1155/2017/1674718.

[13] Zhao A, Balakrishnan G, Durand F, et al. Data augmentation using learned transformations for one-shot medical image segmentation[C]// 2019 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Long Beach: IEEE, 2019.

[14] Brossard M, Bonnabel S. Learning wheel odometry and IMU Errors for localization[C]// 2019 International Conference on Robotics and Automation (ICRA), Montreal: IEEE, 2019.

[15] Krizhevsky A, Sutskever I, Hinton G E. ImageNet classification with deep convolutional neural networks[J]. Advances in Neural Information Processing Systems, 2017, 60(6): 84-90.

[16] 陈娟,陈良勇,王生生,等. 基于改进残差网络的园林害虫图像识别[J]. 农业机械学报,2019,50(5):194-202.

Chen Juan, Chen Liangyong, Wang Shengsheng, et al. Pest recognition based on improved residual network[J]. Transactions of the Chinese Society for Agriculture Machinery, 2019, 50(5): 194-202. (in Chinese with English abstract)

[17] 焦俊,王文周,侯金波,等. 基于改进残差网络的黑毛猪肉新鲜度识别方法[J]. 农业机械学报,2019,50(8):364-371.

Jiao Jun, Wang Wenzhou, Hou Jinbo, et al. Freshness identification of Iberico pork based on improved residual network[J]. Transactions of the Chinese Society for Agriculture Machinery, 2019, 50(8): 364-371. (in Chinese with English abstract)

[18] 向阳,林洁雯,李亚军,等. 芒果双面成熟度在线检测分级系统[J]. 农业工程学报,2019,35(10):259-266.

Xiang Yang, Lin Jiewen, Li Yajun, et al. Mango double-sided maturity online detection and classification system[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(10): 259-266. (in Chinese with English abstract)

[19] 赵志衡,宋欢,朱江波,等. 基于卷积神经网络的花生籽粒完整性识别算法及应用[J]. 农业工程学报,2018,34(21):195-201.

Zhao Zhiheng, Song Huan, Zhu Jiangbo, et al. Identification algorithm and application of peanut kernel integrity based on convolution neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2018, 34(21): 195-201. (in Chinese with English abstract)

[20] 张思雨,张秋菊,李可. 采用机器视觉与自适应卷积神经网络检测花生仁品质[J]. 农业工程学报,2020,36(4):269-277.

Zhang Siyu, Zhang Qiuju, Li Ke. Detection of peanut kernel quality based on machine vision and adaptive convolution neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(4): 269-277. (in Chinese with English abstract)

[21] Han F K, Huang X Y, Aheto J H, et al. Detection of beef adulterated with pork using a low-cost electronic nose based on colorimetric sensors[J/OL]. Foods, 2020, 9(2), [2020-02-10], https: //www. researchgate. net/publication/339311410_Detection_of_Beef_Adulterated_with_Pork_Using_a_Low-CostElectronic_Nose_Based_on_Colorimetric_Sensors.

[22] Zhou L, Zhang C, Liu F, et al. Application of deep learning in food: A review[J]. Comprehensive Reviews in Food Science and Food Safety, 2019, 18(6): 1793-1811.

[23] Yang J, Xu J F, Wu X L, et al. Deep learning for vibrational spectral analysis: Recent progress and a practical guide[J]. Analytica Chimica Acta, 2019, 1081: 6-17.

[24] He K M, Zhang X Y, Ren S Q, et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CPVR), Las Vegas: IEEE, 2016.

[25] 林丽惠,罗志明,王军政,等. 融合整体与局部信息的武夷岩茶叶片分类方法[J]. 智能系统学报,2020,15(5):919-924.

Lin Lihui, Luo Zhiming, Wang Junzheng, et al. Classification of Wuyi rock tealeaves by integrating global and local information[J]. CAAI Transactions on Intelligent Systems, 2020, 15(5): 919-924. (in Chinese with English abstract)

[26] 李善军,胡定一,高淑敏,等. 基于改进SSD的柑橘实时分类检测[J]. 农业工程学报,2019,35(24):307-313.

Li Shanjun, Hu Dingyi, Gao Shumin, et al. Real-time classification and detection of citrus based on improved single short multibox detecter[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(24): 307-313. (in Chinese with English abstract)

[27] Cheng Y, Wang D, Zhou P, et al. A survey of model compression and acceleration for deep neural networks[J/OL]. Signal Processing, [2020-04-14], https: //arxiv. org/abs/1710. 09282.

[28] Howard A G, Zhu M L, Chen B, et al. MobileNets: Efficient convolutional neural networks for mobile vision applications[J/OL]. Computer Vision and Pattern Recognition, [2017-04-17], https: //arxiv. org/abs/1704. 04861.

[29] Deng J K, Guo J, Xue N N, et al. ArcFace: Additive angular margin loss for deep face recognition[C]// 2019 IEEE Conference on Computer Vision and Pattern Recognition (CPVR), Long Beach: IEEE, 2019.

[30] 赵立新,侯发东,吕正超,等. 基于迁移学习的棉花叶部病虫害图像识别[J]. 农业工程学报,2020,36(7):184-191.

Zhao Lixin, Hou Fadong, Lyu Zhengchao, et al. Image recognition of cotton leaf diseases and pests based on transfer learning[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(7): 184-191. (in Chinese with English abstract)

Classification of mutton location on the animal using improved ResNet18 network model and mobile application

Zhang Yaoxin1,2, Zhu Rongguang1,2※, Meng Lingfeng1, Ma Rong1, Wang Shichang1, Bai Zongxiu1, Cui Xiaomin1

(1.,,832003,;2,,832003,)

Accurate and timely detection of meat parts has gradually been highly demanding in meat consumption. However, the traditional image classification cannot clearly distinguish the similar color and texture characteristics for different mutton parts under different storage time, particularly with the low generalization and time-consuming. In this study, an improved ResNet18 network model was proposed to classify the different mutton parts, while, the corresponding mobile application software was developed using the optimal model. Firstly, 1 008 mutton images of loin, hind shank, and fore shank under different storage times (0-12 d) were collected, and then 9 types of data-augmentation were used to expand the dataset. After that, 6 000 images were randomly selected from the augmented dataset for modeling, where 80% of the images were used as the training dataset, and the remainder was used as the test dataset. Secondly, Additive Angular Margin Loss (ArcFace) and the depthwise separable convolution were introduced into the ResNet18 network for the improved one. Thirdly, the improved ResNet18 network wastrained with the augmented images of different mutton parts. Meanwhile, an evaluation was made to determine the effect of different parameters on the convergence speed and accuracy of improved ResNet18. Optimizers of stochastic gradient descent (SGD) and adaptive moment estimation (Adam), the learning rate of 0.01 and 0.001, weight decay coefficient of 0 and 0.000 5 were adopted for experimental comparison. The optimal classification model was then determined for different mutton parts. Finally, a mobile application software was developed to transplant the TorchScript model that transformed from the improved ResNet18. The results showed that the ArcFace greatly improved the distinguishability of different mutton parts, while the depthwise separable convolution significantly reduced the parameters of the network. Furthermore, the improved ResNet18 network using SGD optimizer presented a higher accuracy and more stable performance than that using the Adam in the test phase. When the learning rate was set to 0.01, the weight decay coefficient was set to 0.000 5, and the SGD optimizer was used to train the improved ResNet18 network, only 25 images of different parts of lamb were classified incorrectly in the 1 200 test sets, where the classification accuracy of the model was 97.92%, while the average classification accuracies of the loin, hind shank, and fore shank were 97.00%, 98.00%, and 98.75%, respectively. Compared with the original, the classification accuracy of the improved ResNet18 was improved by 5.92 percentage points, while the classification accuracies of loin, hind shank, and fore shank were improved by 5.75, 5.50, and 6.50 percentage points, respectively. Compared with the MobileNet model, the classification accuracy of improved ResNet18 was improved by 13.34 percentage points, while the classification accuracies of loin, hind shank, and fore shank were improved by 13.50, 10.75, and 15.75 percentage points, respectively. Moreover, the software using the improved ResNet18 quickly and accurately classified different mutton parts, where the average detection time of each image was about 0.3 s. The finding can provide the technical and theoretical support to improve the level of intelligent detection of meat products for the fair competition of the meat market.

image processing; image recognition; models; mutton; ResNet18; mobile terminal; classification of mutton parts

张垚鑫,朱荣光,孟令峰,等. 改进ResNet18网络模型的羊肉部位分类与移动端应用[J]. 农业工程学报,2021,37(18):331-338.doi:10.11975/j.issn.1002-6819.2021.18.038 http://www.tcsae.org

Zhang Yaoxin, Zhu Rongguang, Meng Lingfeng, et al. Classification of mutton location on the animal using improved ResNet18 network model and mobile application[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(18): 331-338. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.18.038 http://www.tcsae.org

2020-10-03

2021-07-22

国家自然科学基金地区科学基金项目(31860465);兵团中青年科技创新领军人才计划项目(2020CB016);石河子大学青年创新人才培育计划项目(CXRC201707)

张垚鑫,博士生,研究方向为图像处理,机器学习。Email:yxzl_ysh@163.com

朱荣光,博士,教授,博士生导师,研究方向为农畜产品无损检测与装备研发。Email:rgzh_jd@163.com

10.11975/j.issn.1002-6819.2021.18.038

TS251.7

A

1002-6819(2021)-18-0331-08