基于空间和ECA注意力机制的废旧手机型号识别研究

余光海 付勇刚 邓梅玲

(1.合肥工业大学机械工业绿色设计与制造重点实验室 合肥 230009;2.中国电器科学研究院股份有限公司 广州 510300)

引言

随着智能手机使用的普及与更新换代的加速,产生了越来越多的废旧手机,然而大量废旧手机不仅造成资源浪费,还会对土壤环境造成污染。因此,废旧手机的回收成为可持续发展战略中不可忽视的重要问题[1,2],对于废旧手机的回收不仅要求对手机型号识别的准确率与手机型号识别的效率,还应考虑在前期准备数据库预训练模型时,调整网络结构以缩短训练时间。因此,设计一种快速准确识别手机型号的方法成为实现废旧手机回收的关键,本文通过深度学习的方法,在残差网络结构中添加注意力机制进行手机型号识别实验,对比几种网络模型的性能,得到了能快速准确识别手机型号的模型。

为了快速实现手机型号识别,工业中主要采用的是支持向量机等分类器提取手机外观纹理、形状等局部特征,然后将提取到的特征信息遍历所有图像进行对比,从而达到识别不同型号的手机[3,4]。但由于识别和遍历均耗费较长的识别时间,导致该方法不适用于大规模废旧手机回收中。同时为了提高废旧手机型号识别的效率与准确率,注意力机制逐渐成为研究热点之一。例如,国外的G-M研究团队实验在递归神经网络模型上添加注意力模块来对图像进行分类[5],最终实验修改后的网络模型可以高效准确的识别图像中物体对象[6]。该实验验证了添加注意力机制在图像处理领域是有效的。在进行废旧手机型号识别时,为了使网络能够实现快速且准确的识别,同时在数据量较少的情况下也具有良好的性能。本文采用的是基于残差网络进行改进并结合迁移学习[7],在Resnet 34网络的残差块结构中加入通道和空间注意力机制[8],分别来提取废旧手机的重要特征和定位具有判别性的局部区域,实现对废旧手机型号的快速准确识别。

1 废旧手机数据介绍

本实验数据收集主要是通过网络爬虫获取,一共收集了900张照片,然后人工清洗筛选出738合格的照片,包括的手机型号一共三种。三种型号的手机分别为Vivo S6、华为麦芒5与荣耀30青春版,所选照片均为质量较好、清晰度较高的照片,如图1所示。

图1 手机图片

由于对于手机型号识别过程中对废旧手机的拍照存在手机背面未拍全、手机位置偏移、手机被拍照面有损伤等因素,可能会导致识别准确率降低,因此在模型训练前可以进行图像增强。本文采用的方法是对图像进行几何增强[8,9],即对图像进行平移,旋转,剪切等几何变换,可以增强模型的泛化能力。其次,本次实验所收集的数据量偏少,故采取结合迁移学习的方法来解决数据量不足。

2 实验模型概述

2.1 废旧手机识别模型概述

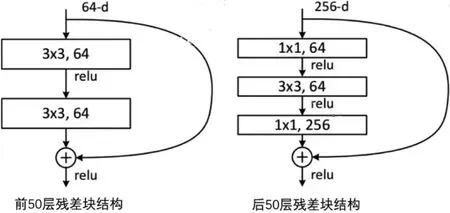

本文用的网络模型为ResNet 34网络模型,并且结合迁移学习将网络在ImageNet数据集上训练获取的网络参数迁移到目标任务的网络中,将部分参数作为废旧手机型号识别模型的部分卷积层的初始化权重。ResNet 34网络模型可以训练特别深的神经网络,避免了随着神经网络层次的加深而出现准确率饱和的现象。残差网络可以通过增加网络的深度来提高准确率,这也决定了残差网络优化比较容易实现。对于神经网络中增加太多深度会造成梯度消失的问题,ResNet 34网络模型内部的残差块添加了跳跃连接来缓解[10],本文所用的残差结构如图2所示。

图2 前50层与后50层残差结构

注意力机制的作用是通过网络的自主学习,得出一组权重系数,并且注意力机制可以使模型更加关注我们想要关注的区域。注意力机制可以提高模型在训练时学习到对空间通道和背景信息的建模能。注意力模块包括空间注意力和通道注意力[11]。

2.2 ECA通道注意力模块

ECA模块是通道注意力机制的一种实现形式[12]。ECA模块可以看作是SE模块的改进版。由于SE模块对通道注意力机制的副作用,导致捕获信息的通道之间的依赖关系是低效的。ECA模块的思想是非常简单的,它去除了原来SE模块中的全连接层,直接在平均池化后的特征上通过一个卷积来学习。其结构如图3所示。

图3 ECA通道注意力模块

2.3 Spartial Attention空间注意力模块

Spartial Attention空间注意力在通道维度上进行最大值和平均值的汇聚,CxWxH的特征图压缩成1xWxH的信息,然后通过带有注意力权重的卷积来提取注意力信息,最后,如果是单分支结构,通过sigmoid来使注意力权重非负,如果是多分支结构则应用softmax来使注意力权重非负[13]。空间注意力机制可以利用图像空间位置上的相关性,获得在空间维度上更有价值的信息,从而获得更有效的空间特征,结构如图4所示。

图4 Spartial Attention空间注意力模块

通道注意力中的注意力信息是筛选出哪些通道的信息和目前这个认为是相关的。空间注意力则是去关心对于特征图来说哪些位置的信息是和目前认为相关的。但是在最近的研究中发现将空间和通道融合后有助于网络模型性能的提升[14],因此,本文尝试将ECA通道注意力与Spartial Attention 空间注意力结合,并与只添加ECA通道注意力与未添加注意力机制的Resnet 34网络模型进行对比实验,本次实验将ECA通道注意力和Spartial Attention空间注意力这两个模块采用串行顺序的方式组合在一块儿,注意力残差结构如图5所示。

图5 注意力残差结构图

3 实验结果与分析

为了对比的性能,在本节进行了如下对比实验,其模型包括:①Resnet 34网络模型为原模型;②Eca-Resnet 34表示在原模型的Layer 4的残差块结构中添加了ECA注意力机制;③Eca-S-Resnet 34模型表示在Resnet 34模型的Layer 4上添加ECA注意力机制和空间注意力机制。实验中三种模型训练完成后的数据如图6、图7、图8所示。

图6 Resnet 34网络模型训练数据

图7 Eca-Resnet 34网络模型训练数据

图8 Eca-S-Resnet 34 网络模型训练数据

这三组网络模型训练的epoch均设置的是100,从三组模型训练后得到的准确率与误差图可知训练结束时Resnet 34网络还未收敛,Eca-Resnet 34网络在epoch接近40时已经收敛,而Eca-S-Resnet 34网络在训练结束时是接近收敛,由此可以推断出,当数据量较少时,只添加ECA注意模块对网络训练速度提升最多,添加了ECA注意力和Spartial Attention注意力模块也对网络训练速度有提升。将实验结果中三个模型的验证集准确率统计后表明此方法有着最高的准确率。各个模型结果如表1所示。

表1 各模型的实验结果

从表1的结果中可以看出,在本次实验中Resnet 34网络添加注意力机制,其分类准确率分别比不加注意力模块的Resnet 34模型提升了1.17 %和1.37 %。说明在此手机数据集的数量较少时,利用迁移学习可以和添加注意力机制可以避免过拟合的发生。实验结果也表明,在Resnet 34网络的layer 4残差结构上添加注意力机制的情况下,将ECA通道注意力和Spartial Attention空间注意力串行结合比只添加ECA注意力机制更有助于网络模型性能提升。

4 结论

本文实验三种模型对三种手机型号进行预训练与手机型号识别,得到Resnet 34模型、Eca-Resnet 34模型与Eca-S-Resnet 34模型在验证集上的准确率分别为97.94 %、99.11 %与99.31 %。通过对比可知,将ECA注意力机制与Spartial Attention空间注意力机制串行顺序组合,可以使得Resnet 34模型能够自适应地关注对分类有重要影响的特征和区域,提高了对手机型号识别的准确率,而且相比于只添加ECA注意力机制,其更有助于网络模型性能的提升。由于本次实验模型训练的epoch均设置的是100,训练结束时Resnet 34模型未收敛,Eca-Resnet 34模型与Eca-S-Resnet 34模型分别为接近收敛和收敛,可知添加注意力机制可以提升网络训练速度,但将ECA注意力机制与Spartial Attention空间注意力机制串行顺序组合后对网络训练速度提升不如只添加ECA注意力机制,在后续工作中,可以尝试在更多数据量时,用这三种模型训练和对废旧手机型号识别,观察是否会导致过拟合,同时再与数据较少时的实验结果对比,观察手机型号识别准确率与网络训练速度的变化,从而继续优化网络模型。