大型车辆右侧盲区碰撞预警方法研究

葛如海,洪志福

(1江苏大学 汽车与交通工程学院,江苏 镇江 212013;2 无锡职业技术学院 汽车与交通学院,江苏 无锡 214121)

大型车辆右侧盲区碰撞预警方法研究

葛如海1,2,洪志福1

(1江苏大学 汽车与交通工程学院,江苏 镇江 212013;2 无锡职业技术学院 汽车与交通学院,江苏 无锡 214121)

为减少大型车辆右转弯碰撞事故对行人的伤害,提出一种基于模式识别的右侧盲区碰撞预警方法。分析了右转弯事故的主要原因,建立了内轮差的数学模型并计算其大小。利用车辆动力学的仿真软件(TRUCKSIM)搭建某型客车右转弯仿真模型,得到该工况下车辆运行参数,得到了合理的内轮差取值。采用单目视觉模型实现行人和车辆间距离的测量。在此基础上,选取训练和识别样本的有效特征指标,用模糊动态聚类的方法对采集样本进行分析,获得预警方法所需的标准模型。最后计算标准模型和待识别样本间的隶属度,对待识别样本进行危险等级分类。实验证明该方法能有效地对危险情况进行识别。

右转弯碰撞;车辆动力学仿真软件(TRUCKSIM);单目测距;预警方法;模糊模式识别

近年来,由于经济发展和工业运输的需要,大型车辆(包括货车、大客车和专用车辆等)的保有量不断增加,相应地大型车辆交通事故也不断发生,每年造成严重的人员伤亡和经济损失[1]。据统计,2012—2015年国内大型车辆交通事故造成54 592人死亡,约占交通事故死亡人数的29%,接近1/3[2]。大型车辆重大伤亡事故频繁发生引起了社会各界的关注,其中大型车辆盲区监测为主要的关注焦点。

我国于2013年颁布了国家标准《机动车辆间接视野装置性能和安装要求》(GB 15804—2013)[3],明确指出大型车辆必须在乘员一侧和驾驶员一侧各安装1个补盲外视镜作为避免侧面碰撞的重要装置。国内外学者对盲区监测进行了相关研究,例如:三菱重工的行人识别系统[4]就在重型货车前面布置一个立体摄像系统,利用行人检测技术和测距技术测定出车辆前面行人的精确位置,并对驾驶员进行报警提醒,减少前盲区的碰撞事故;Leanne等[5]将全景式视觉传感器作为一种辅助驾驶工具,用来监视车辆附近的视觉盲区;Todd等[6]在建筑工程车辆中应用激光扫描仪形成点云图,处理后得到车辆盲区的三维距离图;Michael等[7]使用4个雷达传感器构成的雷达网络探测车辆尾部盲区的情况;李军等[8]基于CAN总线、“蝇眼”理论和超声波测距技术,将测距节点和主控节点组网后建立起一个“蝇眼”传感网络,将其应用于大型车辆的防撞预警中; 李守晓等[9]采用了频率为76.125 GHz左右的毫米波来感应物体的存在,并以此计算出换道时目标车辆的速度、距离及角度。

目前较少涉及通过对大型车辆右前轮盲区的研究来减少右转弯事故的发生和提高对驾驶员与行人的保护效果。因此,根据《机动车辆间接视野装置性能和安装要求》[3],笔者利用单目视觉测距技术和模糊模式识别的原理,确定盲区内行人的位置,并给出相应的预警方法。

1 大型车辆右转弯仿真模型

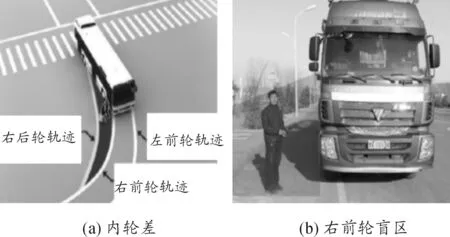

大型车辆在路口右转弯时,行人进入车辆右前轮盲区,在驾驶员毫不知情的情况下,由于内轮差的存在,右前轮或驾驶室与行人可能发生侧面碰撞,右后轮会碾压行人。

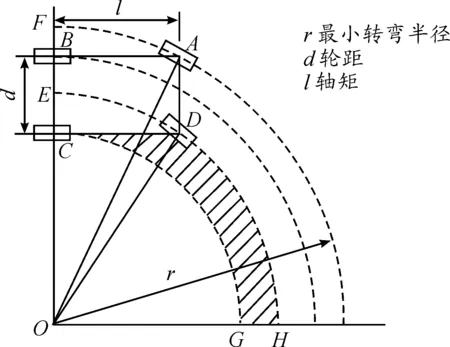

1.1内轮差

内轮差定义为车辆在转弯过程中内侧前轮和后轮的转弯半径差。在最大转向角的情况下产生最大内轮差,此时车辆左前轮转弯产生的轨迹圆弧半径等于最小转弯半径。如果驾驶员在转弯时没有考虑内轮差,可能发生前轮安全通过然而后轮与行人或车辆碰撞的事故。为了获得车辆右转弯时的安全距离模型,需要计算其最大内轮差。车辆右转弯时的数学模型如图1所示。最大内轮差计算公式如下:

(1)

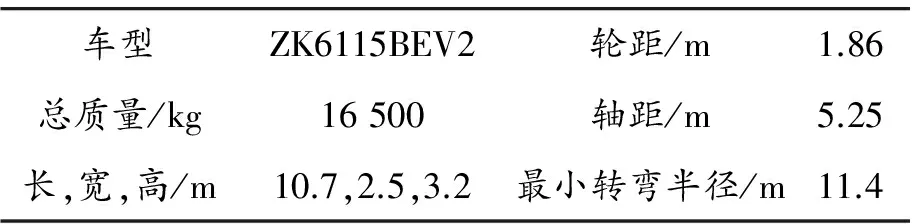

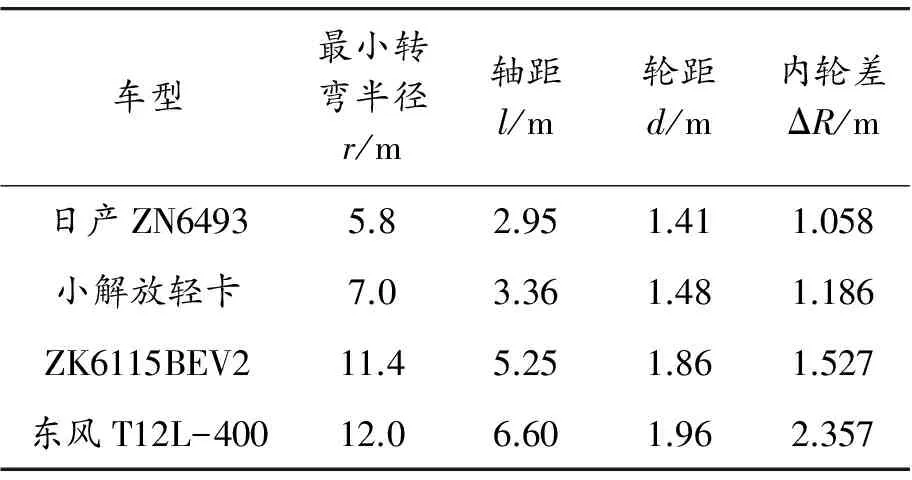

不同车型计算得到的不一样的内轮差。本研究采用的车型为宇通ZK6115BEV2,其各项相关参数见表1。由式(1)计算可得不同车型车辆的内轮差,如表2所示。

图1 车辆右转弯时的数学模型

车型ZK6115BEV2轮距/m1.86总质量/kg16500轴距/m5.25长,宽,高/m10.7,2.5,3.2最小转弯半径/m11.4

表2 不同车型的内轮差

由表2可知:最小转弯半径r、轴距l和轮距d越大内轮差越大,越容易发生事故。采用计算得到的内轮差作为车辆右转弯时右侧安全距离范围,即与车辆右侧车身横向距离在1.527 m以内的都属于危险区域。

1.2右侧盲区

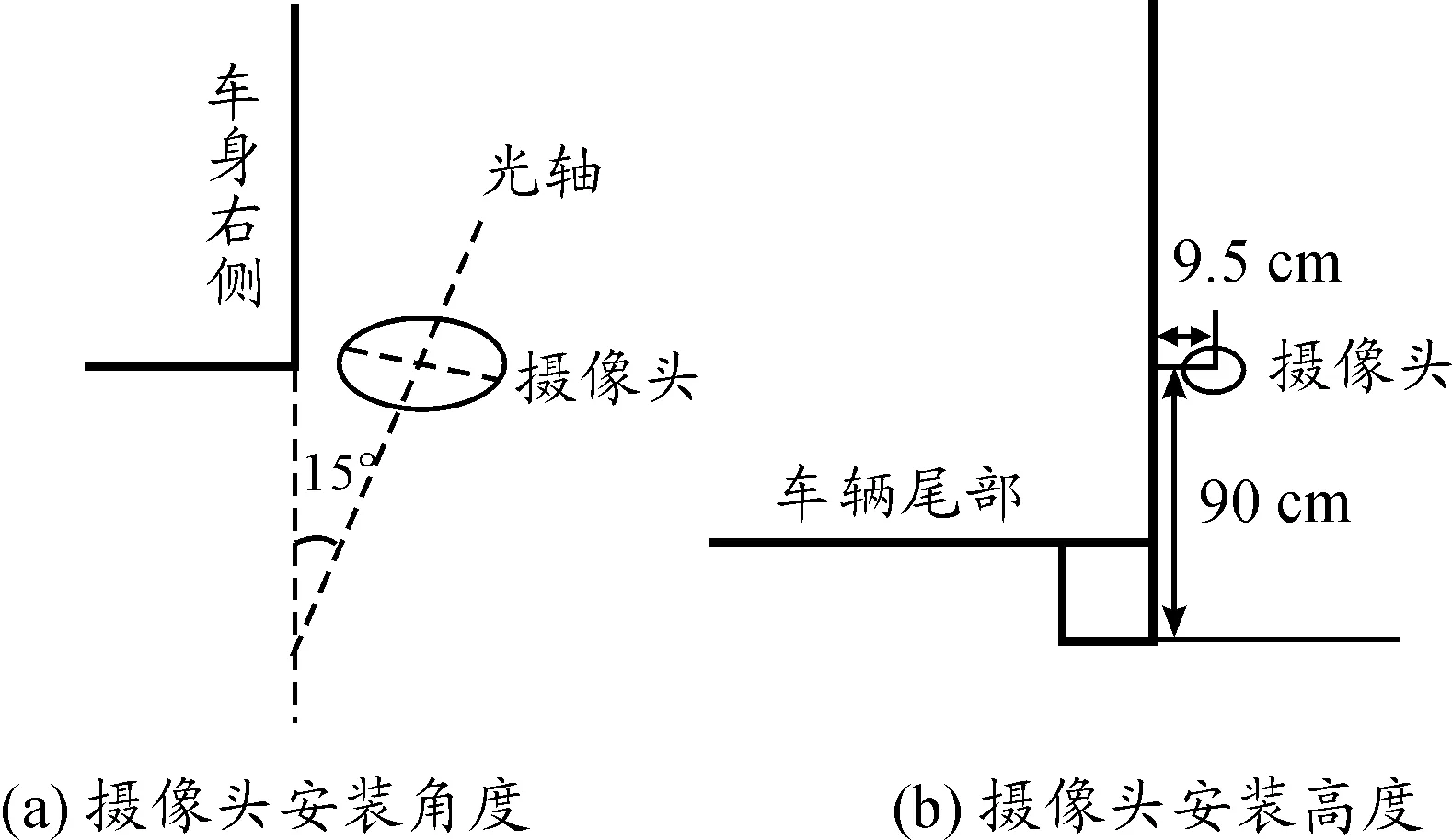

汽车盲区是指汽车正常行驶时,由于自车车身的遮挡驾驶员视线达不到的区域。大型车辆存在着许多盲区,由于本文针对的是右转弯行驶工况,所以只对车辆右前轮盲区进行探讨。本文采用探测目标信息完整且更符合人的认知习惯的视觉传感器,通过合理的传感器安装位置来消除该盲区,摄像头安装在车辆的右后侧,见图2。这样可以有效地覆盖车辆的右前轮盲区,对盲区内的行人进行监测,很好地解决了盲区问题。图 3 为大型车辆右转弯的危险区域。

图2 摄像头的安装位置

图3 大型车辆右转弯的危险区域

1.3右转弯仿真分析

由于进行大型车辆右转向的实车实验难度较大,本文利用车辆动力学仿真软件TRUCKSIM进行某型大客车右转向的模拟仿真。通过仿真模型调试与验证,意在取代实车实验。TRUCKSIM 由美国机械仿真软件公司开发,主要用于预测和仿真汽车整车的动力性、制动性、操纵稳定性、平顺性和经济性。

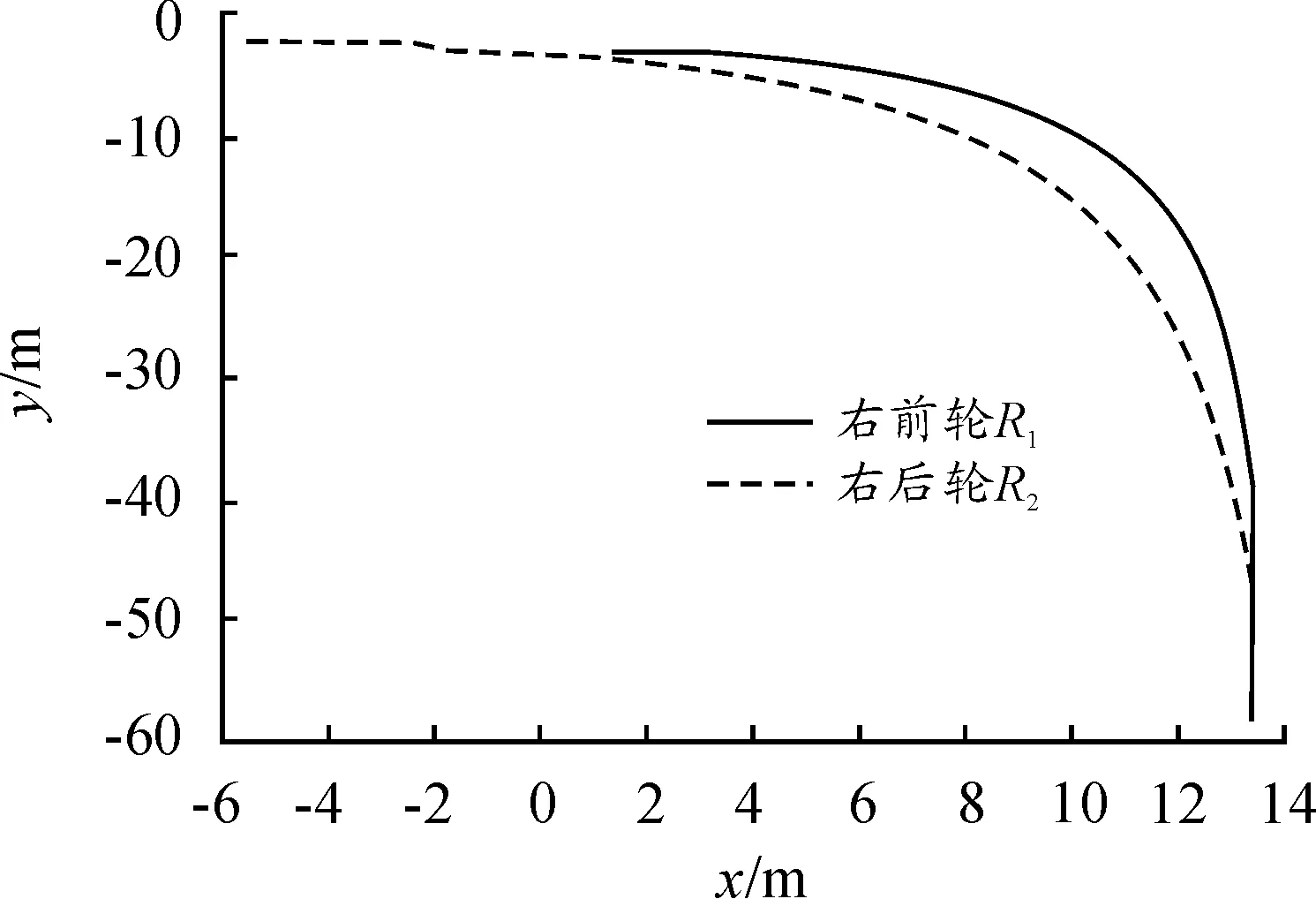

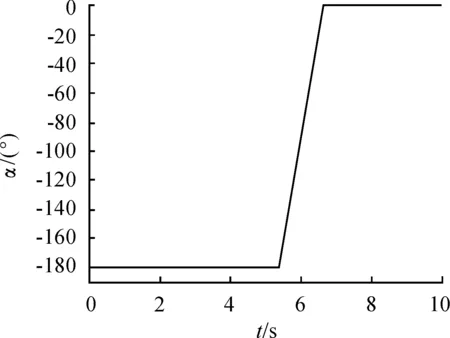

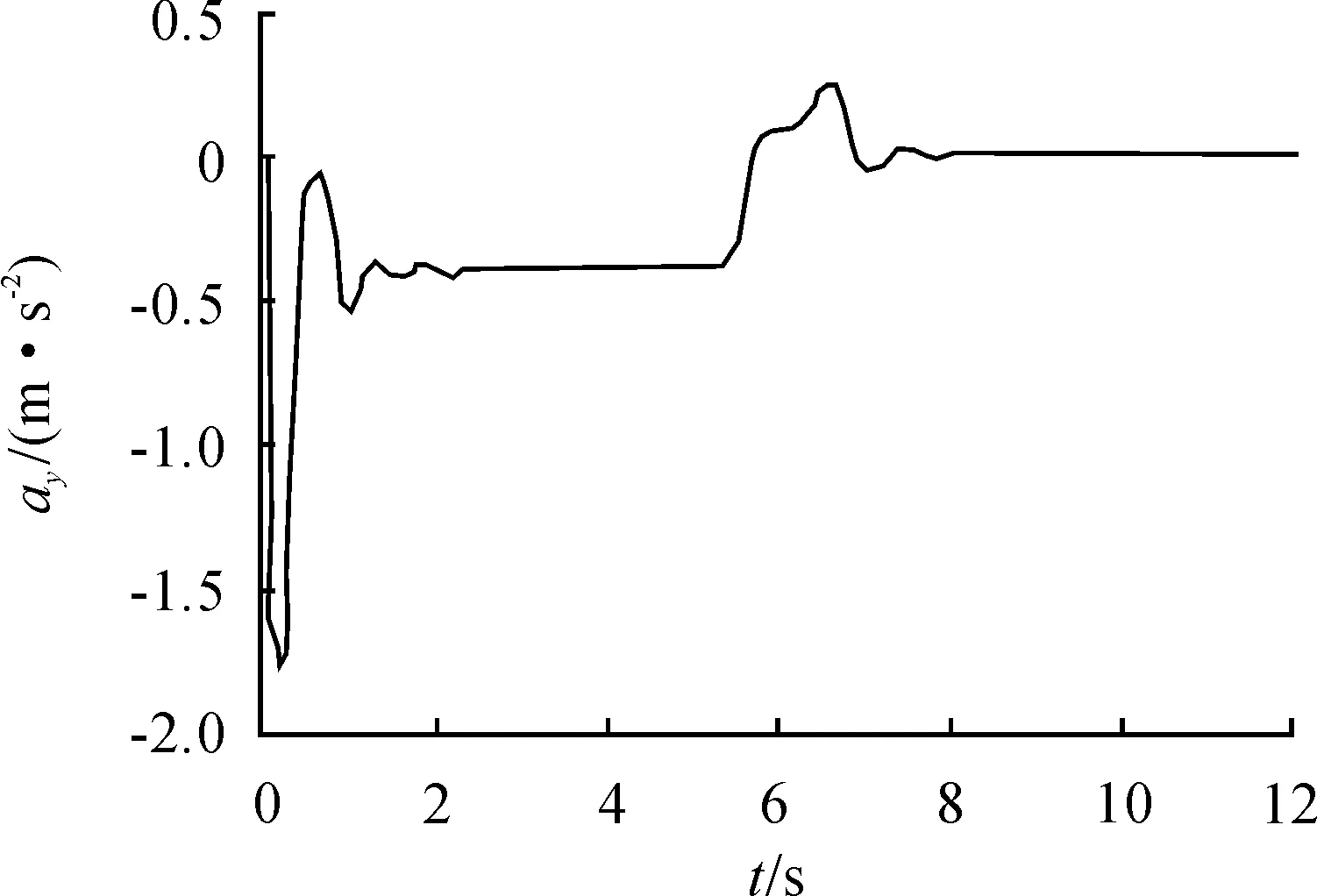

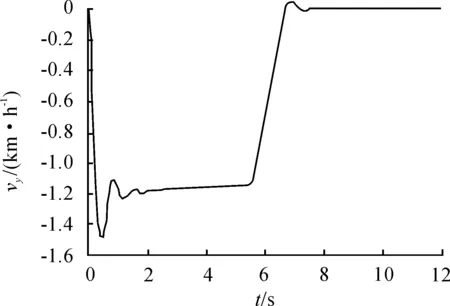

研究发现:一般大型车辆右转弯时其纵向速度都会保持在16~32 km/h。根据表1、表2对车辆参数和右转弯仿真分别进行设置。仿真设置:车速为vx=20 km/h,转向盘转角由 180°转至 0°。进行转向盘转角角阶跃输入下的大型车辆右转弯仿真试验,得到运行轨迹、转向盘转角、侧向加速度、侧向速度等曲线,其中宇通大客车的仿真结果如图4~7所示。

仿真实验结果表明:右转弯行驶时,车辆具有较好的转向性能,不会由于转向盘转角趋于最大值而发生失控;另外,每个变量都趋于稳定且合理;计算得到的内轮差误差小于2%,所以取ΔR=1.527 m是合理的。

图4 车辆运行轨迹曲线

图5 转向盘转角曲线

图6 侧向加速度曲线

图7 侧向速度曲线

2 单目视觉测距

本文采用单目视觉测距来对大型车辆与行人间的距离进行测量。利用图像变换理论、成像模型和视觉测量坐标系,建立了单目视觉测距模型。

2.1常用坐标系

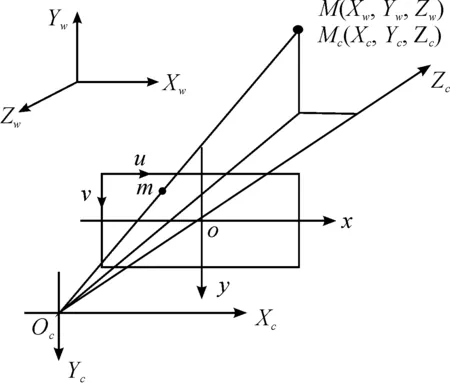

视觉测量中常用到如下一些坐标系,其定义分别如下(见图8):

1) 世界坐标系(Xw,Yw,Zw),即绝对坐标系,通常表示环境中物体的位置。

2) 摄像机坐标系(Xc,Yc,Zc),镜头的光心为原点,光轴为Zc轴,Zc轴、Yc轴分别与图像平面的水平轴、垂直轴平行。

3) 图像像素坐标系(u,v),即帧存坐标,单位为像素,原点为图像左上角端点。

4) 图像物理坐标系(x,y),原点为光轴与图像平面相交点,x和y轴分别平行于u和v轴。

图8 摄像机模型与各坐标系

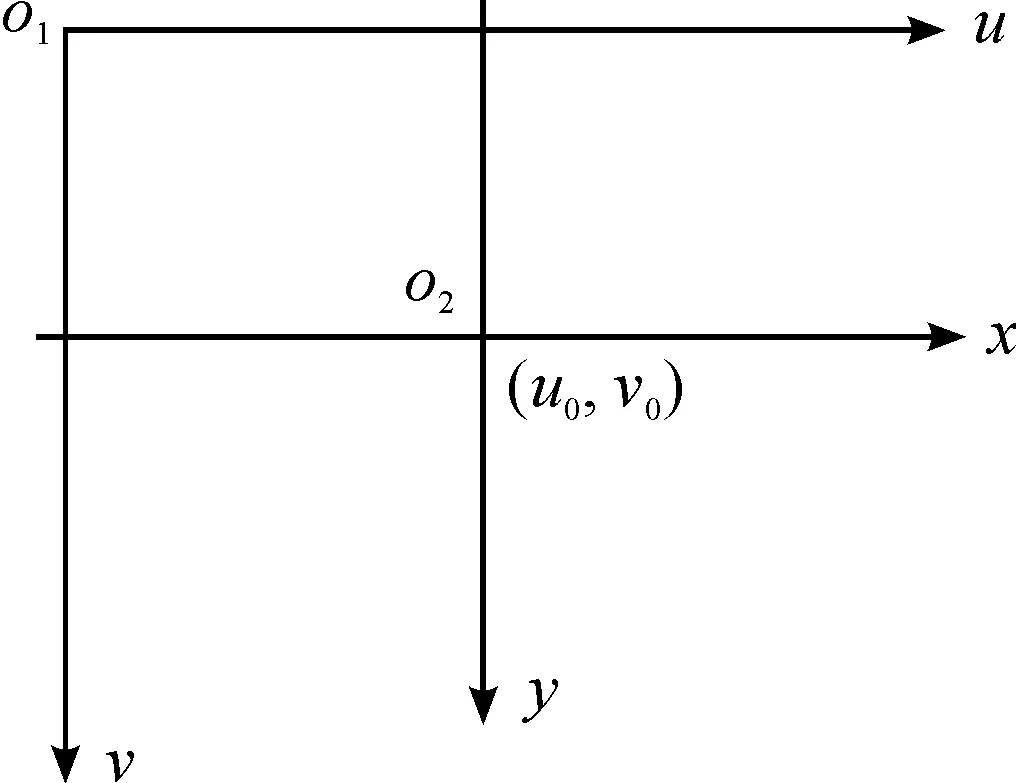

2.2图像像素坐标系和物理坐标系的转换关系

如图9所示,设dx,dy为单位像素在x, y 轴方向的大小,则有:

(2)

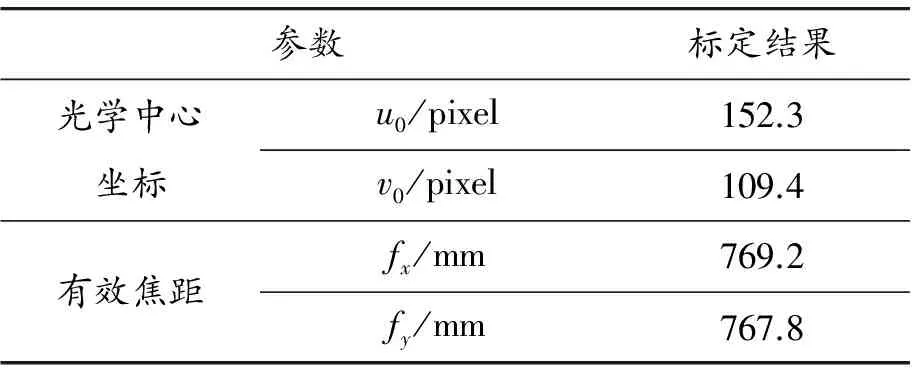

o2(u0,v0)为光轴与相平面相交点帧存坐标。理论上该点在图像的中心,但由于摄像机制作存在误差使得交点出现偏差,所以需要标定摄像机。标定的结果如表3所示。

图9 帧存坐标和图像物理坐标

参数标定结果光学中心坐标u0/pixel152.3v0/pixel109.4有效焦距fx/mm769.2fy/mm767.8

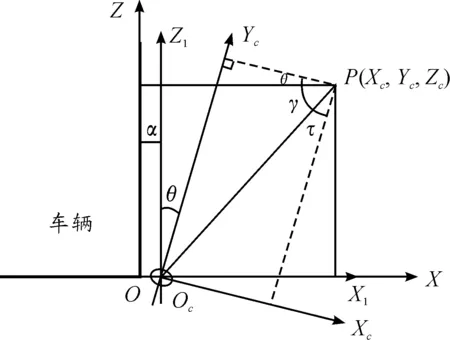

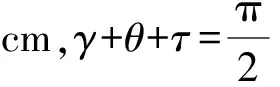

2.3世界坐标系和摄像机坐标系的转换关系

考虑到本文针对的是大型车辆危险区域内的行人测量,所有的距离因素都是相对车辆来说的,所以这里采用车辆坐标系来表示行人在行车环境中的位置,即对车辆坐标系和摄像机坐标系之间的转换进行研究。由摄像机的安装位置可以得到摄像机与车辆之间的几何关系,如图10所示。

图10 车辆与摄像机的几何关系

(3)

其中:

(4)

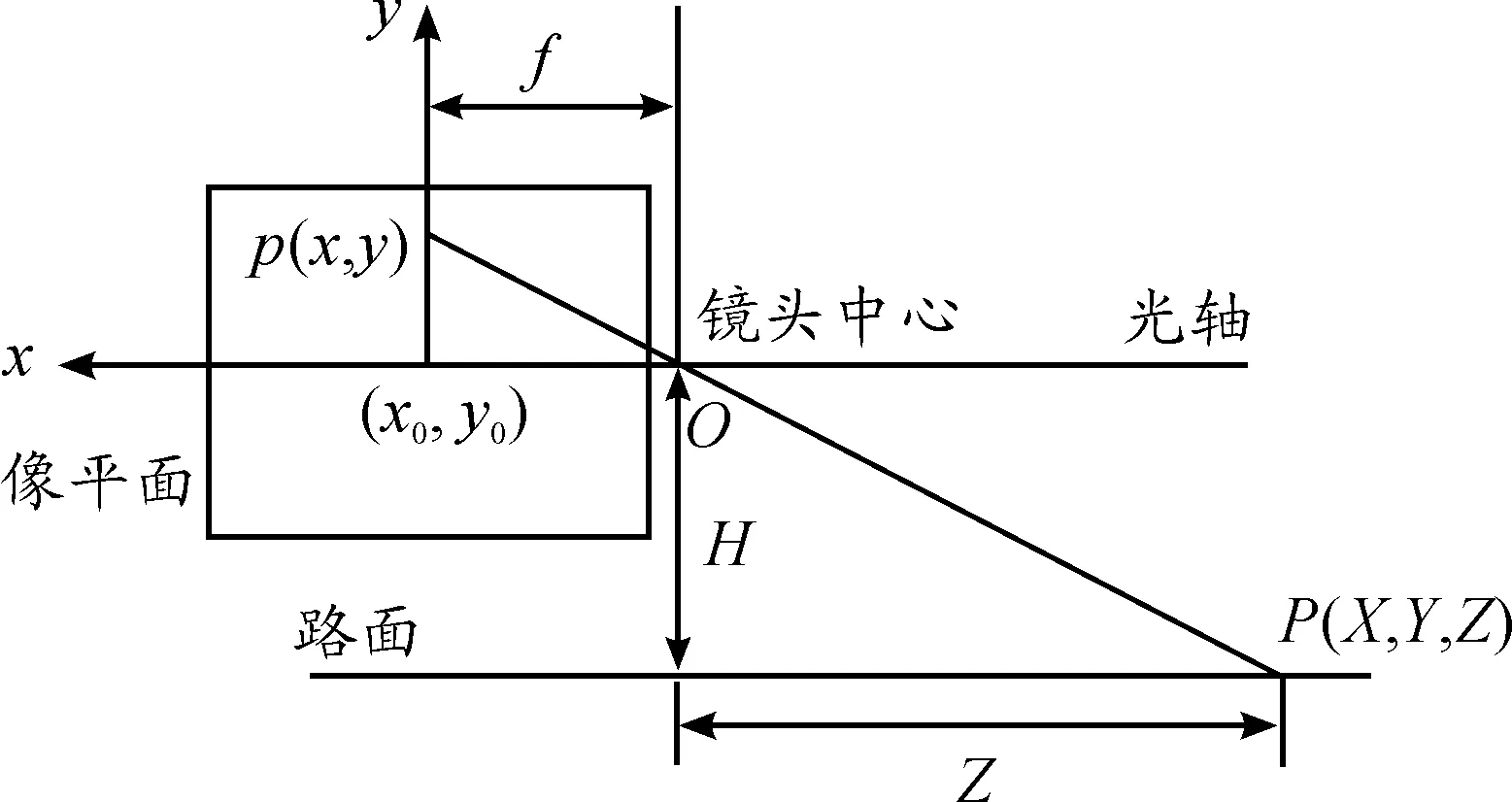

2.4图像坐标系与摄像机坐标系变换关系

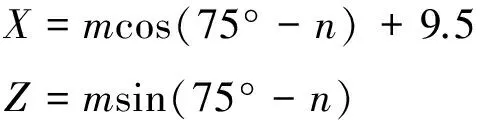

单目视觉的图像采集是将三维场景投影到摄像机的二维像平面[10],该过程可以用针孔成像模型来表示,如图11所示,其中:H为摄像机安装高度(m); (x0,y0)为图像坐标系原点,取(0,0);(x,y)为路面上任一点P在像平面的投影坐标(mm);f为摄像机有效焦距(mm)。根据几何关系得到点P与镜头中心的纵向距离Z和横向距离X的计算公式:

(5)

图11 针孔成像模型

由式(2)和式(5)可以得到空间点P与像点p的之间的坐标变换关系,以齐次坐标表示:

(6)

令fx=f/dx,fy=f/dy,则式(6)可改写成:

(7)

根据式(7)可以计算车辆与行人之间的纵向和横向距离,即得到单目视觉测距模型。

3 预警方法

模糊模式识别在汽车行业通常应用于车型的分类,本文将其应用于碰撞预警方法的研究属于首创。通过聚类分析距离、时间信息得到预警标准模型,利用模糊模式识别的方法来判别待检样本的危险程度。

3.1模糊集合和隶属函数

模糊集合[11-13]是一种以数学语言来表示归属问题模糊性的集合,定义如下:给定论域U,对于任意的x0∈U,都有一个隶属度u(0≤u≤1)与一个模糊集合A对应,称u为集合A的隶属度,记作u=A(x0),x为U中的任一元素,则x对A的隶属函数表示为uA(x)。uA(x)值越大,则隶属于A的程度越高。

1) 模糊样本与模糊集合依据最大隶属度原则进行归属判别。其数学描述:设论域U存在l个模糊子集Ai(i=1,2,…,l),∀x∈U,使得

(8)

当UAi(x)值最大,则说明x隶属于模糊子集Ai,即样本x属于Ai类。

2) 模糊集合与模糊集合依据就近原则来判别。其数学描述:设论域U存在由个模糊子集Ai(i=1,2,…,l)所组成的标准模式集,模糊子集B待识别,则贴近度可由式(9)得到。

(9)

当N(B,Ai)值最大时,则说明待识别子集B与Ai最大相似,即B属于Ai类。

对于集合中的样本,用模糊矩阵R=⎣rij」n×n来表示样本间的相似性,如果R中元素有rii=1,rij=rji,此时R为模糊相似矩阵。一般用夹角余弦法计算:

(10)

其中rij表示xi和xj的相似关系。

当两个集合间不仅为模糊相似关系,还存在传递性时,则称其为模糊等价关系。

传递闭包一般用以下方法构造:

(11)

根据式(11)进行有限次运算后,可得到一个整数k(2k≤n),使得R2k=R2k+2,则R2k即为需要的模糊等价矩阵t(R)。

令R*=⎣rij」n×n为模糊等价矩阵,∃λ∈[0,1]可得λ-截矩阵Rλ的计算公式:

(12)

3.2特征指标的选取

由本文第2节可得到车辆右转弯时的状态参数,其中对本文预警模型有关的参数有:车辆的位置信息,包括内轮差ΔR、转向角和运行轨迹;速度信息,包括侧向加速度ay、纵向速度vx和侧向速度vy。本文特征指标的选取是为了表示行人和车辆间的距离,这是一个二维坐标的问题,只需要求取横向和纵向距离信息即可,这里将位置和时间特征作为预警模型的评价指标。当检测到行人时,依据车辆行驶工况,可以计算出纵向距离X和横向距离Y及所需的时间。因为vx=16 km/h,所以纵向时间tx可由X值计算得出。纵向时间tx是冗余特征,不但影响计算速度(实时性),还会对鲁棒性产生影响。因此,选取车辆与行人的纵向距离X和横向时间tx作为模糊评价指标。

横向时间ty:根据车辆转向盘转角输入下的稳态响应特性 (图6和图7),得ay=0.38 m/s2,横向初始速度vy0=1.17 km/h。车辆的内轮差可近似看成Y方向的距离。因此,在计算横向时间时,必须考虑车辆的内轮差,ΔR=1.527 m,则横向时间ty的计算公式如下:

(13)

3.3模糊聚类分析和模式识别

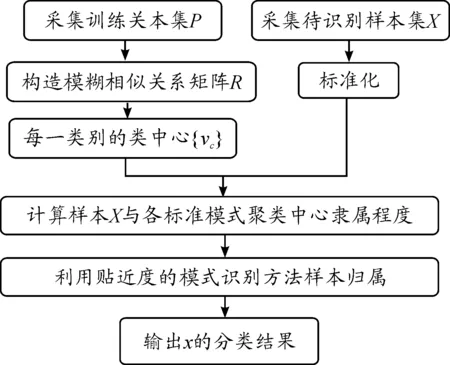

模糊模式识别系统一般主要由两大部分组成,算法流程如图12所示。

图12 模糊模式识别算法流程

1) 样本分类。对一定数量的样本数量进行训练,依据分类函数建立标准模式的类别库,即模糊动态聚类分析。

2) 样本识别。选取模式识别方法,计算隶属度函数进而判断待识别样本在标准模式类别库中的归属类型。其中设模式类别的有e个样本,则该类模式的类中心计算公式如下:

(14)

3.4右转弯盲区预警实验分析

本文的实验设备包括一辆宇通ZK6115BEV2客车、一台笔记本电脑、型号为 MV-130UM 的CCD摄像机。摄像机安装位置与本文所述一致。

样本采集过程:在车辆右侧随机选取至少 30个点,测量出点与车辆的纵向距离和横向距离,让行人站在随机点上,利用摄像机采集图片,采集的部分样本如图13所示。

图13 模糊聚类部分样本

3.4.1聚类分析实验分析

因为行人位置具有不确定性,所以在聚类时采集的训练样本应该足够多,训练后标准模型具有更准确的识别结果。本文包含的情况比较合理。

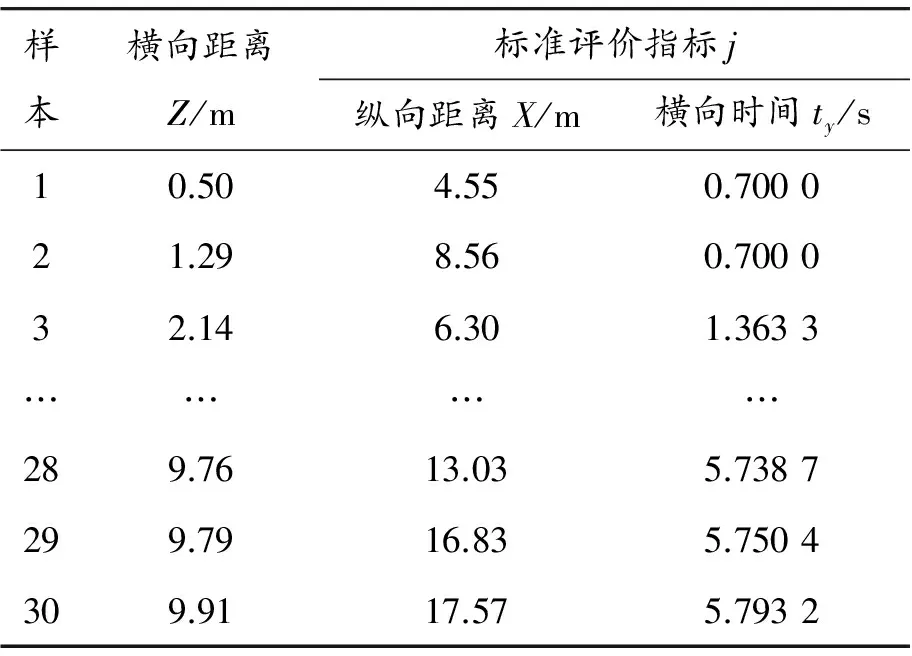

1) 利用3单目视觉测距模型可得本车和行人间的距离信息,即由式(13)计算出训练样本的评价指X和ty,如表4所示。

2) 由表4构造训练样本矩阵P2×30。表4中tymin=0.700 0,经过多次实验验证,tymin值在小范围内对聚类分析结果没有影响。

3) 由式(10)、(11)可计算出模糊等价矩阵R*。

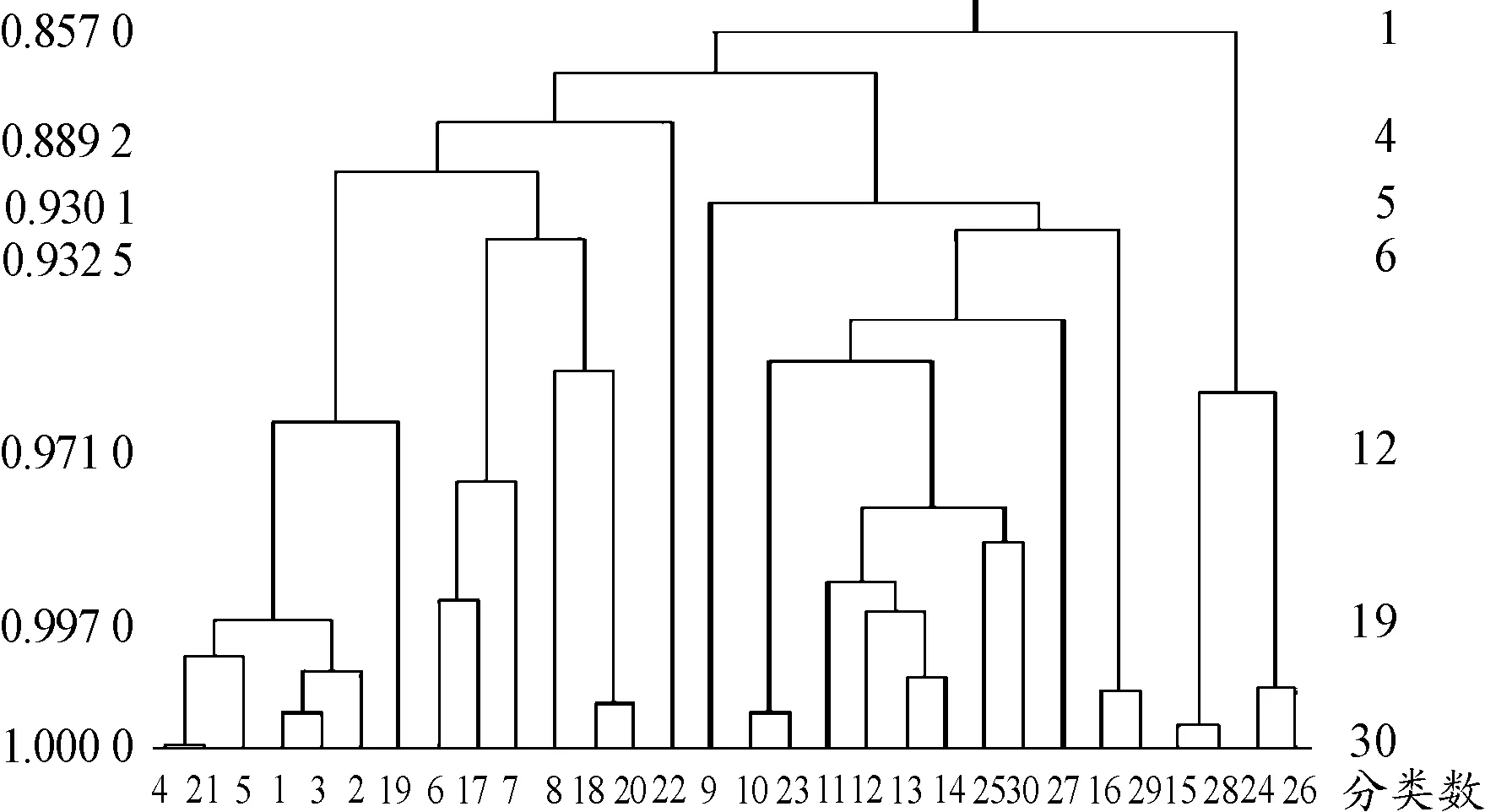

4) 依据λ截矩阵式(12),可以得出模糊等价矩阵R*相对应的λ截矩阵Rλ,将R*中的数按大小排序如下:

1.000 0>0.999 8>0.999 7>0.999 6>0.999 3>0.998 8>0.998 0>0.997 8>0.995 0>0.994 4>0.992 5>0.988 3>0.984 4>0.971 9>0.971 8>0.971 4>0.962 7>0.949 5>0.942 8>0.932 4>0.930 0>0.899 1>0.895 3>0.888 5>0.857 1

依次选取以上各数为λ的水平进行聚类,结果如图14所示。

表4 训练样本的特征值

图14 模糊动态聚类

依据实际需求,设定4种最终分类结果:非常安全、较安全、较危险和非常危险。根据图14,聚类结果与λ值相关。当λ=8 992,样本被分为4类,但是样本 22 作为单独一类,对比其与其他样本的数值大小,该类标准特征值不具全面性和代表性,因此该情况不合适;当λ=0.932 5,有6种类别的样本分类,不符合本文研究需要;当λ=0.930 1,样本被分为5类,样本22作为单独一类,但是,根据本文第1节的安全距离模型,样本22和15,24,26,28在危险区域范围外且数值相近,所以这这些样本归属为同一类,所以取λ=0.930 1最为合理。可以得到最后的分类结果如下:

非常危险D1={p1,p2,p3,p4,p5,p19,p21},为危险等级Ⅰ。该类别样本的各项特征指标均最小,车辆和行人相距过近,此时车辆的行驶状态最危险。

较危险D2={p6,p7,p8,p17,p18,p20},为危险等级Ⅱ。该类别样本的各项特征指标较小,行人处在车辆转弯的危险区域边缘,发生碰撞的可能性较大,安全性较差。

较安全D3={p15,p24,p26,p28,p22},为危险等级Ⅲ。该类别样本的距离特征指标较大,时间指标较小,发生碰撞的可能性较小。行驶过程中与行人的距离会过近,若雨雪等恶劣天气车辆侧滑则存在一定可能与行人碰撞。但总体来说,安全性一般。

非常安全D4={p9,p10,p11,p12,p13,p14,p16,p23,p25,p27,p29,p30}为危险等级Ⅳ。该类别样本的各项特征指标都较大。即此时行人与车辆间相距较远,不会发生碰撞,安全性较高。

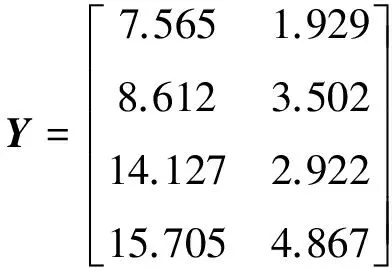

5) 利用加权平均法计算出标准模型{A1,A2,A3,A4},即由式(14)可得其聚类中心,标准指标特征矩阵Y为

且A1={7.565};A2={8.6123.502};A3=(8.6123.502);A4={8.6123.502}。

3.4.2模糊模式识别实验分析

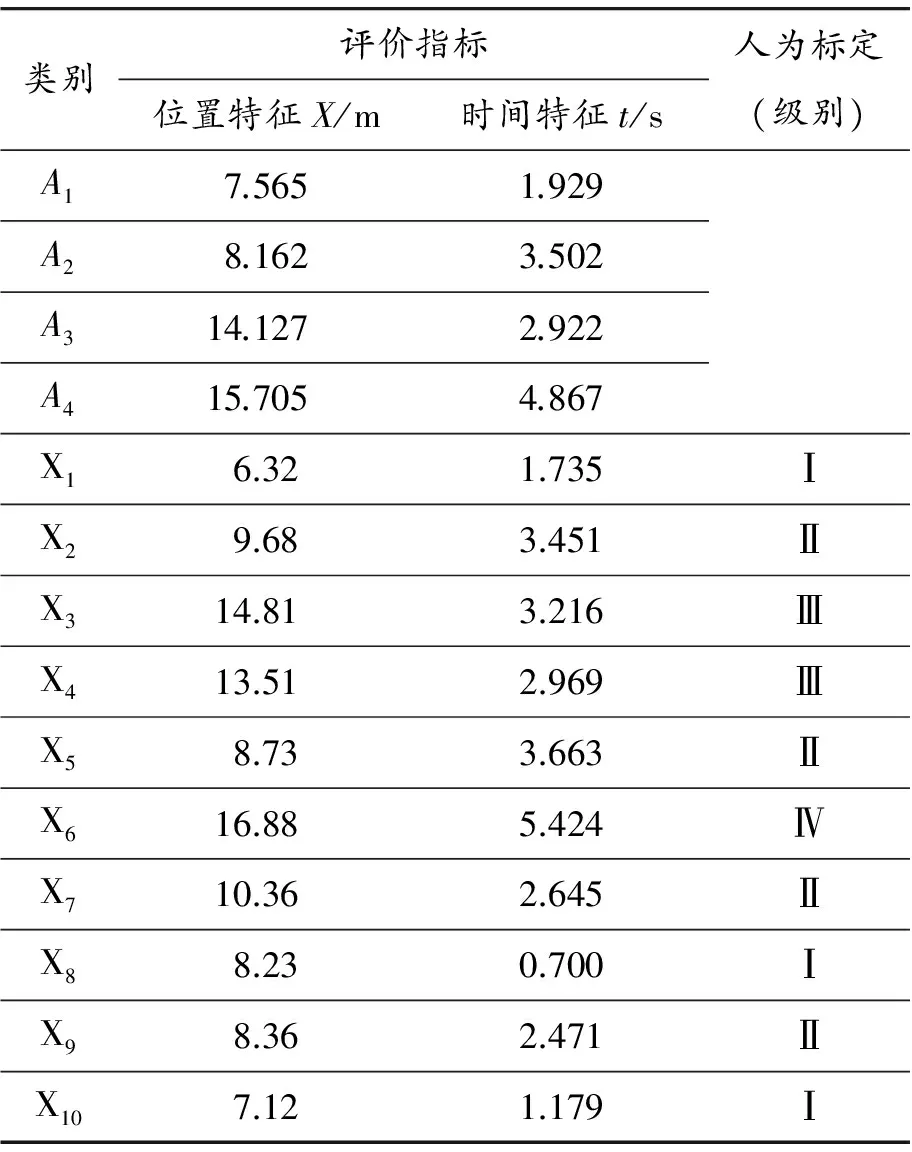

在模式识别时,采用择近原则,而贴近度的计算方法采用格贴近度,待识别样本随机获取,部分样本如图15所示,共10组数据。为验证模式识别的效果,进行识别前人为标定待检测样本,如表5所示。

图15 待识别样本

实验的基本过程如下:

1) 数据标准化:对待识别样本组成的新矩阵进行标准化。

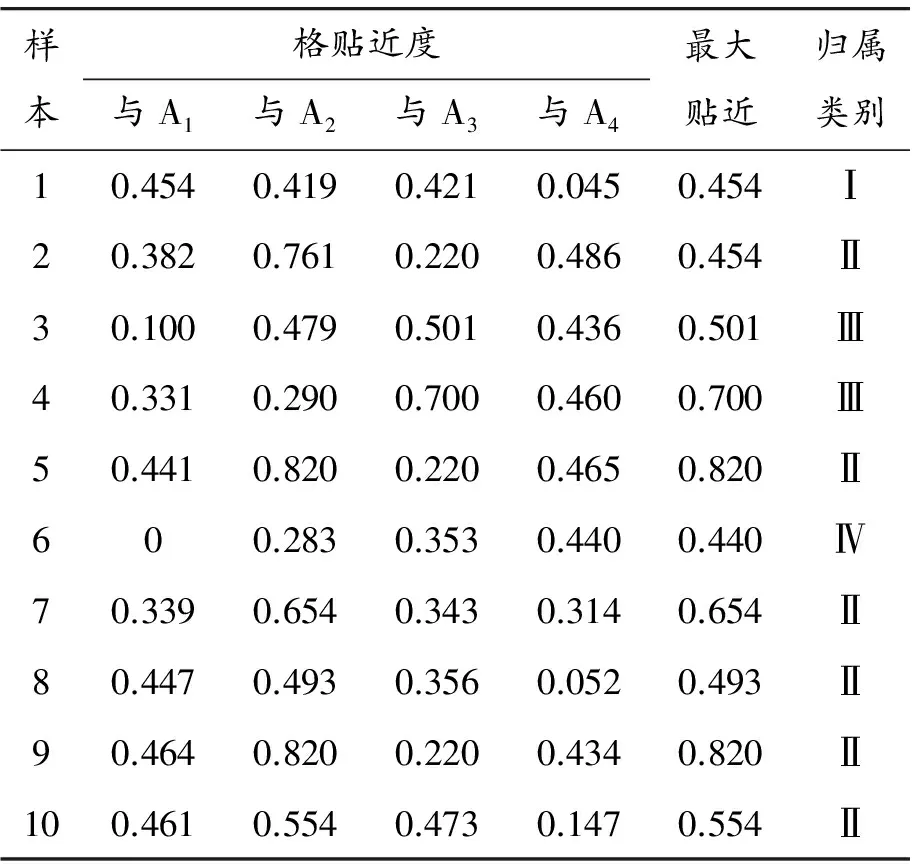

2) 由式(9)可得出标准模型和待识别样本间的贴近度,依据择近原则对其归属进行识别,结果如表6所示。

表5 标准模型和待检样本数据

表6 识别结果

由表6可得:X1,X3和X10与4类标准模型间的格贴近度的数值相差较小,即对其隶属程度相近。这是因为:两个特征指标(时间、位置特征)很大程度上是随机的,没有一定的关联性,若样本各特征指标处在标准模型分类临界范围内,就产生该样本对标准模型具有相近的隶属程度。对比表5、6,发现样本 5与样本10识别结果与标定结果不符合,虽然存在不同的归属判定程度,但都归属危险类别,而不是危险与安全的本质区别。另外 8 组样本的标定和识别结果相同,表明该方法有良好的识别效果。

4 结束语

从仿真结果可知,车辆尺寸和轴距越大,右转弯过程中产生的内轮差越大。大型车辆的内轮差一般可达1.5~2.5 m。

在模糊聚类分析的条件下,对车辆右转弯时的状态参数进行分析,选取纵向距离X和横向时间两个优良特征作为模糊评价指标。

基于模糊模式识别的预警方法,可以准确地对行人的位置信息进行危险等级分类,具有较好的识别效果。

本文只研究了大型车辆右侧盲区的碰撞预警,而未涉及盲区内行人检测和跟踪算法的研究。如何获取行人运动轨迹,使行人得到更好的保护,今后可进一步研究探讨。

[1]李宗烜.大型商用车右侧碰撞预警系统[D].武汉:武汉理工大学,2014.

[2]姚丁茂.大客车防撞预警系统仿真平台的开发研究[D].西安:长安大学,2014.

[3]GB15804—2013,机动车辆间接视野装置性能和安装要求[S].

[4]文彤.戴姆勒-奔驰重型货车的未来驾驶辅助系统[J].新技术与应用,2013 (10):38-42.

[5]LEANNE M,ALEXANDER ZELINSKY.Stereo Panoramic Vision for Monitoring Vehicle Blind-spots[C]//2014 IEEE Intelligent Vehicles Symposium.Parma:IEEE,2014:14-17.

[6]TODD R.Evaluation of a radar-based proximity warning system for off-highway dump trucks [J].Accident Analysis and Prevention,2013(38):92-98.

[7]MICHAEL K,HERMANN ROHLING.24 GHz radar sensors for automotive applications [J].Journal of Telecommunications and Information Technology,2015(4):11-14.

[8]李军,魏民祥.基于“蝇眼”传感网络的大型车辆防撞系统研究[J].农业装备与车辆工程,2012(3):3-6.

[9]李守晓,毕欣.毫米波雷达汽车盲点检测系统研究与设计[J].机械设计与制造,2013(9):25-31.

[10]章毓晋.图像理解与计算机视觉[M].北京:清华大学出版社,2013.

[11]孙庆声,缪旭东.一种基于模糊集的舰空导弹作战通道决策模型[J].四川兵工学报,2009,30(5):22-24.

[12]宋凌怡,舒涛,周德荣.基于超模糊集的Canny边缘检测在花椒图像中的应用[J].重庆工商大学学报(自然科学版),2016(3):38-42.

[13]陈水利,李敬功,王向公.模糊集理论及其应用[M].北京:科学出版社,2012.

(责任编辑刘舸)

Research on Collision Warning of the Right Blind Area for Large Vehicles

GE Ru-hai1, 2, HONG Zhi-fu1

(1.School of Automotive and Traffic Engineering, Jiangsu University, Zhenjiang 212013, China;2. School of Automobile and Traffic, Wuxi Institute of Technology, Wuxi 214121, China)

In order to reduce injuries of pedestrians on right-turning collision of large vehicles, a collision warning method of right blind based on pattern recognition was proposed. Firstly, the main reasons for the right-turning accident were analyzed to establish the mathematical model of the inner wheels difference and to calculate its size. Using the vehicle dynamics simulation software (TRUCKSIM), we built right-turn simulation model of a passenger car to obtain the operating parameters of vehicle in this condition, as well as to verify the validity of the inner wheels difference. At the same time, the distance measurement between the vehicle and pedestrians was achieved by the use of monocular vision ranging model. Based on which, selecting some valid features indicators of samples in training and recognizing and analyzing samples collected by fuzzy dynamic clustering are to gain the standard model of early warning methods needed. Finally, wee calculated the membership grade between standard model and hazard level of samples to be recognized was classified. Experiments show that this method can effectively identify dangerous situations.

right-turing collision; dynamics simulation software (TRUCKSIM); monocular ranging; warning method; fuzzy pattern recognition

2016-03-11;

2016-04-28

国家自然科学基金资助项目(61403172,51275211);中国博士后科学基金资助项目(2013M541607)

葛如海(1957—),男,江苏如皋人,博士,教授,主要从事汽车被动安全性及汽车轻量化研究;通讯作者 洪志福(1990—),男,福建泉州人,硕士研究生,主要从事汽车主被动安全研究,E-mail:achilles_h@yeah.net。

format:GE Ru-hai, HONG Zhi-fu.Research on Collision Warning of the Right Blind Area for Large Vehicles [J].Journal of Chongqing University of Technology(Natural Science),2016(10):1-10.

10.3969/j.issn.1674-8425(z).2016.10.001

U471.15

A

1674-8425(2016)10-0001-10

引用格式:葛如海,洪志福.大型车辆右侧盲区碰撞预警方法研究[J].重庆理工大学学报(自然科学),2016(10):1-10.