压缩光场重建与深度估计

刘晓旻,马治邦,王前程,杜梦珠,朱云飞,马凤英,梁二军

(郑州大学 物理工程学院,河南 郑州 450001)

引言

光场是空间中每一个点和每一个方向辐射函数的总和[1],光场图像蕴含了物方全部的三维信息,可用在重聚焦[2]、超分辨[3]、深度估计[4]、显著性检测[5]、以及三维重建[6]等领域。目前获取光场的途径主要有3种:相机阵列[7]或者单个相机进行移动[1]、微透镜阵列法[2]以及掩膜法[8]获取光场。相机阵列成本高,体积庞大,限制了它的应用,单个相机移动采集光场仅限静态场景。微透镜阵列法采集光场虽然光场采集设备轻便,但该方法采集的光场的空间分辨率(光场子图像大小)和角度分辨率(光场视角个数)存在制约,不能得到和传感器分辨率一样的光场子图像。掩膜法是将掩膜加入到成像系统中,对光线进行调制,再通过重建算法恢复出光场数据,这种方法可以解决光场空间分辨率与角度分辨率制约问题,恢复出的光场子图像大小和采集到的光场图像大小一致。目前研究光场重建主要有Ashok、Babacan等人分别用光学编码方法采集压缩光场[9-10],常雷等人分析掩膜光场成像的特点并仿真验证[11],刘永春等人仿真验证基于掩膜的光场采集与重建[12]。覃亚丽利用低秩矩阵分解完成光场稀疏采样和重建[13]。光场的深度估计是指将采集的光场通过一系列计算获取场景的深度信息,是当今国内外研究热点之一。目前研究光场深度估计的主要有:Wanner和Kim等人利用对极平面图(EPI)通过计算优化得到最终深度图[4,14],但EPI计算深度计算量大,容易受噪声影响。Chen、Heber、Jeon等通过求解不同微透镜所对应子图像间的匹配关系来获取深度信息[15-17],对匹配噪声难以抑制。Tao和Wang等人利用图像的散焦信息为基础,融合图像其他信息后得到最终深度图[18-19],其深度估计结果边缘效果不理想。

综上所述,为了有效降低光场采集、处理和传输的数据量,提高深度估计结果边缘处的准确性,本文利用压缩感知原理仿真重建了压缩光场,同时在文献[19]的基础上提出了一种新的融合场景多种信息的深度估计算法,并实现对仿真重建出的光场的深度估计。通过K-SVD算法训练学习获取光场过完备字典,使得光场可以稀疏表示。然后利用压缩感知重建算法仿真重建出5×5视角光场。获取光场数据后,实现光场的重聚焦,对于存在遮挡区域,采用方差较小的部分代替整个角度像素块,计算聚焦不同深度处的角度像素块的均值和方差之和的最小值作为初始深度,最大值和次最大值的比值作为置信度。然后计算中心视角图像边缘信息,最后通过融合初始深度、置信度、边缘信息得到最终深度。实验通过压缩感知原理仿真实现了多视角光场重建,并且对仿真重建光场和公开光场数据进行了深度估计,实验结果表明,本文的深度估计算法在场景边缘处的深度估计结果边界清晰,层次分明。

1 压缩感知原理

压缩感知是一种新的采样理论[20],突破了奈奎斯特采样定律的限制,在采样频率低于信号最高频率的2倍时,也能精确重建信号,只要满足:1)原始信号可以在稀疏基下稀疏表示;2) 稀疏基Ψ与测量矩阵Φ满足约束等距性(RIP)就能够高概率地重构原始信号。信号f(f∈Rn)压缩感知理论采样过程可表示为

y=Φf

(1)

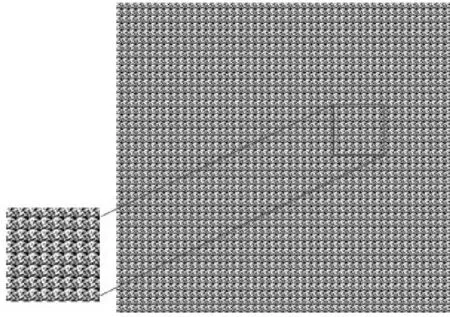

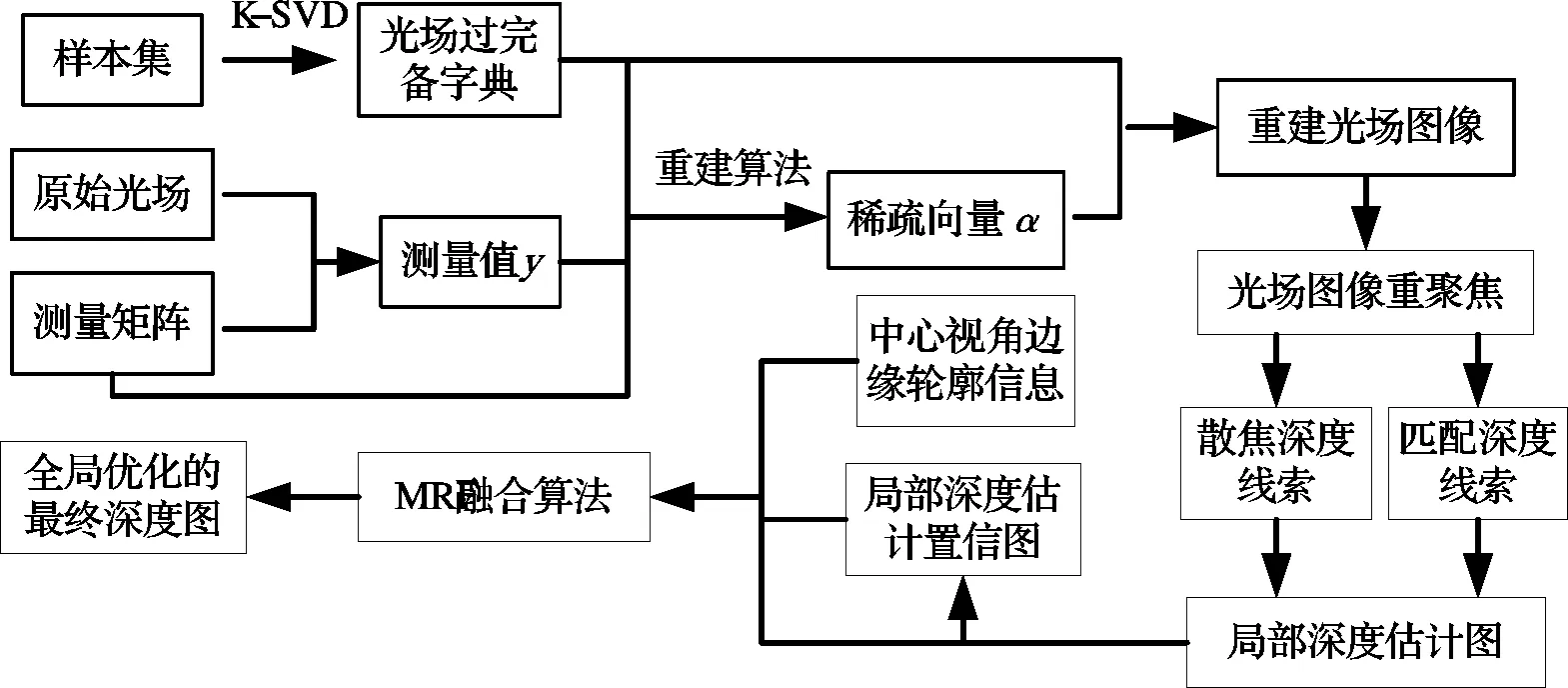

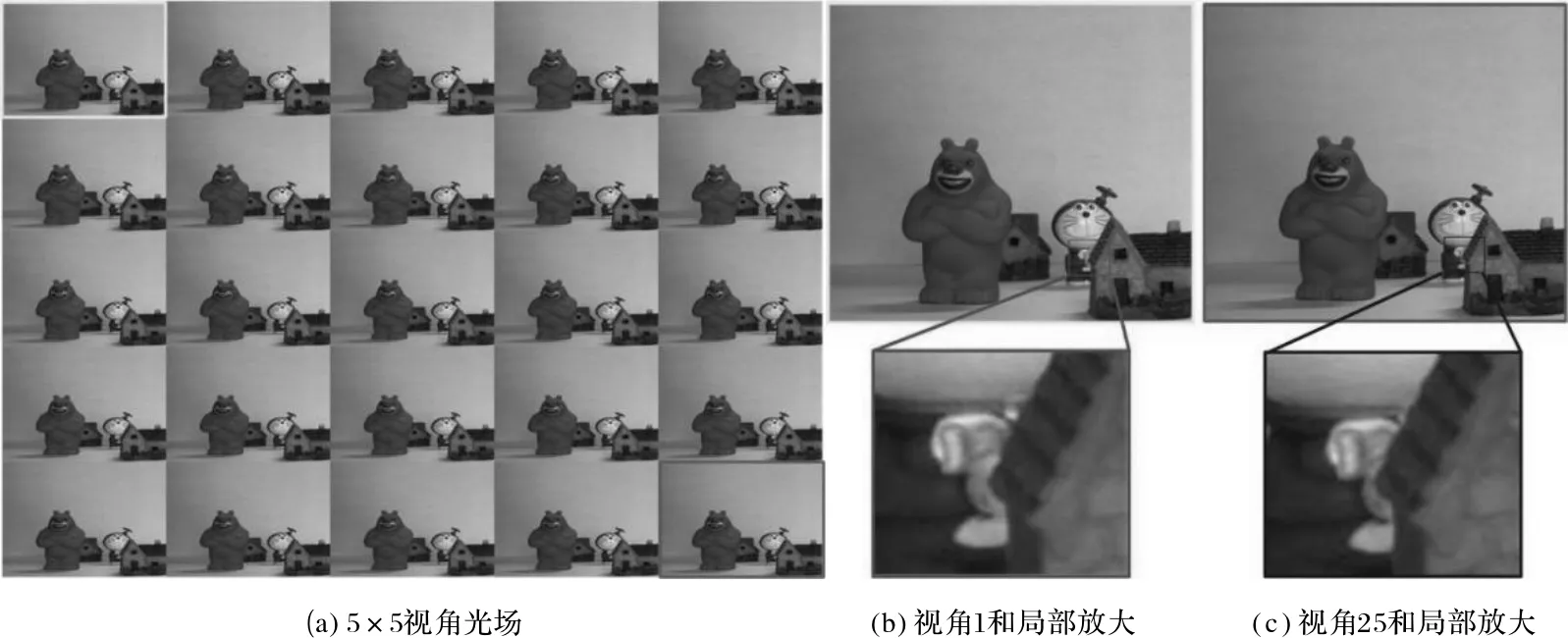

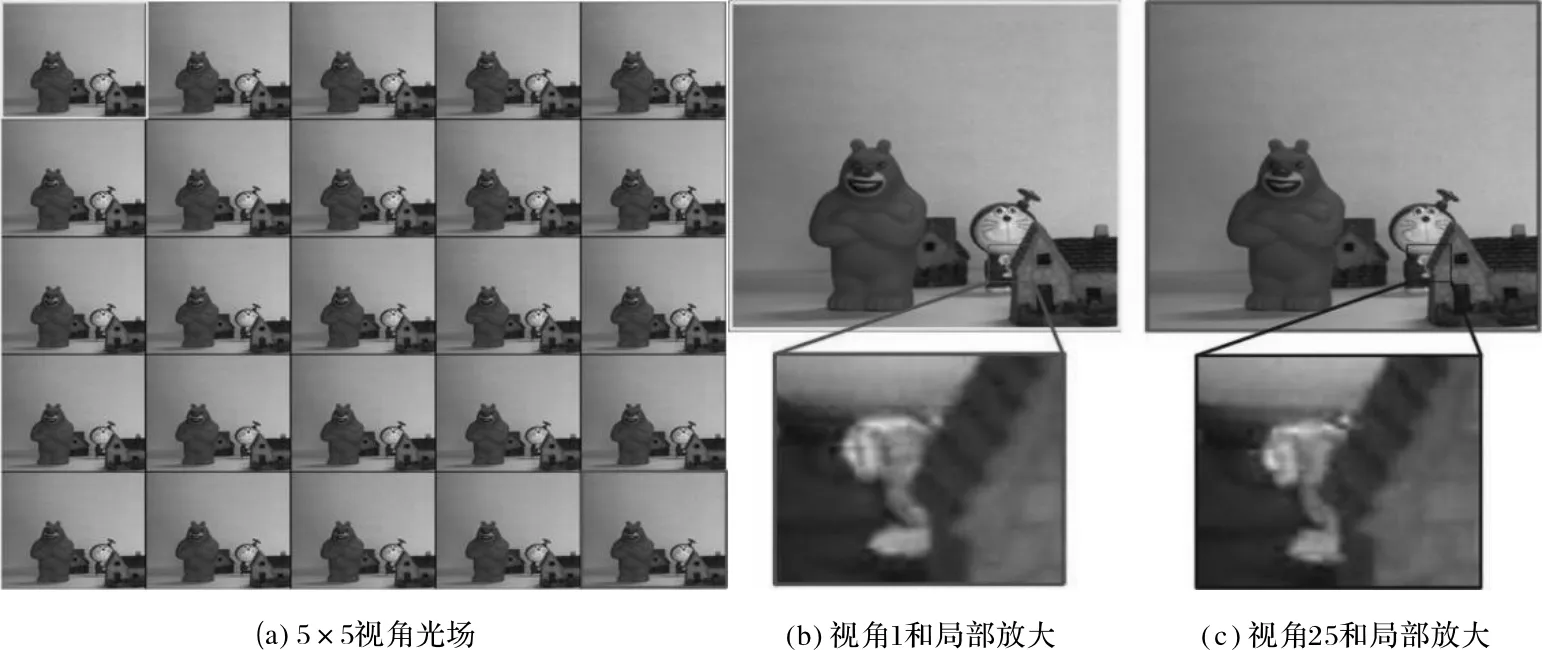

式中:Φ(Φ∈Rm×n(m< f=Ψα (2) 那么压缩感知的测量公式可表示为 y=ΦΨα=Θα (3) 由于光场的复杂性,光场不能由单一完备基来稀疏表示。本文选择过完备字典作为稀疏基Ψ,提高复杂光场稀疏表示的通用性。通过采集多组光场样本数据作为光场样本集,将光场样本集随机分成多个p×q光场碎片,再利用K-SVD[21]算法训练学习获取这个稀疏基Ψn×d(n 图1 部分光场过完备字典可视化Fig.1 Part of visualization over-complete light field dictionary 测量矩阵Φ将完整光场值传递到测量值y,完成信号的线性测量和降维,即在采集光场图像时实现数据压缩。测量矩阵Φ与稀疏基Ψ共同构成传感矩阵Θ,重建原始信号时需要传感矩阵能够高概率地满足约束等距性[21]。测量矩阵Φ与稀疏基Ψ之间高度不相干,则传感矩阵Θ满足k阶约束等矩性。为了最大程度地满足Φ与Ψ的不相干性,更好重建5×5视角的4D光场图像,对测量矩阵进行改进,我们所用测量矩阵仍是随机矩阵,但不直接生成等同图像空间分辨率为808×808像素的随机矩阵(如图2所示),而是每次只生成等同分割块大小8×8像素的随机矩阵,之后用多次生成的8×8像素大小随机矩阵组合成大小为808×808像素的矩阵作为测量矩阵(如图3所示)。这样的测量矩阵具有更高的随机性,且与冗余字典能满足约束等距性(RIP)。 图2 随机测量矩阵Fig.2 Random measurement matrix 图3 优化随机测量矩阵Fig.3 Optimization of random 当传感矩阵满足阶约束等距性时,用l1最小化代替l0最小化,稀疏重建模型[20]可以表示为 mina‖α‖1s.t.y=Θα (4) 采用LASSO(least absolute shrinkage and selection operator)模型来求解。引入噪声约束参数λ更准确描述,拉格朗日方程表示约束项形式为 mina‖y-Θα‖2+λ‖α‖1 (5) 采用交替方向乘子ADMM[22](alternating direction method of multipliers)算法求出稀疏向量α,再由过完备字典Ψ与稀疏向量求出原始光场。 重建时,需要将采集的二维光场图像,即测量值y转变为N×1数组进行计算。计算时数据量大,为了提高计算效率,采用滑动分块法重建光场,滑动模块大小为8×8像素。 光场成像中,可以通过计算像点角度像素块[19]特征来表征场景中的深度信息。通过数字重聚焦原理[23]获得不同深度聚焦序列图像。计算不同深度聚焦图像角度像素块的均值和方差来表征匹配线索和散焦线索。为使初始深度估计准确,用匹配线索和散焦线索之和的最小值来表示初始深度。用匹配线索和散焦线索之和的最大值和次最大值比值表示置信度[19]。通过融合场景初始深度、置信度、中心视角图像边缘信息来获取最终深度。 当重聚焦到α处时。遮挡区域被遮挡物分割成2个区域,方差小的区域用i表示,匹配线索用Cα(x,y)表示、散焦线索用Dα(x,y)表示,则有: Cα(x,y)=Vα,i(x,y) (6) Dα(x,y)=(Iα,i(x,y)-L(0,0,x,y))2 (7) 式中Vα,i(x,y)、Iα,i(x,y)分别表示聚焦在α处时,角度像素片的方差和均值。 初始深度用Z(x,y)表示,置信度用W(x,y)来表示,有关系式: Hα(x,y)=Cα(x,y)+Dα(x,y) (8) Z(x,y)=argminαHα(x,y) (9) W(x,y)=Hα(x,y)/Hα2(x,y) (10) 本文在最终深度的计算过程中融合图像边缘信息来增加场景边缘处深度估计准确性,其最终深度的计算是利用马尔卡夫随机场来传播,定义能量函数为 (11) Eunary部分的计算类似于Tao[24]里面(MRF propagation)表示初始深度Z(x,y)与置信图W(x,y)之间运算,表征着该点深度估计可靠性。 中心视角图像相邻像素之间灰度变化可表示为▽i(p,q),有关系式: (12) 式中:W(p)表示初始深度响应;p,q表示两相邻像素;分子部分表示相邻像素初始深度的变化;分母部分表示图像边缘信息。初始深度和场景中边缘信息融合可以增加场景中边缘处深度估计效果,使边缘更明显,深度结果更准确。 实验设备有:北京卓立汉光微米级三维平移台2个,维视工业相机MV-VEM200SC 1个。实验数据处理使用Intel(R) Core i7-3770 计算机,参数为CPU3.40 GHz、内存16.0 GB、Windows7 64位,处理软件为MATLAB2016b和vs2010。 图4 实验流程图Fig.4 Experimental flow chart 利用三维平移台采集5×5视角真实光场数据组成原始光场数据,每个光场子图像大小为808×808像素,如图5所示。然后用MATLAB生成808×808像素周期排列的测量矩阵。将采集到的光场子图像与相应的测量矩阵点乘再相加,得到仿真的压缩传感测量值y。然后利用上述的重建算法重建出5×5视角的光场图像,公式(5)中正则化参数取2,仿真重建结果如图6所示,局部放大图像为90×90像素。 图5 原始光场图Fig.5 Origin light field images 图6 仿真重建光场图像Fig.6 Reconstruction light field images 通过图5和图6可以看出,仿真重建出的光场具有视差。但由于平移台精度以及实验操作时的精度不能达到亚像素级,所以造成重建光场清晰度有所下降,但是平滑效果好。 为验证本文深度估计算法的准确性,用HCI大学光场数据“monasRoom”进行深度估计,分别用本文方法、Wang方法[19]、Tao方法[24]和Mousnier方法[25]进行深度估计,结果如图7所示。从深度估计结果可以看出,与其他方法相比,本文方法的深度估计结果更好。在最终深度计算时,融合了图像的边缘信息,所以在场景边缘处深度估计结果更准确。 图7 “monasRoom”深度估计结果Fig.7 Results of “monasRoom” depth estimation 在文献[19]的基础上,提出了融合初始深度、置信度、边缘信息的深度估计算法,用边缘信息代替文献[19]深度正则化中遮挡预测的计算,在不影响计算精度的前提下,降低了时间开销。分别用本文和文献[19]对HCI大学的光场数据以及合成光场数据进行深度估计,其深度估计的结果与基准深度图做对比,用均方误差(mean squared error,MSE)作为误差评价标准,实验结果如表1所示。MSE定义为 (13) 表1 时间开销与MSE对比Table 1 Comparison of time cost and MSE 从表1中时间复杂度对比中可看到:利用边缘信息替代遮挡线索优化初始深度图,降低了程序运行的时间开销,同时能够获取高精度的深度图。 用本文的深度估计方法分别对采集的原始光场、仿真重建出的光场进行深度估计,实验结果如图8所示。从图8可以看出,重建光场深度估计结果分层没有原始光场深度估计结果明显,原因在于重建光场的视差比原始光场有所减少。 图8 深度估计结果Fig.8 Results of depth estimation 为了验证重建光场深度估计准确度,用本文的深度估计方法分别对“monasRoom”和仿真重建的“monasRoom”进行深度估计,实验结果如图9所示。通过与基准深度对比,可以看出原始光场和仿真重建光场的准确性。 图9 深度估计结果Fig.9 Results of depth estimation 文中采用压缩感知原理仿真实现多视角光场重建,通过融合光场的初始深度、置信度、边缘信息实现光场深度估计,系统地完成了从仿真压缩光场采样获取光场数据,到重建光场,最后得到深度估计结果的整个过程。实验结果表明仿真重建光场可以用于深度估计。深度估计结果表明本文方法在场景边缘处有更好效果,边缘轮廓清晰,分层明显。实验验证了单个相机单次曝光便可重建出一组5×5视角的光场图像,将光场图像的采样率降低为4%。为降低光场采集、处理和传输的数据量,提高边缘处深度估计结果的准确度提供了实验依据。为后续搭建更准确的物理平台,实现测量矩阵调制真实入射光线,提高重建光场的精度,为采集、重建、深度估计一体化奠定了实验基础,可用在三维重建、三维显示等领域。1.1 光场稀疏表示

1.2 光场测量矩阵设计

1.3 光场重建算法

2 光场深度估计原理

2.1 初始深度和置信度

2.2 最终深度计算

3 实验结果

3.1 压缩光场仿真重建

3.2 公开光场数据深度估计结果

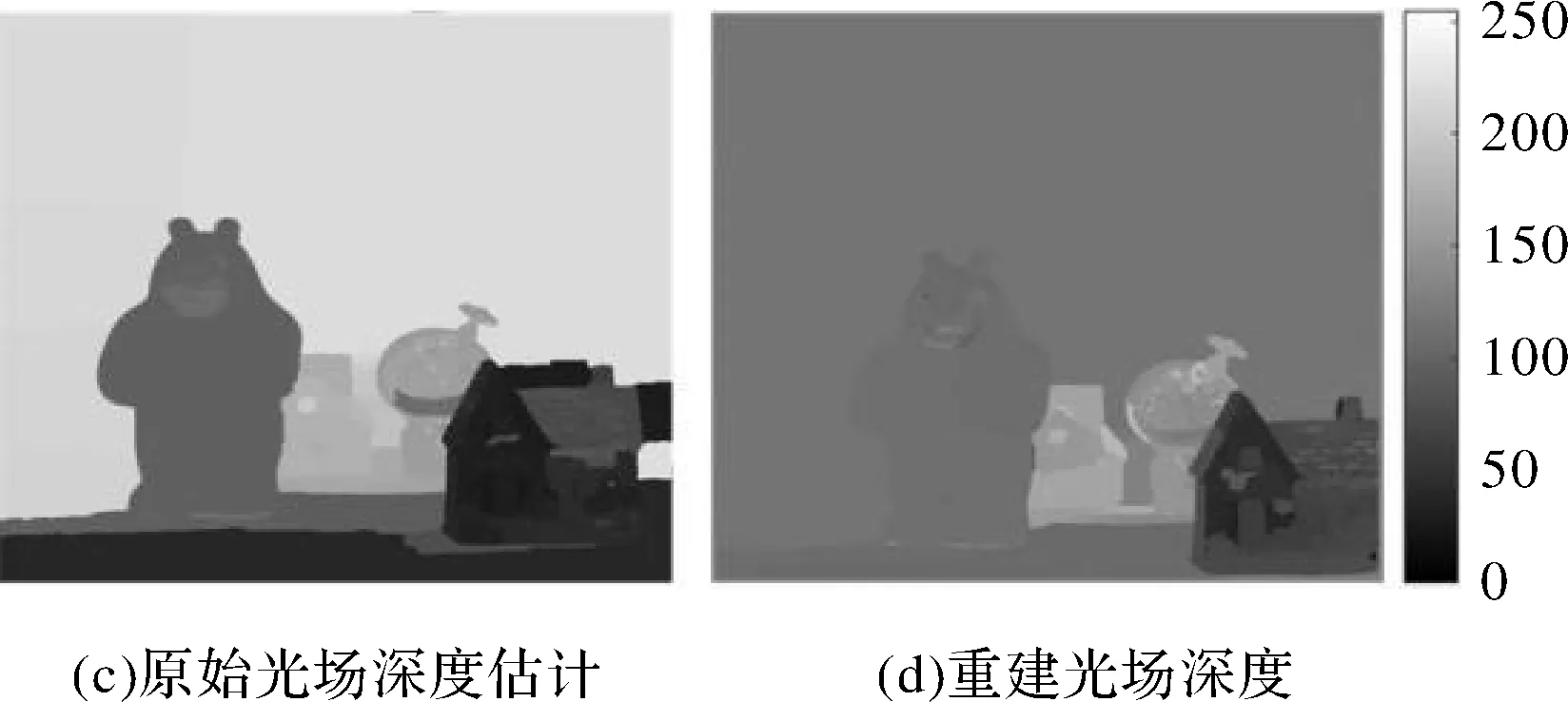

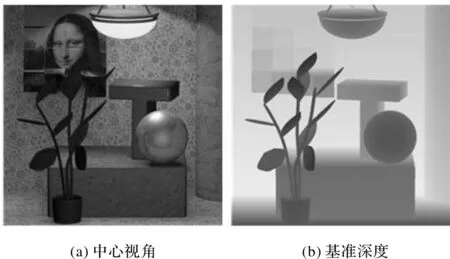

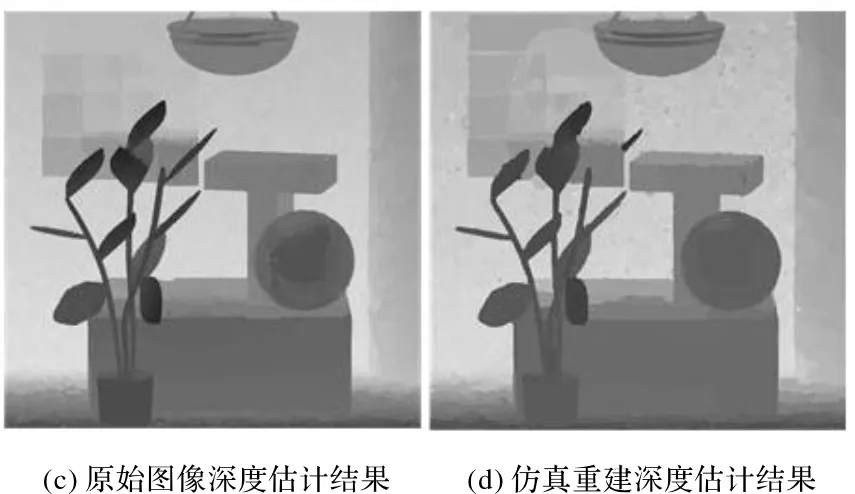

3.3 原始光场和仿真重建光场深度估计结果

4 结论