基于情感轮和多任务卷积神经网络的图像情感分布学习

赖金水,万中英,曾雪强

(江西师范大学计算机信息工程学院,江西 南昌 330022)

0 引言

图像情感分析任务的目标是挖掘出图像中隐含的人们的情感倾向,是一项涉及计算机视觉、心理学和美学的多学科交叉任务[1].近年来,图像情感分析因其在人工智能领域中的广泛应用而已成为机器学习领域的一个研究热点并受到大量关注[2-3].

与传统的计算机视觉任务相比,图像情感分析任务更具有挑战性,主要体现在2个方面:(i)图像很少表达单一的情绪,而往往是多种不同情绪的混合[4];(ii)人类各种情绪之间存在较高的相关性[5].图1展示了来自Emotion6数据集的6个样本及其对应的情绪标注,由图1(a)和图1(e)可见,高兴情绪与惊讶情绪表现出较高正相关性;由图1(d)可见,该图像的主导情绪是愤怒,但同时也蕴含了大量的恐惧与惊讶的情绪.因此,多情绪分析和情绪间的相关性是情绪分析模型需要考虑的重要因素.

目前,图像情感分析方法主要包括2个大类.一类是基于单标签学习或多标签学习[6]的方法,其主要特点是为每幅图像分配1个或多个情绪标签.基于单标签学习或多标签学习的方法可以借鉴经典的分类模型来实现情绪标签的预测,但不能对图像在各种情绪上的表达程度进行定量分析.另一类是基于情感分布学习的方法.Zhou Ying等[7]提出情感分布学习(emotion distribution learning,EDL),其核心思想是将图像在各个基本情绪上的表达程度作为图像的情感分布,学习图像中的特征与情感分布之间的相关信息.EDL模型对图像中蕴含的多种情绪同时建模,从而可以更好地处理多情绪标签的相关性和模糊性.

近年来,国内外学者在国际顶级会议和期刊上发表了多个EDL相关的研究工作,其中在EDL模型中考虑情绪类别之间的相关性是一个重要的研究思路.如Jia Xiuyi等[8]提出了一种利用局部低秩结构捕捉标签局部相关性的EDL方法,Zhou Deyu等[9]提出了一种基于情绪之间的约束关系的EDL方法,Xiong Haitao等[10]提出了利用情感极性和情绪标签稀疏性的EDL方法.这些研究工作都表明,考虑在训练数据中的情绪相关性可明显提升EDL模型的性能.情绪间的相关性既可从训练数据中抽取,也可基于心理学先验知识获得.但是,目前较少有基于图像的EDL研究工作,特别是在预测模型中直接运用心理学先验知识考虑情绪之间的相关性.

Mikel′s情感轮(Mikel′s emotion wheel)是心理学家J.A. Mikels等[11]提出的心理学情绪模型.Mikel′s情感轮描述了人类的8种基本情绪之间的相关性,分别是愤怒(anger)、厌恶(disgust)、悲伤(sadness)、恐惧(fear)、兴奋(excitement)、惊讶(awe)、满意(contentment)、高兴(amusement).这8种情绪按一定顺序组成一个情感轮,在情感轮上的位置关系反映了情绪类别之间的相关性,处于相邻位置的2种情绪呈正相关,处于相对位置的2个情绪呈负相关.

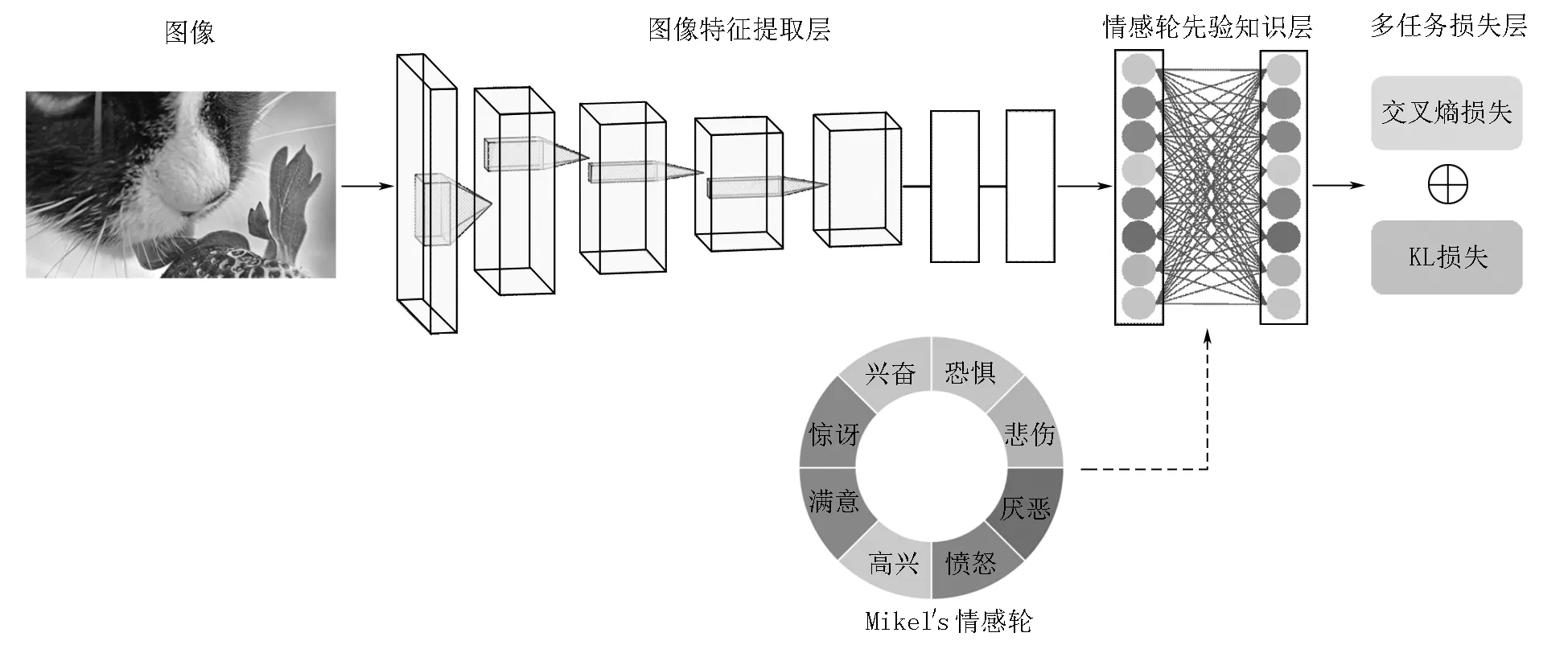

本文将Mikel′s情感轮心理学先验知识引入情感分布学习中,提出了一种基于情感轮和多任务卷积神经网络的图像情感分布学习(emotion wheel enhanced multi-task convolutional neural network for image emotion distribution learning,EW-MTCNN)模型.EW-MTCNN的深度神经网络模型包括3个模块:图像特征提取层、情感轮先验知识层和多任务损失层.图像特征提取层通过多层卷积神经网络提取图像中的特征信息;情感轮先验知识层基于Mikel′s情感轮计算成对情绪间的相关程度,将图像特征提取层的输出转换为情感分布;多任务损失层采用交叉熵损失和Kullback-Leibler(KL)损失分别度量情绪分类任务和情感分布预测任务,通过综合这2种损失训练目标,同时优化情绪分类和情感分布预测任务.EW-MTCNN模型以端到端的方式进行训练,将在输出的情感分布中表达程度最大的情绪作为情绪分类任务的预测值.在图像情感分布数据集(Emotion6)和情绪单标签数据集(Artphoto)上的对比实验结果表明:EW-MTCNN模型在情感分布预测和情绪分类任务上的性能优于对比的其他情感分布学习方法.

1 相关工作

图像情感分析的相关工作主要包括图像特征提取和情感分布学习.

1.1 图像特征提取

传统的图像特征提取方法主要基于特征工程,人工提取图像中的底层特征(如颜色[12]、纹理[13]和构图[14]等).C. Colombo等[15]将图像分割成若干个区域,将每个区域和其他区域在颜色、饱和度、色调等特征上进行比对,将图像分为4种不同情绪.J. Machajdik等[16]基于艺术原理和心理学理论定义了多种人工处理特征的组合,包括构图、颜色变化和图像语义.研究表明,这些数据大多来源于抽象绘画与艺术照片,通过人工处理的图像特征在一些特定的数据集上是有效的.因为基于特征工程的方法太过于经验化,且需要耗费大量的人力,因此不适用于大规模数据集.此外,对于来自不同领域的图像,人工提取图像中情感信息的方法往往存在一定差异.因此,传统的图像情感分析方法不具有泛化性能.

近年来,随着卷积神经网络(convolutional neural network,CNN)在许多计算机视觉任务上取得成功,CNN也被运用到图像情感分析中.基于CNN的图像特征提取方法主要通过深层卷积神经网络提取在图像中的深层特征,不再需要人工从图像中提取特征,实现了从图像中学习特征和参数,并且在各种数据集上具有良好的泛化性能.如Rao Tianrong等[17]提出了一个多层深度网络(MldrNet),它将图像的底层特征与深层特征进行统一.Yang Jufeng等[18]将人工提取的图像底层特征与深层卷积神经网络提取的深层特征进行对比实验,结果表明深层特征在情感分析模型上表现更优.

1.2 情感分布学习

传统的图像情感分析致力于图像的情感极性分类,即判别在一幅图像中的情感是正面还是负面.然而,这种情感极性识别只能适用于简单的情感分析任务(如情感二分类问题),无法实现对多个情绪类别的识别.因此,单标签学习(single label learning)将简单的正面、负面情绪细分为若干个基本情绪,通过人工标注,从细分的情绪类别中为每幅图像分配一个情绪标签.在此基础上,多标签学习(multi label learning)为每幅图像分配多个情绪标签进行区分,这种标注方法适用于细粒度的图像情感分析.

虽然基于单标签或多标签的方法可以实现在细粒度情绪上的情绪分类,但是无法对图像在每种情绪上的表达程度进行定量分析.因此,Zhou Ying等[7]提出了情感分布学习(emotion distribution learning,EDL),情感分布学习能够对多种情绪进行建模,学习图像特征与图像真实情感分布之间的相关信息,适用于处理具有情绪模糊性的任务.此外,Geng Xin[19]提出了标签分布学习(label distribution learning,LDL),其中包括3种策略,即问题转化(PT)、算法改造(AA)和专用算法(SA);基于这3种策略提出了6种LDL模型,它们分别是PT-Bayes、PT-SVM、AA-kNN、AA-BP、SA-IIS和SA-BFGA模型,本文将在后续实验中展示这6种标签分布学习模型的性能.

目前,许多学者在国内外顶级会议与期刊上发表了关于EDL的相关工作.Zhang Yuxiang等[20-21]提出了基于多任务卷积神经网络(multi-task convolutional neural network,MT-CNN)模型用于文本情感分布学习.由于未考虑情绪标签之间的相关性,MT-CNN模型的性能有限.Jia Xiuyi等[8]提出一种利用局部低秩结构捕捉标签局部相关性的情感分布学习方法并将它用于面部表情识别任务,该方法旨在从训练数据中学习情绪标签之间的相关性,在不同数据集上不具有泛化性能.He Tao等[22]通过引入外部先验知识来表示情绪之间的相关性,提出一种基于情感轮的情绪图卷积网络的方法(EmotionGCN),但由于EmotionGCN模型结构较为简单,不能有效地学习情绪之间的相关性,模型性能有限.与MT-CNN和EmotionGCN模型不同,本文提出的EW-MTCNN模型将Mikel′s情感轮心理学先验知识引入情感分布学习中,并采用多任务卷积神经网络,以端到端的方式进行训练,学习情绪之间的相关性,共同优化情感分布预测与情绪分类任务.

2 基于情感轮和多任务卷积神经网络的图像情感分布学习

2.1 Mikel′s情感轮

有心理学研究表明:人类情绪之间存在高度相关性[5],一些正相关的情绪经常同时出现,一些负相关的情绪则通常互斥出现.基于心理学理论,J.A. Mikels等[11]提出了Mikel′s情感轮(Mikel′s emotion wheel),用于描述8种基本情绪之间的相关性,它们分别是愤怒(anger)、厌恶(disgust)、悲伤(sadness)、恐惧(fear)、兴奋(excitement)、惊讶(awe)、满意(contentment)、高兴(amusement),这8种基本情绪在情感轮的相对位置如图2所示.根据Mikel′s情感轮,将2个情绪之间的距离定义为在Mikel′s情感轮上从一个情绪到另一个情绪所经过的步数.如兴奋与惊讶之间的距离为1,高兴与恐惧之间的距离为4.总体而言,距离近的2类情绪之间相关程度高,距离远的2类情绪相关程度低.

图2 Mikel′s情感轮

目前已有一些研究工作将情感轮运用于情感分布学习,如He Tao等[22]提出一种基于情感轮的图卷积网络,但由于未能很好地学习情绪标签之间的相关性信息,所以该模型性能有限.总体而言,基于情感轮的情感分布学习方法仍比较少,本文基于Mikel′s情感轮定义成对情绪之间的相关程度,并采用基于情感轮和多任务卷积神经网络的图像情感分布学习模型,同时优化情感分布预测与情绪分类任务.

2.2 基于Mikel′s情感轮和多任务卷积神经网络的图像情感分布学习

本文提出的基于情感轮和多任务卷积神经网络的图像情感分布学习(emotion wheel enhanced multi-task convolutional neural network for image emotion distribution learning,EW-MTCNN)模型主要由3个模块组成,它们分别为图像特征提取层、情感轮先验知识层和多任务损失层,具体的模型架构如图3所示.

1)图像特征提取层.鉴于VGGNet[23]在许多计算机视觉任务的特征提取上表现出优秀的性能,本文基于VGGNet构建图像特征提取层,取VGGNet倒数第2层的全连接层作为图像信息的表示,即采用了VGGNet的5组卷积层与池化层和2层全连接层用于提取图像中隐含的深层图像特征.对于给定彩色图像xi∈Rw×Rh×R3,在VGGNet之后增加一个全连接层,用于对应各个目标情绪.最后,图像特征提取层提取出图像信息表征向量v=(v1,v2,…,vC),C为目标情绪的数量.

(1)

(2)

其中σ为先验情感分布标准差,用于描述先验情感分布fμ的离散程度,|j-μ|为情绪j与情绪μ在Mikel′s情感轮上的距离.

采用基于Mikel′s情感轮的转换矩阵W,对图像特征提取层的输出v=(v1,v2,…,vC)进行加权计算,将其转换为包含心理学先验知识的情感分布,其计算公式为

p=v1f1+v2f2+…,vCfC.

3)多任务损失层.采用情绪分类和情感分布预测2个任务,同时对神经网络进行训练,用基于情感轮先验知识层预测情感分布.多任务损失层采用交叉熵损失和Kullback-Leibler(KL)损失分别度量情绪分类任务和情感分布预测任务,通过加权的方式,将这2种损失函数综合起来,同时优化情绪分类和情感分布预测任务,具体的损失函数为

L=(1-λ)Lcls(x,y)+λLsdl(x,d),

(3)

其中Lcls和Lsdl分别表示情绪分类损失和情感分布预测损失,参数λ用于控制在训练过程中这2种损失的相对权重.

在训练过程中,由于交叉熵损失用于最大化正确类别的概率,因此采用交叉熵损失用于情绪分类任务.交叉熵损失为

图3 基于情感轮和多任务卷积神经网络的图像情感分布学习模型总体框架

KL损失是度量预测情感分布与先验情感分布或真实情感分布之间的相似性的指标之一,因此,将KL损失用于情感分布预测任务,KL损失为

对于式(3),采用随机梯度下降(SGD)来最小化损失函数.根据链式法则,梯度的计算公式为

(4)

多任务损失层根据式(4)进行梯度的反向传播.

3 实验结果与分析

为了评估EW-MTCNN模型的性能,本文在2个图像情感数据集上设置了3组实验:对比EW-MTCNN模型与多种情感分布学习模型在情感分布预测与情绪分类任务上的性能、分析先验情感分布参数σ对EW-MTCNN模型性能的影响以及对比EW-MTCNN模型与基于深度网络的情绪分析模型在传统情绪分类任务上的性能.

3.1 数据集

本文采用图像情感分布数据集(Emotion6)和情绪单标签数据集(Artphoto)进行EDL模型的对比实验.Emotion6数据集是从Flickr中集成而来,常用于情感预测基准数据集,其中标注了7个情绪类别:愤怒、厌恶、高兴、恐惧、悲伤、惊讶、中性,总共包含1 980幅图像.在Emotion6数据集中每幅图像都对应一个真实情感分布,即图像在每个情绪上的表达程度.Artphoto数据集来源于一个艺术图像分享网站,每幅图像都分配至8个情绪标签中的一个,8个情绪分别是愤怒、厌恶、悲伤、恐惧、兴奋、惊讶、满意和高兴,该数据集总共包含806幅艺术图像.Emotion6数据集和Artphoto数据集各个情绪的图像数量如表1所示.

3.2 实验设置

本文实验设置采用分层十折交叉验证.具体实验步骤如下:在保持各种情绪的图像数量比例的前提下,将数据集平均分成10份,每份数据作为测试集使用1次,剩余9份数据作为训练集,如此重复10次,取各评价指标在10次实验中的平均值作为模型的最终性能.为了合理对比EW-MTCNN模型与其他图像情感分布学习模型,参与对比的模型均采用相同的数据划分.

表1 实验数据集的各个情绪的图片数量

将EW-MTCNN模型的图像特征提取层的权重初始化为VGGNet[23]在ImageNet数据集上预训练的权重,并在Emotion6或Artphoto数据集上进行了微调.这种训练方法能够有效提高模型的收敛速率,适用于大规模数据集上的训练.

参照Yang Jingyuan等[28]的方法,将多任务损失函数权重系数λ设为0.7.此外,EW-MTCNN模型的其余参数设置如下:图像特征提取层和多任务损失层的学习率分别设为0.001和0.010;为防止过拟合,在全连接层采用Dropout比率为0.5,设置Batch Size为32,并采用随机梯度下降(SGD)对整个网络的所有层的权重进行微调,具体的模型参数设置如表2所示.

表2 EW-MTCNN模型参数设置

对于情感分布预测任务,采用6种常用于评价真实情感分布和情感分布预测之间距离或相似度的指标,它们分别是Chebyshev distance、Clark distance、Canberra metric、KL divergence、Cosine和Intersection.其中,前4个指标为距离指标,值越小表明模型性能越优;后2个指标为相似度指标,值越大表明模型越优.由于当分母为0时,KL divergence无定义,因此设ε=1×10-10(近似0值).对于情绪分类任务,采用准确率评估模型的性能,将在情感分布预测中表达程度最大的情绪作为图像的情绪标签用于情绪分类.

本文实验的硬件配置为Intel酷睿i9-10900X 3.70 GHz 10核CPU,128 G内存,NVIDIA GeForce RTX 3060显卡.操作系统为Ubuntu 18.04,深度学习框架采用Tensorflow2.4和Keras2.4.3.

3.3 多种图像情感分析模型的情感分布预测和情绪分类性能对比

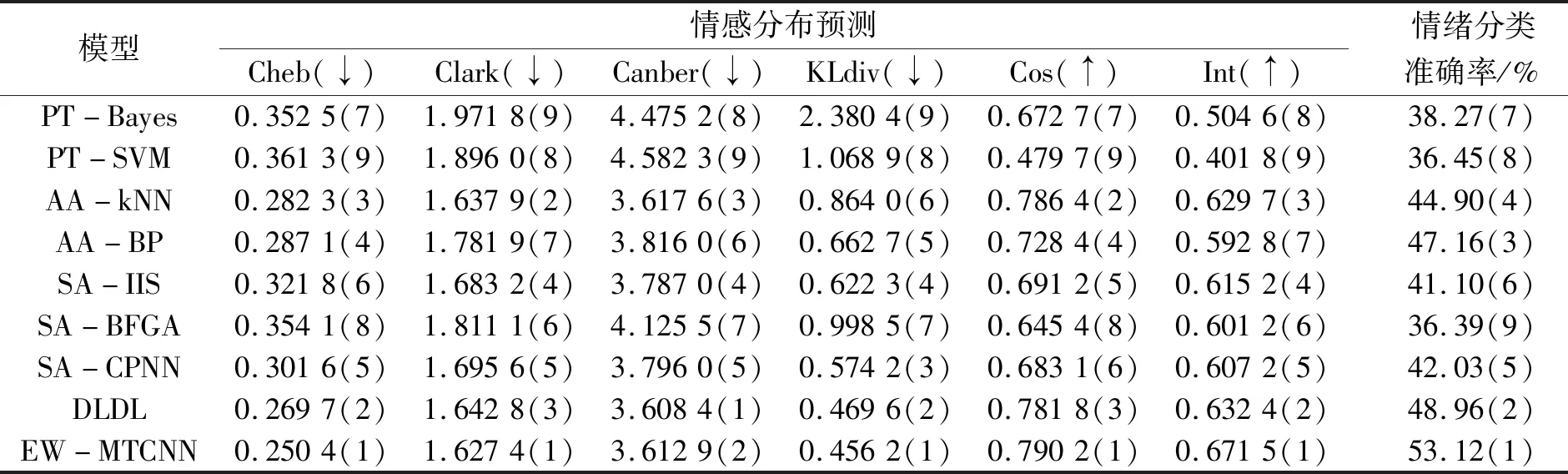

为了评估EW-MTCNN模型在图像情感分布数据集上的情感分布预测和情绪分类性能,将EW-MTCNN模型与7种LDL模型(分别是PT-Bayes、PT-SVM、AA-kNN、AA-BP、SA-IIS、SA-BFGA和SA-CPNN[24]模型)进行对比.参照Yang Jufeng等[29]的方法,将VGGNet中倒数第2层全连接层的输出作为图像信息表征,并采用主成分分析(PCA)将图像信息表征的维度降至280维,将降维后的图像信息表征作为输入,采用上述LDL模型作为分类器进行训练,输出情感分布预测.此外,将EW-MTCNN模型与图像情感分布学习模型DLDL模型[30]进行对比,DLDL模型通过多层卷积神经网络提取图像中的深层特征,并采用KL损失函数进行训练,在情感分布预测上具有良好性能,对比实验的具体结果如表3所示.

表3 在Emotion6数据集上9种情感分布学习模型的性能对比结果

表3展示了EW-MTCNN模型与8种情感分布学习模型在Emotion6数据集上的情感分布预测和情绪分类性能,括号中展示了在单项指标上各模型性能的排序结果.实验结果表明:在情感分布预测和情绪分类任务的7个指标上,EW-MTCNN模型均优于PT-Bayes、PT-SVM、AA-kNN、AA-BP、SA-IIS、SA-BFGA和SA-CPNN模型.在情感分布预测任务上,EW-MTCNN模型除了在Canberra指标上略低于DLDL模型外,在其余5项情感分布预测指标上均优于对比的情感分布学习模型.在情绪分类任务上,EW-MTCNN模型在准确率上表现出优秀的性能,比次优的DLDL模型高4.16%.由此可见,EW-MTCNN模型比其他情感分布学习模型在情感分布预测和情绪分类任务上均取得了优越的性能.实验结果表明:EW-MTCNN模型能够有效利用情绪之间的相关性信息,综合度量情感分布预测损失与情绪分类损失,同时优化情感分布预测和情绪分类任务.

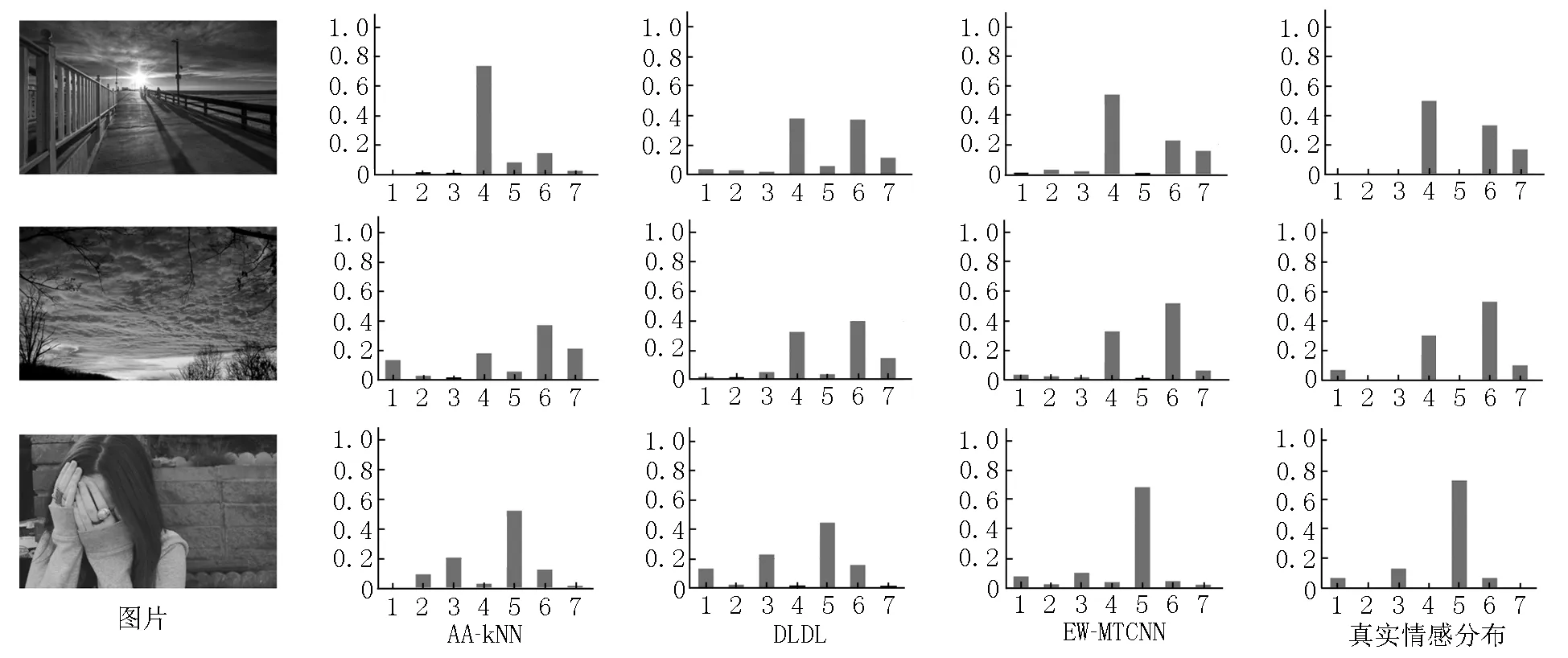

图4展示了在Emotion6数据集上AA-kNN、DLDL和EW-MTCNN模型的情感分布预测结果.由图4可见:EW-MTCNN模型在情绪极性、情绪类型和情感分布上都与真实情感分布相似度最高.此外,与DLDL模型仅采用KL损失函数相比,EW-MTCNN模型结合交叉熵损失与KL损失,在情感分布预测上具有优越的性能.

情绪标签1:愤怒、2:厌恶、3:恐惧、4:高兴、5:悲伤、6:惊讶、7:中立;横轴是情绪,纵轴是表达程度.

3.4 先验情感分布参数σ对模型性能的影响

先验情感分布参数σ是先验情感分布的标准差,用于描述由情绪标签生成先验情感分布的离散程度,是影响EW-MTCNN模型的重要参数.σ越小,生成的先验情感分布越集中,曲线越瘦高.σ越大,生成的先验情感分布越分散,曲线越扁平.为了分析先验情感分布参数σ对EW-MTCNN模型性能的影响,在Artphoto数据集上进行实验.首先根据图像情绪标签,由式(1)~(2)为每幅图像生成对应先验情感分布,其次将参数σ从0~1取值,每隔0.1取值1次,采用情感分布预测指标KL divergence和情绪分类指标的准确率来评估先验情感分布参数σ对EW-MTCNN模型性能的影响.由式(1)可知,当σ=0时无定义,因此采用ε=1×10-10近似0值.先验情感分布参数σ对EW-MTCNN模型性能的影响如图5所示.

图5 在Artphoto数据集上参数σ对模型性能的影响

由图5可见:随着σ的增加,EW-MTCNN模型在情绪分类指标的准确率上的性能逐步上升,并在σ=0.6时达到最高(42.19%),随后逐步下降,在情感分布预测指标KL divergence上的性能逐步下降,在σ=0.6时达到最低(0.608 2),随后逐步上升.实验结果表明:相比于传统的基于单标签的情绪分类模型(σ=0),将情绪标签扩展为情感分布能有效提高模型在情感分布预测和情绪分类任务上的性能,并且适当增加先验情感分布的离散程度能有效促进EW-MTCNN模型的性能.当σ=0.6时,先验情感分布的离散程度最佳.以恐惧情绪为例,当σ=0.6时先验情感分布为[1.48×10-10,2.47×10-6,2.57×10-3,1.66×10-1,6.64×10-1,1.66×10-1,2.57×10-3,2.47×10-6].当σ取值为0.6~1.0时,EW-MTCNN模型在准确率指标上的性能逐步下降,这说明先验情感分布离散程度过大会混淆主导情绪标签,影响EW-MTCNN模型情绪分类性能.由于EW-MTCNN模型在σ=0.6时性能最优,因此,在实验中设σ=0.6.

3.5 基于深度网络的情绪识别模型的情绪分类性能对比

为了评估EW-MTCNN模型在传统情绪分类任务上的性能,本文在Emotion6和Artphoto数据集上进行对比实验.对于Emotion6数据集,采用在真实情感分布中表达程度最高的情绪作为图像的情绪标签.鉴于AlexNet[31]、VGGNet[23]和ResNet[32]3种深度网络模型在图像特征提取上已经表现出优越的性能,本文展示了这3种模型在传统情绪分类任务上的性能,以及在对应数据集上对这3种模型进行微调后的模型性能,具体的9种基于深度网络的情绪识别模型在情绪分类任务上的性能对比结果如表4所示,9种对比模型简要介绍如下:

1)AlexNet、VGGNet和ResNet.模型权重初始化为3种模型在ImageNet数据集上预训练的权重,将最后一层用于分类的全连接层神经元数量修改为数据集的情绪类别数量,采用交叉熵损失,将其余层权重冻住,只对最后一层全连接层权重进行更新.

2)Fine-tuned AlexNet、Fine-tuned VGGNet和Fine-tuned ResNet.基于AlexNet、VGGNet和ResNe模型,在目标数据集上对3个模型的权重进行微调.

3)EW-MTCNN(AlexNet)、EW-MTCNN(VGGNet)和EW-MTCNN(ResNet).为了分析不同图像特征提取层对EW-MTCNN模型的性能的影响,基于3种深度网络模型构建图像特征提取层,得到对应的模型.

表4 9种基于深度网络的情绪识别模型在Emotion6数据集和Artphoto数据集上的情绪分类性能对比

表4的实验结果表明:相比于基于AlexNet的情绪识别模型,基于ResNet或VGGNet模型的表现更优.具体而言,在Emotion6数据集上,EW-MTCNN(ResNet)模型性能最优(53.60%),在Artphoto数据集上,EW-MTCNN(VGGNet)模型性能最优(42.19%).同时,在Emotion6和Artphoto数据集上,基于ResNet或VGGNet的模型之间的性能差异都比较小.即ResNet和VGGNet均可以较好地提取图像中的图像特征信息.

从预训练模型是否进行微调的角度观察,在Emotion6和Artphoto数据集上进行了微调的情绪识别模型的情绪分类性能均优于只在ImageNet数据集上预训练的模型的情绪分类性能.这说明对预训练模型进行微调可以提高情绪识别模型的性能.

另外,EW-MTCNN模型总体上表现出最优的性能,其准确率比次优的模型在Emotion6数据集上高出5.68%,在Artphoto数据集上高出5.34%.实验结果表明:相比于只使用交叉熵损失进行训练的情绪分类模型,多任务同时进行训练,可以提高情绪识别模型在情绪分类任务上的性能.

4 总结与展望

针对多情绪分析任务,本文提出了一种基于情感轮和多任务卷积神经网络的图像情感分布学习模型.EW-MTCNN模型将Mikel′s情感轮心理学先验知识引入情感分布学习中,基于Mikel′s情感轮计算成对情绪之间的相关程度,采用多任务卷积神经网络以端到端的方式进行训练,有效利用情绪之间的相关性,共同优化情感分布预测与情绪分类任务.在图像情感分布数据集和情绪单标签数据集上的对比实验表明:EW-MTCNN模型在情感分布预测与情绪分类任务上比现有的EDL模型具有更优越的性能.

在下一步的工作中,将对提高图像特征提取层与多任务学习的性能上加以研究,尝试将EW-MTCNN的图像特征提取层更换为更加有效的预训练图像特征提取模型,并提出能够更有效的学习情绪间相关性的多任务损失函数,进一步提高图像情感分布学习模型的性能.