基于改进DeepSORT和FastReID的室内多目标人员跨镜识别与跟踪

赵安新 杨金桥 杨浩波 史新国 付文旭 刘帅 王伟峰

摘 要:為解决利用视频分析实现目标检测、目标跟踪和行人重识别存在的诸如目标框重框、遮挡等问题,提出了一种基于改进DeepSORT和FastReID的室内多目标人员跨镜追踪的方法。该方法使用YOLOv5s进行人员检测、DeepSORT进行人员跟踪、FastReID进行人员重识别。采用EIOU-NMS算法解决了YOLOv5s人员检测过程中出现的重框问题;在FastReID的特征提取网络中引入了NEUFA注意力机制,并使用优化后的FastReID的特征提取网络替换了DeepSORT原有特征提取网络,降低了DeepSORT跟踪过程中由于遮挡导致的ID跳变的次数;结合注意力机制、人员动态图像库与运动估计的方法减少了人员识别过程中因遮挡导致的人员无法识别和错误识别的次数。结果表明:EIOU-NMS算法将人员检测准确率提升了0.8%,召回率提升了0.4%;替换了特征网络后的DeepSORT将人员跟踪中的ID跳变次数降低了38.46%;结合注意力机制、人员动态图像库和运动估计方法之后,None的次数减少了79.8%,误识别次数减少了91.2%。研究结果能够提升人员识别与跟踪的准确性,降低遮挡对人员跟踪和识别带来的影响。

关键词:多目标跟踪;局部遮挡;目标检测;行人重识别;人员图像库;运动估计

中图分类号:TN 911.73文献标志码:A

文章编号:1672-9315(2023)03-0622-09

DOI:10.13800/j.cnki.xakjdxxb.2023.0320开放科学(资源服务)标识码(OSID):

Indoor multi-object personnel recognition and tracking across camera based on optimized DeepSORT and FastReID

ZHAO Anxin1,YANG Jinqiao1,YANG Haobo2,SHI Xinguo3,FU Wenxu1,LIU Shuai1,WANG Weifeng4

(1.College of Communication and Information Engineering,Xian University of Science and Technology,Xian 710054,China;2.Shaanxi Zhengtong Coal Industry Co.,Changwu 713600,China;3.Shandong Boxuan Mineral Resources Technology Development Co.,Jining 272073,China;4.College of Safety Science and Engineering,Xian University of Science and Technology,Xian 710054,China)

Abstract:To solve the problems such as target frame re-framing and occlusion that exist in target detection,target tracking,and person re-identification using video analytics,a method based on optimized DeepSORT and FastReID for indoor multi-target person cross-camera tracking is proposed.YOLOv5s is adopted for person detection,DeepSORT for person tracking,and FastReID for person re-identification.The EIOU-NMS algorithm is used to solve the re-framing problem that occurs during YOLOv5s person detection; the NEUFA attention mechanism is introduced in the feature extraction network of FastReID,and the optimized feature extraction network of FastReID is chosen to replace the original feature extraction network of DeepSORT,which reduces the number of ID jumps due to occlusion in the DeepSORT tracking process.The combination of attention mechanism,dynamic image gallery,and motion estimation reduces the number of unidentified and incorrectly identified persons due to occlusion during DeepSORT tracking.The results show that the EIOU-NMS algorithm improves the person detection accuracy by 0.8% and the recall rate by 0.4%; the replacement of the feature networks in the DeepSORT reduces the number of ID jumps in person tracking by 38.46%; combining the attention mechanism,person dynamic image library and motion estimation methods reduces the number of None by 79.8% and the number of false identifications by 91.2%.The research results can improve the accuracy of person identification and tracking,thus reducing the impact of occlusion on person tracking and identification.

Key words:multiple object tracking;local occlusion;object detection;person re-identification;image bank of people;movement estimation

0 引 言

随着大数据技术的不断提升,人工智能技术也在不断地发展成熟,基于深度学习算法与深度神经网络的视觉识别技术已经应用于工业的各个领域[1]。除了如洗煤厂、炼钢厂、汽车制造厂等工厂的车间内为了保证工人安全需要使用智能监控设备,当企业出现如流水线人手不足或者火灾等应急情况下需要进行人员调度或者疏散人员时,需要清楚的了解人員的分布境况,以便指定合理的方案[2]。将目标检测、目标跟踪与行人重识别算法应用到办公楼的监控设备中,既能够帮助企业对人员进行合理管控,又避免了人眼查看监控因疲劳而忽视关键信息的问题,省时省力。同时,3种算法的结合使用能够有效的增加识别与跟踪的准确性[3]。

在实际应用中,多目标的智能识别与跟踪往往面临着检测框重框和人员遮挡的问题。针对重框问题,谭芳喜等使用DIOU-NMS(基于Distance-IOU的非极大值抑制)去除冗余框,提升检测精度[4]。张长伦等在NMS中融入了注意力机制,结合了位置信息和框的得分信息得到框的最终得分[5]。侯志强等提出一种双阈值非极大值抑制算法,将传统的(Intersection Over Union,IOU)指标替换为全局交并比指标(Generalized Intersection Over Union,GIOU),抑制多余的检测框[6]。从以上研究可以看出,目前重框问题主要通过非极大值抑制(Non Maximum Suppression,NMS)算法来解决,以上算法虽然解决了重框问题,但并未考虑预测框和真实框的横纵比和难易样本之间的平衡问题。为了降低遮挡对人员追踪的影响,学者们通过在网络模型中添加注意力机制引导网络学习图片中需要关注的区域,薛丽霞等结合空间和通道双重注意力机制提出一种网络模型,提取到了更有针对性的特征[7]。CHEN等为解决注意力机制提取局部特征容易忽略地相关性特征的问题提出了一种多样专注网络(Attentive But Diverse Network,ABD-NET)[8]。ZHANG等设计一种(Relation-aware Global Attention,RGA)模型,对于提高特征的表示能力效果显著[9]。虽然注意力机制能够有效的降低遮挡带来影响,但现有的注意力机制还无法彻底解决遮挡问题。文献[10]指出ReID模型能够有效增加轨迹关联的准确性,缓解目标被遮挡的问题,而目前人员跟踪中使用的ReID模型相对简单,难以提取到更好的外观信息。为此,文中提出一种基于优化DeepSORT和FastReID的多目标人员识别与跟踪的方法,使用(Efiicient Generalized Intersection Over Union,EIOU)-NMS算法代替YOLOv5s原有的NMS算法,EIOU-NMS算法计算了预测框和真实框的宽高之间的差异值,既解决重框问题,又降低了难易样本不平衡的带来的影响。在FastReID的特征提取网络中引入NEUFA注意力机制,并使用优化后的FastReID网络替换DeepSORT原有ReID网络,缓解了跟踪过程中的遮挡问题。此外,为了保证人员在被遮挡时能够准确识别,建立了动态人员图像库并根据人员的像素坐标校正FastReID的识别结果。

1 人员目标检测算法

目标检测的目的在于找到图像中感兴趣的部分并进行分类与定位,被广泛应用在视频分析中[11-13]。现阶段目标检测方法主要分为单阶段法和两阶段法,两阶段法先通过如边界箱和选择性搜索等区域选择法进行候选区域的生成,再使用卷积神经网络对样本进行分类,典型的两阶段目标检测算法有快速区域卷积神经网络(Faster R-CNN)[14]和掩模卷积神经网络(Mask R-CNN)[15]等。两阶段法虽然准确度高但相比单阶段法速度相对较慢,单阶段法直接通过卷积网络提取样本特征预测不同目标物的类别信息与位置信息。单阶段法提升了算法的运行速度,能够满足实时检测的要求,典型的单阶段目标检测算法包括YOLO(You Only Look Once)[16]系列和SSD(Single Shot Multibox Detector)[17]系列。

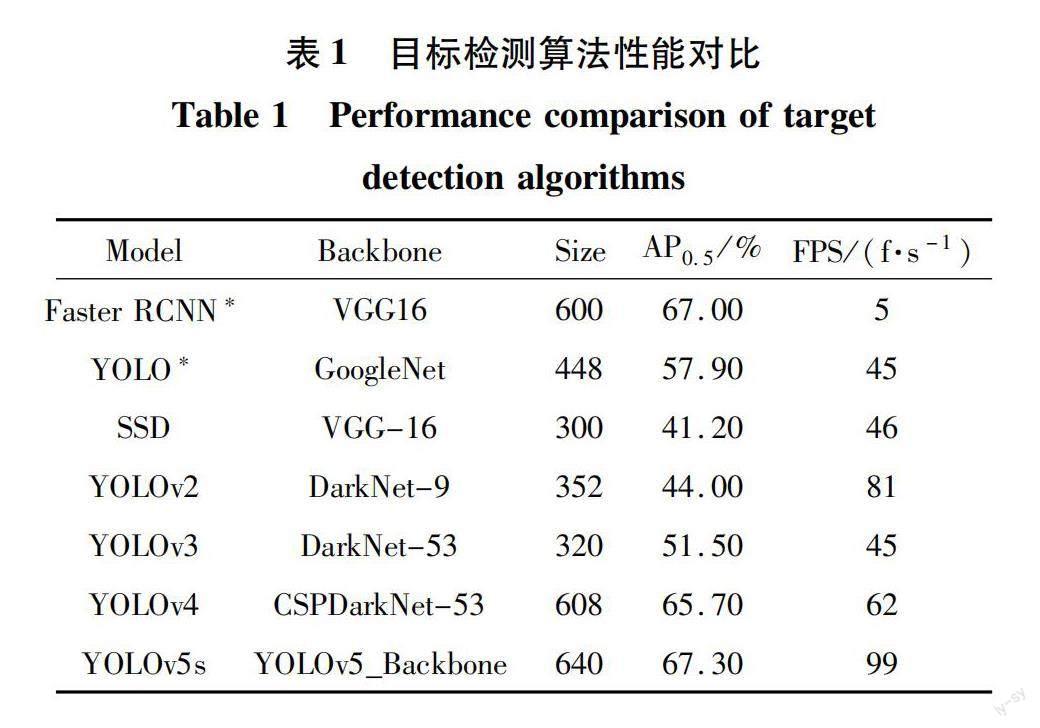

表1对比近年来经典的目标检测算法,可以看出,YOLOv5s的平均精度(Average Precision,AP)和每秒传输帧数(Frames Per Second,FPS)均高于其他算法,故本研究采用YOLOv5s进行人员检测。

非极大值抑制(Non Maximum Suppression,NMS)算法通过调整目标检测框与最高得分的预测框之间的交并比IOU来抑制多余的目标框,IOU是预测框与真实框之间的交并比,IOU损失是指1减去IOU的值,IOU和IOU损失函数见下式。

式中 B为预测框面积;Bi为真实框面积。IOU损失虽然可以表达出预测框和真实框的检测效果,但当预测框和真实框不相交时,IOU损失就恒等于1,无法继续进行学习。此外,IOU损失函数还无法判断预测框与真实框之间的位置关系。而EIOU损失函数[18]计算了预测框和真实框中心点的标准化距离和2个框宽与高之间的差异,使得预测框与真实框不相交时,EIOU损失函数依旧可以寻找下降梯度。EIOU损失函数计算见下式。

式中 b和bgt分别为预测框与真实框的中心点;ρ为b和bgt之间的欧式距离;d为预测框和真实框的最小外接矩形的对角线距离;ω,ωgt,h,hgt分别为预测框和真实框的宽和长;Cw,Ch为覆盖预测框和真实框的最小外接矩形的宽度和长度。

因此采用EIOU-NMS算法替换了YOLOv5s中原有的NMS算法。EIOU-NMS算法将人员检测准确率由90.4%提升到91.2%,提升了0.8%,召回率由94.8%提升到95.2%,提升了0.4%。

图1对比NMS优化前后的检测结果,图1(a)是优化前的检测結果,图1(b)是优化后的检测结果,可以看出优化后的NMS成功去掉人员检测中多余的预测框。

2 DeepSORT多目标跟踪

目标跟踪通过找到图像中感兴趣的区域,在后续视频帧中对其进行跟踪,在监控安防与无人驾驶等领域都起着关键作用[19-21]。基于跟踪的目标数目,可以分为单目标和多目标跟踪,现阶段研究主要通过获取目标外观特征和视频每一帧中的目标信息来进行跟踪。

DeepSORT作为一种端到端的跟踪算法,能够同时提取了人员的外观信息和运动信息,因此研究使用DeepSORT算法进行多目标跟踪。但由于DeepSORT中的使用的ReID特征提取网络结构简单,为了获得更具针对性的行人特征,需要使用其他ReID模型替换DeepSORT中原有的ReID模型。表2将FastReID[22]与其他典型的行人重识别算法做了对比,可以看出在大型公开数据集Market 1501,DukeMTMC中的Rank 1和mAP值均高于其他算法,所以在DeepSORT中使用FastReID特征提取网络。

为了降低遮挡带来的影响,在替换DeepSORT的特征提取网络之前在FastReID的Bottleneck中添加了注意力机制,如图2所示,在FastReID的Bottleneck中添加了NEUFA[23]注意力机制。表3记录FastReID添加不同注意力机制之后在Market1501数据集上的表现,其中FastReID+NEUFA的mAP值和Rank值均是最高的。

改进后的DeepSORT模型在跟踪时ID跳变次数由13次减少为8次,在原有的基础上减少38.46%。

3 基于动态图像库和像素坐标的人员重识别

人员重识别(Person Re-identification)利用计算机视觉,将多个摄像机拍摄的同一人员的图像关联起来,人员第1次被摄像机拍摄到的图像会被保存到一个图像库,当人员被另一个摄像机拍摄到时,当前图像会在图像库中进行匹配识别,识别出准确的身份信息。文中使用FastReID进行人员的重识别,针对由于遮挡导致的人员身份错误识别或者识别不到的问题,在FastReID的Bottleneck中添加了NEUFA注意力机制。表4记录了FastReID添加不同注意力机制在测试视频中的表现,FastReID添加NEUFA之后的误识别次数和None的数量均低于其他注意力机制。其中None的数量为未识别到的人员数量,误识别次数指的是错误识别到的人员次数,比如将人员A错误识别为人员B。

3.1 动态人员图像库

由于在公司办公楼内的人员基本是固定的,所以提前建立好人员图像库用来进行人员的身份匹配。张海燕等将Market1501数据集上捕捉到的人员姿态划分为8个标准姿态骨架,如图3所示,基于此在人员图像库内提前放置每个人员在8个不同方向的行走图像[24]。为了能够在人员遮挡时准确识别到人员的身份信息,图库内还需保存人员身体被部分遮挡的图像。

摄像机镜头可划分为远景镜头、中景镜头、近景镜头和特写镜头[25]。其中远景镜头拍摄到人员的全身像,中景镜头拍摄人物膝部以上的活动情形,表现人物手臂活动范围,近景镜头拍摄人员胸部以上图像,特写镜头则拍摄人员肩部以上的头像。其中中景镜头、近景镜头和特写镜头可以看成人员被遮挡的情况。以上遮挡可以看成横向遮挡,而遮挡除了横向遮挡之外还有纵向遮挡,因此对于每个人员需要存储他的全身图像、头部图像、胸部以上的图像、膝部以上的图像和半身像。

考虑到以上因素,需要在人员图像库内提前放置每个人员在8个不同方向的行走图像,每个方位的图像包括人员全身图像、头部图像、胸部以上的图像、膝部以上的图像和半身像,共计40张图像。除了预设的图像,图像库还会根据人员的识别信息存储与图像库内已有的图像特征差异较大的人员图像。

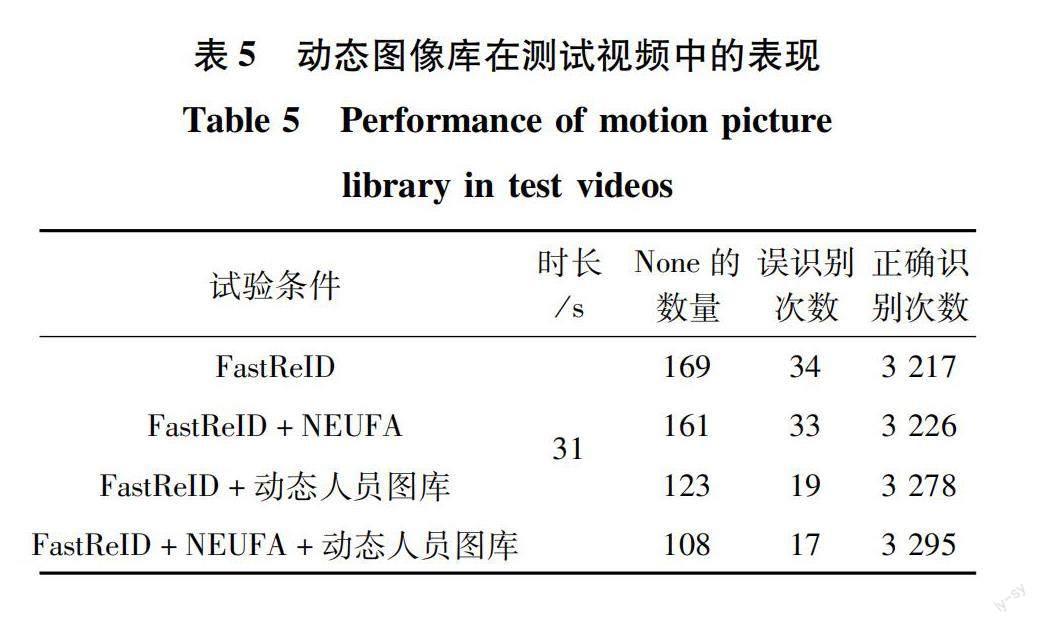

图像的存储通过计算人员之间的余弦相似度,余弦相似度得分阈值设定为0.6,当得分大于等于0.6时确定为目标人员,当有多人得分均大于0.6时,取最高值,得分越高说明与图像库内的某一张图像越相似。为了存储到与初始图像特征差异较大的图像,需要在能够确定人员身份的情况下保存该人员得分分值较低的图像,该分值越接近0.6越好,这样存储到的图像才能够与初始图像有较大的区分度。动态图像库在测试视频中的表现见表5。添加了动态人员图库的FastReID算法将None的数量由169次减少到123次,误识别的次数由34次减少到19次,添加了注意力机制与动态人员图库后,None的数量由169次减少到108次,误识别的次数由34次减少到17次,相较单一添加注意力机制,同时添加注意力机制与动态人员图库2种方法对于减少遮挡引起的人员错误识别与无法识别的问题收益更大。

3.2 根据像素坐标校正人员身份信息

在人员识别的过程中,添加注意力机制和建立动态人员图库能够有效减少由于人员部分遮挡导致的人员无法识别和错误识别的次数,而当人员被严重遮挡时,以上2种方法仍然无法准确识别到人员的身份信息。因此,提出一种根据像素坐标校正人员身份信息的方法,如果该人员在遮挡的上一帧程序正确识别到了该人员的身份信息,就可以根据上一帧的人员信息校正当前帧的人员信息,该方法的步骤如下。

步骤1:保存正确识别到的每个人员的像素坐标和身份信息,用来和下一帧校正。

步骤2:判断当前帧是否存在None或者误识别现象,如果没有,保存当前帧的人员信息,作为下一帧的校正依据。如果有,则计算每个人员之间的像素距离,判断该人员在前一帧和当前帧之间的距离是否小于阈值。

步骤3:如果距离小于阈值,查看该人员身份是否发生改变,如果发生改变,则使用前一帧保存的正确信息进行校正。如果距离大于阈值,则判定前一帧与当前帧不是同一个人,该人员直接使用当前帧的身份信息。

步骤4:校正完成后保存当前帧人员信息,作为下一帧校正依据。

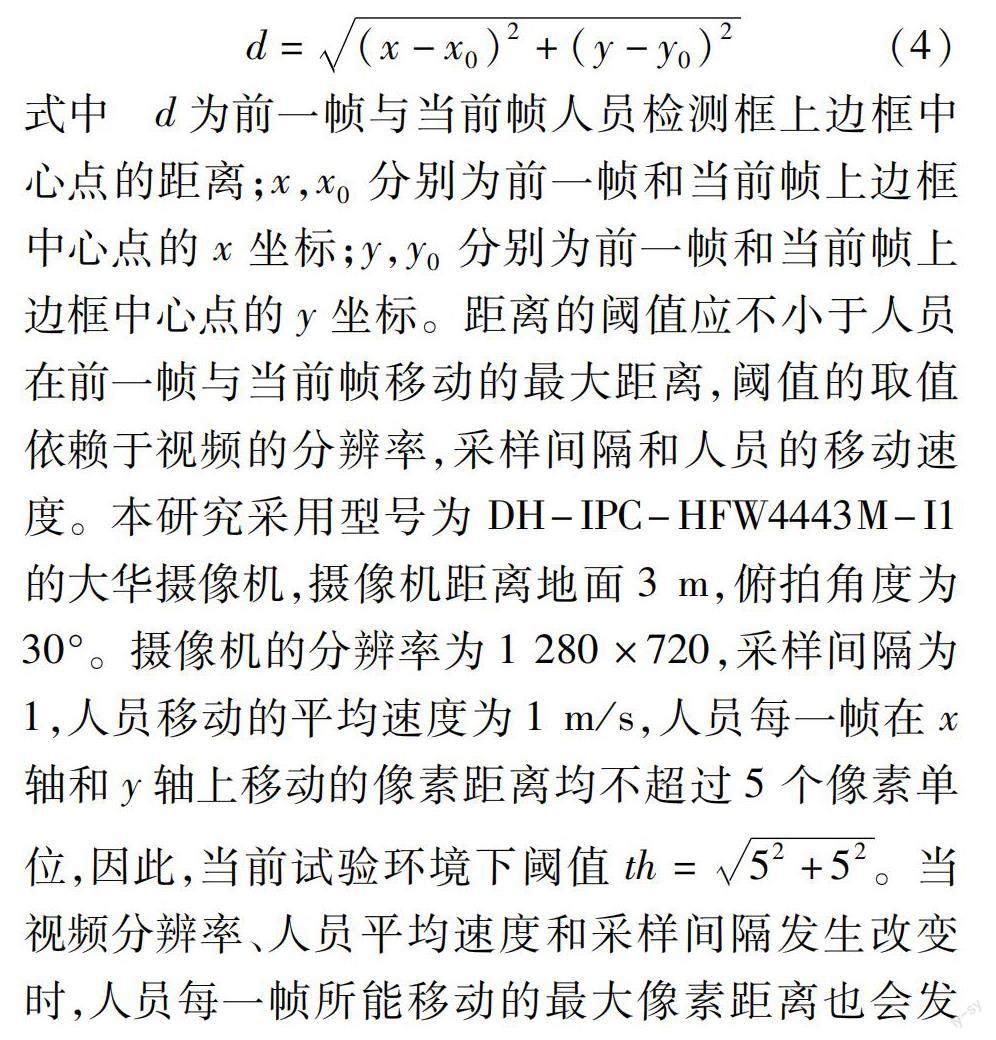

上述步骤中,人员在前一帧与当前帧的距离指的是人员前一帧与当前帧的检测框上边框中心点的距离,通过两点之间的距离公式计算,两点间的距离见式(4)。

式中 d为前一帧与当前帧人员检测框上边框中心点的距离;x,x0分别为前一帧和当前帧上边框中心点的x坐标;y,y0分别为前一帧和当前帧上边框中心点的y坐标。距离的阈值应不小于人员在前一帧与当前帧移动的最大距离,阈值的取值依赖于视频的分辨率,采样间隔和人员的移动速度。本研究采用型号为DH-IPC-HFW4443M-I1的大华摄像机,摄像机距离地面3 m,俯拍角度为30°。摄像机的分辨率为1 280×720,采样间隔为1,人员移动的平均速度为1 m/s,人员每一帧在x轴和y轴上移动的像素距离均不超过5个像素单位,因此,当前试验环境下阈值th=52+52。当视频分辨率、人员平均速度和采样间隔发生改变时,人员每一帧所能移动的最大像素距离也会发生改变。当分辨率发生变化时,视频帧内所包含的像素点的个数也会变化,但人员在前一帧和当前帧在x轴和y轴上所能移动的最大像素距离与视频帧中x轴和y轴总长度的比值不发生改变,因此当视频分辨率发生变化时,基于该比值可以求出其他分辨率下人员所能移动的最大像素距离。以1 m/s的速度为基准,当人员移动速度变为原来的x倍时,每一帧内人员的移动的最大像素距离也会变为原来的x倍。同样的,当采样间隔变为原来的x倍时,人员在前一帧和当前帧能移动的最大像素距离也会变为原来的x倍,例如当采样间隔由1变成4时,人员在相邻2次采样之间所能移动的最大像素单位会变为原来的4倍。考虑以上因素,确定阈值的表达式为

式中 th为閾值;l1,l2分别为在当前分辨率下,人员在一帧内沿x轴所能移动的最大像素单位与x轴总长的比值和沿y轴所能移动的最大像素单位与y轴总长的比值;px,py分别为目标分辨率的宽度与高度;f为FastReID进行人员识别时的采样间隔;v为人员的运动速度。该运动估计方法的流程如图4所示。

表6对比注意力机制、行人动态图库和根据像素坐标校正人员身份信息(简称运动估计)3种不同方法在测试视频中的表现,数据显示,在FastReID中分别加入3种方法都能够减少None的数量和误识别的次数,将注意力机制、人员动态图像库和运动估计的方法结合之后,None的数量减少为34次,减少了79.8%,误识别次数减少为3次,减少了91.2%,相较于只使用一种或者2种方法,能够更准确的识别到人员身份,充分证明了上述方法对于正确识别人员身份信息的有效性。

使用人员像素坐标校正人员身份信息的效果展示如图5所示:在第654帧中,白衣男子的身份信息,本应未fu,但是由于身体部分被遮挡,被FastReID错误识别为了yao。在第838帧中,带眼镜的黑衣男子的身份信息,本应为shen,但是由于身体部分被遮挡,FastReID未识别到该人员。通过该方法成功的校正了白衣男子和戴眼镜黑衣男子的身份信息。

4 跨摄像机的人员识别与跟踪

为了提升人员识别与跟踪的效果,将目标检测、行人重识别与行人跟踪技术结合起来,构建的框架如图6所示,对于输入的视频流,首先使用YOLOv5s进行人员检测,将人员检测框传入到DeepSORT中,DeepSORT将人员特征信息输入到FastReID中,FastReID通过将视频中提取到的人员特征与人员查询图库内的图片进行匹配,从而识别出人员身份信息。

采用深度学习框架Pytorch 1.9.0,NVIDIA GeForce GTX 1650显卡,在Windows 64位系统下进行试验研究。选用2台大华DH-IPC-HFW4443M-I1型号的摄像机,摄像机1拍摄办公室内的场景,摄像机2拍摄办公室外走廊的场景,摄像机距离地面2.5 m,俯拍角度30°。试验场景如图7所示。

试验结果如图8所示,为了保护人员隐私,在比较清晰的人员面部打了马赛克,后续试验结果做了同样处理。人员沿走廊走向办公室,在办公室行走一圈后停止前行。图8(a)是摄像机2拍摄到的走廊的视频截图,图8(b)是摄像机1拍摄到的办公室内的视频截图,图8(a)和图8(b)均存在人员相互遮挡的现象。图中蓝色的线条是人员的跟踪轨迹,右上角的英文字母是FastReID赋予的人员身份信息,可以看出在测试视频中,无论处于哪个场景,行人的身份信息都没有发生改变。可见文中提出的框架在人员部分身体被遮挡的情况下能够准确的识别和跟踪到目标人员。

5 结 论

1)结合改进后的YOLOv5s人员检测算法、DeepSORT人员跟踪算法与FastReID行人重识别算法实现了室内人员的跨镜识别与跟踪。

2)使用DeepSORT算法进行人员跟踪,优化了DeepSORT的检测器YOLOv5s算法的中的非极大值抑制算法和DeepSORT的特征提取网络,降低了人员跟踪过程中的ID跳变次数。

3)使用FastReID进行人员重识别,结合注意力机制、人员动态图像库和运动估计的方法降低了遮挡造成的人员无法识别与识别错误的次数。

参考文献(References):

[1] 余京蕾.浅谈计算机视觉技术进展及其新兴应用[J].北京联合大学学报,2020,34(1):63-69.

YU Jinglei.A study on the progress of computer vision and its newly developing applications[J].Journal of Beijing Union University,2020,34(1):63-69.

[2]徐江浪,李林燕,万新军,等.结合目标检测的室内场景识别方法[J].计算机应用,2021,41(9):2720-2725.

XU Jianglang,LI Linyan,WAN Xinjun,et al.Indoorscene recognition method combined with object detection[J].Journal of Computer Applications,2021,41(9):2720-2725.

[3]胡正平,张敏姣,李淑芳,等.智能视频监控系统中行人再识别技术研究综述[J].燕山大学学报,2019,43(5):377-393.

HU Zhengping,ZHANG Minjiao,LI Shufang,et al.Review of person re-identification technology in intelligent video surveillance system[J].Journal of Yanshan University,2019,43(5):377-393.

[4]谭芳喜,肖世德,周亮君,等.基于改进YOLOv3算法在道路目标检测中的应用[J].计算机技术与发展,2021,31(8):118-123.

TAN Fangxi,XIAO Shide,ZHOU Liangjun,et al.Application in road target detection based on improved YOLOV3 algorithm[J].Computer Technology and Development,2019,43(5):377-393.

[5]张长伦,张翠文,王恒友,等.基于注意力机制的NMS在目标检测中的研究[J].电子测量技术,2021,44(19):82-88.

ZHANG Changlun,ZHANG Cuiwen,WANG Hengyou,et al.Research on non-maximum suppression based on attention mechanism in object detection[J].Electronic Measurement Technology,2021,44(19):82-88.

[6]侯志强,刘晓义,余旺盛,等.使用GIoU改进非极大值抑制的目标检测算法[J].电子学报,2021,49(4):696-705.

HOU Zhiqiang,LIU Xiaoyi,YU Wangsheng,et al.Object detection algorithm for improving non-maximum suppression using GloU[J].Acta Electronica Sinica,2021,49(4):696-705.

[7]薛麗霞,朱正发,汪荣贵,等.基于多分区注意力的行人重识别方法[J].光电工程,2020,47(11):23-32.

XUE Lixia,ZHU Zhengfa,WANG Ronggui,et al.Person re-identification by multi-division attention[J].Opto-Electronic Engineering,2020,47(11):23-32.

[8]CHEN T L,DING S J,XIE J Y,et al.ABD-Net:Attentive but diverse person re-identification[J].IEEE,2019:8351-8361.

[9]ZHANG Z Z,LAN C L,ZENG W J,et al.Relation-aware global attention[C]//Conference on Computer Vision and Pattern Recognition.Seattle,USA,Jun.13-19,2020:3183-3192.

[10]WOJKE N,BEWLEY A,PAULUS D.Simple online and realtime tracking with a deep association metric[C]//International Conference on Image Processing.Beijing,China,Sep.17-20,2017:3645-3649.

[11]王迪聪,白晨帅,邬开俊.基于深度学习的视频目标检测综述[J].计算机科学与探索,2021,15(9):1563-1577.

WANG Dicong,BAI Chenshuai,WU Kaijun.Survey of video object detection based on deep learning[J].Journal of Frontiers of Computer Science and Technology,2021,15(9):1563-1577.

[12]徐大专,胡超,潘登,等.目标检测定理[J].数据采集与处理,2020,35(5):791-806.

XU Dazhuan,HU Chao,PAN Deng,et al.Target detection theorem[J].Journal of Data Acquisition and Processing,2020,35(5):791-806.

[13]王树奇,刘贝,邹斐.一种新的矿井监控视频增强目标检测算法[J].西安科技大学学报,2019(2):347-353.

WANG Shuqi,LIU Bei,ZOU Fei.A new image enhancement target detection algorithm based on monitoring video in coal mine tunnel[J].Journal of Xian University of Science and Technology,2019(2):347-353.

[14]金鑫,胡英.基于改进深度网络的车辆乘员数量检测研究[J].激光与红外,2021,51(1):52-58.

JIN Xin,HU Ying.Research on vehicle occupant number detection based on improved depth network[J].Laser and Infrared,2021,51(1):52-58.

[15]從明芳,李子印,卢鸯,等.基于Mask R-CNN深度学习的羊绒羊毛纤维识别技术[J].现代纺织技术,2022,30(2):36-40,47.

CONG Mingfang,LI Ziyin,LU Yang,et al.Recognition technology of cashmere and wool fibers based on mask R-CNN deep learning[J].Advanced Textile Technology,2022,30(2):36-40,47.

[16]朱杰,辛月兰,孙可心.二次特征融合的YOLO目标检测算法[J].计算机与数字工程,2021,49(5):914-919.

ZHU Jie,XIN Yuelan,SUN Kexin.YOLO target detection algorithm based on secondary feature fusion[J].Computer and Digital Engineering,2021,49(5):914-919.

[17]张建明,刘煊赫,吴宏林,等.面向小目标检测结合特征金字塔网络的SSD改进模型[J].郑州大学学报(理学版),2019,51(3):61-66,72.

ZHANG Jianming,LIU Xuanhe,WU Honglin,et al.Improved SSD model with feature pyramid network for small object detection[J].Journal of Zhengzhou University(Natural Science Edition),2019,51(3):61-66,72.

[18] ZHANG Y F,REN W Q,ZHANG Z,et al.Focal and efficient IOU loss for accurate bounding box regression[J].Computer Science,2021,12(1):1-10.

[19]包晓敏,王思琪.基于深度学习的目标检测算法综述[J].传感器与微系统,2022,41(4):5-9.

BAO Xiaomin,WANG Siqi.Survey of object detection algorithm based on deep learning[J].Transducer and Microsystem Technologies,2022,41(4):5-9.

[20]逯彦,黄庆享.基于稀疏表示的目标跟踪新算法[J].西安科技大学学报,2020,40(5):910-918.

LU Yan,HUANG Qingxiang.A novel target tracking algorithm based onsparse representation[J].Journal of Xian University of Science and Technology,2020,40(5):910-918.

[21]王燕妮,王建平.约束条件下的优选进化目标跟踪算法分析[J].西安科技大学学报,2017(4):559-564.

WANG Yanni,WANG Jianping.Analysis of target tracking algorithm of preferred evolutionary under constraints[J].Journal of Xian University of Science and Technology,2017(4):559-564.

[22]HE L X,LIAO X Y,LIU W,et al.FastReID:A pytorch toolbox for general instance re-identification[C]//Computer Vision and Pattern Recognition.Beijing,China,Jul.15-18,2020:407-416.

[23]LI J B,MENG Y,WU Z Y,et al.NEUFA:Neural network based end-to-end forced alignment with bidirectional attention mechanism[C]//International Conference on Acoustics,Speech and Signal Processing.Singapore,Singapore,Mar.23-27,2022:8007-8011.

[24]张海燕,张富凯,袁冠,等.多姿态图像生成的行人重识别算法研究[J].计算机工程与应用:2022,19(3):1-12.

ZHANG Haiyan,ZHANG Fukai,YUAN Guan,et al.Research on person re-identification algorithm based on multi-pose image generation[J].Computer Engineering and Applications,2022,19(3):1-12.

[25]MERCADO G.The filmmakers eye:Learning(and breaking)the rules of cinematic composition[M].New York:Routledge,2013.

(责任编辑:刘洁)