体感交互在大型触摸屏环境中的应用与研究

翟 言,赵国英,黄心渊

(1.北京林业大学信息学院,北京100083;2.奥卢大学计算机科学与工程系,芬兰奥卢90014;

3.中国传媒大学动画与数字艺术学院,北京100024)

体感交互在大型触摸屏环境中的应用与研究

翟 言1,2,赵国英2,黄心渊1,3

(1.北京林业大学信息学院,北京100083;2.奥卢大学计算机科学与工程系,芬兰奥卢90014;

3.中国传媒大学动画与数字艺术学院,北京100024)

大型触摸屏环境带来高沉浸感的触控体验,然而当用户离大屏幕过近时体验效果欠佳。为改善其交互体验,引入体感交互技术,基于用户与屏幕的距离提出2种交互模式。通过设计并实现一套测试系统,将体感交互技术应用到大型触摸屏环境中。利用该系统进行用户测试,并对测试结果进行统计学分析。测试结果显示,体感交互技术能有效减少大型触摸屏环境体验效果欠佳的局限性。体感交互技术与大型触摸屏环境的结合有利于改善公共空间的交互体验。

大屏幕;触摸屏;人机交互;体感交互;动作识别;交互模式

1 概述

在触摸屏技术日渐成熟的今天,越来越多的大型触摸屏被用于公共交互空间[1]。这些大型触摸屏环境在为用户提供高沉浸感交互体验的同时,也为人机交互带来了一些问题。

当用户站在一个大型触摸屏环境中(例如宽3.5 m,高2 m的触摸屏)进行触感交互时,通常难以看清整个屏幕的画面,这对于三维视图导航,系统菜单选择等功能会造成不便。因为大型触摸屏宽达数米,用户在进行一些长距离的触摸交互时(如将物件从屏幕一边拖拽到另一边),需要用户有较大幅度的动作,甚至要求用户来回走动,这也影响到用户的交互体验。由于屏幕过大,用户可能需要举起手臂或

掂起脚尖才能触碰到屏幕的上半部分,一些年幼的儿童或使用轮椅的用户甚至不能触到特定位置因而无法进行交互。

大型触摸屏环境现存的局限性主要来源于屏幕尺寸过大,而用户离屏幕距离过近。所以本文尝试以用户与屏幕间的距离为切入点进行交互模式上的讨论。

文献[2]探讨了隐式交互与显式交互之间的关系,并根据用户与屏幕间的距离划分出4个交互空间。文献[3]利用不同用户离屏幕的远近关系,搭建了一个多用户合作的交互空间。大型触摸屏环境充分利用了用户与屏幕的近距离交互空间,若能通过另外一种交互方式把远距离的交互空间也加以利用,将有可能减少大型触摸屏环境的局限性。

体感交互技术通过识别人体动作实现对计算机的操作,消除了接触式交互设备带来的硬件隔阂。随着近年来实时深度摄像机技术[4]与体感交互算法[5]的日渐成熟,体感交互技术在学术界引起了广泛讨论[6-7]并应用在大型显示系统中[8]。在大型触摸屏环境中引入体感交互技术,有利于对用户与屏幕的远距离交互空间进行利用。文献[9]结合触摸屏与体感交互技术,然而只选用了普通尺寸的触摸屏,并未讨论大型触摸屏环境所产生的问题及解决方法。文献[10]针对大屏幕中的人体检测与跟踪,对双目视觉定位、手势识别等问题进行了研究;文献[11]通过改进手势识别算法来优化用户在大触摸屏上的选择方式,但都没有讨论屏幕与用户间相对距离所产生的问题。

本文分析大型触摸屏环境中的局限性,利用体感交互技术来解决这些问题。基于用户与触摸屏的距离,提出2种交互模式以改善用户在大型触摸屏环境下的交互体验。通过设计并实现一个测试系统,将体感交互与大型触摸屏相结合。

2 基于距离的2种交互模式

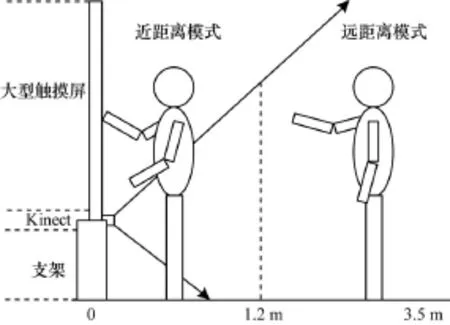

以一个三维地图应用程序为切入点,基于用户与屏幕间的距离设计出2种交互模式,如图1所示。

图1 基于屏幕与用户间距离的2个交互模式

2.1 远距离模式

远距离模式通过Kinect传感器识别用户的动作,从而实现体感交互。用户在进行体感交互时需要跟屏幕保持一定距离,因此,能对整个屏幕画面有更清楚的概观,有利于用户导览视图以及选择菜单等。通过直观地移动手臂,用户即可选择屏幕任意地方的图标或按钮,也能轻松地将物件拖拽到屏幕的任意地方。另外,通过体感交互技术,年幼的儿童或使用轮椅的用户也能轻易地使用系统。远距离模式的主要功能及实现方式如下:

(1)三维视图导航

一般而言,视图导航是用户进入三维地图服务后首先使用的功能。因此,系统通过挥手(正如向系统打招呼)的手势来激活三维视图导航功能。一旦用户对系统挥手后,系统便会追踪用户的手掌心。随着用户掌心上下/左右移动,三维视图的画面会相应垂直/水平地平移。同时,掌心的前移或后拉可对视图进行放大或缩小。

(2)菜单选择

屏幕的边缘设置了系统功能菜单(如搜索、分类、帮助、选项等)。用户通过抓的手势可以让屏幕上的鼠标跟随手势移动,从而轻松地选择屏幕上不同地方的菜单。因为用户进行体感交互时离屏幕有一定距离,所以能清晰了解整个系统菜单,从而容易地实现想要的功能。

(3)拖拽物件

当用户需要拖拽物体时(如将商品拖入购物车),可通过体感交互控制鼠标停留在物件图标上把物件抓起,再移动手臂将物件放置在目标位置。在大型触摸屏环境中,通过触感交互将物件从屏幕一方拖拽至另一方,不但增加了用户的动作,还可能因为用户无法看到系统概况而导致操作失误。体感交互方式对此类情况提供了一个有效的解决方案。

(4)辅助特殊用户

在大型触摸屏环境下,年幼的或使用轮椅的用户可能无法触及屏幕的上半部分而无法进行交互。然而通过体感交互技术,这些特殊用户只需轻松地举起手臂选择辅助模式进行交互。在辅助模式下,用户可以通过手臂动作实现系统的所有功能而无需再触摸屏幕。

2.2 近距离模式

近距离模式利用触感交互实现一些需要用户精准操作或仔细阅读的功能,如:点击屏幕上跳出的窗口及按钮;输入关键字句,发表评论信息;短距离的拖拽(如控制弹出窗口的滚动条)等。

这2种交互模式并没有一条特定距离的边界,只要用户的动作被Kinect识别,远距离模式便会被

激活。因为Kinect的有效识别范围大概为1.2 m~3.5 m,当用户在进行远距离模式下交互时,不会误触到触摸屏;用户在近距离模式中进行触摸交互时也不会被Kinect识别。当用户完成远距离模式的交互之后,可走近屏幕通过触摸屏进行进一步的交互。完成近距离触感交互后,用户也能退回到远距离模式中继续进行体感交互。

3 测试系统的实现

3.1 系统框架设计

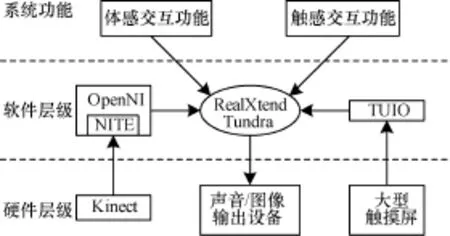

测试系统尝试将上述2种交互模式结合于大型触摸屏环境中。如图2所示,测试系统的顶层功能分为体感交互功能与触感交互功能,分别实现远距离与近距离模式。在软件层级上,通过体感交互开发平台OpenNI与其中间插件NITE接收Kinect获得的人体动作数据;基于TUIO协议,可获取大型触摸屏上的手势信息;最后,将人体动作数据与触摸屏手势信息输入到开源虚拟现实开发平台RealXtend Tundra SDK[12]上,搭建三维地图应用程序,实现测试系统。

图2 测试系统框架

测试系统的硬件层级由6块55英寸MultiTaction触摸屏以3×2的阵列所构成,总宽度为3.73 m,屏幕高度为1.43 m,如图3所示。整块屏幕放置于一个0.75 m高的钢铁支架上,连接着一台高性能的电脑主机(处理器:Intel i7-3770 CPU 3.40 GHz;内存:16 GB;图形显卡:GeForce GTX 670 2 GB×3)。另外,一台微软Kinect传感器被固定在支架与触摸屏之间。

图3 测试系统硬件

3.2 动作识别

OpenNI通过应用程序接口提供了人体骨骼数据,并以15个关节节点描绘出人体骨骼。利用这些节点数据可对用户的特定动作进行识别,从而实现相应的功能。

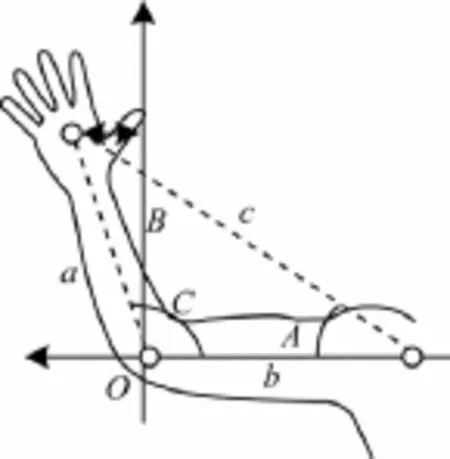

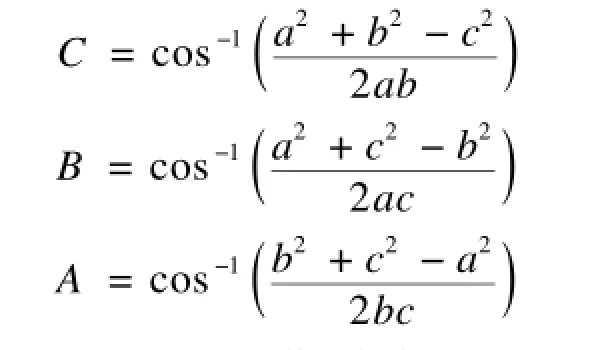

人体的姿势可以通过关节的张合程度来定义。某个关节相对于另一关节的位置与角度是影响用户姿势识别的关键参数。任何3个关节点可组成一个三角形,使用简单的几何模型便可以计算出它们之间构成的角度。知道每个节点的坐标可以计算每个边长的值,然后使用余弦定理获得边与边之间的角度。利用肱二头肌姿势作为例子,如图4所示,可以演示如何使用节点三角形方法来识别姿势。

图4 通过节点三角形计算关节角度

在图4中,组成三角形的3个关节点为:手腕,肘部,肩膀。根据这3个关节点的坐标可计算出3个角度。有2种使用节点三角形的方法。第1种是如上述方法使用3个节点来构造一个三角形;另一个方法就是使用2个节点,第3个节点为另外指定的一点。不同方法取决于姿势的限制和复杂度。上述例子使用的是3个节点的方法,因为所需要的角度是由手腕、肘和肩部构成,不论其他部位如何变化,这3点所成的角度是相对不变的。

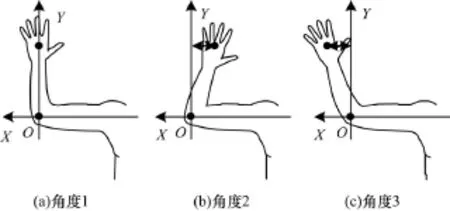

对于某个动作(如挥手),可以根据肘关节与掌心节点所构成的角度来判断该动作是否被完成,如图5所示。

图5 挥手动作的识别

然而,对于这个角度判定并非精准的,因为无法确定多大的角度才能被定义为挥手。解决此问题可通过设定一个阈值范围,若关节点移动满足特定阈值范围时,便可认为用户做出了该姿势。

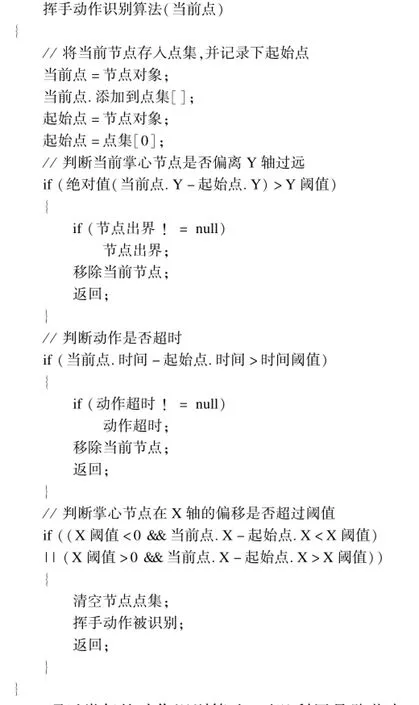

挥手动作识别核心算法流程如下。首先将当前节点存入到节点点集,并记录下掌心节点初始位置。判断当前掌心节点是否偏离Y轴过远,若是便抛出节点出界事件以判断手势超出范围。确定手势在侦测范围后,记录手势开始时间与当前时间。若时间差大于特定阈值,抛出动作超时事件,移除该掌心节点。最后,判断手势的起始位置与当前位置在X轴上的距离是否超过了设定的阈值,若超过便抛出挥手动作被识别事件,判定挥手动作被成功识别;若没有,将等待新的掌心点数据输入,进行下一次判断。以下为实现挥手动作识别功能的伪代码:

通过类似的动作识别算法,可以利用骨骼节点判断不同的动作,进而实现测试系统中的不同功能。如:通过判断掌心关节与手臂关节所成的角度,可实现三维视图导航功能;通过识别掌心向前推的动作,可实现菜单选择功能等。

4 用户测试

用户测试邀请了14名测试者参加(8男6女, 10人年龄在30岁~34岁,4人年龄在35岁~39岁)。测试者需要分别通过触感交互和体感交互在测试系统中完成以下任务:点击屏幕热点,三维视图导航,选择系统功能菜单,拖拽物件,点击屏幕上半部分按钮,坐在轮椅上进行交互。每项任务完成后,用户都需要分别对触感交互与体感交互进行评分。最后,测试者会被要求分别对触感交互与体感交互的控制感、自然度、趣味性分别进行评分。

4.1 测试结果

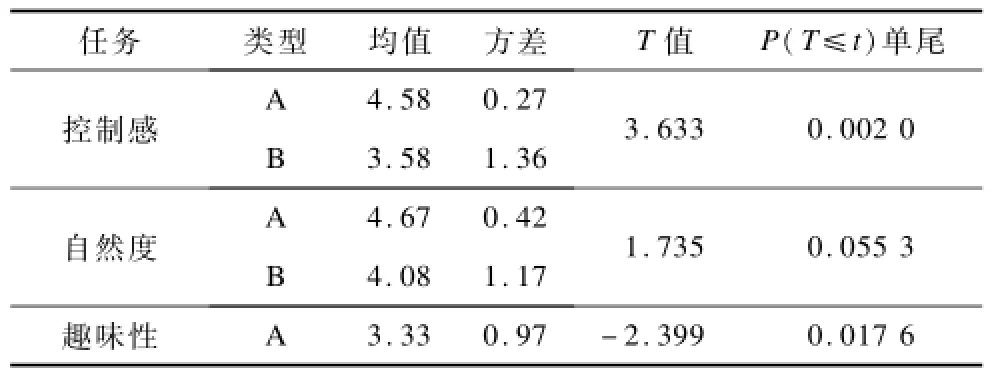

由于测试要求同一批测试者分别对2种交互方式进行评分(5分为最高,1分为最低),即观察值成配对关系,因此本测试在进行统计分析时选用了配对样本T检验,获得了以下的结果,如表1所示,其中,A为触感交互,B为体感交互。

表1 2种交互方式在不同任务中得分的T检验结果

表1中的T检验结果显示,在点击屏幕热点任务中,触感交互与体感交互的得分不具有显著性差异(T=1.332,P=0.104 9>0.05)。在三维视图导航(T=-2.345,P=0.019 4<0.05)和选择系统功能菜单任务(T=-2.000,P=0.035 4<0.05)中,触感交互与体感交互的得分具有显著性差异,表明体感交互很可能在这2项任务中获得更高分数。在拖拽物件(T=-4.324),点击屏幕上半部分(T= -2.872),坐在轮椅上交互(T=-13.675)的任务中,得分结果具有极显著差异(P<0.001),显示体感交互极可能在这3项任务中获得更高分数。另外,对于拖拽物件和模仿特殊用户交互任务上,2种交互方式得分的均值与T值绝对值的差异都比较大,显示出体感交互在这2项任务中的得分可能大大高于触感交互。

对于触感交互与体感交互的控制感、自然度、趣味性的得分(5分为最高,1分为最低),同样也通过配对样本T检验,获得了以下的结果,如表2所示。

表2 2种交互方式在不同参数中得分的T检验结果

表2的结果显示,2种交互方式在控制感的得分上具有显著性差异(T=3.6 3 3,P=0.0 0 20<0.0 5),显示触感交互很有可能在控制感上获得更高分数。对于交互方式的自然度,触感交互与体感交互的得分并不具有显著性差异(P>0.0 5)。而在趣味性上,两者得分具有显著性差异(T=-2.3 9 9,P= 0.0 1 76<0.0 5),显示体感交互在趣味性上的得分很可能高于触感交互。

4.2 结果分析与讨论

根据上述用户测试结果,可认为在大型触摸屏环境中实现三维视图导航与菜单选择功能,体感交互相比触感交互具有一定的改进意义。而在拖拽物件以及辅助特殊用户的功能上,体感交互更显示出明显的优势。在点击交互热点的任务中,体感交互与触感交互并未在得分上显示出显著差异,但对于点击屏幕上半部分的测试,体感交互却显示出非常明显的优势。以上结果证明,对于屏幕过大所产生的无法看清全局画面、无法触及特定位置等问题,体感交互技术提供了一个有效的解决方案。

另外,测试显示体感交互在控制感上的得分不如触感交互,原因可能来自目前体感交互技术还不够成熟,以及测试系统的鲁棒性不足,证明体感交互技术要真正应用于大型触摸屏环境中还需要继续深入研究与实践。在自然度上,2种交互方式的均分都较高且没有显示出明显差异,证明2种交互方式的自然度都能使用户满意。在趣味性上,体感交互的得分明显地高于触感交互。作为新兴的人机交互方式,体感交互技术可引起用户的兴趣,有利于大型触摸屏在公共交互空间中传播信息。

5 结束语

本文论述了大型触摸屏环境下现存的局限性主要来源于用户离大屏幕过近以及屏幕尺寸过大,导致无法看清全局画面、无法触及特定位置等问题。通过对交互空间的研究,基于用户与屏幕的距离提出了2种交互模式。为了对2种交互模式作进一步探讨,本文设计并实现了一个三维地图应用程序,以结合体感交互技术与大型触摸屏环境,并以此进行了用户测试。经过统计学分析后的测试结果显示,体感交互技术有利于减少大型触摸屏环境的局限性,特别在三维视图导航、系统功能菜单选择、拖拽物件、辅助特殊用户等功能上有明显的优势。研究结果表明,体感交互技术与大型触摸屏环境的结合有利于改善公共空间的交互体验,具有一定研究意义与实践价值。

[1]Hinrichs U,Carpendale S,Valkanova N,et al.Interactive Public Disp lays[J].Com puter G raphics and Applications,2013,33(2):25-27.

[2]Vogel D,Balakrishnan R.Interactive Public Am bient Displays:Transitioning from Im plicit to Explicit,Public to Personal,Interaction w ith M ultiple Users[C]// Proceedings o f the 17th Annual ACM Sym posium on User Interface Software and Technology.New York,USA:ACM Press,2004.

[3]Haw key K,Kellar M,Reilly D,et al.The Proxim ity Factor:Im pact of Distance on Co-located Collaboration[C]//Proceedings of International ACM SIGGROUP Conference on Supporting Group W ork.New York,USA:ACM Press,2005.

[4]Freedm an B,Shpunt A,M achline M,et al.Depth M apping Using Projected Patterns:USA,US20100118123 A1[P].2010-05-13.

[5]Shotton J,Sharp T,Kipman A,et al.Real-time Human Pose Recognition in Parts from Single Depth Images[J].Comm unications of the ACM,2013,56(1):116-124.

[6]林 鹏,张 超,李竹良,等.基于深度图像学习的人体部位识别[J].计算机工程,2012,38(16):185-188.

[7]曹雏清,李瑞峰,赵立军.基于深度图像技术的手势识别方法[J].计算机工程,2012,38(8):16-18.

[8]Ren Gang,Li Chuan,O’Neill E,et al.3D Freehand Gestural Navigation for Interactive Public Displays[J].IEEE Com puter Graphics and Applications,2013,33(2):47-55.

[9]Bragdon A,Deline R,H inckley K,et al.Code Space:Touch+Air Gesture Hybrid Interactions for Supporting Developer Meetings[C]//Proceedings of ITS.New York,USA:ACM Press,2011.

[10]郭 星.大屏幕人机互动中若干关键技术研究[D].合肥:安徽大学,2013.

[11]高 洋.大触摸屏上目标选择技术研究与设计[D].长春:吉林大学,2013.

[12]A latalo T.An Entity-com ponent M odel for Extensible VirtualW orlds[J].Internet Computing,2011,15(5):30-37.

编辑 顾逸斐

Application and Research on Somatosensory Interaction in Large Touchscreen Envirnoment

ZHAI Yan1,2,ZHAO Guoying2,HUANG Xinyuan1,3

(1.School of Information Science and Technology,Beijing Forestry University,Beijing 100083,China;

2.Department of Computer Science and Engineering,University of Oulu,Oulu 90014,Finland;

3.School of Animation and Digital Arts,Communication University of China,Beijing 100024,China)

While enhancing the immersion of touch-based interaction,large touchscreen yet shows some limitations due to the short distance between user and the large screen.In order to improve user experience,this paper tries to combine gesture interaction and large touchscreen with two interaction modes based on the distance between user and screen.A survey is performed through a test system which combines both gesture interaction and large touchscreen technology.Statistical results indicate that gesture interaction is beneficial to large touchscreen display,which proves the practical value and research significance of this study.

large screen;touchscreen;human computer interaction;somatosensory interaction;gesture recognition; interaction mode

翟 言,赵国英,黄心渊.体感交互在大型触摸屏环境中的应用与研究[J].计算机工程,2015, 41(3):317-321.

英文引用格式:Zhai Yan,Zhao Guoying,Huang Xinyuan.Application and Research on Somatosensory Interaction in Large Touchscreen Envirnoment[J].Computer Engineering,2015,41(3):317-321.

1000-3428(2015)03-0317-05

:A

:TP18

10.3969/j.issn.1000-3428.2015.03.060

北京市科技专项基金资助项目“数字动画创作支撑平台的研究与实践”;芬兰科学院基金资助项目(251286);芬兰FiDiPro基金资助项目(40093/12)。

翟 言(1988-),男,硕士研究生,主研方向:人机交互,虚拟现实;赵国英,副教授、博士;黄心渊(通讯作者),教授、博士。

2014-04-14

:2014-05-20E-mail:yan_chuck@hotmail.com