基于Cascade R-CNN改进的花色布匹瑕疵智能识别方法

摘 要:花色布匹在生产的过程中,其相比于单色布匹的生产需要引入更多的加工工序,比如印花、后整理等工序,经常导致花色布匹产生更多的瑕疵类别。为了实现花色布匹瑕疵的智能识别与检测,文章给出一种基于Cascade R-CNN改进的花色布匹瑕疵智能识别与检测方法,实验结果表明,相比同类算法,文章提出的方法在花色布匹瑕疵数据集上识别的准确率提升了2.39%,mAP评估指标提高了3.83%的显著效果。

关键词:花色布匹瑕疵;目标识别;缺陷检测;深度学习;卷积神经网络

中图分类号:TP391.41;TS107 文献标识码:A 文章编号:2096-4706(2020)23-0020-05

Improved Intelligent Recognition Method of Pattern and Color Fabric Defects

Based on Cascade R-CNN

LU Guijia

(Guangdong University of Technology,Guangzhou 510006,China)

Abstract:In the process of patterned and color fabric production,it needs to introduce more processing procedures than the production of monochrome fabric,such as printing and finishing,etc,which often leads to more defect categories in the pattern and color fabric. In order to realize the intelligent recognition and detection of the defects of the pattern and color fabric,this paper presents an improved method of intelligent recognition and detection of the pattern and color fabric defects based on Cascade R-CNN. The experimental results show that compared with similar algorithms,the method proposed in this paper improves the accuracy of recognition on the pattern and color fabric defect data set by 2.39%,and the mAP evaluation index is improved by 3.83%.

Keywords:pattern and color fabric defect;target recognition;defect detection;deep learning;convolutional neural network

0 引 言

眾所周知,工业产品的表面缺陷问题严重地影响着其美观和质量,对于纺织工业的布匹产品,其表面的缺陷一般被人们称为布匹瑕疵,其可能会产生于布匹生产工艺流程上各个环节,布匹产品的瑕疵问题会导致布匹产品滞销和经济损失[1]。目前在我国的纺织企业中布匹瑕疵识别绝大多数还是依靠人工检测,人工检测有效率低,成本高,会导致误检和漏检等问题,且人工检测布匹瑕疵检出率约为70%[2],对于追求高质量纺织品和提高生产效率的布匹生产企业,这无疑是个比较严重的阻碍。

近年来,随着人工智能技术的快速发展与应用,基于深度学习的方法使得布匹瑕疵智能识别与检测的效果又迈进了一大步。吴志洋等[3]为了解决单色布匹瑕疵的快速检测,基于AlexNet[4]提出了一种双网络并行的OurNet方法,在单色布匹瑕疵识别准确率和速度上有显著的提升,该模型均衡了检测速度和性能,但是对于分辨率高,瑕疵区域小的布匹图像,却难以检测。车翔玖等[5]针对高分辨率,瑕疵区域小的布匹图像不易于检测的问题,基于FastRCNN[6]改进提出一种多分类任务概率合成的方法,能够有效识别高分辨率,小目标瑕疵的布匹图像的瑕疵,不过在识别和检测速度上并不够理想。

上述方法均是基于深度学习算法对布匹瑕疵检测进行相关研究,不过研究的对象都是易于检测的单色布匹和纹理布匹瑕疵种类,而对于花色布匹,其瑕疵种类更为繁多,背景纹理图案复杂,瑕疵形状与背景花纹相似的布匹图像条件下却难以发挥出其相应的性能,同时花色布匹瑕疵识别在国内外却鲜有研究。基于此,本文在布匹瑕疵检测相关研究的基础上,引入花色布匹模板图像,提出了基于花色布匹图像模板的花色布匹瑕疵智能识别与检测方法。该方法首先使用图像处理技术对采集到的花色布匹瑕疵图像进行预处理,进一步将图像输入卷积神经网络进行特征提取;其次,引入花色布匹模板图像的特征层,基于特征金字塔网络(FPN)搭建一种新的特征融合网络(TeFPN)来进行有效特征融合;最后,提出一种基于花色布匹图像模板的回归框抑制方法(Te-NDS)来提高最终的花色布匹瑕疵识别效果。

1 花色布匹瑕疵问题描述

通过对花色布匹瑕疵进行观察,发现有一些花色布匹的瑕疵特征与花色背景纹理十分相似,还有一些瑕疵类别之间的特征也十分相似,部分各类花色布匹瑕疵如图1所示,若依靠人工去检查很难通过人眼去观察并把它们寻找出来,而且人工检测花色布匹瑕疵是十分困难且低效率的,所以本文拟采用一种基于深度学习的智能方法来研究花色布匹瑕疵的识别与检测。

通过对花色布匹数据库进行分类统计,可以发现花色布匹瑕疵各个类别在分布上具有显著的不平衡特性。其中,最多的是玷污类瑕疵,总共有5 233个,占瑕疵总体的34.7%,瑕疵数目最少的类别是破洞类,有368个,约占总体的2.5%,这样的数据分布显然不利于用学习的方法进行模型训练并推理预测。同时,本文还对各类瑕疵的形状尺寸进行统计分析,发现各类瑕疵存在类内瑕疵尺寸差异较大,类间瑕疵尺寸差异显著的特点。

2 花色布匹瑕疵检测模型构建

2.1 基于Cascade R-CNN改进的花色布匹瑕疵识别方法

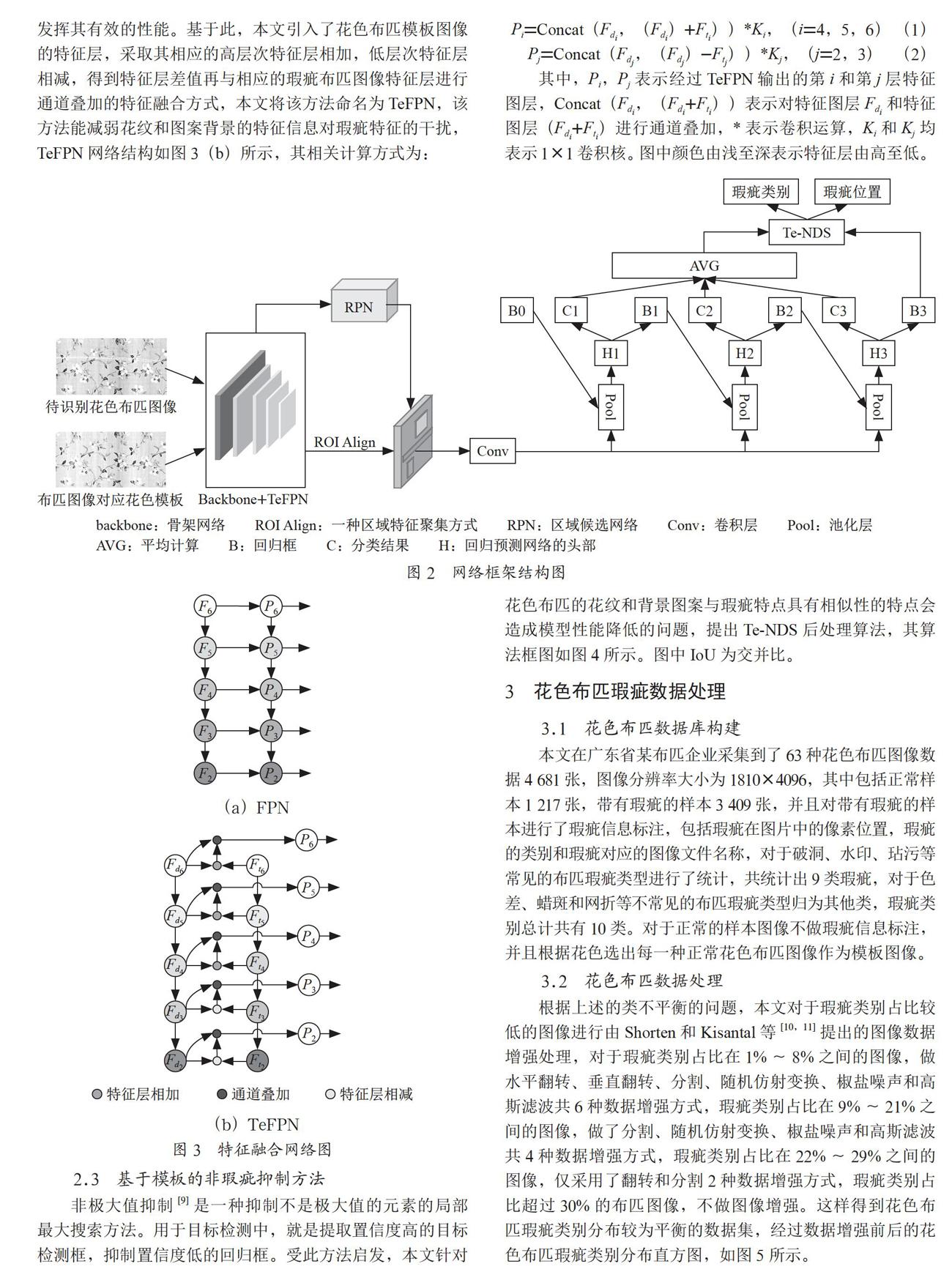

为了更能适应对于花色布匹瑕疵的检测与分类,本文采用Cascade R-CNN[7]网络结构作为花色布匹瑕疵识别的基本模型,并且在此模型结构上做了部分有效的改进,网络框架结构如图2所示。首先,本文基于特征金字塔网络[8],引入正常花色布匹图像作为模板进行特征提取,然后和待检测花色布匹图像提取的特征层进行有效的融合。其次,本文采用K-means聚类分析方法,针对花色布匹瑕疵尺寸进行聚类分析,然后在网络模型结构中的区域候选网络中对anchor的比例和尺寸大小进行重新设定。最后,本文在瑕疵分类和定位回归处理上结合了花色布匹模板图像进行非极大值抑制处理,提高了花色布匹瑕疵检测定位的效果。

2.2 基于FPN改进的特征融合网络

FPN是通过利用卷积神经网络提取输入图像的特征图层进行了横向连接和自顶向下连接的特征融合方式,这种方法能够有效地融合输入图像中各个维度的特征,可以使下层输出的特征图层融合上层的语义信息,实验表明,该特征表达的语义信息更为有效。FPN网络结构如图3(a)所示,其中Fl(l=2,…,6)表示经过CNN提取原始图像的第2~6层金字塔型特征图层,从第6层特征图层F6开始,每个特征图层在水平方向以3×3的卷积核进行卷积运算,再从最顶层P6从顶向下进行2倍的上采样运算后与对应水平卷积运算后的特征图层逐元素相加,获得最终特征图层Pk(k=2,…,5)。

由于花色布匹瑕疵的特点与花色布匹的背景花纹图案具有相似性,FPN会融合花色布匹图像的冗余特征信息,难以发挥其有效的性能。基于此,本文引入了花色布匹模板图像的特征层,采取其相应的高层次特征层相加,低层次特征层相减,得到特征层差值再与相应的瑕疵布匹图像特征层进行通道叠加的特征融合方式,本文将该方法命名为TeFPN,该方法能减弱花纹和图案背景的特征信息对瑕疵特征的干扰,TeFPN网络结构如图3(b)所示,其相关计算方式为:

Pi=Concat(Fdi,(Fdi)+Fti))*Ki,(i=4,5,6) (1)

Pj=Concat(Fdj,(Fdj)-Ftj))*Kj,(j=2,3) (2)

其中,Pi,Pj表示经过TeFPN输出的第i和第j层特征图层,Concat(Fdi,(Fdi+Fti))表示对特征图层Fdi和特征图层(Fdi+Fti)进行通道叠加,*表示卷积运算,Ki和Kj均表示1×1卷積核。图中颜色由浅至深表示特征层由高至低。

2.3 基于模板的非瑕疵抑制方法

非极大值抑制[9]是一种抑制不是极大值的元素的局部最大搜索方法。用于目标检测中,就是提取置信度高的目标检测框,抑制置信度低的回归框。受此方法启发,本文针对花色布匹的花纹和背景图案与瑕疵特点具有相似性的特点会造成模型性能降低的问题,提出Te-NDS后处理算法,其算法框图如图4所示。图中IoU为交并比。

3 花色布匹瑕疵数据处理

3.1 花色布匹数据库构建

本文在广东省某布匹企业采集到了63种花色布匹图像数据4 681张,图像分辨率大小为1810×4096,其中包括正常样本1 217张,带有瑕疵的样本3 409张,并且对带有瑕疵的样本进行了瑕疵信息标注,包括瑕疵在图片中的像素位置,瑕疵的类别和瑕疵对应的图像文件名称,对于破洞、水印、玷污等常见的布匹瑕疵类型进行了统计,共统计出9类瑕疵,对于色差、蜡斑和网折等不常见的布匹瑕疵类型归为其他类,瑕疵类别总计共有10类。对于正常的样本图像不做瑕疵信息标注,并且根据花色选出每一种正常花色布匹图像作为模板图像。

3.2 花色布匹数据处理

根据上述的类不平衡的问题,本文对于瑕疵类别占比较低的图像进行由Shorten和Kisantal等[10,11]提出的图像数据增强处理,对于瑕疵类别占比在1%~8%之间的图像,做水平翻转、垂直翻转、分割、随机仿射变换、椒盐噪声和高斯滤波共6种数据增强方式,瑕疵类别占比在9%~21%之间的图像,做了分割、随机仿射变换、椒盐噪声和高斯滤波共4种数据增强方式,瑕疵类别占比在22%~29%之间的图像,仅采用了翻转和分割2种数据增强方式,瑕疵类别占比超过30%的布匹图像,不做图像增强。这样得到花色布匹瑕疵类别分布较为平衡的数据集,经过数据增强前后的花色布匹瑕疵类别分布直方图,如图5所示。

4 实验结果与分析

4.1 实验环境与细节

本文的实验环境是采用配置为Intel(R)Xeon(R)E5-2650 v4 @ 2.20 GHz CPU和NVIDIA GeForce GTX 1080Ti GPU

的服务器进行实验,服务器的操作系统为Ubuntu 16.04,同时基于PyTorch框架进行模型的搭建与改进,用到ImageNet[12]中的预训练权重。此外,使用了OHEM采样方法进行采样、多尺度训练、随机翻转等训练技巧和Focal Loss损失函数,使用随机梯度下降算法进行优化训练过程不会引起梯度爆炸。

4.2 评估指标

识别的准确率(Acc)为识别正确的花色布匹图像数量与测试集所有样本数量的比值,其计算公式见式(3):

(3)

其中,TP为预测实际瑕疵为瑕疵,TN为预测实际正常花色布匹为正常(无瑕疵),M为测试集所有样本数量。

另外,为了测量模型在10类不同瑕疵中的总体检测性能,本文采用mAP性能指标进行评估模型的性能,mAP的定义公式为式(4):

(4)

其中Pn(Rn)表示第n类的PR曲线,N表示实际的总类别数目。识别的速度以每秒识别帧数(FPS)来评估,一帧表示一幅花色布匹图像,FPS值越高表明识别速度越快。

4.3 模型的性能实验结果

本文实验用到含有28种花色,926张分辨率为2 048 ×915的花色布匹图像的测试集进行花色布匹瑕疵智能识别实验,表1是本文方法和同类方法的实验结果比较。Faster RCNN在不同的骨架网络上的性能表现相差不大,随着卷积网络层数的加深,其准确率和mAP都有小幅度提升,准确率提高了0.55%,mAP提升了1.41%,由此可以推断,卷积网络深度的加深可以提取更到更多的特征信息,提升模型的检测性能。一方面,在相同的骨架网络下Cascade R-CNN与Faster RCNN相比,Cascade R-CNN的性能表现更好。另一方面,Cascade R-CNN在同一特征提取骨架网络下,特征融合网络中TeFPN的准确率相比FPN提高了1.07%,mAP提升了2.07%,因此TeFPN有效地融合瑕疵的特征,过滤掉部分花纹和背景图案等非瑕疵特征信息。同时,Te-NDS的引入也使得模型的识别准确率再提高了1.32%,mAP又提升了1.76%,验证了本文提出的Te-NDS方法能有效地抑制模型对背景纹理信息对瑕疵特征的干扰。另外,经过参数整定实验,当设定Te-NDS的阈值Nt=0.32时,模型性能在测试集上取得最好的效果。这说明,对比于原始的Cascade R-CNN方法,本文的改进方法在花色布匹瑕疵数据集上的准确率和mAP性能指标均有大幅提升,不过在识别的速度上略有减缓。

5 结 论

本文针对花色布匹具有花纹和复杂图案等条件下进行瑕疵分类与检测,提出了一种基于Cascade R-CNN改进的智能识别方法。该方法通过在特征融合网络引入花色布匹图像的模板特征层与待测花色布匹图像特征层进行有效融合,同时在模型识别过程中采用了一种基于花色布匹模板的非瑕疵抑制的后处理方法。经过实验验证,本文提出的方法能够提升花色布匹瑕疵的识别效果,可应用于花色布匹瑕疵的识别与检测。

参考文献:

[1] HENRY Y.T. NGAN A,Grantham K.H,etc. Automated fabric defect detection—A review [J].Image and Vision Computing,2011,29 (7):442-458.

[2] CHAN C H,PANG G K H. Fabric defect detection by Fourier analysis [J].IEEE Transactions on Industry Applications,2000,36(5):1267.

[3] 吴志洋,卓勇,李军,等.基于卷积神经网络的单色布匹瑕疵快速检测算法 [J].计算机辅助设计与图形学学报,2018,30(12):2262-2270.

[4] KRIZHEVSKY A,SUTSKEVER I,HINTON G. ImageNet classification with deep convolutional neural networks [J].Communications of the ACM,2017,60(6):84-90.

[5] 车翔玖,刘华罗,邵庆彬.基于Fast RCNN改进的布匹瑕疵识别算法 [J].吉林大学学报 (工学版),2019,49(6):2038-2044.

[6] GIRSHICK R. Fast R-CNN [C]//2015 IEEE International Conference on Computer Vision (ICCV).Santiago:IEEE,2015:1440-1448.

[7] CAI Z W,VASCONCELOS N. Cascade R-CNN:Delving Into High Quality Object Detection [C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition:IEEE,2018.

[8] LIN T Y,DOLLAR P,HE K,et al. Feature Pyramid Networks for Object Detection [C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR):IEEE,2017.

[9] NEUBECK A,GOOL L J V. Efficient Non-Maximum Suppression [C]//International Conference on Pattern Recognition:IEEE,2006.

[10] SHORTEN C,KHOSHGOFTAAR T M. A survey on Image Data Augmentation for Deep Learning [J].Journal of Big Data,2019,6(1):1-48.

[11] KISANTAL M,WOJNA Z,MURAWSK J,et al. Augmentation for small object detection [C]//9th International Conference on Advances in Computing and Information Technolog:Aircc Publishing Corporation,2019.

[12] DENG J,DONG W,SOCHER R,et al. ImageNet:A large-scale hierarchical image database [C]//IEEE Conference on Computer Vision & Pattern Recognition.Miami:IEEE,2009:248-255.

作者簡介:陆贵家(1996—),男,壮族,广东广州人,硕士研究生在读,主要研究方向:深度学习,计算机视觉,目标检测。