基于深度学习的翼状胬肉自动分类系统研究

何 楷,吴茂念,郑 博,杨卫华,朱绍军,金 玲

0引言

翼状胬肉(pterygium)是结膜组织的一种慢性炎症增生性疾病,是眼科常见病和多发病[1],病变较大时会限制眼球运动,甚至导致失明。全球翼状胬肉的患病率约为12%,中国40岁以上人群翼状胬肉的患病率约为13.4%,中国将近有1.09亿人患有翼状胬肉[2],以渔民、农民等经常暴露在紫外线下的户外工作者最多[3-6]。翼状胬肉患者大多生活在农村,经济困难,长期以来很少受到人们的关注,且农村地区医疗设备短缺,专业医生少,人工诊断筛查工作量大[7]。

随着人工智能(artificial intelligence,AI)技术的进步和眼科人工智能的发展,为眼科学的快速发展提供了可能。当前已有人工智能诊断系统应用于临床辅助诊断[8-11],可快速获取初步诊断结果,节省医生时间,提高诊断效率。目前使用深度学习技术对翼状胬肉的自动分类研究较少[12-19],主要基于翼状胬肉与非翼状胬肉的自动二分类,Zaki等提出的最好深度学习二分类模型,其准确率达99.22%,但并没有进一步的翼状胬肉分级研究[19]。本研究基于临床采集的翼状胬肉正常、观察期、手术期眼前节图像三个类别数据,使用深度学习技术,分别训练VGG16、AlexNet、ResNet18、MobileNetV2、EfficientNetB0、EfficientNetB4和EfficientNetB7神经网络分类模型,确定最好模型,实现翼状胬肉自动三分类系统,辅助医生筛查诊断,减轻工作量,为翼状胬肉疾病细化分级研究提供参考。

1对象和方法

1.1对象本研究中使用的翼状胬肉彩色眼前节图片数据集,均来源于2020-05/2021-04南京医科大学附属眼科医院通过裂隙灯数字显微镜照相获得,共计750张分辨率为5184×3456、格式为JPG的RGB彩色眼前节图片,其中翼状胬肉正常眼前节图片250张,观察期眼前节图片250张,手术期眼前节图片250张,所有图片都经过南京医科大学附属眼科医院眼科2名经验丰富的眼科医生交叉阅片确认,当2名医生意见不一致时经第3名高级眼科专家判定。所有图片都已做脱敏处理,不包含任何患者隐私信息。本研究经医院伦理委员会审批通过。

1.2方法

1.2.1数据预处理图片的预处理方法主要包括数据增强和数据标准化。

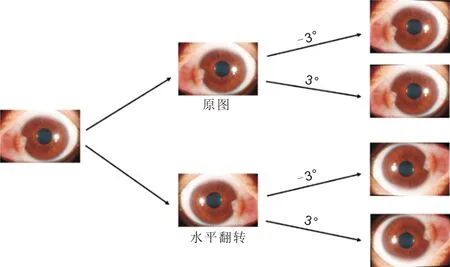

1.2.1.1数据增强本试验数据集数量有限,为防止试验结果差,使训练生成的模型泛化能力好,故对原始数据集进行增强。采取的数据增强方法为:(1)对原始翼状胬肉彩色眼前节图片进行水平翻转;(2)对原图和水平翻转图片分别旋转-3°和3°;(3)产生出6倍的数据增强效果,见图1。

图1 翼状胬肉数据集扩增方法图。

1.2.1.2数据标准化翼状胬肉眼前节图片是由RGB色彩通道构成,其图像特征是由3个范围在[0,255]的像素值组成,特征值之间数据差异过大会影响模型的训练效果。标准化是指利用线性变换将各特征值缩放到相应区间的一种方法。本试验采用了迁移学习算法,所以采用的预处理方法要与PyTorch深度学习框架中预训练模型所使用的方法一致,将图片中的像素值标准化到[-1,1]范围内,这样可以保证所有的图像数据分布更集中,在训练的时候更容易收敛,便于加速训练过程。

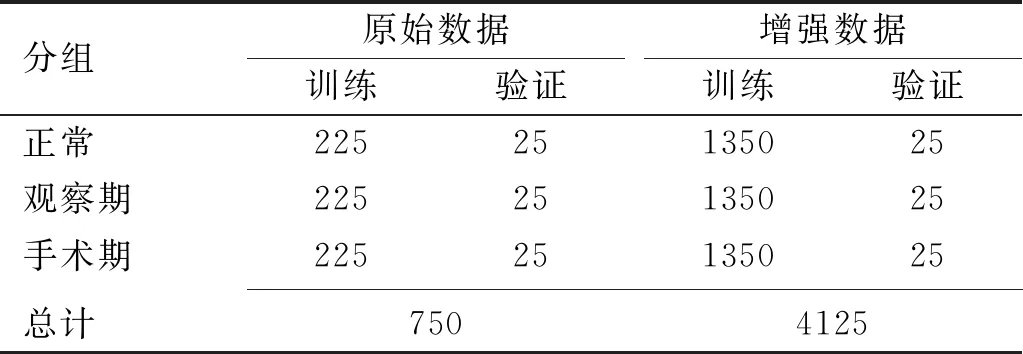

1.2.2数据划分本试验首先对三种类别各250张翼状胬肉眼前节图片按9∶1比例划分为试验训练集(225张)和验证集(25张),然后对划分的训练集做数据增强,每类别扩增为原来的6倍(1350张),最终,原始数据被划分为:训练集共675张,验证集共75张,共计750张。增强数据被划分为:训练集共4050张,验证集共75张,共计4125张,见表1。

表1 试验数据集划分 张

1.2.3模型训练由于本试验训练数据量少,若直接训练分类模型,会出现分类准确率低和过拟合问题。所以本研究采用迁移学习,一种将某个领域或任务上学习到的知识或模式应用到不同但相关的领域或问题中的方法,能在提升准确率同时减少模型训练时间。

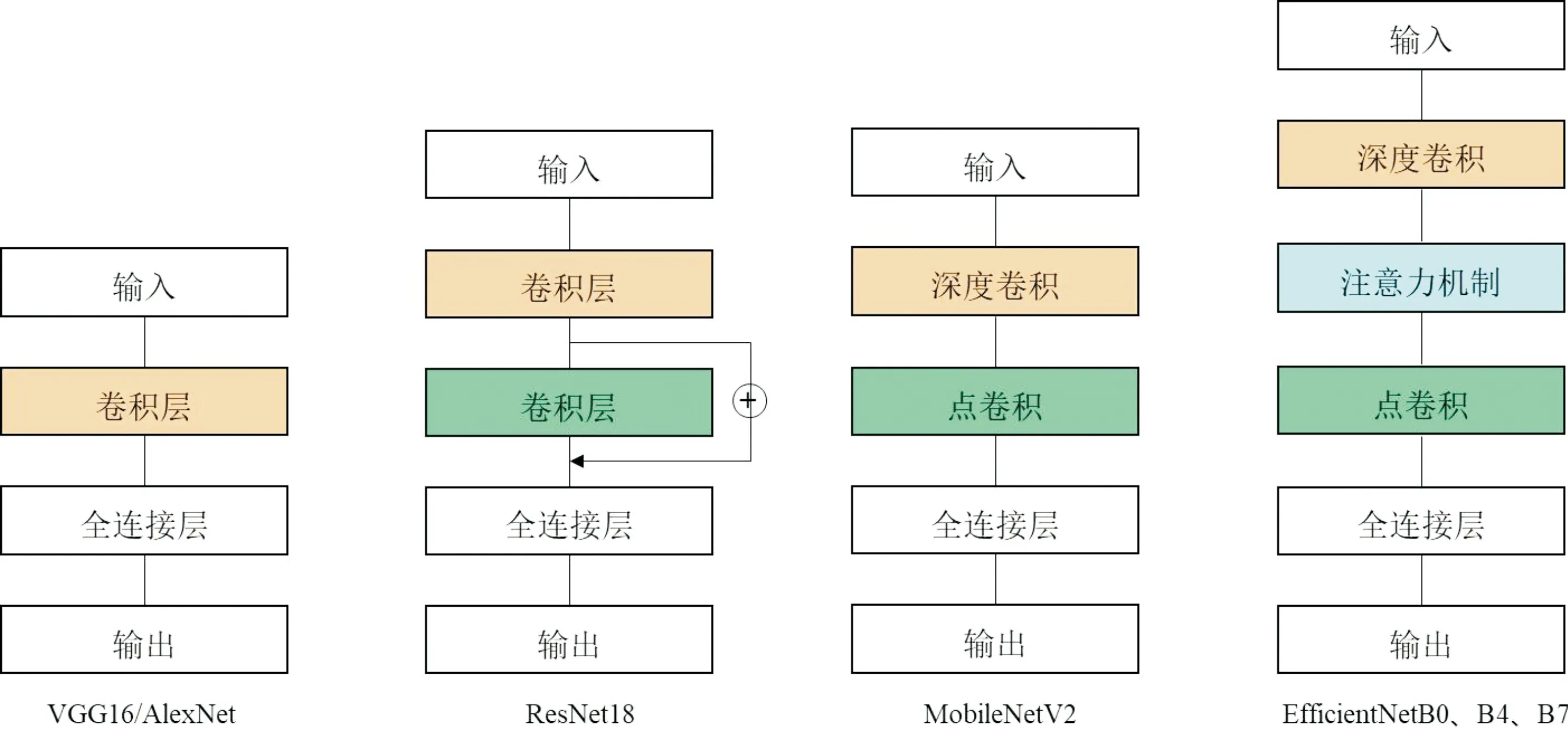

本研究分别在原始数据集和增强数据集上,使用迁移学习方法。选择加载在ImageNet大数据集完成分类任务的预训练模型VGG16、AlexNet、ResNet18、MobileNetV2、EfficientNetB0、EfficientNetB4和EfficientNetB7,其模型简单结构如图2所示,固定预训练模型卷积层参数,使用SGD优化算法,经过多次数据迭代,重新训练新分类器参数来获得翼状胬肉三分类模型。为了检测模型效果,我们从临床获取了189张正常图片,171张观察期图片和110张手术期图片,共计470张进行测试,对比两种数据集上训练的14个模型测试结果,最终确定可用于自动分类系统的模型。为了降低因随机划分数据,导致结果的偶然性,本试验设置不同随机划分参数,进行了多次试验,可保证构建模型的稳定性。

图2 本试验使用的深度学习网络模型简单结构图。

1.2.4试验条件本试验使用的硬件配置为Intel(R) Xeon(R) Gold 5118CPU,主频为2.30GHz,Tesla V100显卡,32GB显存,操作系统为Ubuntu18.04,深度学习框架为PyTorch,编程语言为Python。

统计学分析:采用SPSS25.0统计学软件进行统计分析。分别使用灵敏度、特异度、准确率、Kappa值、受试者工作特征曲线曲线(receiver operator characteristic curve,ROC)及ROC曲线下面积(area under curve,AUC)指标来分析模型测试效果。灵敏度越高,漏诊率低;特异度越高,误诊率低;Kappa值在61%~80%为显著一致性,>80%为高度一致性;ROC曲线分析不同模型诊断性能;AUC值在50%~70%认为该指标具有较低诊断价值,70%~85%认为效果一般,>85%认为该指标具有很好的诊断价值。

2结果

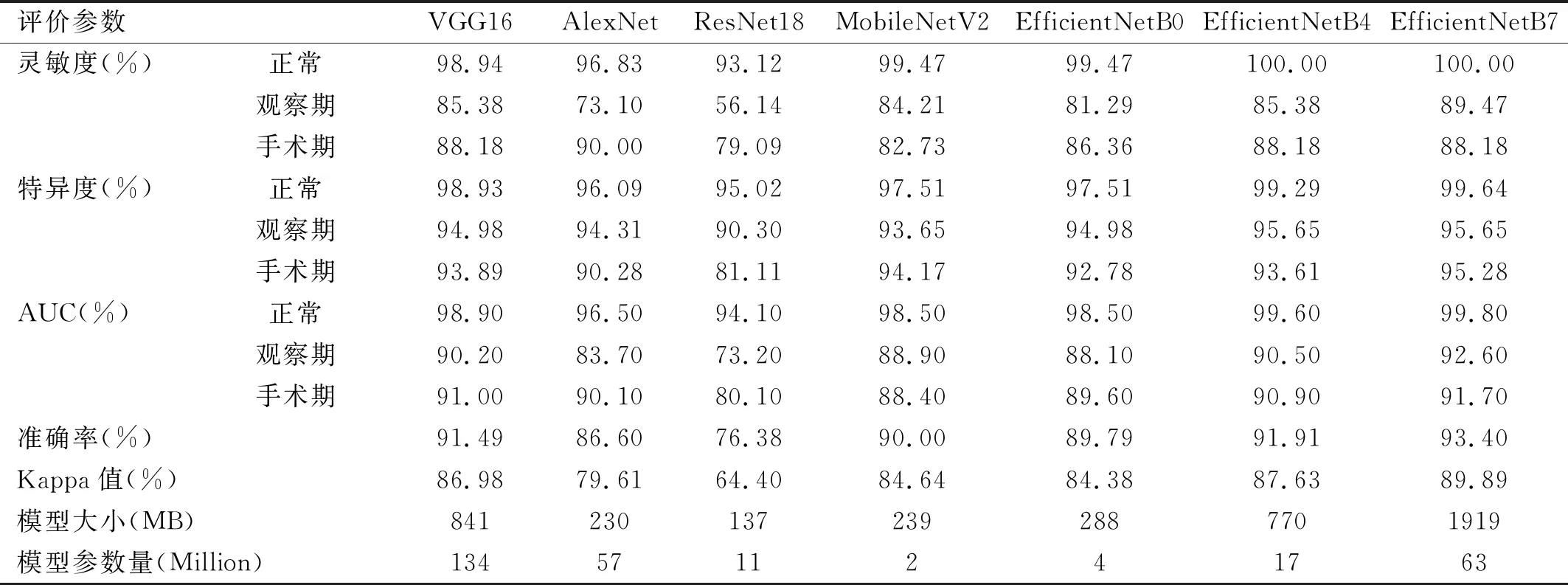

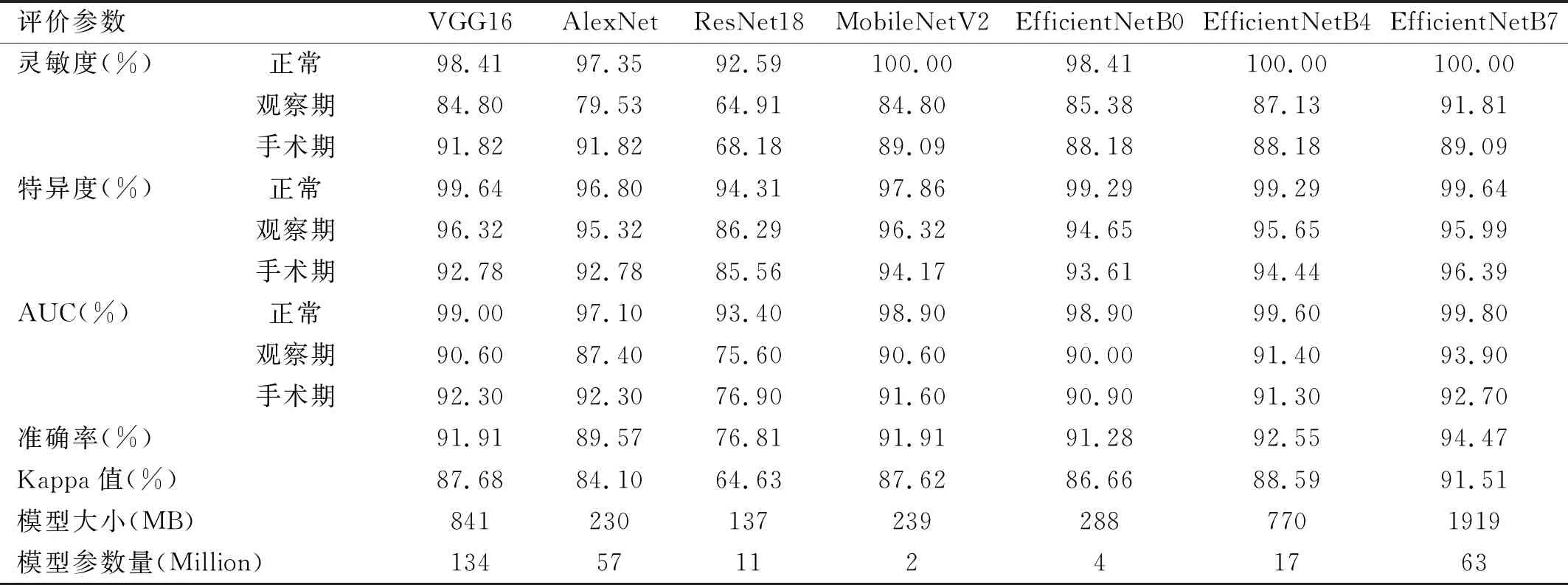

2.1不同数据集测试结果比较本试验在原始数据集和增强数据集分别训练得到翼状胬肉三分类模型,使用470张临床眼前节图像对模型进行测试,结果见表2、3。对比不同数据集的测试结果,增强数据集训练得到的模型取得更好的结果。准确率:不同模型在数据增强后增长0.5%~3%。Kappa值:不同模型在数据增强后增长0.2%~4%,最高值为91.51%,是在增强数据集上训练的EfficientNetB7模型结果。灵敏度在数据增强后平均提升3.7%,特异度在数据增强后平均提升1.9%,AUC在数据增强后平均提升2.7%,最大AUC是在增强数据集训练的EfficientNetB7模型上取得,其平均值为95.46%。总之通过随机改变训练样本进行数据的增强可以降低模型对某些属性的依赖,从而提高模型的泛化能力。数据增强让有限的数据产生更多的数据,增加训练样本的数量以及多样性,可以训练模型识别更多的图像特征,训练得到更好的参数,实现更好的分类效果。

2.2不同模型间测试结果比较对比不同模型测试结果见表2、3。在原始数据集和增强数据集上,EfficientNetB7在灵敏度、特异度、AUC、准确率和Kappa值评价指标上均取得最好结果。在原始数据集上训练最好EfficientNetB7模型的准确率为93.40%,Kappa值为89.89%,灵敏度平均值为92.55%,特异度平均值为96.86%,AUC平均值为94.70%。在增强数据集上,其准确率为94.47%,Kappa值为91.51%,灵敏度平均值为93.63%,特异度平均值为97.34%,AUC平均值为95.47%,该模型具有很好的诊断价值。根据表3所示,对比不同模型大小和模型参数量,轻量化MobileNetV2模型大小仅为EfficientNetB7模型的1/8,准确率相差2.5%,Kappa值相差3.8%,AUC相差1.7%,该模型也具有很好的诊断和应用价值。EfficientNet不同输入分辨率模型,整体表现出了很好的测试结果。为了准确辅助医生诊断,在增强数据集训练的EfficientNetB7模型具有很好的诊断价值,可以初步用于自动分类诊断系统。

表2 原始数据集上训练的不同模型测试结果

表3 增强数据集上训练的不同模型测试结果

3讨论

翼状胬肉是常见的眼表疾病之一,不断增大的翼状胬肉会导致眼球运动障碍等一系列问题。翼状胬肉患者多来自于农村基层地区,但目前基层医院专业眼科医生少,培养周期长,难以短时间解决当前问题。随着AI技术在眼科领域的不断成熟[20-24],智能诊断系统的应用,使用AI技术智能辅助翼状胬肉诊断可以有效缓解农村地区医疗需求。基于这样的出发点,本研究通过训练自动分类模型,智能辅助眼科医生完成对翼状胬肉的初期分类诊断工作,缩短医生诊断时间,减轻医生工作量。

本研究中模型判别正常眼前节图片结果高于判别观察期和手术期眼前节图片,其最好的EfficientNetB7模型灵敏度平均高9.6%,特异度平均高3.5%,AUC值平均高6.5%。主要原因是正常眼前节图片更容易分辨,而观察期和手术期眼前节图片相似性强,分辨界限较为模糊。同时本研究试验训练数据只有750张,试验数据量少,模型对样本数据特征学习少,整体泛化性能稍差。

翼状胬肉使用深度学习方法实现自动分类研究较少,Zaki等从2018开始发表翼状胬肉有关分类与检测文章[14,17,19],2020年最新研究开发的翼状胬肉二分类辅助筛选平台,能够很好识别翼状胬肉眼前节图像和正常眼前节图像,准确率为99.22%、灵敏度为98.45%、特异度为100%、AUC值为100%[19]。将本研究观察期和手术期图像归为翼状胬肉类,EfficientNetB7模型三分类测试结果通过计算过渡为正常与翼状胬肉二分类结果后,准确率为99.8%、灵敏度为100%、特异度为99.64%、AUC值为99.80%。

与Zaki等2020年结果想比,本研究准确率和灵敏度更好,特异度和AUC值稍差,整体相差不大。

本研究试验中EfficientNet系列模型相比其他经典模型取得了更好的三分类测试结果,其中最好的EfficientNetB7模型准确率为94.47%、Kappa值为91.51%、灵敏度平均值为93.63%、特异度平均值为97.34%、AUC平均值为95.47%。EfficientNetB7模型的网络深度比其他模型更深,能获取更多的图像信息,提取更多的特征,可以获得比其他模型更好的结果。

综上所述,本研究采用深度学习技术实现了翼状胬肉自动三分类,通过对在原始数据集和增强数据集上训练的14个模型测试,结果表明在增强数据集上训练的EfficientNetB7模型具有较高灵敏度、特异度和AUC,可用于翼状胬肉自动分类系统。该自动分类系统能较好地诊断翼状胬肉疾病,有望成为基层医疗的有效筛查工具,为基层地区解决患者多医疗资源少的问题提供一种方案,也为翼状胬肉的细化分级研究提供参考。