基于卷积神经网络的织物图像识别方法研究进展

郑雨婷,王成群,陈亮亮,吴 江,吕文涛

(1.浙江理工大学信息学院,杭州 310018;2.浙江经贸职业技术学院应用工程系,杭州 310018)

纤维、纱线通过一定的交叉、绕结或连结等方式构成稳定的关系形成了织物。在纺织工业生产中,织物不仅作为制作服装的基础材料,而且可作为其他装饰类和工业类的原材料进行再加工。随着织物图像数据库的不断扩大,如何从海量织物图像数据中提取、组织关键特征并快速精准得到有效信息,正成为纺织领域中倍受关注的问题。在生产过程中,疵点分类及检测、图像分类、图像分割技术分别在质量检测、工艺加工等环节起着至关重要的作用。采用人工处理的方法具有一定的主观性,工作环境、情绪状态和资历经验等因素均会影响技术的具体实施效果,同时还需考虑人力和时间成本等问题;而以浅层次结构为主的传统机器学习方法,存在无法自主学习特征的缺点。基于神经网络的图像识别技术不仅克服了人工检测主观性强和传统机器方法无法自主学习的难题,而且提高了生产效率降低了加工成本。卷积神经网络(Convolution neural network, CNN)一般由输入层、卷积层、激活函数、池化层、全连接层5部分组成,可借助标准数据集ImageNet[1]和纺织服装行业大量丰富的图像数据进行训练,具有处理精度高、适应性好、灵活性强等特点。随着神经网络的研究不断深入,图像识别技术的精度和速度得到了极大的提高。其成果一方面得益于数据集的扩大,另一方面来自算法和网络结构的优化。

1 基于卷积神经网络的织物疵点分类算法

目前,基于神经网络的织物疵点分类算法,主要包括以下几种:GG-Very-Deep-16 CNN(VGG16-Stochastic Gradient Descent[2]、VGG16-Visual Saliency[3]、VGG16-Double Low Rank[4]、Fisher Deep Convolutional Neural Network(FDCNN)[5-6]、LZFNet-V1[7]),GoogLeNet(Inception v1[8-10]、Inception v3[2, 11-12]),Deep Residual Network(ResNet-34[13-14]、ResNet-50[15])和其他CNN(CNN-Dense[16]、CNN-Adam[17]、CNN-PASS[18]、EfficientNet-B5[19]、CNN-Regularization[20])。卷积网络不同于传统机器学习方法的手动定义特征,它利用卷积层的局部连接和权值与池化层的平移不变性,达到自主学习特征提取的目的,最后一般利用全连接层实现分类。

1.1 VGG16

AlexNet模型采用了ReLu激活函数[1]、Dropout策略和Local Response Normalization(LRN)处理,缓解了网络的过拟合问题和梯度弥散问题并增加了网络的稀疏性,但面对复杂纹理结构需要获得更大的感受野增强特征提取效率,而且池化层会造成一些不必要的信息损失。VGG16采用连续的3×3卷积核代替AlexNet中的较大卷积核,卷积层由5层增加至13层,保证同等感知野的情况下增加了网络深度和非线性变换,但是出于计算时间的考虑未进行LRN处理。

为证明Batch Normalization(BN)层对坯布缺陷分类的有效性,晏琳[2]在VGG16的池化层和卷积层间增加批归一化层,而在原始AlexNet用批归一化层替代局部归一化层,分别使用Stochastic Gradient Descent(SGD)、momentum和Root Mean Square prop(RMSprop)3种梯度下降法进行实验。经比较,SGD作为优化算法的改进VGG16取得了最高的准确率,达到98.26%。在背景复杂的提花织物图像中,随着卷积层数的增加背景花纹容易被误检为疵点,李敏等[3]基于VGG16融合视觉显著性模型来抑制背景信息,在提花织物疵点数据集中测得平均准确率97.07%,比原网络提高了 19.44%,但无法区分疵点类别。江伴等[4]利用疵点图像显著性得分高的特点很好地实现了疵点和背景、噪声的分离,先是参考VGG16构建了浅层卷积网络得到图像的特征矩阵,接着采用双低秩表示模型实现疵点区域和背景区域的分离,最后利用阈值分割算法定位,准确率高达98.58%。Chollet[5]提出的Xception证明了利用深度可分离滤波器可超越Inception v3模型性能,深度可分离卷积可以保证较高分类准确率的前提下降低网络参数。因此,史甜甜[6]在VGG16的基础上结合深度可分离卷积提出FDCNN模型,并在Softmax分类器中加入Fisher准则约束以增加模型的泛化性,在TILDA和彩色格子数据集上分类准确率分别为98.14%、98.55%,并且网络参数量缩减为1.8 MB、计算量和运行时间大幅度降低,但还没有应用到自动监测系统中。为更有针对性地调整VGGNet结构以提高识别精度,Liu等[7]引入反卷积网络并对VGGNet进行深度特征可视化分析,优化体系结构构造了LZFNet-V1,精度不低于原网络的同时参数缩减了90%以上,适用于纺织品生产企业中计算资源受限条件下的轻量级织物缺陷识别系统。

1.2 GoogLeNet

VGGNet中的3个全连接层需要耗费一定的计算资源,GoogLeNet[8]将全连接层用全局平均池化来取代,虽然减少了过拟合情况的出现,但也导致了模型泛化能力的缺失。GoogLeNet提出了Inception模块,在卷积层后方衔接1×1的卷积核进行特征提取,并且采用多个模块组合构建整体模型,在增加网络宽度与深度的同时减少了模型参数。Inception v2用2个3×3的卷积核代替5×5的大卷积,紧接着Inception v3提出将一个较大的二维卷积拆分成两个较小的一维卷积,减少了参数量而且加速了运算。但随着网络的加深,不可避免会造成梯度消失等问题。

赵志勇等[9]用Inception-ResNet-v2在复杂背景和无规律纹理的布匹数据集中实验,疵点判决准确率达到了99%,其中Inception结构用于自动学习特征提取,而残差网络用来缓解网络加深带来的一系列问题。从输出的特征图谱可看出该网络实现了疵点和背景的隔离,但只能实现二分类且无法应用于嵌入式平台。王理顺等[10]去掉了GoogLeNet架构中的LRN层与Dropout层,在卷积层和Inception层后均添加一个BN层作归一化处理,在保证收敛速度和泛化能力的前提下,降低了模型的复杂度。在织物验布机实时高清图平均每张图的测试时间为0.37 ms,比GoogLeNet、ResNet-50分别减少了67%、93%,测试集上的分类准确率高达 99.99%,准确率与实时性均满足工业需求。相比于Inception v1结构,Inception v3[11]不仅用多个小卷积核替代大卷积减少了参数量,而且利用非对称卷积减少了计算量。晏琳[2]基于迁移学习的Inception v3训练迭代仅200次时,就能够在坯布缺陷数据集取得97.03%的分类准确率,大大降低了训练时间,且能被运用到传送带或验布机等对速率要求较高的环境中。曹振军等[12]参考Inception v3模块,添加Dropout层减少过拟合,在破洞、带纱、双纬纱和断头4类色织物疵点数据集训练的平均准确率达到了94%,并满足在嵌入式平台工业在线检测的要求。

1.3 ResNet

随着VGGNet、GoogLeNet深度的增加,网络可能会出现退化现象,ResNet使用了残差学习的结构避免了此等现象的发生。为研究迁移学习给残差网络带来的影响,罗俊丽等[13]比较了在不同大小的素色织物数据集中,迁移学习ResNet-34中不同层对应的疵点识别率。在较大的数据集中,由于预训练数据集ImageNet与织物数据集特征差别较大,而高层特征描述得较为抽象,故模型识别率随着迁移层数的增加而下降;在较小的数据集中,加载迁移层数2层以内,模型识别率有所提高,继续增加层数反而下降。实验表明,残差网络在较大数据集中识别率更高,当数据集较小时,可以通过迁移学习提升模型的识别率。由于使用阿里云天池大赛织物数据集中包括大量正常(无疵点)的织物图像,蔡鹏等[14]先采用重采样、垂直和水平方向上的翻转对有疵点图像进行数据增强,得到的训练样本再和缩小尺寸的原图分别输入到2个ResNet-34模型中训练后融合。对比得mean Average Precision(mAP)和AreaUnderRoc(AUC)的数值发现,训练集扩充、测试集数据增强和模型融合都有助于模型预测精度的提高。为提取到更细微的特征信息,罗维平等[15]基于ResNet-50应用迁移学习方法,并用3个3×3的堆叠卷积层替换7×7卷积层,降低了计算参数量,最后在残差模块1×1卷积核下采样前加入一层2×2的平均池化层整合空间信息。在企业提供的真实高清织物数据集中训练并测试,比标准模型速度提升了1倍,计算量减少10%,泛化能力相比于最深的残差网络ResNet152模型只差了0.63%。

1.4 其他CNN

崔春杰等[16]观察到平纹、斜纹和锻纹3类织物数据集中疵点具有明显的方向性,针对这3类织物设计了由卷积层、池化层、flatten层和dense层组成的卷积网络,在测试样本的平均准确率为98.6%,且具有较强的鲁棒性和泛化能力,但只能实现二分类。在平纹布这类简单背景的织物中,刘艳锋等[17]设计的卷积网络包含了连续三次的卷积、池化操作,并采用Adam作为梯度下降算法。该网络在检测准确率达到98%以上,均高于VGG16和LeNet,但检测速度基于两者之间,且无法判断疵点具体类别。针对数码印花PASS道等4类小目标缺陷,苏泽斌等[18]先对图像作预处理和几何变换的数据增强,增加了图像质量和数量,设计了一个包含2个卷积层、2个池化层和2个全连接层的CNN,分类准确率高于LeNet-5、AlexNet、VGG16以及GoogLeNet等网络模型。张敏等[19]使用ImageNet数据集上预训练的初始权重,采用迁移学习在小样本TILDA数据集上进行微调构建新的EfficientNet-B5模型,得到高达99%的分类准确率。孙羽等[20]在卷积核上引入多层感知机加深局部感受野深度,进一步增强特征表示能力;为防止网络深度的增加造成过拟合,在前向传播的softmax损失函数中使用L2正则化,加快收敛速度、提高检出率。在线阵CCD相机收集的布匹数据集中训练,测试识别率高达98.9%,要优于未改进的传统CNN方法以及传统检测算法。

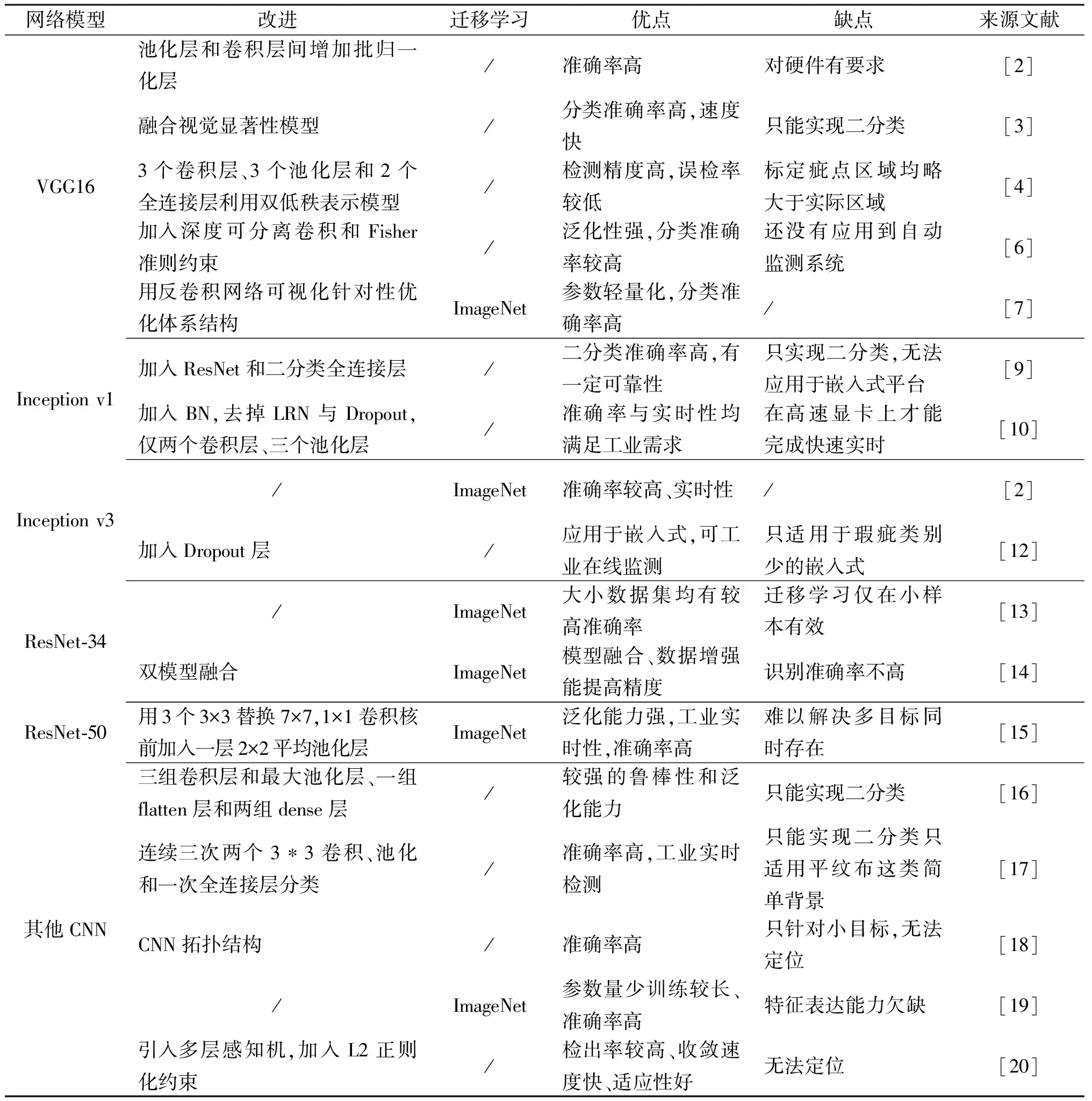

综上,神经网络技术在织物疵点分类中起着重要的作用,不仅能自主学习织物疵点图像的特征取得较高的分类精度,也能通过优化网络结构满足工业实时性分类的要求。各网络分类算法分析见表1。

表1 基于卷积神经网络的疵点分类算法优缺点分析

2 基于卷积神经网络的瑕疵检测算法

织物瑕疵检测是纺织品质检过程中的重要环节,高检测精度和实时工业监测是织物瑕疵检测领域的主要挑战,瑕疵检测结果如图 1所示。基于卷积神经网络的织物瑕疵检测算法主要分为两种:一种是基于候选区域的算法,分开实现候选区域的产生和分类与回归(两步法),例如Faster Region Convolution Neural Network(Faster RCNN-Generative Adversarial Networks[21]、Faster RCNN-Soft Non Maximum Suppression[22]、Faster RCNN-ResNet-101[23-25])、Region-based Fully Convolutional Networks(R-FCN)[26];另一种是仅使用一个卷积网络就对目标直接定位与分类(一步法),例如You Only Look Once(Tiny-YOLOv3[27-28]、YOLOv3[29]、LW-YOLO[30])、Single Shot MultiBox Detector(MobileNet(V3)-SSD[28]、MobileNet Feature Fusion-SSD(MF-SSD)[31]、Deconvolutional Single Shot Detector(DSSD)[32]、Multi-scale Fusion Deconvolutional Single Shot Detector(MFDSSD)[33])。

图1 瑕疵检测示意

2.1 两步法

RCNN利用候选区域与CNN结合做目标定位,接着Fast RCNN的提出实现了目标分类与检测框回归的统一。Faster RCNN则利用Region Proposal Network(RPN)采用自主学习的方式生成区域候选框,再与Fast RCNN检测网络共享卷积层,并且利用非极大值抑制算法减少候选框的冗余,比传统滑动窗口获得目标候选框精度和速度都更高。

2.1.1 Faster RCNN

李明等[21]在Faster RCNN的基础上利用Generative Adversarial Networks(GAN)对织物瑕疵图像集进行扩充,缓解了瑕疵样本有限和类别分布不均的问题。先后在3个织物缺陷数据集中实验,在保持效率不变的同时mAP分别提高了 4.32%、3.88%、3.46%,最终准确率分别为 93.68%、92.45%、93.7%。由于Non Maximum Suppression(NMS)算法会误删位置相近的小瑕疵产生的检测框,安萌等[22]在Faster RCNN的基础上用Soft-NMS算法替代该算法,同时在Softmax函数中加入L2范数约束提高了分类准确率。在天池布匹瑕疵数据集中准确率高达94.67%,相比原模型提高了5.09%,但主要研究纹理较为简单的数据集,并未对复杂纹理特征深入研究。为提升多尺度瑕疵和小目标瑕疵的检测能力,陈康等[23]采用了Faster RCNN与ResNet-101相结合的方法,增加锚点框的种类至16种,用全局平均池化层替代原网络前两个全连接层,不仅减少参数数量加快了网络运算,而且还减轻了过拟合的发生。虽然使用残差网络牺牲了部分检测时间,但在纯色布匹瑕疵数据集的平均准确率高达 95.63%,显著超越了人工检测精度。晏琳等[24]同样以ResNet-101作为Faster RCNN的特征提取网络,在ImageNet数据集和坯布缺陷数据集多次合理参数优化后,最终检测准确率高达99.6%,但不适用于对检测速度有要求的生产线。Zhou等[25]将Feature Pyramid Network(FPN)和Distance Intersection Over Union(DIOU)损失函数技术融入Faster RCNN中,用Region of Interest Pooling(ROI Pooling)替代Region of Interest Align(ROI Align),搭建出由ResNet-101作为Backbone的FabricNet模型。在DAGM2007数据集上达到62.07%的mAP和 97.37% 的AP50,平均预测速度为每秒16帧。

2.1.2 R-FCN

基于ResNet-101的Faster RCNN只共享了前91层的卷积层,存在平移不变性和位置敏感性的矛盾,极大地限制了算法的训练和计算速度。R-FCN 是基于此用卷积层替代全连接层,并在ROI pooling前引入位置敏感得分图,合并了大量独立运算。廖如天[26]基于R-FCN,并将Soft-NMS算法引入到R-FCN的样本后处理,提出了全局信息融合的R-FCN模型。为减少特征提取网络的浮点数运算,将ResNet-101替换为ResNet-50,同时去除Conv5层的一次降采样,并引入空洞卷积替代普通卷积弥补感受野减小问题,使用多尺度交替训练和在线难示例挖掘保证网络得到更加充分的训练。应用于圆织机织物瑕疵检测的实验表明,空洞卷积可以在尺寸为640×96的条带上提升5.4%的平均查全率,且不会加入额外的计算开销。提出的快速R-FCN有与R-FCN相当的查全率和与YOLOv2较为接近的检测速度,鲁棒性强,不受光照等外界条件影响,但只能对静态单帧图像进行检测。

2.2 一步法

Faster RCNN虽然准确率较高,但在速度方面稍有劣势。单阶段的检测算法虽然准确率稍低,但是在速度方面更有优势。针对YOLO可以从两个方向加以改进,一个是在降速不多的前提下提高模型的检测精度,另一个则是在不损失精度的情况下继续提高检测速度。

2.2.1 YOLO

YOLOv3[27]借鉴FPN的思想提取3个不同尺度的特征分别做预测,Tiny-YOLOv3在此基础上修改部分主干网络并去掉一个独立预测分支。彭亚楠等[28]提出了基于Tiny-YOLOv3改进的织物瑕疵检测算法IMP-Tiny-YOLOv3,在原主干网络的基础上增加3个卷积层,同时引入1×1卷积核来降低模型计算复杂度。该网络在广东智能制造良品检测数据集实验得到的mAP和recall较原网络模型分别提升了3.1%和2.7%,也满足工业实时性的要求,但对小型织物瑕疵检测仍有不足。

由于检测出尺度小的瑕疵需要高清晰度图片输入,这会导致检测速度降低,谢景洋等[29]分别选取轻量化的MobileNets和更细粒度多尺度特征的Res2Net代替Darknet53作为YOLOv3算法的主干网络,模型在COCO数据集上预训练后迁移到阿里云天池数据大赛布匹瑕疵数据集微调后测试, 并采用Grad-CAM对主干网络特征提取能力可视化。结果发现MobileNets在保持检测精度的同时速度提高了30%,并且能更专注提取缺陷的特征,而Res2Net虽然残差连接了多尺度特征但是在布匹瑕疵检测中没有明显优势。YOLOv3对小目标检测能力较强,崔健[30]参考此网络并采用连续的3×3和1×1卷积层搭建出一个轻量型卷积神经网络框架LW-YOLO,在TILDA织物图像库整体检测准确率达到97.7%,将检测速度提高了2.6倍,模型参数减小了30倍。在此基础上加入深度可分离卷积和可分离自适应再校准块(Separated Adjusting Region,SAR),即在深度卷积与点卷积之间添加了sigmoid激活函数,此SAR-DefectNet织物缺陷检测算法降低了计算复杂度,提高了网络特征提取的能力,在基本保持与DefectNet模型检测速度和模型大小相差不大的同时,检测准确率提升了1.3%。

2.2.2 SSD

SSD在Faster RCNN的锚框机制和FPN结构上,为不同尺度的特征图构造不同大小的先验框。不同于YOLO在全连接层进行分类回归,SSD直接利用卷积层对多个不同尺度的特征图进行检测,在保证良好的实时性的同时具有较好的检测准确率。

彭亚楠[28]选用SSD作为基础网络结构,出于实时性考虑利用轻量级网络MobileNetV3-small代替VGG16做特征提取,保留一定的检测精度也缩减了网络模型的参数量。该研究结果表明,VGG-SSD对小目标的检测效果最佳但检测速度最慢,MobileNet(V3)-SSD对中小型目标的检测精度比IMP-Tiny-YOLOv3更高,mAP-75值比MobileNet(V2)-SSD提高了2.6%。黄汉林等[31]提出了改进的MF-SSD,基于Mobile-SSD引入深度可分离卷积,同时在主干网络后面增加8个3×3的卷积层。由于SSD存在深层网络丢失语义信息而造成小目标漏检的问题,使用双线性插值对特征图进行上采样并利用Concat相加融合各尺度的特征信息。MF-SSD相比于MobileNet-SSD牺牲了检测速度,但增加了检测精度,单张图片检测速度从27ms增加到30ms,但模型mAP从84.1%增加到了90.1%,速度也在工业检测要求范围内。由于SSD模型中浅层网络和高层特征信息的结合没有被充分地利用,影响小目标缺陷的定位检测;DSSD模型[32]将反卷积应用到SSD顶层网络,实现了低层和高层上下相连的语义融合,牺牲部分检测速度但提高了小目标检测精度,无法满足工业实时性需求。赵亚男等[33]提出了基于SSD和DSSD网络结构的MFDSSD模型,利用3个用卷积融合模块的跳跃网络增强了小目标上下文信息并弥补了浅层网络的感受野。在TILDA数据库中检测速度可达51 fps,检测精度超越了原有网络结构,改善了SSD的小目标漏检问题,但未在彩色复杂图案实验。基于卷积神经网络的瑕疵检测算法优缺点分析见表2。

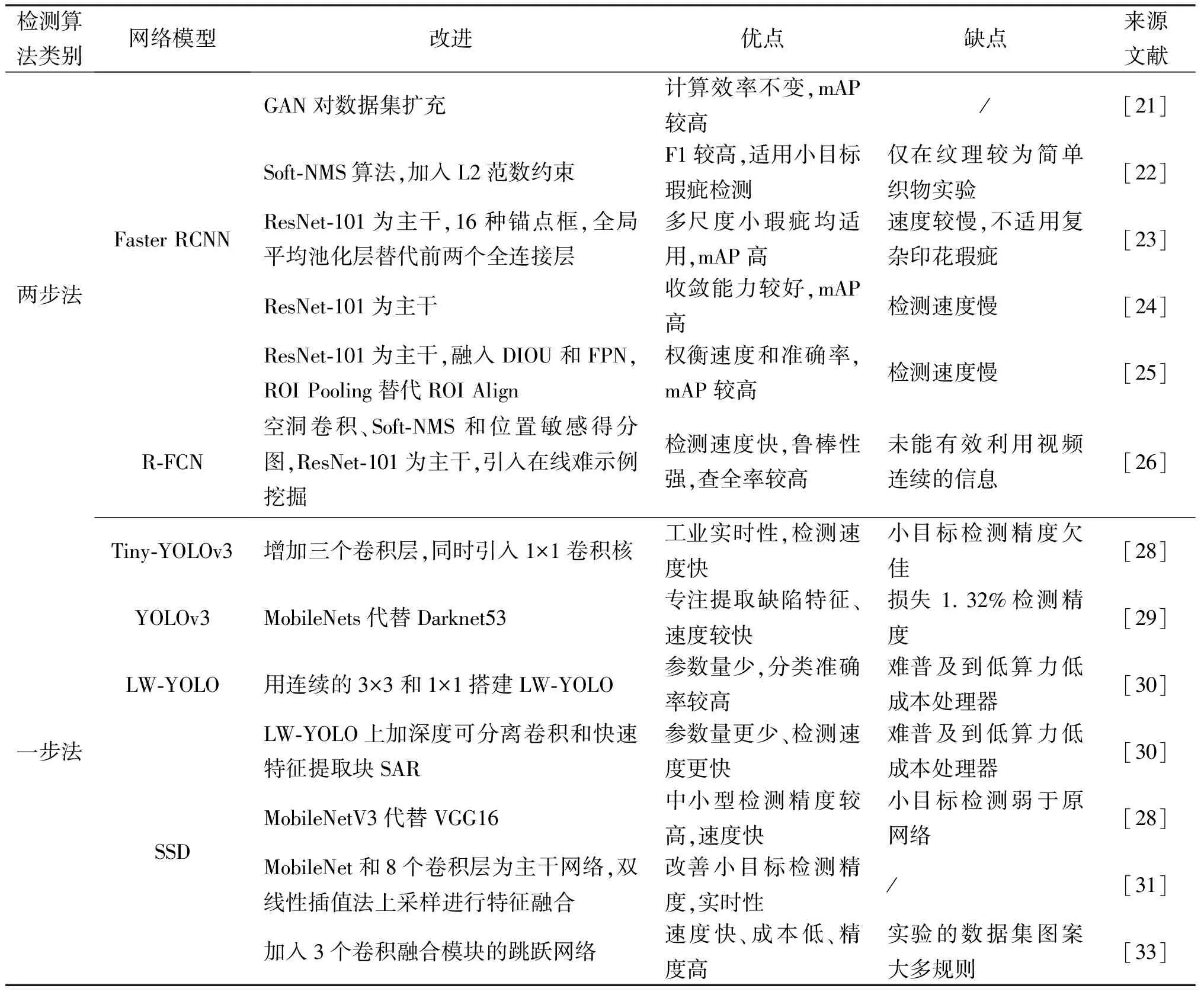

表2 瑕疵检测的卷积神经网络优缺点分析

3 基于卷积神经网络算法的其他图像识别技术

3.1 基于卷积神经网络算法的织物图像分类技术

不同于疵点分类,纹理结构、纤维特征等信息是纺织领域中图像分类的主要依据。邓宇平等[34]分别设计了基于迁移学习的改进GoogLeNet和非迁移学习的残差网络的织物纹理分析模型,前者借助了非对称卷积和1×1的网络结构减少了计算量,并用平均池化代替最大池化保留更多的纹理信息,同时新增两个softmax辅助分类器避免梯度消失。两者在带有小范围瑕疵干扰的织物数据集中训练测试,均达到了预期纹理分类准确率98%以上的要求,但没有针对大范围瑕疵进行实验。对比发现小样本中迁移学习的收敛速度和泛化性能优于非迁移学习的残差网络性能,但随着类型、类型图片总数以及网络层数的逐渐增加,GoogLeNet可能会出现梯度爆炸和梯度消失的问题,残差网络的优势才会慢慢体现出来。MobileNets[35]基于一种流线型架构,使用深度可分离卷积构建轻量级深层神经网络。张玮等[36]参考MobileNet,综合使用空洞卷积和深度可分离卷积模块,减少了模型参数量同时增大了卷积视野,相比于原轻量化网络MobileNet参数量减少了34.38%,对5类织物面料主成分分类的准确率最高为96.53%。利用Grad-CAM算法可视化分析发现,织物图像分类主要依据的是面料纤维特征而不是纹理信息。彭涛等[37]在不考虑织物表面颜色、纹理和光照等信息情况下,基于图卷积网络结合视频多帧时序信息及织物运动特征,给出一种用图来描述织物运动的新方法,突破了传统分类方法只能对少数织物进行分类的限制。在麻省理工学院的公开织物数据集中的实验结果表明,该模型对比Yang等[38]提出的CNN和Long Short Term Memory(LSTM)模型,准确率从66.7%提高到 84.45%,但需要自己制作数据集训练。

3.2 基于卷积神经网络算法的织物图像分割技术

Ronneberger等[39]提出了结构形如字母“U”的U-Net模型结构,在生物医学应用中仅需少量的带注释的图像,就能实现比较好的性能。汪坤等[40]用去掉全连接层后的VGG16代替U-Net的左侧下采样部分并加入空洞卷积,加深模型结构的同时提高卷积核感受野,以便更精确地提取织物印花的特征。在数据增强后的1000张织物图像数据集,改进的U-Net分割模型将分割准确率从88.67%提高到了98.33%。阿力木·安外尔等[41]首先对图像进行伽马校正增强折皱与背景对比度,然后利用不同采样率的空洞卷积有效获取上下文信息,并采用双线性插值法上采样,最终在模拟织物折皱数据库的训练集和验证集上分割准确率均达到95%以上。

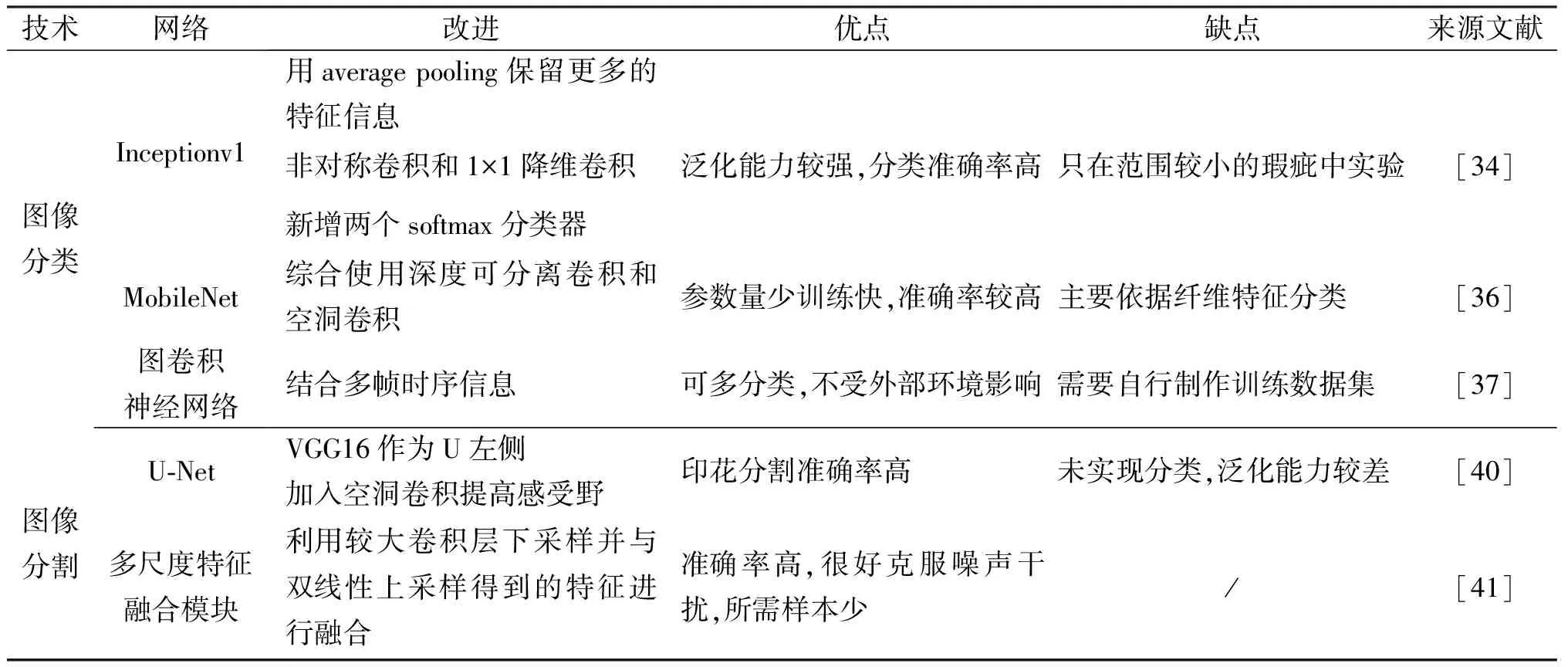

综上,卷积神经网络运用到图像分类和图像分割中都能得到较高的准确率。本文列举了依据织物纹理、面料纤维和运动特征3种信息的图像分类方法,针对不同的分类依据需要搭建不同需求的网络。图像分割比较注重不同尺度信息和上下文信息的特征融合,可借助可视化工具证明网络的可靠性。其他图像识别技术分析见表3。

表3 基于卷积神经网络的图像分类和分割技术优缺点分析

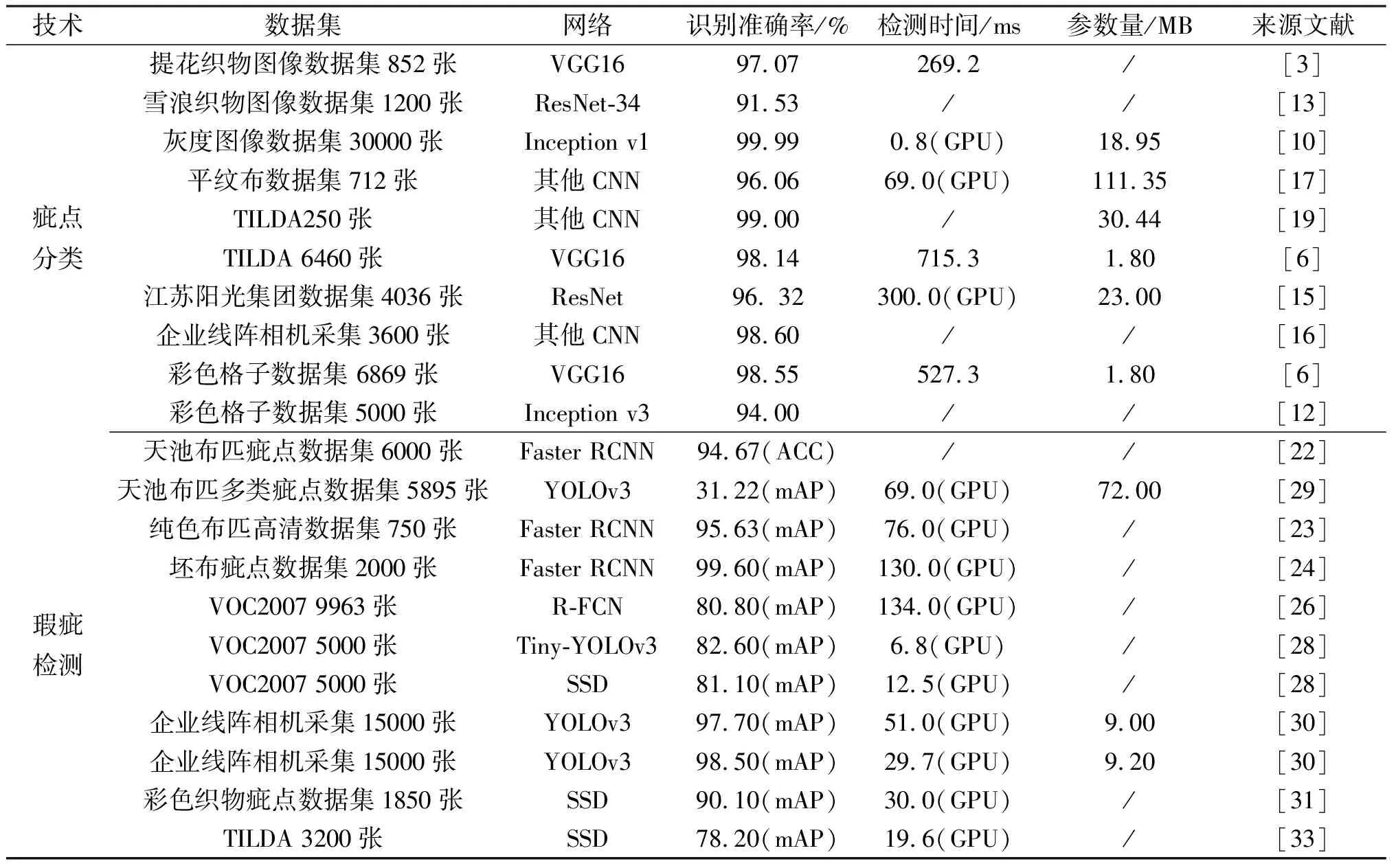

4 实验结果对比

基于上述文献,本文选取基于卷积神经网络的疵点分类和瑕疵检测技术中部分文献的实验结果进行对比,详见表4。基于卷积神经网络的疵点分类技术在各类数据集中得到的准确率均在90%以上,仅个别低于95%,主要原因有两点:一个是网络深度较浅、模型复杂度不够,另一个是数据集中的部分疵点特征不明显导致总体分类效果不佳。

表4 基于卷积神经网络的疵点处理技术实验结果对比

基于卷积神经网络的瑕疵检测技术在实验中大多利用GPU的并行处理能力加速计算,其检测精度大多超过80%。其中,文献[29]中所实验的数据集缺陷类别多而杂,存在一定的检测难度,故mAP较低。文献[30]参考YOLOv3将网络结构轻量化,并保持较高的检测精度,但也需要一定的硬件设备条件。总体上看,一步法中的YOLO的检测速度快于两步法中的RCNN。由于图像分类和分割技术所实验的数据集各不相同,较难从同一维度进行公平性评价。

5 结论与展望

本文介绍了面向纺织领域基于卷积神经网络的图像识别技术,根据网络进行分类并分析了其改进点及优缺点,得出以下结论:

a)深层网络的疵点分类方法会使背景与疵点不易分开,可利用瑕疵的特性结合视觉显著性模型和双低秩表示模型实现分离,但大部分只在二分类时速度较快。随着网络层数的增加,参数量与计算量也会相对应增加,一般无法应用于嵌入式平台,部分满足工业实时性检测但需要一定的硬件支持。

b)基于候选区域的疵点检测算法检测精度高,但速度较慢大部分仅适用于简单背景织物中,一般增加锚框种类提高多尺度疵点的检测精度。基于回归学习的疵点检测算法满足工业实时在线监测,普及到低算力低成本的处理器还需进一步优化网络结构,还需通过多尺度特征融合提高中小疵点的检测精度。

c)基于卷积神经网络的图像识别方法,注重对图像特征提取的过程,空洞卷积被用来扩大感受野和增加上下文语义信息。过多的池化层和降采样操作虽然能够采集到更多的语义信息,却会丢失一定的细节特征造成小疵点的精度损失。

d)网络的搭建需要借助可视化工具,根据具体分类依据具体问题具体分析。由于纺织工业追求量产量检,模型达到一定的检测精度后也需满足嵌入式平台的参数量和计算量要求。

根据本文对基于卷积神经网络的织物图像识别算法的整理、分类和分析,面向纺织领域的图像识别技术可在以下几个方面继续研究发展:

a)在疵点分类和检测中,织物图像库虽然具有一定的数据量,但存在疵点样本数少、小疵点数量多、疵点尺寸变化大的问题。可将Focal Loss和Gradient Harmonizing Mechanism函数用来解决背景样本和前景样本不平衡问题,结合Cascaded R-CNN提高对密集小目标的检测精度是未来重要的发展方向。

b)卷积倾向于捕获局部信息,可考虑注意力模块引入上下文信息提取有效特征。结合反卷积结构多尺度融合不同分辨率和较强语义强度的特征,同时采集丰富的上下文信息也是可深入研究方向之一。

c)繁多的织物色彩样式和相似复杂的织物背景导致较高的类内差异度与类间相似度,可通过在目标函数加入正则化约束或dropout策略减缓该问题的发生。在实际生产和加工过程中,采集到的织物图像容易带有光照等外界噪声,这与理想状态下的图像特征存在一定的差异,故利用残差模块和滤波技术消除环境噪声具有较大意义。

d)利用Grad-CAM对网络各阶段特征图进行可视化,通过结果分析寻找合适的网络结构。采用剪枝或量化等手段使网络结构轻量化,最后运用到嵌入式平台和工业实时监测系统中,这在纺织工业上也愈来愈迫切。