基于视频图像的面部表情识别研究综述

梅英, 谭冠政, 刘振焘

基于视频图像的面部表情识别研究综述

梅英1, 2, 谭冠政2, 刘振焘3

(1. 湖南文理学院 电气与信息工程学院, 湖南 常德, 415000; 2. 中南大学 信息科学与工程学院, 湖南 长沙, 410083; 3. 中国地质大学 自动化学院, 湖北 武汉, 430074)

面部表情识别是机器理解人类情感的前提, 是改善人机交互关系的关键。首先, 按照视频图像中面部表情识别的流程, 综述了表情识别的 3个阶段: 人脸检测、表情特征提取、表情分类。重点介绍了表情特征提取和表情分类中所采用算法的原理、优缺点及应用场合, 并给出了部分算法的识别率对比结果。其次, 对人机交互中的微表情识别及表情识别的鲁棒性研究也做了介绍。最后总结了面部表情识别研究中存在的问题及难点, 探讨了该领域值得进一步研究的问题。

表情识别; 特征提取; 表情分类; 微表情; 鲁棒性

随着机器视觉研究的不断深入, 面部表情识别从静态图像中的表情识别逐步转向了动态图像中的表情识别; 从基本表情识别逐步转向了自然场景下复杂表情的识别。本文综述了近几年针对视频图像序列的表情识别研究成果, 重点介绍了表情特征提取、表情分类中所用主流算法的基本原理、优缺点及应用场合。对当今流行的微表情识别和表情识别的鲁棒性研究也做了介绍, 最后指出了当前表情识别研究存在的问题, 并总结了进一步的研究方向。

1 面部表情识别

针对视频图像的表情识别技术基础包括多媒体视频技术、图像处理技术、模式识别技术等。视频图像中面部表情识别一般包含3个主要步骤:首先判断视频中是否存在人脸, 如果存在,则定位出人脸, 然后提取表情特征, 最后确定表情特征所属的分类[3]。面部表情识别流程见图1。

图1 面部表情识别流程

1.1人脸检测

人脸检测是指在图像中定位出人脸, 人脸检测是进一步分析和理解面部表情和行为的基础。为了减少外部影响, 还增加了图像预处理环节。现有的人脸检测方法可以分为基于特征和基于图像2大类[4]。基于肤色特征的方法是将输入图像经过预处理后, 在多个色彩空间中利用肤色特征比对后即可得到肤色的区域, 从而实现人脸区域的精确定位。该方法的优点是处理速度快, 但当背景中存在与肤色相近的景物时, 可能会产生误判的结果[5]; 基于图像的方法[6]首先选取面部样本与非面部样本, 通过训练生成分类器进行面部与非面部的区分, 实现面部检测。目前, 人脸检测技术已经成熟, 在智能手机、电子考勤上应用广泛。

1.2表情特征提取

面部表情特征提取是从检测出的人脸图像中提取有效的表情特征信息, 特征提取的有效程度直接关系到表情分类的准确程度, 因此, 表情特征提取是表情识别中至关重要的一步。目前, 基于视频图像的特征提取方法有光流法、主动外观模型法(Active Appearance Model, AAM)及差分图像法等。

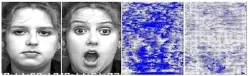

(1) 光流法。光流法是目前运动图像分析的重要方法之一。光流是运动物体在观测成像平面上的像素运动的“瞬时速度”, 根据光流可以衡量2帧图像之间的变化。表情变化是一个面部肌肉运动的过程,通过计算视频图像中嘴巴、眼睛、眉毛等表情特征点上的光流, 然后根据特征区域的运动方向变化, 计算出对应的表情[7]。文献[8]采用光流法与差分图像法相结合的方法, 首先计算出差分图像绝对值并检测出运动区域, 再在已确定的运动区域内计算光流场, 最后计算出面部表情对应的运动信息, 图2所示的是吃惊表情序列光流场。文献[9]提出了采用直方图和光流法提取面部表情的时空信息, 在CK+数据集上的实验效果良好。

图2 “吃惊”表情序列光流场

光流法具有突出面部形变和反映面部运动趋势的优点, 但是, 该算法成立的前提是灰度守恒假设和光流场平滑性假设。当动态图像不满足上述条件时, 光流法的效果就会受到很大影响, 在光源有变化或面部有遮挡时, 会导致光流计算不准确而影响识别率。而且, 光流法计算量较大不利于实时处理, 所以一般采用与其它方法相结合的方法。

(2) 主动外观模型法。主动外观模型法是在主动形状模型(Active Shape Model, 简称ASM)的基础上引入纹理模型发展而来的。因此, 基于AAM的方法不但能精确地描述人脸轮廓特征还能描述人脸的纹理特征[10]。近年来, AAM 广泛应用于模式识别领域的特征点提取方法。文献[11]采用主动外观模型(AAM) 定位图像序列中各幅人脸图像的 68个特征点, 然后计算图像序列中表情帧和中性帧的表情关键点的坐标差, 从而提取出表情特征, 图3是AAM特征提取结果。文献[12]利用主动形状模型对人脸图像进行特征点检测, 然后将图像比例特征与面部动画参数作为支持向量机的输入, 最后获得理想的识别效果。文献[13]提出了基于 AAM提取面部区域特征的方法, 通过支持向量机分类, 实验结果证明了该方法可以适应多种头部姿势和光照条件下的表情识别。

图3 AAM特征提取结果

AAM 方法将面部形状和纹理等信息进行统计建模, 可以很好地匹配不同形状、大小的人脸, 通用性强。但是, 在一般情况下, 基于模型的方法需要依靠人工标注的方式实现面部特征点的初始化, 从而在一定程度上影响了算法的自动化程度。

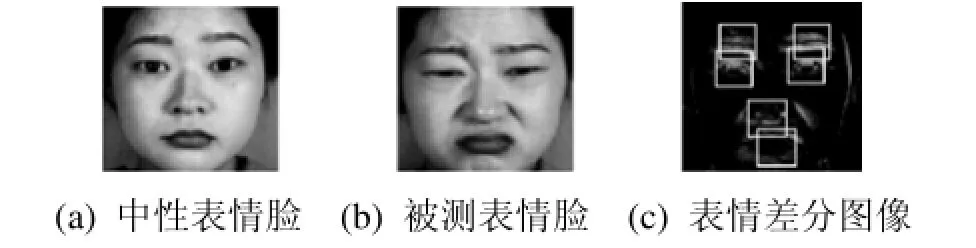

(3) 差分图像法。差分图像法是将图像序列中的被测帧与标准帧做差分运算, 保留2帧间存在变化的特征。在进行表情识别时, 在相同背景条件下, 将表情帧和中性表情帧进行差分运算, 最后得到反映表情特征的关键帧, 通过分析关键帧就可以识别人脸表情。图4是JAFFE库中人脸图像及对应的差分图像[14]。文献[15]提出了一种基于差分的AAM模型, 即差分主动外观模型, 用来识别一组动态的人脸面部表情序列。首先, 通过输入人脸表情图像和中性表情图像参数的差分来计算差分主动表观模型, 然后运用流形学习对差分主动外观模型进行平滑图像以及降维, 最终实验表明基于差分主动外观模型在表情识别率上比传统AAM模型提高了20%。

图4 人脸表情图像及其差分图像

差分图像法能够大幅度地减少计算量, 但需要作差的2帧图像必须保证像素点严格对应, 否则不能反应真实的表情变化。

1.3表情分类

表情分类即判断表情特征所对应的表情类别。现有 2种分类方式: 一种是按照面部动作分类[16](Facial Action Coding System, FACS), 即将面部表情动作分类到44个动作单元AU(Action Units), 每种表情对应几个动作单元的组合; 另一种分类是按照美国著名心理学家Ekman[17]划分的6种基本表情(恐惧、悲伤、愤怒、高兴、惊讶和厌恶)来分类。近年来, 人工神经网络、Adaboost算法、支持向量机、隐马尔可夫模、K近邻分类器等成为主流的表情分类方法。

(1) 人工神经网络分类。由于面部表情的变化规律难以显性描述, 但能通过人工神经网络的自学习功能, 可以隐性表达表情的规律。因此, 将提取的表情特征通过人工神经网络分类是目前有效地使用方法[18-19]。文献[20]采用前馈神经网络作为表情分类器, 实验效果表明, 前馈神经网络比采用传统神经网络的识别效果好。文献[21]将所选是Gabor特征送入一个三层神经网络中, 通过反向传播算法训练分类器, 实验结果表明: 在JAFFE和Yale数据库平均识别率分别为96.8%和92.2%。

人工神经网络具有较强的自学习、自组织能力, 但是, 当输入样本维数过高或训练样本过多时, 会导致算法收敛缓慢而出现过学习问题[22]。

(2) Adaboost算法分类。Adaboost算法的核心思想是针对同一个训练集训练不同的分类器(弱分类器), 然后把这些弱分类器集合起来组成一个分类能力更强的强分类器[23]。Ghimire等[24]采用多级Adaboost和支持向量机相结合的方法将表情的几何特征分类, 实验结果表明, 在CK+面部表情数据库中的识别率为95.17%。Owusu[25]采用Adaboost算法与SVM相结合的方法, 形成分类器进行训练,利用JAFFE和耶鲁大学的Yale数据库分别测试, 结果表明平均识别率分别为97.57%和92.33%, 执行时间也明显缩短。图5是采用Adaboost分类器的表情识别结果。

图5 表情识别结果

Adaboost 算法中权值的确定可以根据弱学习器预测的正确率来设定, 从而避免人工神经网络中容易出现的过学习现象, 但在小样本情况下, Adaboost方法的性能并不好。

(3) 支持向量机分类。支持向量机(Support Vector Machines, SVM)在解决小样本、非线性及高维模式识别中表现出许多特有的优势。支持向量机方法是建立在统计学习理论和结构风险最小原理基础上的, 根据有限的样本信息在模型的复杂性和学习能力之间寻求最佳匹配, 以求获得最好的推广能力。使用SVM的关键在于核函数的选择, 只要选用适当的核函数, 就可以得到高维空间的分类函数。文献[26]提出了一种基于SVM模型的方法用于表情识别, 通过与Adboost方法比较, 证明SVM模型具有较高的识别率。文献[27]使用主动形状模型与 SVM相结合的方法进行表情识别, 取得较好的识别结果, 可以适应头部偏转和光照不均条件下的表情识别。

SVM的优点是算法具有坚实的理论基础, 尤其适合小样本数据的分类。但经典的SVM算法是二类分类算法, 在解决多分类和大规模样本运算上, SVM 算法需要结合其它算法来解决问题。

(4) 隐马尔可夫模型分类。隐马尔可夫模型(Hiding Markov Model, HMM)是一种统计分析模型, 用于描述随机过程信号统计特性, HMM具有很强的动态时间序列建模能力, 因此可用于针对视频图像序列的表情识别。文献[28]采用HMM模型与K近邻相结合的方法组成分类器, 实现了针对6种基本表情的识别。

(5) 稀疏表示分类法。稀疏采样(Sparse Sampling)是一个新的采样理论, 它的原理是采用随机采样的方法获取信号中的离散样本, 最后采用非线性重建算法来恢复信号的原样。文献[29]提出了一种基于稀疏表示的遮挡人脸表情识别方法, 通过稀疏分解求得待测图像的稀疏表示系数实现表情识别, 在Cohn-Kanade 和JAFFE 人脸库上的实验表明稀疏分类法具有较强的鲁棒性。

近些年来, 一些新的分类算法不断提出,如深度学习[30]、随机森林[31]等, 表1列出了部分算法的识别结果。

从表 1可以看出, 针对动态视频图像的面部表情识别率有待提高, 且每种算法都是在特定约束条件下, 针对基本表情识别提出的解决方法。在人机交互过程中, 人的表情变化是极其微妙的, 背景也相对复杂。因此,对于微表情和表情识别的鲁棒性研究, 还有待进一步深入。

表1 部分算法的表情识别结果对比

2 微表情及表情的鲁棒性识别

2.1微表情识别

微表情是指持续时间仅为 1/25~1/5 s的快速的表情, 表达了人们试图压抑或隐藏的真正情感, 因此, 心理学家Ekman发现50%的人在撒谎时会出现微表情, 于是Ekman认为微表情可以用于测谎[35]。文献[36]指出微表情应用于职务犯罪侦查具有识别犯罪嫌疑人真实情绪从而扩大案件线索的作用, 在职务犯罪侦查中具有可操作性。文献[37]提出了基于差分切片能量图和 Gabor变换的微表情识别算法,通过Gabor变换和线性判别分析提取差分切片能量图向量判别特征, 并运用SVM分类器实现微表情识别, 实验表明该方法具有较高的识别性能。文献[38]使用极限学习机实现微表情自动识别, 在ORL、Yale和CASME 微表情数据库中的实验取得了一定的效果。

微表情不仅持续时间短而且出现频率低, 对于微表情的自动识别难度很大, 目前研究尚不成熟。但微表情识别可以作为一种有效的侦查辅助手段在刑侦中发挥重要作用。因此, 微表情识别研究具有实用价值。

2.2表情的鲁棒性识别

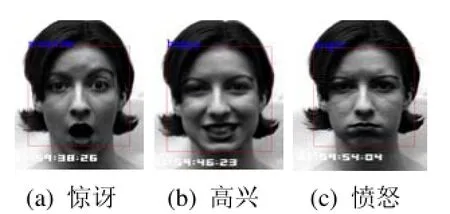

在人机交互过程中, 局部遮挡、光照不均、头部偏转的情况时有发生, 如图6所示。为了解决局部遮挡的问题, 文献[39]提出了一种基于流形学习的遮挡人脸表情识别方法;为了解决光照和头部偏转的问题, 文献[40]通过AAM和K近邻算法, 实现了面部表情的鲁棒性识别。

图6 自然交互场景中的人脸

为了能更好地解决光照不均、遮挡等问题。近些年三维人脸表情识别逐步兴起。面部三维信息比二维图像具有更多的人脸信息, 以人脸表情的三维数据为载体, 最大程度地利用面部几何特征, 文献[41]使用面部等高曲线的方法, 在BU-4DFE数据库上的识别率为92.2%。但是, 目前三维人脸表情识别技术的研究致力于识别率的提高, 在特征提取上过多依赖特征点, 计算量较大, 难以满足实时性要求。

3 表情识别存在的问题及难点

3.1存在的问题

(1) 缺乏真实表情研究。近些年的表情识别研究主要针对基本表情识别, 尽管取得了一定的识别效果, 但需要实验对象呈现夸张的脸部表情, 因而很难将它应用到真实的表情交互系统中去, 且在识别率和实时性上不够理想。

(2) 研究场景局限于实验室。尽管一些文献中的表情识别率较高, 但大多都是基于实验室理想条件下测试的。在自然真实环境下, 由于光照、姿势、遮挡等对面部表情识别有较大影响, 如何在复杂环境下进行面部表情识别是当前研究的一个关键问题。

(3) 面部表情数据不足。目前已有的面部表情数据库(如:JAFFE, CK+, Yale)一般都比较小, 而且带有主观性质, 表情流露不自然, 难以为科学研究提供十分精确有效的数据, 且动态序列图像数据库更是缺乏。

3.2表情识别的难点

(1) 表情的模糊性。人类表情本身具有模糊性, 并不是每种表情之间都有很明显的区别, 如: 睁大眼睛有可能代表惊奇, 也有可能代表恐惧等。而且, 同种表情由于民族、年龄、性别等因素也会存在表达上的差异。

(2) 人脸的非刚性。人脸受年龄、性别、种族等因素的影响, 表现出明显的个体差异, 导致人脸很难用统一的模型来描述, 因而增加了识别难度。

(3) 表情识别的学科交叉性。表情识别研究涉及多门学科, 如: 模式识别、机器学习、心理学等, 有些学科本身在理论和方法上有待完善。

4 表情识别的研究方向

(1) 寻求新的理论和研究思路。结合机器学习理论, 根据表情的图像特征和几何特征之间的相关性,有效融合表情的全局和局部信息[42], 或结合语音、行为等因素进行多模态情感识别[43], 将有利于提高表情识别效果。同时, 应借鉴心理学、神经科学的研究成果, 多方面寻找新的研究思路。

(2) 加强三维面部表情识别。相对于二维信息而言, 面部三维信息能包含更多的人脸信息, 结合三维信息能很好地解决光照不均、遮挡等问题[44]。然而, 采用三维数据会随着运算量的增大导致系统实时性不足的问题, 如何提取更有效的三维特征来提高表情的识别率与实时性, 是一个值得深入思考的问题。

(3) 建立完善的表情数据库。表情数据库是表情识别的基础, 目前缺乏标准化的大型数据库, 无法比较各种算法之间的优劣。所以, 建立以自然场景为背景的、标准的、公开的动态表情数据库是一项非常迫切的研究工作。

5 结束语

面部表情作为主要的信息载体将成为下一代人机交互模式的重要组成部分, 面部表情识别将在服务机器人、教育、娱乐、智能家居等领域具有广阔的应用前景。目前, 面部表情识别技术在理论方法和实用技术上得到了迅速发展, 并在服务机器人、智能手机上得到了初步应用, 但在识别率、实时性及鲁棒性等方面尚不够理想。加强真实环境下自然表情的识别有利于改善人机交互模式, 让计算机能够真正了解人类的意图从而更好地服务人类, 同时也有助于人工智能的发展。因此, 面部表情识别研究具有重要的理论意义与实际应用价值。

[1] Picard R W. Affective computing [M]. USA: MIT Press, 1997: 2–10.

[2] Mehrabian A. Communication without words [J]. Psychology Today, 1968, 2(4): 53–56.

[3] Fang H, Mac Parthaláin N, Aubrey A J, et al. Facial expression recognition in dynamic sequences: An integrated approach [J]. Pattern Recognition, 2014, 47(3): 1271–1281.

[4] Wechsler H, Phillips P J, Bruce V. Face recognition from theory to applications [M]. Berlin: Springer International Publishing, 2012: 23–35.

[5] Mahdi I, Hamed S H. A novel fuzzy facial expression recognition system based on facial feature extraction from color face images [J]. Engineering Applications of Artificial Intelligence, 2012, 25(1): 130–146.

[6] Connolly J F, Granger E, Sabourin R. An adaptive classification system for video-based face recognition [J]. Information Sciences, 2012, 192(6): 50–70.

[7] Fan X, Tjahjadi T. A spatial-temporal framework based on histogram of gradients and optical flow for facial expression recognition in video sequences [J]. Pattern Recognition, 2015, 48(11): 3 407–3 416.

[8] 王宇纬. 基于改进光流和HMM的人脸表情识别研究[D]. 天津: 天津大学, 2009.

[9] Fan X, Tjahjadi T. A spatial-temporal framework based on histogram of gradients and optical flow for facial expression recognition in video sequences [J]. Pattern Recognition, 2015, 32(2): 68–75.

[10] Member F R, Zhong N M. Facial expression recognition based on AAM–SIFT and adaptive regional weighting [J]. IEEE Transactions on Electrical & Electronic Engineering, 2015, 10(6): 713–722.

[11] 施毅. 基于主动外观模型的人脸表情识别研究[D]. 上海: 上海交通大学, 2012.

[12] Song M L, Tao D C, Liu Z C. Image ratio features for facial expression recognition application [J]. IEEE Transactions on Systems, Man and Cybernetics, 2010, 40(3): 779–788.

[13] Wang L, Li R, Wang K. A novel automatic facial expression recognition method based on AAM [J]. Journal of Computers, 2014, 9(3): 608–617.

[14] 万川. 基于动态序列图像的面部表情识别系统理论与方法研究[D]. 长春: 吉林大学, 2013.

[15] Cheon Y, Kim D. Natural facial expression recognition using differential-AAM and manifold learning [J]. Pattern Recognition, 2009, 42(7): 1 340–1 350.

[16] Sumathi C P, Santhanam T, Mahadevi M. Automatic facial expression analysis a survey [J]. International Journal of Computer Science & Engineering Survey, 2013, 3(6): 47–59.

[17] Ekman P, Friesen W. Constants across cultures in the face and emotion [J]. Journal of Personality and Social Psychology, 1971, 17(2): 124–129.

[18] Taormina R, Chau K W, Sethi R. Artificial neural network simulation of hourly groundwater levels in a coastal aquifer system of the venice lagoon [J]. Engineering Applications of Artificial Intelligence, 2012, 25(8): 1 670–1 676.

[19] Saudagare P V, Chaudhari D S. Facial expression recognition using neural network–an overview [J]. International Journal of Soft Computing and Engineering, 2012, 2(1): 224–227.

[20] Perveen N, Gupta S, Verma K. Facial expression recognition system using statistical feature and neural network [J]. International Journal of Computer Applications, 2012, 48(18): 17–23.

[21] Owusu E, Zhan Y, Mao Q R. A neural-AdaBoost based facial expression recognition system [J]. Expert Systems with Applications, 2014, 41(7): 3 383–3 390.

[22] 王赛. 基于动态模糊神经网络的人脸表情识别算法研究[D]. 重庆: 西南大学, 2012.

[23] Hu W, Gao J, Wang Y, et al. Online adaboost-based parameterized methods for dynamic distributed network intrusion detection [J]. IEEE Transactions on Cybernetics, 2014, 44(1): 66–82.

[24] Ghimire D, Lee J. Geometric feature-based facial expression recognition in image sequences using multi-class AdaBoost and support vector machines [J]. Sensors, 2013, 13(6): 7 714–7 734.

[25] Owusu E, Zhan Y, Mao Q R. An SVM-AdaBoost facial expression recognition system [J]. Applied Intelligence, 2014,40(3): 2 427–2 432.

[26] Prabhakar S, Sharma J, Gupta S. Facial expression recognition in video using adaboost and SVM [J]. International Journal of Computer Applications, 2014, 104(2): 1–4.

[27] Lozano-Monasor E, López M T, Fernández-Caballero A, et al. Facial expression recognition from webcam based on active shape models and support vector machines [M]. Berlin: Springer International Publishing, 2014: 147–154.

[28] Vijayalakshmi M, Senthil T. Automatic human facial expression recognition using Hidden Markov Model [C] // IEEE International Conference on Electronics and Communication Systems, Sanya, 2014: 1–4.

[29] 朱明旱, 李树涛, 叶华. 基于稀疏表示的遮挡人脸表情识别方法[J]. 模式识别与人工智能, 2014, 27(8): 708–712.

[30] Song I, Kim H J, Jeon P B. Deep learning for real-time robust facial expression recognition on a smartphone [C] // IEEE International Conference on Consumer Electronics, Sanya, 2014: 564–567.

[31] Pu X, Fan K, Chen X, et al. Facial expression recognition from image sequences using twofold random forest classifier [J]. Neurocomputing, 2015, 168: 1 173–1 180.

[32] Lajevardi S M, Hussain Z M. Higher order orthogonal moments for invariant facial expression recognition [J]. Digital Signal Processing, 2010, 20(6): 1 771–1 779.

[33] Fanelli G, Yao A, Noel P L, et al. Hough forest-based facial expression recognition from video sequences [M]. Berlin: Springer International Publishing, 2012: 195–206.

[34] Li Y, Wang S, Zhao Y, et al. Simultaneous facial feature tracking and facial expression recognition [J]. IEEE Transactions on Image Processing, 2013, 22(7): 2 559–2 573.

[35] Ekman P, Telling lies. Clues to deceit in the marketplace, politics, and marriage [M]. 2nd Ed. New York: Norton, 2001.

[36] 胡明银, 孟凡民. 微表情识别的侦查实用性探析[J]. 江西警察学院学报, 2011(3): 35–37.

[37] Zhang P, Ben X Y, Yang M Q. Algorithm of micro-expression recognition based on differential slices energy diagram and the Gabor transform [EB/OL]. http://www.paper.edu.cn/releasepaper/content/201312-994, 2013–12–27.

[38] Wang S J, Chen H L, Yan W J, et al. Face recognition and micro-expression recognition based on discriminant tensor subspace analysis plus extreme learning machine [J]. Neural processing letters, 2014, 39(1): 25–43.

[39] 朱明旱, 陈日新, 罗大庸. 基于流形学习的遮挡条件下表情识别方法[J]. 光电子: 激光, 2012, 10(23): 2 003–2 008.

[40] Lee Y H, Han W, Kim Y, et al. Robust emotion recognition algorithm for ambiguous facial expression using optimized AAM and k-NN [J]. International Journal of Security and Its Applications, 2014, 8(5): 203–212.

[41] Le V, Tang H, Huang T S. Expression recognition from 3D dynamic faces using robust spatio-temporal shape features [C] // IEEE International Conference on Automatic Face & Gesture Recognition, California, 2011: 414–421.

[42] Meng H, Bianchi-Berthouze N. Affective state level recognition in naturalistic facial and vocal expressions cybernetics [J]. IEEE Transactions on Cybernetics, 2014, 44(3): 315–328.

[43] Chao Xu, Qinghua Hu, Guangquan Xu, et al. An approach to facial expression analysis with multi-model interactions [J]. International Journal of Computer Mathematics, 2013, 91(11): 2 329–2 340.

[44] Li H, Ding H, Huang D, et al. An efficient multimodal 2D+3D feature-based approach to automatic facial expression recognition [J]. Computer Vision & Image Understanding, 2015, 140: 83–92.

(责任编校: 刘晓霞)

Review on facial expression recognition based on video image

Mei Ying1, 2, Tan Guanzheng2, Liu Zhentao3

(1. College of Electrical and Information Engineering, Hunan University of Arts and Science, Changde 415000, China; 2. School of Information Science and Engineering, Central South University, Changsha 410083, China)

Facial expression recognition is the precondition for the computer understanding human emotion, and it is the key to improve human-computer interaction. Firstly, a survey facial expression recognition in video is provided according to the three steps: face detection, facial feature extraction, expression classification. Algorithms applied in feature extraction and expression classification are mainly summarized, including their principles, advantages and disadvantages, applications, as well as the accuracy comparisons of some algorithms. Secondly, some issues about micro-expression recognition and robustness research are described in the human-computer interaction. Finally, the existing problems and the difficulties of facial expression recognition, as well as the issues worthy of further study are concluded.

Facial expression recognition; feature extraction; expression classification; micro-expression; robustness

TP 391

1672–6146(2016)03–0019–07

10.3969/j.issn.1672–6146.2016.03.005

梅英, 63641214@qq.com。

2016-06-05

国家自然科学基金青年科学基金项目(61403422)。乐等领域均有广泛地应用。

面部表情识别是近些年逐步兴起的情感计算的重要组成部分。美国麻省理工学院的 Picard教授[1]曾在《Affective Computing》中指出“情感是未来计算机能够有效工作的必要条件之一, 希望通过赋予计算机识别用户情感的能力, 以便更好地服务人类。”人类的情感常常通过面部表情、语音、姿态等来表达, 但是, 它们所传递的信息量有差别。美国心理学家 Mehrabian[2]提出“人们在交流的过程中, 面部表情能传递55%的信息量, 38%的信息量通过语调表现出来, 而语言本身传递的信息量只占7%。” 因此, 面部表情这一重要的信息载体将成为下一代人机交互模式的重要组成部分, 面部表情识别将是人机交互研究的重要内容。在服务机器人领域, 机器人通过识别人类的面部表情可以更好地服务人类; 在远程教育领域, 计算机通过监测学生在学习过程中的表情, 实时地调节教育资源; 此外, 表情识别在医疗、娱